General Flexible $f$-divergence for Challenging Offline RL Datasets with Low Stochasticity and Diverse Behavior Policies

作者: Jianxun Wang, Grant C. Forbes, Leonardo Villalobos-Arias, David L. Roberts

分类: cs.LG, cs.AI

发布日期: 2026-02-11

备注: Extended version of the full paper with the appendix accepted at AAMAS 2026

💡 一句话要点

提出通用灵活的f散度,提升离线强化学习在低随机性和多样化策略数据集上的性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 f散度 策略约束 贝尔曼残差 线性规划

📋 核心要点

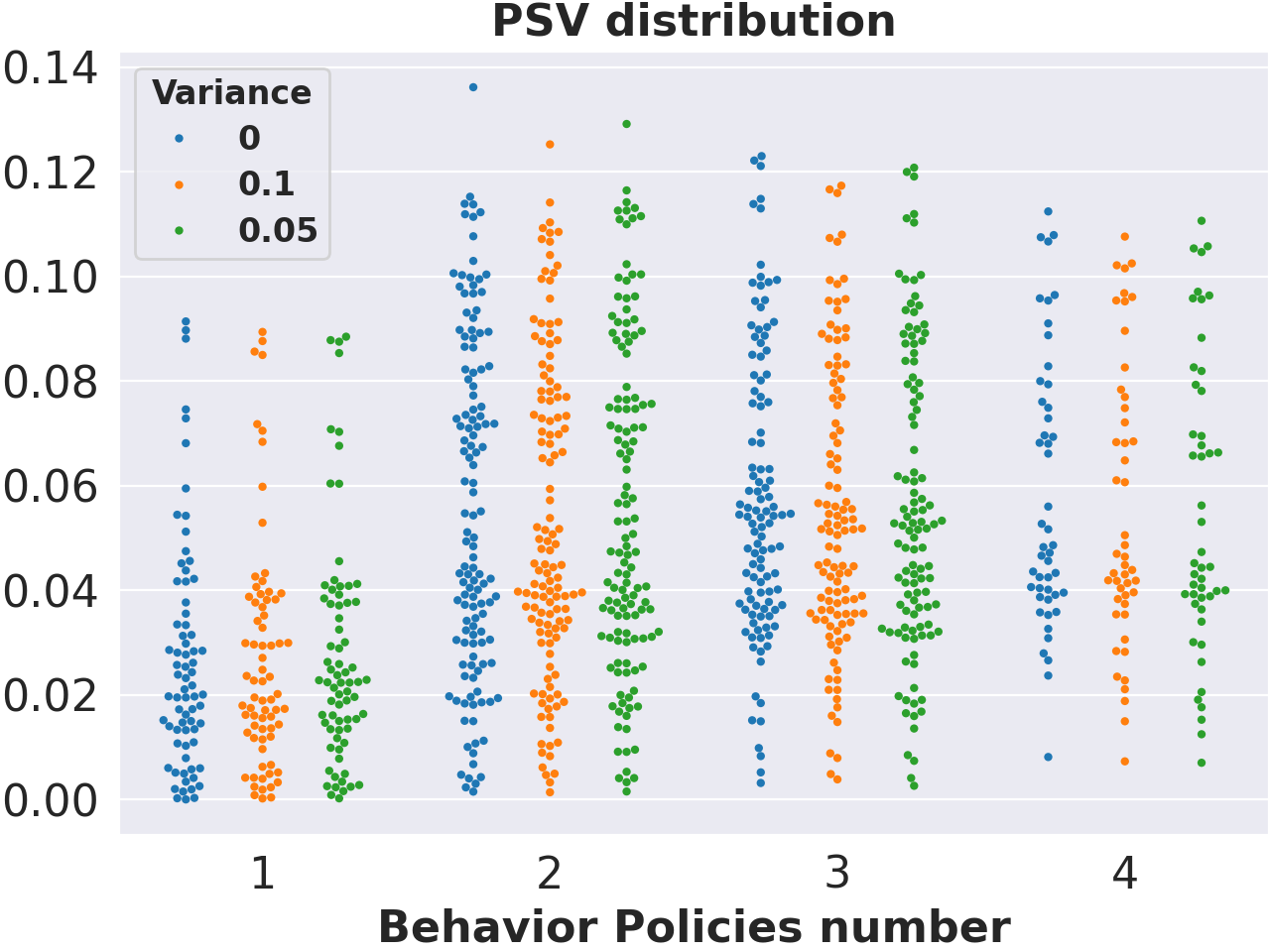

- 实际离线数据集常包含低多样性和多策略数据,导致Q/V值估计困难,保守策略约束限制了性能。

- 论文提出通用灵活的f散度,通过自适应约束算法学习目标,平衡RL目标和行为策略约束。

- 实验表明,该方法在MuJoCo、Fetch和AdroitHand等环境的挑战性数据集上,能有效提升性能。

📝 摘要(中文)

离线强化学习算法旨在改进生成收集数据的行为策略,同时将学习到的策略约束在数据集的支持范围内。然而,实际的离线数据集通常包含多样性不足或环境探索有限的样本,并且来自具有不同专业水平的多个行为策略。有限的探索会削弱离线强化学习算法估计Q或V值的能力,而约束于多样化的行为策略可能过于保守。这类数据集需要平衡强化学习目标和行为策略约束。我们首先通过更通用的强化学习线性规划形式和凸共轭,确定了f散度和贝尔曼残差优化约束之间的联系。在此基础上,我们引入了通用灵活的f散度函数形式,以基于离线训练数据集对算法的学习目标进行自适应约束。在MuJoCo、Fetch和AdroitHand环境上的实验结果表明,所提出的线性规划形式的正确性以及灵活的f散度在应用于兼容的约束优化算法时,在具有挑战性的数据集上提高学习性能的潜力。

🔬 方法详解

问题定义:离线强化学习旨在利用预先收集的数据集训练策略,而无需与环境进行交互。然而,实际数据集往往包含探索不足、多样性有限的数据,或者来自多个不同水平的行为策略。这导致传统的离线强化学习方法难以准确估计Q函数或V函数,并且为了保证安全性,通常需要施加保守的策略约束,从而限制了策略的改进空间。现有方法难以在探索不足和策略约束之间取得平衡。

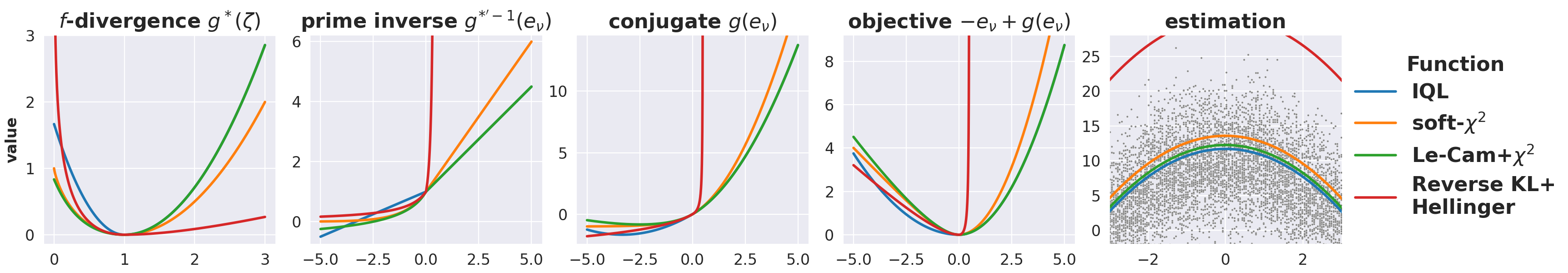

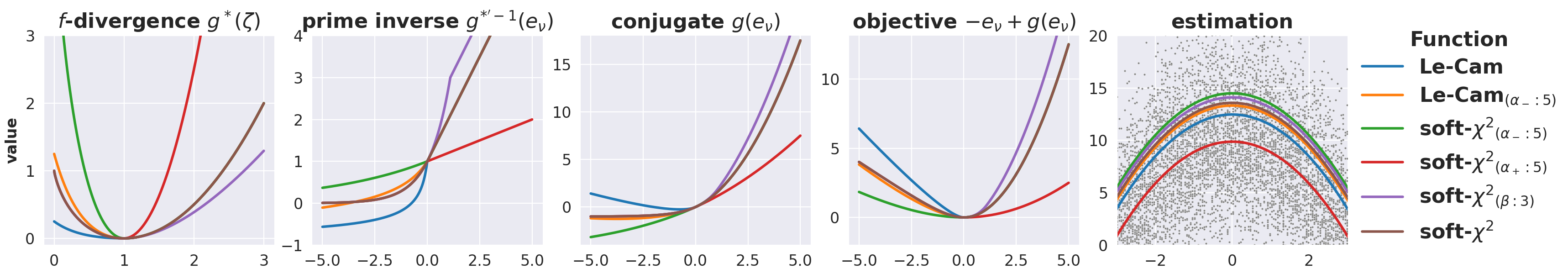

核心思路:论文的核心思路是引入一种通用且灵活的f散度,用于约束学习到的策略与数据集中的行为策略之间的差异。通过调整f散度的形式,可以自适应地控制策略约束的强度,从而在保证安全性的同时,允许策略在一定程度上偏离行为策略,以探索更优的策略。

技术框架:该方法首先建立了一个更通用的强化学习线性规划形式,并利用凸共轭将f散度与贝尔曼残差的优化约束联系起来。然后,引入了通用灵活的f散度函数形式,该形式允许根据离线训练数据集的特性自适应地调整约束强度。最后,将该f散度应用于现有的约束优化算法中,以实现离线强化学习。

关键创新:该方法最重要的创新点在于提出了通用灵活的f散度,它能够根据离线数据集的特性自适应地调整策略约束的强度。与传统的固定形式的f散度相比,该方法能够更好地平衡探索和安全性,从而在具有挑战性的离线数据集上取得更好的性能。此外,将f散度与贝尔曼残差的优化约束联系起来,为理解和设计离线强化学习算法提供了新的视角。

关键设计:通用灵活的f散度的具体形式需要根据具体的离线数据集进行设计。一种可能的设计是使用一个可学习的函数来表示f散度,并使用离线数据来训练该函数,使其能够自适应地调整策略约束的强度。此外,还需要选择合适的约束优化算法,并调整其参数,以保证算法的稳定性和收敛性。损失函数通常包含一个强化学习目标项和一个f散度约束项,用于平衡策略的性能和安全性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在MuJoCo、Fetch和AdroitHand等环境的挑战性数据集上,使用通用灵活的f散度能够显著提高离线强化学习算法的性能。与传统的离线强化学习算法相比,该方法能够取得更高的回报,并且能够更好地平衡探索和安全性。具体的性能提升幅度取决于数据集的特性和算法的参数设置。

🎯 应用场景

该研究成果可应用于各种需要离线强化学习的场景,例如机器人控制、自动驾驶、医疗决策等。特别是在数据收集成本高昂或与环境交互风险较大的情况下,离线强化学习具有重要的应用价值。通过使用通用灵活的f散度,可以提高离线强化学习算法在复杂数据集上的性能,从而实现更智能、更安全的决策。

📄 摘要(原文)

Offline RL algorithms aim to improve upon the behavior policy that produces the collected data while constraining the learned policy to be within the support of the dataset. However, practical offline datasets often contain examples with little diversity or limited exploration of the environment, and from multiple behavior policies with diverse expertise levels. Limited exploration can impair the offline RL algorithm's ability to estimate \textit{Q} or \textit{V} values, while constraining towards diverse behavior policies can be overly conservative. Such datasets call for a balance between the RL objective and behavior policy constraints. We first identify the connection between $f$-divergence and optimization constraint on the Bellman residual through a more general Linear Programming form for RL and the convex conjugate. Following this, we introduce the general flexible function formulation for the $f$-divergence to incorporate an adaptive constraint on algorithms' learning objectives based on the offline training dataset. Results from experiments on the MuJoCo, Fetch, and AdroitHand environments show the correctness of the proposed LP form and the potential of the flexible $f$-divergence in improving performance for learning from a challenging dataset when applied to a compatible constrained optimization algorithm.