MoEEdit: Efficient and Routing-Stable Knowledge Editing for Mixture-of-Experts LLMs

作者: Yupu Gu, Rongzhe Wei, Andy Zhu, Pan Li

分类: cs.LG

发布日期: 2026-02-11

💡 一句话要点

MoEEdit:面向MoE LLM的高效且路由稳定的知识编辑框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识编辑 混合专家模型 路由稳定 零空间投影 大型语言模型

📋 核心要点

- 现有知识编辑方法主要针对稠密模型,无法有效应用于日益重要的稀疏MoE模型。

- MoEEdit通过专家更新的零空间投影,保持路由器输入不变,抑制路由偏移,实现路由稳定。

- 实验表明,MoEEdit在效率、泛化性和路由稳定性方面均优于现有方法,且计算和内存效率更高。

📝 摘要(中文)

知识编辑(KE)使得对大型语言模型(LLM)中的事实内容进行精确修改成为可能。现有的KE方法主要为稠密架构设计,限制了它们在日益普及的稀疏混合专家(MoE)模型上的应用,而MoE模型是现代可扩展LLM的基础。尽管MoE提供了强大的效率和容量扩展,但简单地调整稠密模型编辑器既计算成本高昂,又容易产生路由分布偏移,从而破坏稳定性和一致性。为了解决这些挑战,我们推出了MoEEdit,这是第一个用于MoE LLM中参数修改知识编辑的路由稳定框架。我们的方法通过每个专家的零空间投影来重新参数化专家更新,从而保持路由器输入不变,并抑制路由偏移。由此产生的块结构优化通过块坐标下降(BCD)求解器有效地解决。实验表明,MoEEdit在保持高特异性和路由稳定性的同时,获得了最先进的功效和泛化能力,并具有卓越的计算和内存效率。这些结果为稀疏LLM中可扩展、精确的知识编辑奠定了坚实的基础,并强调了路由稳定干预的重要性。

🔬 方法详解

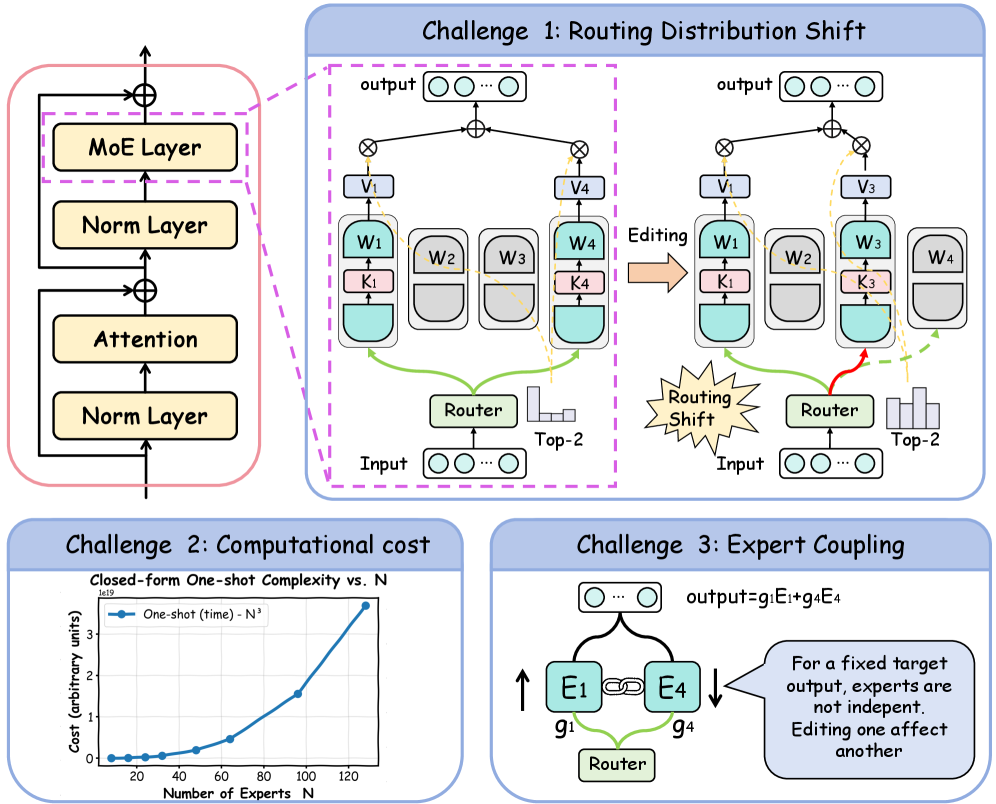

问题定义:现有知识编辑方法主要针对稠密模型设计,直接应用于MoE模型会导致计算成本高昂,并且由于路由分布的改变,会破坏模型的稳定性和一致性。因此,需要一种专门为MoE模型设计的知识编辑方法,能够在保证编辑效果的同时,维持路由的稳定性。

核心思路:MoEEdit的核心思路是通过重新参数化专家更新,使得更新后的模型在路由层面保持不变。具体来说,通过计算每个专家的零空间投影,将更新限制在不影响路由器输入的空间内,从而避免路由分布的偏移。

技术框架:MoEEdit的整体框架包括以下几个主要步骤:1) 确定需要编辑的知识;2) 计算每个专家的零空间投影;3) 在零空间内更新专家参数;4) 使用块坐标下降(BCD)求解器优化更新后的参数。该框架旨在通过限制参数更新对路由的影响,实现路由稳定的知识编辑。

关键创新:MoEEdit最关键的创新在于提出了基于零空间投影的路由稳定知识编辑方法。与直接更新专家参数的方法不同,MoEEdit通过将更新限制在不影响路由器的空间内,有效地避免了路由分布的偏移,从而保证了模型的稳定性和一致性。这是首次在MoE模型的知识编辑中考虑路由稳定性的工作。

关键设计:MoEEdit的关键设计包括:1) 使用每个专家的零空间投影来约束参数更新;2) 使用块坐标下降(BCD)求解器来高效地优化块结构化的目标函数;3) 损失函数的设计需要同时考虑编辑的有效性、泛化性和路由稳定性。具体的参数设置和网络结构细节取决于所使用的MoE模型。

🖼️ 关键图片

📊 实验亮点

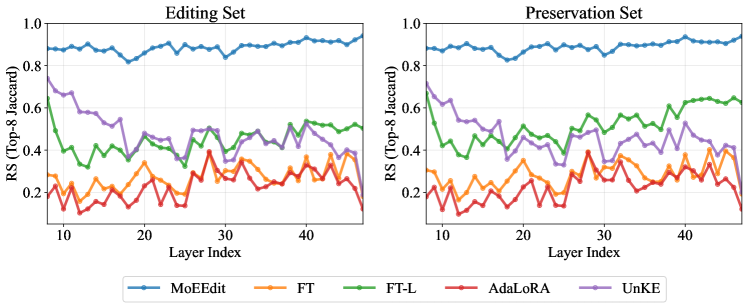

实验结果表明,MoEEdit在知识编辑的有效性、泛化性和路由稳定性方面均优于现有方法。具体来说,MoEEdit在保持高特异性的同时,实现了最先进的编辑效果和泛化能力,并且显著降低了路由分布的偏移。此外,MoEEdit还具有更高的计算和内存效率,使其能够应用于更大规模的MoE模型。

🎯 应用场景

MoEEdit在需要频繁更新知识的MoE LLM应用中具有广泛的应用前景,例如:1) 快速修复模型中的错误知识;2) 根据用户反馈定制模型行为;3) 持续学习新的知识并保持模型性能稳定。该研究为构建可信赖、可控的大型语言模型奠定了基础,并有望推动LLM在各个领域的应用。

📄 摘要(原文)

Knowledge editing (KE) enables precise modifications to factual content in large language models (LLMs). Existing KE methods are largely designed for dense architectures, limiting their applicability to the increasingly prevalent sparse Mixture-of-Experts (MoE) models that underpin modern scalable LLMs. Although MoEs offer strong efficiency and capacity scaling, naively adapting dense-model editors is both computationally costly and prone to routing distribution shifts that undermine stability and consistency. To address these challenges, we introduce MoEEdit, the first routing-stable framework for parameter-modifying knowledge editing in MoE LLMs. Our method reparameterizes expert updates via per-expert null-space projections that keep router inputs invariant and thereby suppress routing shifts. The resulting block-structured optimization is solved efficiently with a block coordinate descent (BCD) solver. Experiments show that MoEEdit attains state-of-the-art efficacy and generalization while preserving high specificity and routing stability, with superior compute and memory efficiency. These results establish a robust foundation for scalable, precise knowledge editing in sparse LLMs and underscore the importance of routing-stable interventions.