Rotary Positional Embeddings as Phase Modulation: Theoretical Bounds on the RoPE Base for Long-Context Transformers

作者: Feilong Liu

分类: cs.LG, cs.AI, cs.CL

发布日期: 2026-02-11

💡 一句话要点

通过相位调制理论分析RoPE,为长文本Transformer提供基准参数选择的理论依据。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 旋转位置编码 长文本Transformer 相位调制 信号处理 理论分析

📋 核心要点

- 现有RoPE在长文本中行为未充分描述,存在位置信息丢失风险,影响模型性能。

- 将RoPE视为相位调制,利用信号处理理论分析其在长文本中的位置编码能力。

- 推导出RoPE基参数的上下界,并验证了这些界限与现有模型的成功和失败案例相符。

📝 摘要(中文)

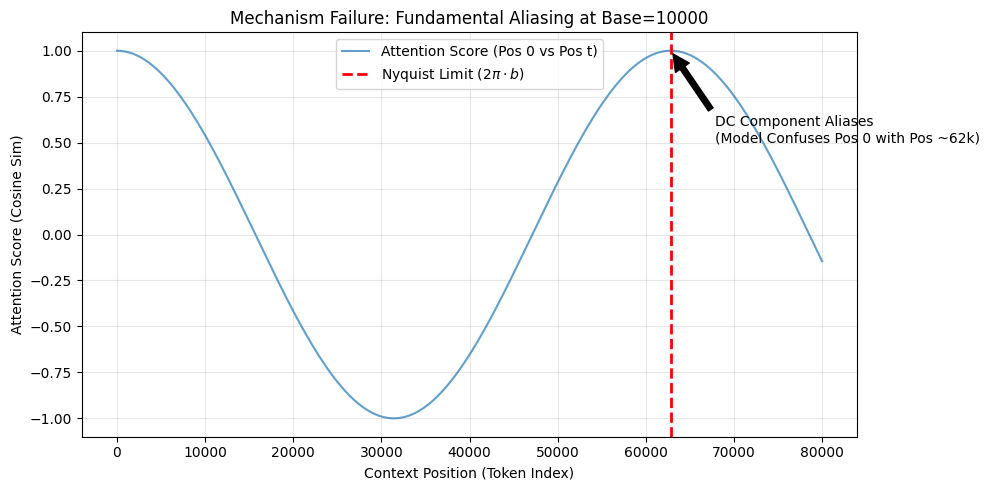

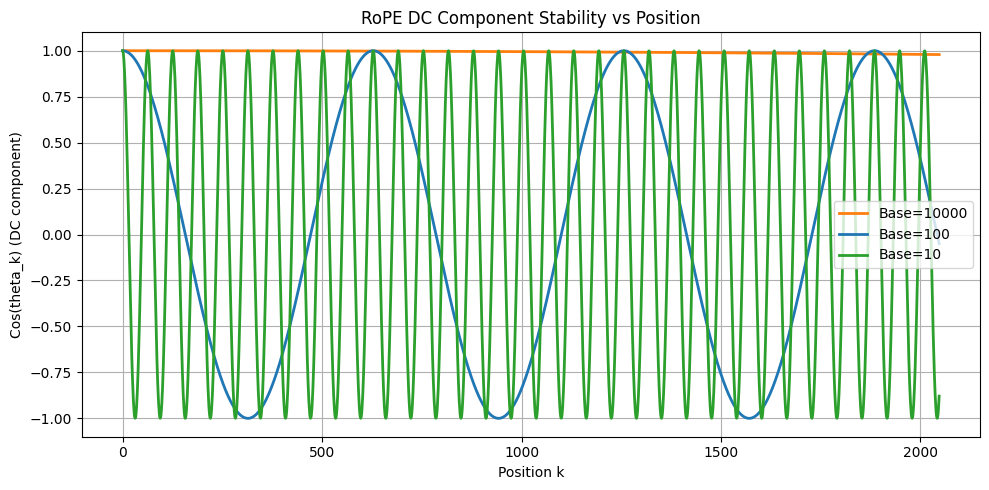

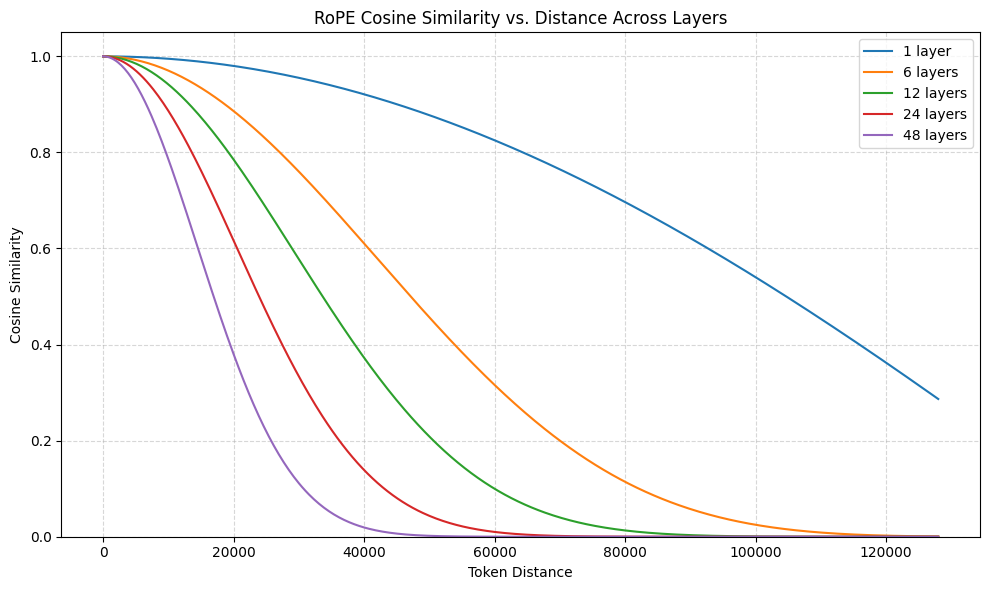

旋转位置嵌入(RoPE)被广泛应用于大型语言模型中,通过乘法旋转来编码token的位置,但其在长上下文长度下的行为仍未得到充分描述。本文将RoPE重新解释为应用于复数振荡器组的相位调制,从而可以通过经典信号处理理论进行分析。在此基础上,我们推导出了RoPE基参数的原则性下界,这些下界对于在目标上下文长度上保持位置连贯性是必要的。这些下界包括一个类似于奈奎斯特极限的基本混叠界限,以及一个约束低频位置模式相位漂移的直流分量稳定性界限。我们进一步将此分析扩展到深度Transformer,表明跨层的重复旋转调制会加剧角度不对齐,从而收紧对基参数的要求,随着深度的增加而增加。作为对这些结果的补充,我们推导出了一个由有限浮点分辨率引起的RoPE基参数的精度相关上限。超过此限制,即使在没有混叠的情况下,增量相位更新在数值上也变得无法区分,从而导致位置擦除。总之,下限和上限定义了一个精度和深度相关的可行区域——长上下文Transformer的黄金区域。

🔬 方法详解

问题定义:论文旨在解决长文本Transformer中,旋转位置编码(RoPE)在长序列下性能退化的问题。现有方法缺乏对RoPE基参数的理论指导,导致模型在处理超长文本时出现位置信息混叠和精度损失,进而影响模型的理解和生成能力。

核心思路:论文的核心思路是将RoPE重新解释为一种相位调制技术,类似于信号处理中的频率调制。通过这种类比,可以使用成熟的信号处理理论来分析RoPE的性质,并推导出RoPE基参数的上下界,从而保证RoPE在长文本中的有效性。

技术框架:论文的技术框架主要包括以下几个部分:1) 将RoPE建模为复数振荡器的相位调制;2) 推导RoPE基参数的下界,包括混叠界限和直流分量稳定性界限;3) 推导RoPE基参数的精度上限,考虑了浮点数精度对相位更新的影响;4) 通过实验验证理论推导的有效性,分析现有模型的RoPE基参数设置是否满足理论界限。

关键创新:论文的关键创新在于将RoPE与相位调制联系起来,从而可以使用信号处理的工具来分析RoPE的性质。这种新的视角为理解RoPE在长文本中的行为提供了理论基础,并为RoPE基参数的选择提供了指导。此外,论文还考虑了浮点数精度对RoPE的影响,这在以往的研究中很少被关注。

关键设计:论文的关键设计包括:1) 使用复数指数函数表示RoPE的旋转操作;2) 利用奈奎斯特采样定理推导混叠界限;3) 分析低频分量的相位漂移,推导直流分量稳定性界限;4) 考虑浮点数精度,分析相位更新的最小可区分值,推导精度上限。

🖼️ 关键图片

📊 实验亮点

论文通过案例分析验证了理论框架的有效性,发现LLaMA、Mistral和DeepSeek等模型的成功、失败以及社区的改进措施与预测的界限密切相关。违反稳定性界限的模型表现出注意力崩溃和长程退化,而试图扩展到一百万个token以上的模型则遇到了与架构或训练无关的硬精度壁垒。

🎯 应用场景

该研究成果可应用于各种需要处理长文本的自然语言处理任务,例如长文档摘要、机器翻译、对话生成等。通过合理设置RoPE的基参数,可以提高模型在长文本上的性能,并扩展Transformer模型的应用范围。此外,该研究也为其他位置编码方法的设计提供了理论参考。

📄 摘要(原文)

Rotary positional embeddings (RoPE) are widely used in large language models to encode token positions through multiplicative rotations, yet their behavior at long context lengths remains poorly characterized. In this work, we reinterpret RoPE as phase modulation applied to a bank of complex oscillators, enabling analysis through classical signal processing theory. Under this formulation, we derive principled lower bounds on the RoPE base parameter that are necessary to preserve positional coherence over a target context length. These include a fundamental aliasing bound, analogous to a Nyquist limit, and a DC-component stability bound that constrains phase drift in low-frequency positional modes. We further extend this analysis to deep transformers, showing that repeated rotary modulation across layers compounds angular misalignment, tightening the base requirement as depth increases. Complementing these results, we derive a precision-dependent upper bound on the RoPE base arising from finite floating-point resolution. Beyond this limit, incremental phase updates become numerically indistinguishable, leading to positional erasure even in the absence of aliasing. Together, the lower and upper bounds define a precision- and depth-dependent feasibility region a Goldilocks zone for long-context transformers. We validate the framework through a comprehensive case study of state-of-the-art models, including LLaMA, Mistral, and DeepSeek variants, showing that observed successes, failures, and community retrofits align closely with the predicted bounds. Notably, models that violate the stability bound exhibit attention collapse and long-range degradation, while attempts to scale beyond one million tokens encounter a hard precision wall independent of architecture or training.