SimuScene: Training and Benchmarking Code Generation to Simulate Physical Scenarios

作者: Yanan Wang, Renxi Wang, Yongxin Wang, Xuezhi Liang, Fajri Koto, Timothy Baldwin, Xiaodan Liang, Haonan Li

分类: cs.LG

发布日期: 2026-02-11

💡 一句话要点

SimuScene:训练和评估LLM生成代码以模拟物理场景

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 物理场景模拟 代码生成 大型语言模型 强化学习 视觉奖励

📋 核心要点

- 现有大型语言模型在物理场景模拟方面能力不足,缺乏系统性的训练和评估。

- SimuScene通过构建包含多个物理领域的数据集,并结合强化学习方法,提升LLM的代码生成能力。

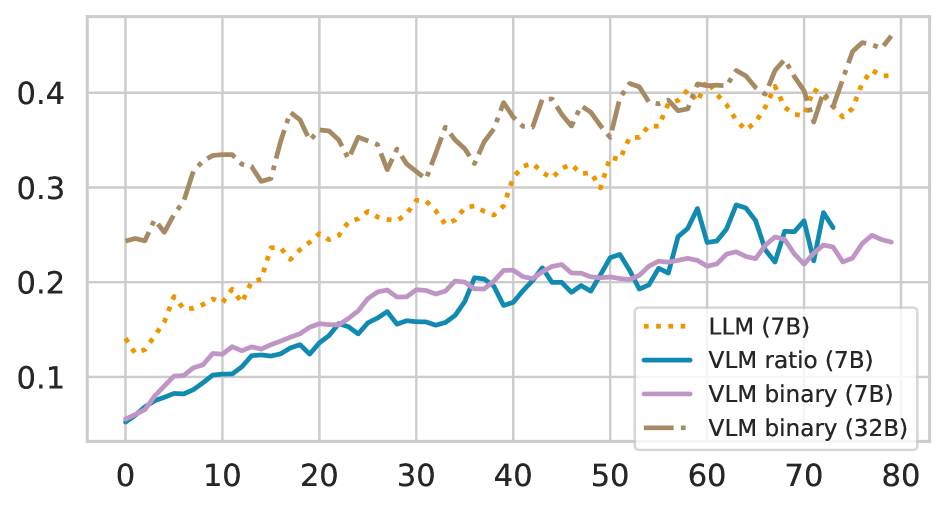

- 实验结果表明,使用SimuScene训练的数据可以有效提高物理模拟代码生成能力,并提升通用代码生成性能。

📝 摘要(中文)

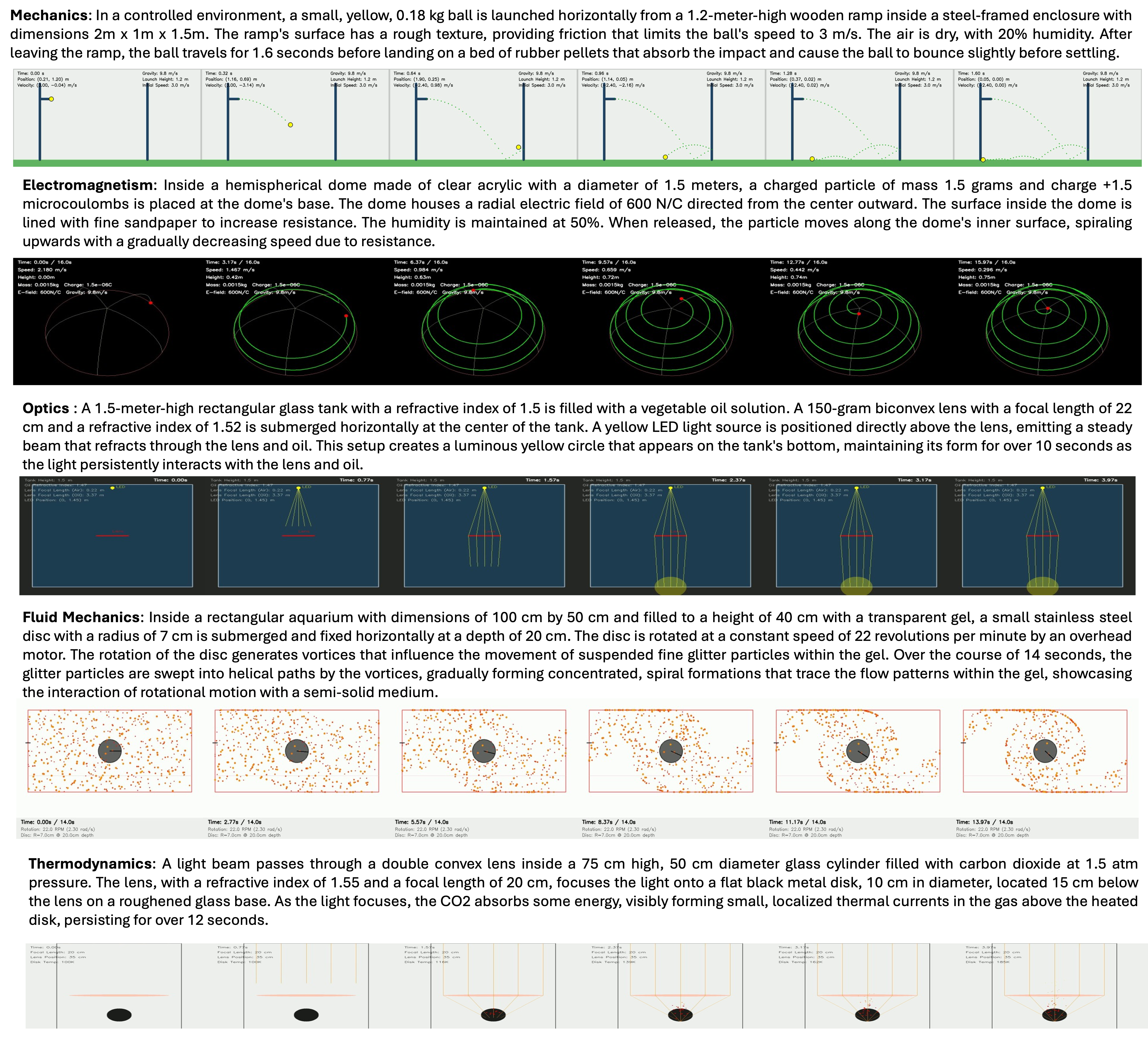

大型语言模型(LLMs)在数学竞赛、复杂编码和科学推理等任务中得到了广泛研究,但它们通过代码准确表示和模拟物理场景的能力仍未得到充分探索。我们提出了SimuScene,这是第一个系统性研究,旨在训练和评估LLMs在五个物理领域和52个物理概念中模拟物理场景的能力。我们构建了一个自动化的数据收集流程,并通过人工验证来确保质量。最终数据集包含7659个物理场景,其中334个经过人工验证的示例作为测试集。我们评估了10个最新的LLMs,发现即使是最强大的模型也仅达到21.5%的通过率,这表明了该任务的难度。最后,我们引入了一个带有视觉奖励的强化学习流程,该流程使用视觉-语言模型作为裁判来训练文本模型。实验表明,使用我们的数据进行训练可以提高通过代码进行物理模拟的能力,同时显著提高通用代码生成性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在通过代码准确模拟物理场景方面的不足。现有方法缺乏针对物理场景的系统性训练数据和评估基准,导致LLMs难以有效理解和模拟物理世界的规律。现有方法在处理复杂物理概念和场景时,代码生成质量较低,难以满足实际应用需求。

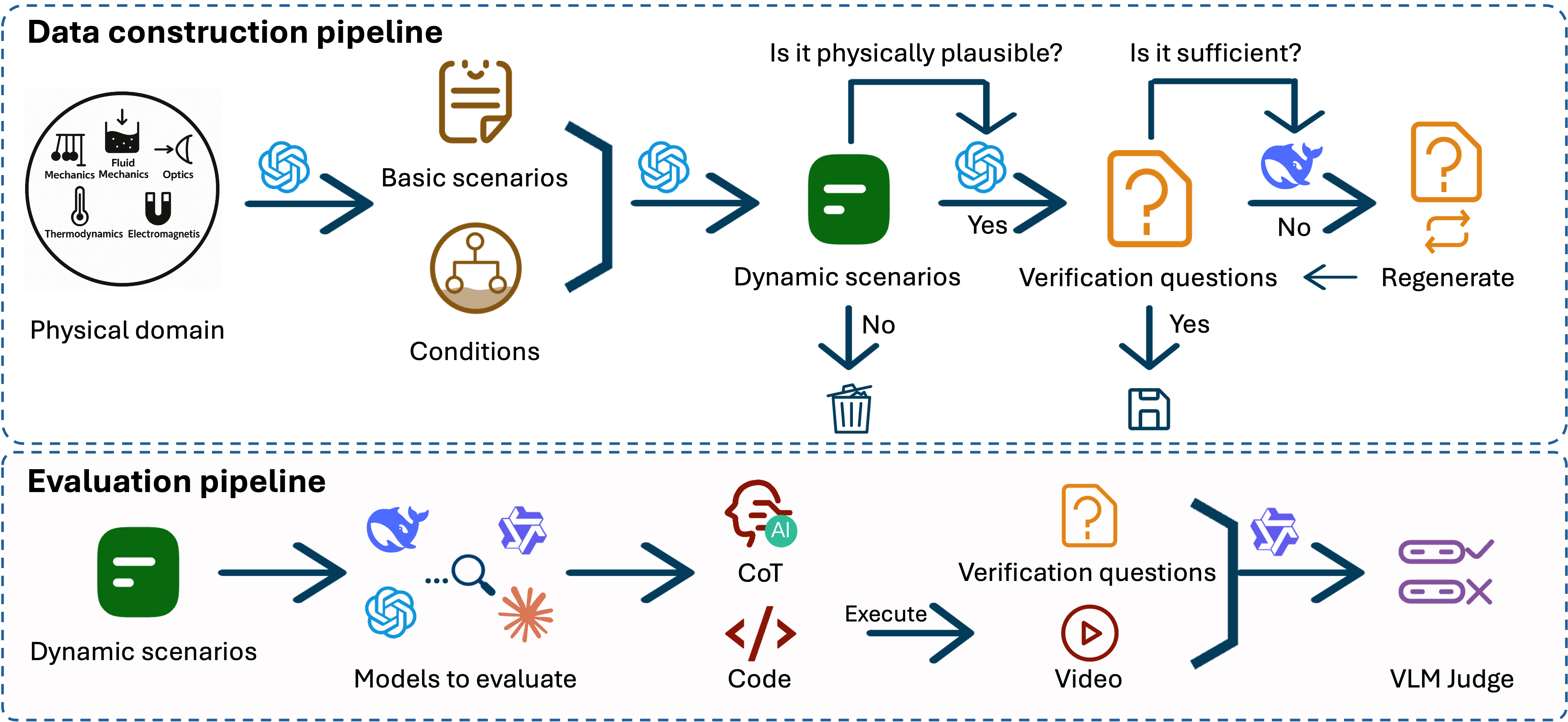

核心思路:论文的核心思路是构建一个高质量的物理场景模拟数据集(SimuScene),并利用该数据集训练LLMs,使其能够更好地理解和模拟物理现象。同时,引入基于视觉奖励的强化学习方法,进一步提升LLMs的代码生成能力。通过视觉-语言模型作为裁判,对生成的代码进行评估,并根据评估结果调整模型参数,从而提高代码的准确性和可靠性。

技术框架:SimuScene的整体框架包括以下几个主要模块:1) 数据收集模块:自动化地从各种来源收集物理场景数据,并进行初步筛选。2) 人工验证模块:对收集到的数据进行人工验证,确保数据的质量和准确性。3) 模型训练模块:使用SimuScene数据集训练LLMs,并结合强化学习方法进行优化。4) 评估模块:使用人工验证的测试集评估LLMs的性能,并分析模型的优缺点。5) 强化学习模块:使用视觉-语言模型作为奖励函数,通过强化学习进一步优化LLM的代码生成能力。

关键创新:论文的关键创新点在于:1) 提出了SimuScene数据集,这是第一个专门用于训练和评估LLMs模拟物理场景的数据集。2) 引入了基于视觉奖励的强化学习方法,利用视觉-语言模型作为裁判,提高了代码生成的准确性和可靠性。3) 系统性地评估了多个LLMs在物理场景模拟方面的性能,并分析了模型的优缺点。

关键设计:在数据收集方面,论文设计了一个自动化的流程,从多个来源收集数据,并进行初步筛选。在人工验证方面,论文采用了多轮验证机制,确保数据的质量和准确性。在强化学习方面,论文使用了视觉-语言模型作为奖励函数,该模型能够根据生成的代码模拟的物理场景,给出相应的奖励。具体参数设置和损失函数细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是最强的LLM在SimuScene测试集上的通过率也仅为21.5%,表明该任务具有挑战性。通过使用SimuScene数据集进行训练,并结合基于视觉奖励的强化学习方法,LLM的代码生成能力得到了显著提升。具体提升幅度未知,论文中未给出明确的量化数据。

🎯 应用场景

该研究成果可应用于机器人控制、游戏开发、科学教育等领域。例如,可以利用训练好的LLM生成控制代码,使机器人能够在复杂的物理环境中完成任务。在游戏开发中,可以利用LLM生成逼真的物理效果,提高游戏的沉浸感。在科学教育中,可以利用LLM生成模拟程序,帮助学生更好地理解物理概念。

📄 摘要(原文)

Large language models (LLMs) have been extensively studied for tasks like math competitions, complex coding, and scientific reasoning, yet their ability to accurately represent and simulate physical scenarios via code remains underexplored. We propose SimuScene, the first systematic study that trains and evaluates LLMs on simulating physical scenarios across five physics domains and 52 physical concepts. We build an automatic pipeline to collect data, with human verification to ensure quality. The final dataset contains 7,659 physical scenarios with 334 human-verified examples as the test set. We evaluated 10 contemporary LLMs and found that even the strongest model achieves only a 21.5% pass rate, demonstrating the difficulty of the task. Finally, we introduce a reinforcement learning pipeline with visual rewards that uses a vision-language model as a judge to train textual models. Experiments show that training with our data improves physical simulation via code while substantially enhancing general code generation performance.