Learning Mixture Density via Natural Gradient Expectation Maximization

作者: Yutao Chen, Jasmine Bayrooti, Steven Morad

分类: cs.LG

发布日期: 2026-02-11

💡 一句话要点

提出基于自然梯度期望最大化的混合密度网络训练方法,加速收敛并避免模式崩塌。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 混合密度网络 自然梯度下降 期望最大化 信息几何 深度隐变量模型

📋 核心要点

- 传统混合密度网络训练依赖负对数似然,存在收敛慢和模式崩塌问题。

- 论文提出自然梯度期望最大化(nGEM)方法,利用信息几何加速训练。

- 实验表明,nGEM显著提升收敛速度,在高维数据上表现优于传统方法。

📝 摘要(中文)

混合密度网络(MDN)是一种利用高斯混合模型表示连续多模态条件密度的神经网络。标准的训练过程通常采用最大似然估计,并使用负对数似然(NLL)作为目标函数,但这种方法收敛速度慢且容易发生模式崩塌。本文通过整合信息几何来改进混合密度网络的优化。具体来说,我们将混合密度网络解释为深度隐变量模型,并通过期望最大化框架对其进行分析,揭示了其与自然梯度下降之间令人惊讶的理论联系。然后,我们利用这些联系推导出自然梯度期望最大化(nGEM)目标函数。实验结果表明,nGEM在几乎不增加计算开销的情况下,实现了高达10倍的收敛速度提升,并且可以很好地扩展到NLL失效的高维数据。

🔬 方法详解

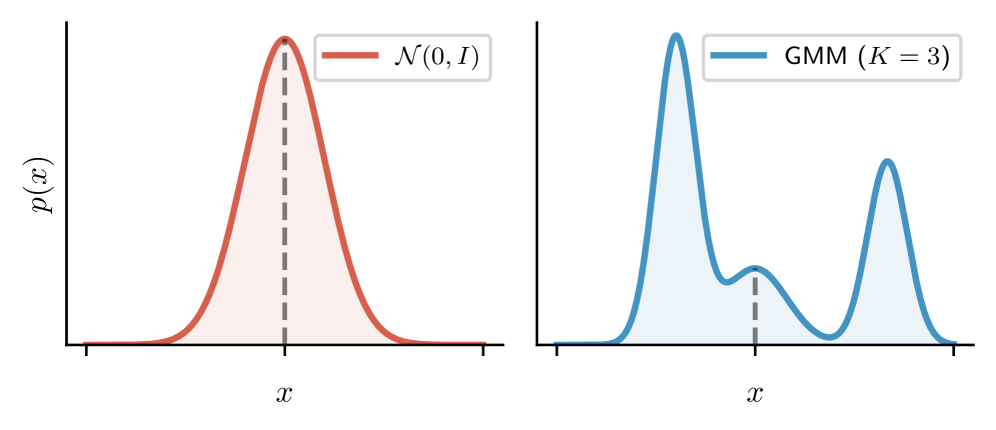

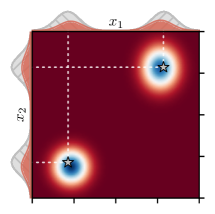

问题定义:混合密度网络旨在学习条件概率分布,尤其擅长处理多模态数据。然而,使用负对数似然(NLL)进行训练时,优化过程容易陷入局部最优,导致收敛速度慢,甚至出现模式崩塌,即模型只学习到部分数据模式。

核心思路:论文的核心在于将混合密度网络视为深度隐变量模型,并利用期望最大化(EM)算法的框架进行优化。通过分析EM算法与自然梯度下降之间的联系,推导出一种新的目标函数,即自然梯度期望最大化(nGEM)。这种方法旨在利用信息几何的优势,更有效地探索参数空间,从而加速收敛并避免模式崩塌。

技术框架:该方法主要包含以下几个步骤:1. 将混合密度网络视为深度隐变量模型。2. 推导EM算法框架下的更新规则。3. 建立EM算法与自然梯度下降之间的联系。4. 基于自然梯度下降,推导出nGEM目标函数。5. 使用nGEM目标函数训练混合密度网络。

关键创新:最关键的创新在于将自然梯度下降的思想融入到混合密度网络的EM训练框架中。与传统的基于梯度下降的方法不同,自然梯度下降考虑了参数空间的几何结构,能够更准确地估计梯度方向,从而加速收敛。此外,nGEM方法在计算上非常高效,几乎没有增加额外的计算开销。

关键设计:论文中关键的设计包括:1. 将混合密度网络建模为深度隐变量模型,这为应用EM算法提供了理论基础。2. 推导nGEM目标函数,该函数利用了自然梯度的信息,能够更有效地优化模型参数。3. 实验中,作者使用了标准的混合密度网络结构,并针对不同的数据集调整了网络参数和训练策略。损失函数为推导出的nGEM目标函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,nGEM方法在多个数据集上都取得了显著的性能提升。与传统的NLL方法相比,nGEM实现了高达10倍的收敛速度提升,并且在高维数据上表现出更强的鲁棒性。例如,在某个高维数据集上,NLL方法无法有效收敛,而nGEM方法则能够成功训练出高质量的混合密度网络。

🎯 应用场景

该研究成果可广泛应用于需要建模条件概率分布的领域,例如机器人运动规划、语音合成、图像生成和金融建模等。通过提高混合密度网络的训练效率和稳定性,可以使其更好地适应复杂的数据分布,从而提升相关应用的性能和可靠性。未来,该方法有望进一步扩展到其他类型的神经网络和概率模型。

📄 摘要(原文)

Mixture density networks are neural networks that produce Gaussian mixtures to represent continuous multimodal conditional densities. Standard training procedures involve maximum likelihood estimation using the negative log-likelihood (NLL) objective, which suffers from slow convergence and mode collapse. In this work, we improve the optimization of mixture density networks by integrating their information geometry. Specifically, we interpret mixture density networks as deep latent-variable models and analyze them through an expectation maximization framework, which reveals surprising theoretical connections to natural gradient descent. We then exploit such connections to derive the natural gradient expectation maximization (nGEM) objective. We show that empirically nGEM achieves up to 10$\times$ faster convergence while adding almost zerocomputational overhead, and scales well to high-dimensional data where NLL otherwise fails.