CoFEH: LLM-driven Feature Engineering Empowered by Collaborative Bayesian Hyperparameter Optimization

作者: Beicheng Xu, Keyao Ding, Wei Liu, Yupeng Lu, Bin Cui

分类: cs.LG

发布日期: 2026-02-10

💡 一句话要点

CoFEH:基于协同贝叶斯超参数优化的LLM驱动特征工程

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动化机器学习 特征工程 大型语言模型 贝叶斯优化 超参数优化 协同优化 思维树

📋 核心要点

- 传统特征工程方法受限于预定义搜索空间,缺乏领域知识,难以充分挖掘特征。

- CoFEH通过LLM驱动的特征工程和贝叶斯超参数优化协同工作,实现端到端AutoML。

- 实验结果表明,CoFEH在性能上优于传统和基于LLM的特征工程方法,提升了端到端性能。

📝 摘要(中文)

特征工程(FE)在自动化机器学习(AutoML)中至关重要,但传统方法将其视为黑盒搜索,在僵化的预定义搜索空间中操作,缺乏领域感知,这仍然是一个瓶颈。大型语言模型(LLM)通过利用语义推理生成无界算子提供了一种有希望的替代方案,但现有方法未能构建自由形式的FE流水线,仍然局限于孤立的子任务,例如特征生成。最重要的是,它们很少与ML模型的超参数优化(HPO)联合优化,导致贪婪的“FE-then-HPO”工作流程,无法捕捉到强大的FE-HPO交互。在本文中,我们提出了CoFEH,一个协同框架,它交错LLM的FE和贝叶斯HPO,以实现鲁棒的端到端AutoML。CoFEH使用由思维树(ToT)驱动的LLM驱动的FE优化器来探索灵活的FE流水线,一个贝叶斯优化(BO)模块来解决HPO,以及一个动态优化器选择器,通过自适应地调度FE和HPO步骤来实现交错优化。至关重要的是,我们引入了一种相互调节机制,在LLM和BO之间共享上下文,从而实现相互知情的决策。实验表明,CoFEH不仅优于传统的和基于LLM的FE基线,而且在联合优化下实现了卓越的端到端性能。

🔬 方法详解

问题定义:论文旨在解决自动化机器学习中特征工程的瓶颈问题。现有方法,包括传统方法和一些基于LLM的方法,要么搜索空间受限,要么无法进行端到端的联合优化,导致性能受限。特别是“FE-then-HPO”的策略无法捕捉特征工程和超参数优化之间的强交互作用。

核心思路:论文的核心思路是构建一个协同框架CoFEH,该框架将LLM驱动的特征工程与贝叶斯超参数优化交错进行,并通过相互调节机制共享上下文信息,从而实现特征工程和超参数优化的联合优化。这种协同优化能够更好地捕捉两者之间的依赖关系,提升最终的模型性能。

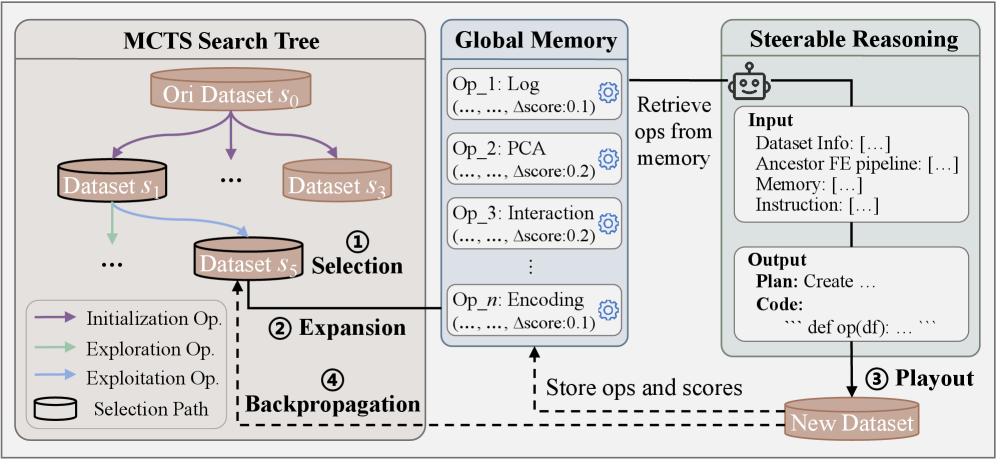

技术框架:CoFEH框架包含三个主要模块:LLM驱动的特征工程优化器、贝叶斯优化(BO)模块和动态优化器选择器。LLM驱动的特征工程优化器使用思维树(ToT)探索灵活的特征工程流水线。BO模块负责超参数优化。动态优化器选择器自适应地调度特征工程和超参数优化步骤,实现交错优化。此外,框架还包含一个相互调节机制,用于在LLM和BO之间共享上下文信息。

关键创新:CoFEH的关键创新在于其协同优化框架和相互调节机制。传统的特征工程和超参数优化通常是独立进行的,而CoFEH通过交错优化和信息共享,实现了两者之间的协同作用。相互调节机制使得LLM和BO能够相互学习,从而做出更明智的决策。

关键设计:CoFEH使用思维树(ToT)来指导LLM进行特征工程的探索,允许LLM生成和评估多个候选特征。动态优化器选择器使用强化学习来学习最佳的调度策略,以平衡特征工程和超参数优化之间的资源分配。相互调节机制通过共享特征工程的元信息和超参数优化的结果来实现信息共享。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CoFEH在多个数据集上优于传统的和基于LLM的特征工程基线。CoFEH不仅在特征工程方面表现出色,而且在端到端性能方面也取得了显著提升。具体性能数据和提升幅度在论文中有详细展示,证明了CoFEH的有效性和优越性。

🎯 应用场景

CoFEH可应用于各种机器学习任务,尤其是在数据特征工程复杂且需要精细超参数调整的场景下。例如,金融风控、医疗诊断、推荐系统等领域,CoFEH能够自动发现有效的特征组合和最优的超参数配置,从而提升模型性能,降低人工成本,加速模型部署。

📄 摘要(原文)

Feature Engineering (FE) is pivotal in automated machine learning (AutoML) but remains a bottleneck for traditional methods, which treat it as a black-box search, operating within rigid, predefined search spaces and lacking domain awareness. While Large Language Models (LLMs) offer a promising alternative by leveraging semantic reasoning to generate unbounded operators, existing methods fail to construct free-form FE pipelines, remaining confined to isolated subtasks such as feature generation. Most importantly, they are rarely optimized jointly with hyperparameter optimization (HPO) of the ML model, leading to greedy "FE-then-HPO" workflows that cannot capture strong FE-HPO interactions. In this paper, we present CoFEH, a collaborative framework that interleaves LLM-based FE and Bayesian HPO for robust end-to-end AutoML. CoFEH uses an LLM-driven FE optimizer powered by Tree of Thought (ToT) to explore flexible FE pipelines, a Bayesian optimization (BO) module to solve HPO, and a dynamic optimizer selector that realizes interleaved optimization by adaptively scheduling FE and HPO steps. Crucially, we introduce a mutual conditioning mechanism that shares context between LLM and BO, enabling mutually informed decisions. Experiments show that CoFEH not only outperforms traditional and LLM-based FE baselines, but also achieves superior end-to-end performance under joint optimization.