Latent Poincaré Shaping for Agentic Reinforcement Learning

作者: Hanchen Xia, Baoyou Chen, Zelin Zang, Yutang Ge, Guojiang Zhao, Siyu Zhu

分类: cs.LG

发布日期: 2026-02-10

💡 一句话要点

LaPha:在庞加莱潜在空间中训练类AlphaZero的LLM智能体,提升数学问题求解能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 大型语言模型 庞加莱空间 数学问题求解 智能体 搜索算法 奖励函数

📋 核心要点

- 现有LLM智能体在复杂数学问题求解中面临推理能力不足的挑战,尤其是在探索解空间时效率较低。

- LaPha利用庞加莱空间的负曲率特性,使智能体能够更有效地探索解空间,并使用双曲测地距离评估解的正确性。

- 实验表明,LaPha显著提升了LLM智能体在MATH-500和AIME等数学数据集上的求解准确率,验证了其有效性。

📝 摘要(中文)

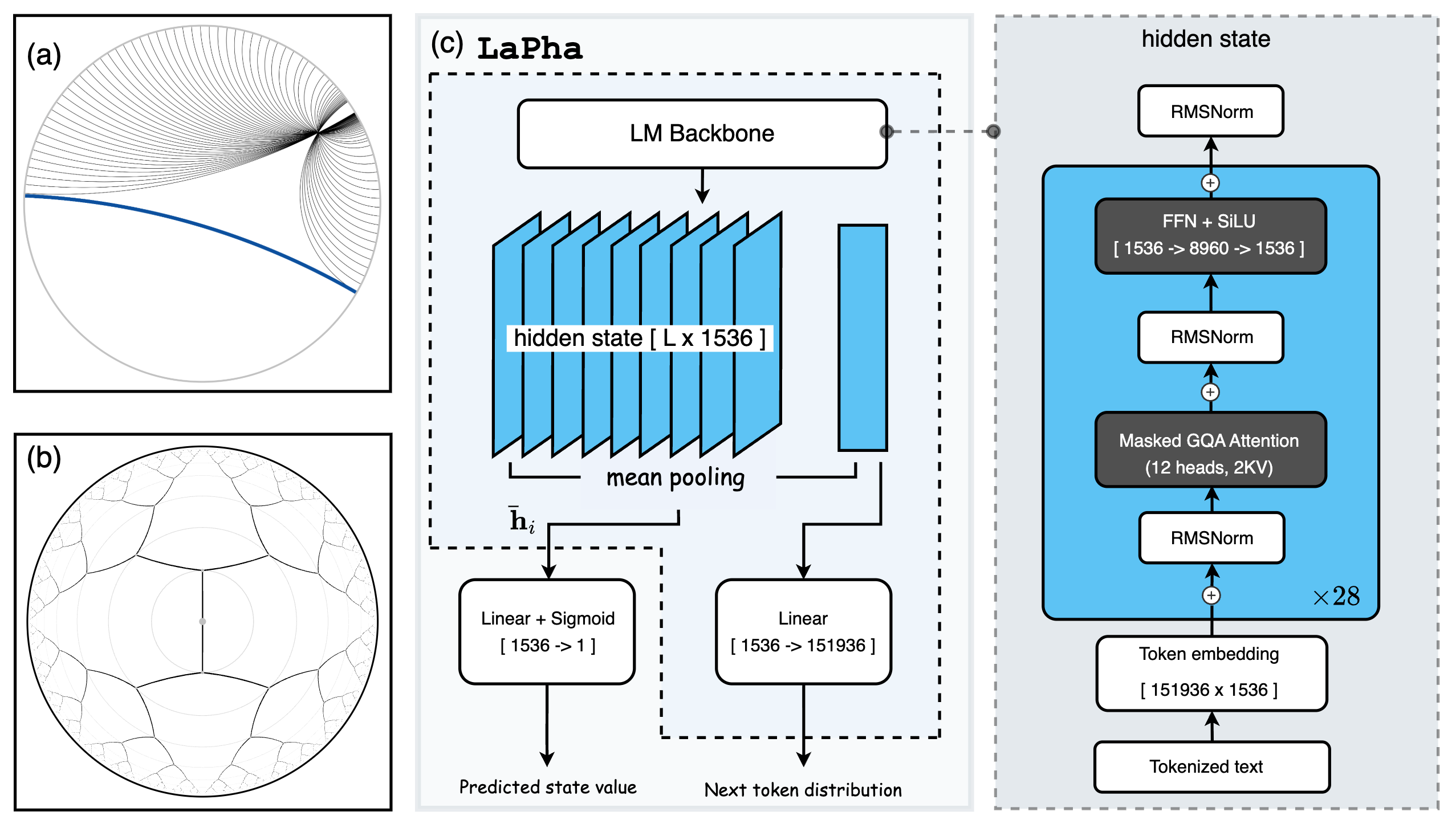

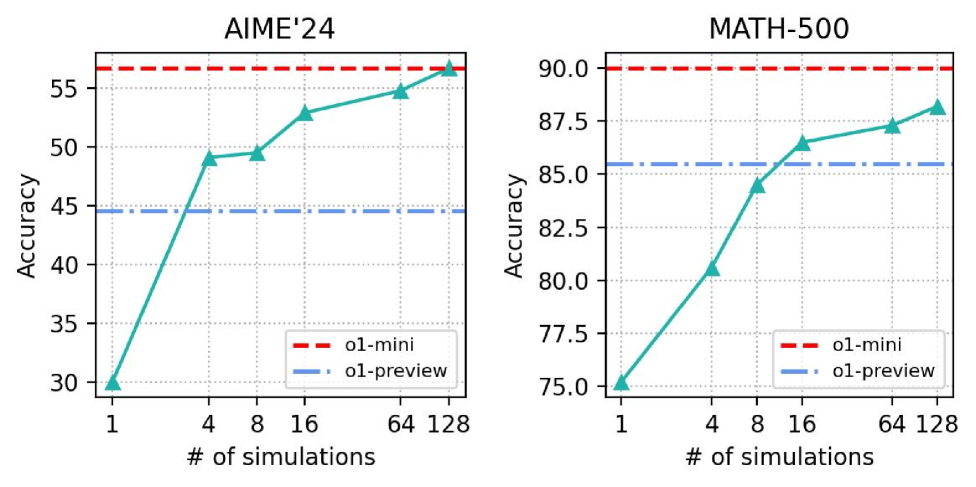

本文提出LaPha,一种在庞加莱潜在空间中训练类AlphaZero的LLM智能体的方法。在LaPha下,搜索过程可以被可视化为一棵树,树根位于提示词,并从原点向庞加莱球的边界向外生长,其中负曲率提供了随半径呈指数增长的容量。利用双曲测地距离来衡量规则验证的正确性,我们定义了一个节点势,并通过势差分配密集的进程奖励。我们还在同一个共享潜在空间上附加了一个轻量级的值头,从而实现几乎没有额外开销的自引导测试时缩放。在MATH-500数据集上,LaPha将Qwen2.5-Math-1.5B的准确率从66.0%提高到88.2%。通过值头引导的搜索,LaPha-1.5B在AIME'24上达到了56.7%的准确率,LaPha-7B在AIME'24上进一步达到了60.0%,在AIME'25上达到了53.3%。

🔬 方法详解

问题定义:论文旨在提升LLM智能体在复杂数学问题求解任务中的性能。现有方法,如直接使用LLM或简单的搜索算法,在探索庞大的解空间时效率低下,难以找到正确的解。此外,缺乏有效的奖励机制来指导搜索过程,导致训练困难。

核心思路:论文的核心思路是将LLM智能体嵌入到庞加莱潜在空间中进行训练。庞加莱空间的负曲率特性使得智能体能够以指数方式扩展搜索空间,从而更有效地探索可能的解。同时,利用双曲测地距离来衡量解的正确性,并基于节点势差设计密集的奖励函数,以指导智能体的搜索方向。

技术框架:LaPha的整体框架包括以下几个主要模块:1) 庞加莱潜在空间:将LLM的输出嵌入到庞加莱球中。2) 搜索树构建:从提示词开始,在庞加莱空间中构建搜索树,每个节点代表一个中间解。3) 节点势评估:使用双曲测地距离计算节点势,反映解的正确性。4) 奖励函数设计:基于节点势差分配奖励,鼓励智能体探索更有希望的解。5) 值头:附加一个轻量级的值头,用于评估当前状态的价值,指导搜索过程。

关键创新:LaPha的关键创新在于将庞加莱几何引入到LLM智能体的训练中,利用其负曲率特性来提升搜索效率。与传统的欧几里得空间相比,庞加莱空间能够以更少的计算资源探索更大的解空间。此外,基于双曲测地距离的奖励函数设计,能够更准确地评估解的正确性,从而更好地指导智能体的学习。

关键设计:关键设计包括:1) 使用双曲测地距离作为评估解正确性的指标。2) 基于节点势差设计密集的奖励函数,鼓励智能体探索更有希望的解。3) 附加一个轻量级的值头,用于评估当前状态的价值,指导搜索过程。4) 采用AlphaZero-like的训练方式,通过自博弈来提升智能体的性能。具体参数设置和网络结构细节在论文中未详细说明,可能需要参考相关文献。

🖼️ 关键图片

📊 实验亮点

LaPha在MATH-500数据集上将Qwen2.5-Math-1.5B的准确率从66.0%提高到88.2%,提升显著。此外,通过值头引导的搜索,LaPha-1.5B在AIME'24上达到了56.7%的准确率,LaPha-7B在AIME'24上进一步达到了60.0%,在AIME'25上达到了53.3%,表明LaPha具有良好的泛化能力。

🎯 应用场景

LaPha方法具有广泛的应用前景,可应用于各种需要复杂推理和搜索的任务,例如数学问题求解、代码生成、游戏AI等。通过提升LLM智能体的推理能力和搜索效率,LaPha可以帮助解决更复杂的实际问题,并推动人工智能技术的发展。

📄 摘要(原文)

We propose LaPha, a method for training AlphaZero-like LLM agents in a Poincaré latent space. Under LaPha, the search process can be visualized as a tree rooted at the prompt and growing outward from the origin toward the boundary of the Poincaré ball, where negative curvature provides exponentially increasing capacity with radius. Using hyperbolic geodesic distance to rule-verified correctness, we define a node potential and assign dense process rewards by potential differences. We further attach a lightweight value head on the same shared latent space, enabling self-guided test-time scaling with almost no additional overhead. On MATH-500, LaPha improves Qwen2.5-Math-1.5B from 66.0% to 88.2%. With value-head-guided search, LaPha-1.5B reaches 56.7% accuracy on AIME'24, and LaPha-7B further achieves 60.0% on AIME'24 and 53.3% on AIME'25.