MacrOData: New Benchmarks of Thousands of Datasets for Tabular Outlier Detection

作者: Xueying Ding, Simon Klüttermann, Haomin Wen, Yilong Chen, Leman Akoglu

分类: cs.LG

发布日期: 2026-02-10

备注: 28 pages

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出MacrOData,一个包含数千表格数据集的大规模异常检测基准测试集。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 异常检测 表格数据 基准测试 机器学习 数据挖掘

📋 核心要点

- 现有异常检测基准测试集规模小,数据集多样性不足,限制了对算法性能的全面评估。

- MacrOData构建了包含真实和合成数据的超大规模基准测试集,覆盖多种数据先验和异常类型。

- 该基准测试集提供了标准化的数据分割、在线排行榜和语义元数据,方便研究人员进行公平比较和分析。

📝 摘要(中文)

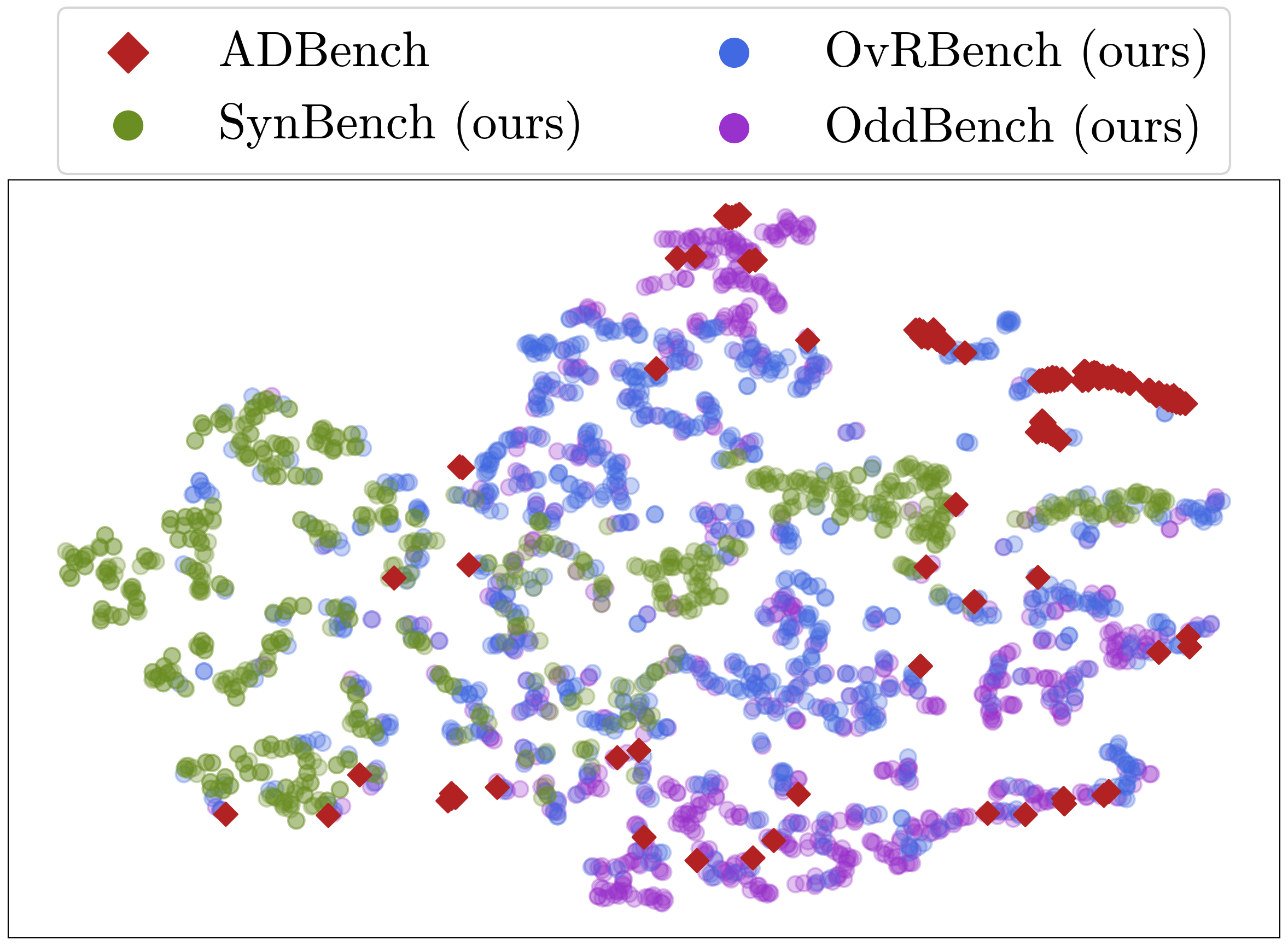

高质量的基准测试对于公平、准确地跟踪科学进展以及帮助从业者做出明智的方法选择至关重要。表格数据上的异常检测(OD)是许多实际应用的基础,但现有的OD基准测试仍然有限。著名的OD基准测试AdBench是文献中的事实标准,但仅包含57个数据集。除了本文讨论的其他缺点外,其小规模严重限制了多样性和统计能力。我们介绍了MacrOData,一个大规模的表格OD基准测试套件,包含三个精心策划的组件:OddBench,包含790个包含真实世界语义异常的数据集;OvrBench,包含856个具有真实世界统计异常的数据集;以及SynBench,包含800个跨越不同数据先验和异常原型的合成生成数据集。由于其规模和多样性,MacrOData能够对表格OD方法进行全面且具有统计鲁棒性的评估。我们的基准测试还满足了几个关键的需求:我们为所有数据集提供标准化的训练/测试分割,公共/私有基准测试分区,其中保留了后者的保留测试标签以用于在线排行榜,并使用语义元数据注释我们的数据集。我们跨所有基准测试进行了广泛的实验,评估了包括经典模型、深度模型和基础模型在内的各种OD方法,以及不同的超参数配置。我们报告了详细的经验结果、实践指南以及个人表现,作为未来研究的参考。包含总共2,446个数据集的所有基准测试都是开源的,并且在https://huggingface.co/MacrOData-CMU上托管了一个可公开访问的排行榜。

🔬 方法详解

问题定义:现有表格数据异常检测基准测试集,如AdBench,规模较小,数据集多样性不足,难以对现有异常检测算法进行全面、客观的评估。这阻碍了该领域的研究进展,并使得从业者难以选择合适的算法。

核心思路:构建一个大规模、多样化的表格数据异常检测基准测试集,包含真实世界和合成生成的数据,覆盖不同的数据先验和异常类型。通过提供标准化的数据分割、在线排行榜和语义元数据,促进公平比较和分析。

技术框架:MacrOData包含三个组件:OddBench(真实世界语义异常)、OvrBench(真实世界统计异常)和SynBench(合成数据)。OddBench和OvrBench的数据集来自真实世界的各种应用领域,SynBench则通过合成方法生成具有不同数据先验和异常类型的数据集。所有数据集都提供了标准化的训练/测试分割。此外,还提供了一个在线排行榜,用于评估和比较不同算法的性能。

关键创新:MacrOData的核心创新在于其规模和多样性。它包含了数千个数据集,覆盖了各种真实世界和合成的异常场景,能够更全面地评估异常检测算法的性能。此外,它还提供了标准化的数据分割、在线排行榜和语义元数据,方便研究人员进行公平比较和分析。

关键设计:SynBench使用多种合成数据生成方法,以模拟不同的数据先验和异常类型。OddBench和OvrBench的数据集来自各种真实世界的应用领域,例如网络安全、金融和医疗保健。数据集的语义元数据包括数据集的描述、特征类型和异常类型等信息。

🖼️ 关键图片

📊 实验亮点

论文通过在MacrOData上对多种异常检测算法进行评估,展示了该基准测试集的有效性。实验结果表明,不同算法在不同数据集上的性能差异很大,这突出了大规模、多样化基准测试集的重要性。此外,实验还揭示了一些现有算法的局限性,为未来的研究方向提供了启示。

🎯 应用场景

MacrOData可用于评估和比较各种表格数据异常检测算法,帮助研究人员发现更有效的算法。此外,它还可以帮助从业者选择适合其特定应用场景的算法。该基准测试集有望促进表格数据异常检测领域的研究进展,并提高实际应用中的异常检测性能。

📄 摘要(原文)

Quality benchmarks are essential for fairly and accurately tracking scientific progress and enabling practitioners to make informed methodological choices. Outlier detection (OD) on tabular data underpins numerous real-world applications, yet existing OD benchmarks remain limited. The prominent OD benchmark AdBench is the de facto standard in the literature, yet comprises only 57 datasets. In addition to other shortcomings discussed in this work, its small scale severely restricts diversity and statistical power. We introduce MacrOData, a large-scale benchmark suite for tabular OD comprising three carefully curated components: OddBench, with 790 datasets containing real-world semantic anomalies; OvrBench, with 856 datasets featuring real-world statistical outliers; and SynBench, with 800 synthetically generated datasets spanning diverse data priors and outlier archetypes. Owing to its scale and diversity, MacrOData enables comprehensive and statistically robust evaluation of tabular OD methods. Our benchmarks further satisfy several key desiderata: We provide standardized train/test splits for all datasets, public/private benchmark partitions with held-out test labels for the latter reserved toward an online leaderboard, and annotate our datasets with semantic metadata. We conduct extensive experiments across all benchmarks, evaluating a broad range of OD methods comprising classical, deep, and foundation models, over diverse hyperparameter configurations. We report detailed empirical findings, practical guidelines, as well as individual performances as references for future research. All benchmarks containing 2,446 datasets combined are open-sourced, along with a publicly accessible leaderboard hosted at https://huggingface.co/MacrOData-CMU.