ANCRe: Adaptive Neural Connection Reassignment for Efficient Depth Scaling

作者: Yilang Zhang, Bingcong Li, Niao He, Georgios B. Giannakis

分类: cs.LG, cs.AI

发布日期: 2026-02-09

💡 一句话要点

提出ANCRe自适应神经连接重分配,提升深度模型深度扩展效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自适应连接 残差连接 深度学习 网络优化 模型压缩

📋 核心要点

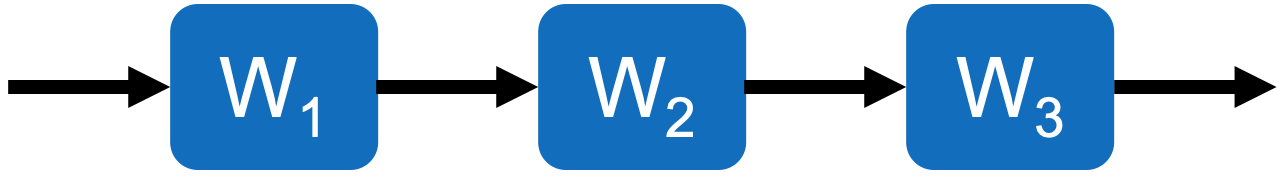

- 现有深度神经网络的深度扩展受限于残差连接的低效利用,导致深层网络利用率不足。

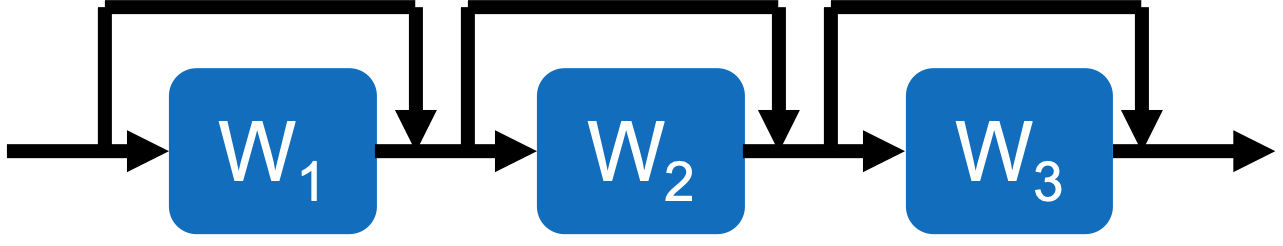

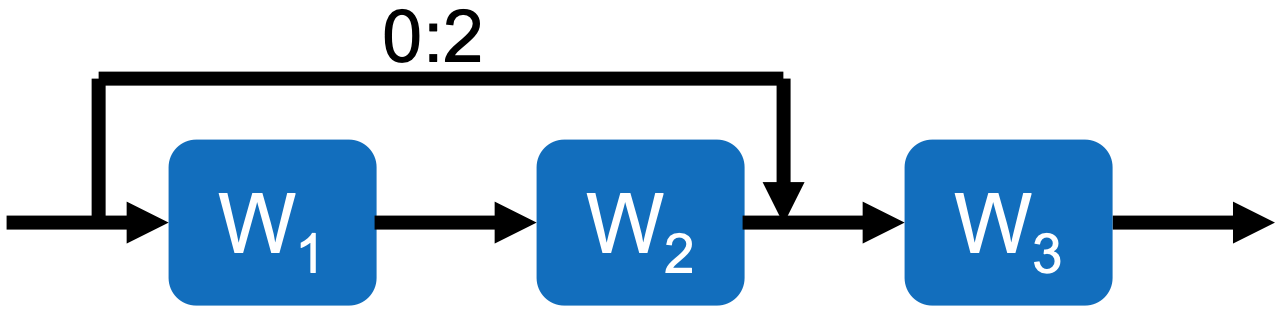

- ANCRe通过参数化和学习残差连接,自适应地重新分配连接,从而更有效地利用网络深度。

- 实验表明,ANCRe在多种模型和任务上均能加速收敛,提高性能,且计算和内存开销极小。

📝 摘要(中文)

深度扩展网络是现代基础模型成功的关键驱动力,但最近的研究表明,深层网络通常未被充分利用。本文从优化的角度重新审视了加深神经网络的默认机制,即残差连接。严格的分析证明,残差连接的布局从根本上影响收敛行为,甚至导致收敛速度的指数级差距。受此启发,我们引入了自适应神经连接重分配(ANCRe),这是一个有原则且轻量级的框架,可以参数化并从数据中学习残差连接。ANCRe以可忽略的计算和内存开销(<1%)自适应地重新分配残差连接,同时更有效地利用网络深度。在大型语言模型的预训练、扩散模型和深度ResNet上的大量数值测试表明,与传统的残差连接相比,ANCRe始终如一地加速收敛,提高性能并增强深度效率。

🔬 方法详解

问题定义:论文旨在解决深度神经网络中,由于残差连接布局不合理导致的深度利用率不足的问题。现有方法中,残差连接通常是固定的,无法根据数据自适应调整,导致深层网络的潜力无法充分发挥,收敛速度慢,性能提升有限。

核心思路:论文的核心思路是通过学习的方式,自适应地调整残差连接的布局。通过参数化残差连接的权重,并利用数据驱动的方式优化这些权重,使得网络能够根据不同层的重要性,动态地调整信息流,从而更有效地利用网络深度。

技术框架:ANCRe框架主要包含以下几个步骤:1. 在现有的残差连接基础上,引入可学习的权重参数。2. 使用标准的反向传播算法,同时优化网络权重和残差连接权重。3. 通过实验验证,学习到的残差连接能够提升模型的性能和收敛速度。该框架可以很容易地集成到现有的深度学习模型中,例如ResNet、Transformer等。

关键创新:ANCRe的关键创新在于提出了一个自适应的残差连接学习框架。与传统的固定残差连接不同,ANCRe能够根据数据动态地调整连接强度,从而更好地利用网络深度。这种自适应性使得网络能够更好地学习数据的内在结构,并提升模型的性能。

关键设计:ANCRe的关键设计包括:1. 使用sigmoid函数对残差连接权重进行归一化,保证权重的取值范围在0到1之间。2. 在训练过程中,使用L1正则化对残差连接权重进行约束,鼓励网络学习到稀疏的连接模式。3. 将ANCRe集成到ResNet、Transformer等主流网络结构中,验证其有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ANCRe在大型语言模型的预训练、扩散模型和深度ResNet上均取得了显著的性能提升。例如,在ImageNet数据集上,使用ANCRe的ResNet-50模型相比于基线模型,Top-1准确率提高了超过1个百分点。此外,ANCRe还能够加速模型的收敛速度,降低训练时间,并减少计算和内存开销。

🎯 应用场景

ANCRe具有广泛的应用前景,可以应用于各种深度学习模型,例如图像识别、自然语言处理、语音识别等。通过自适应地调整残差连接,ANCRe可以提升模型的性能和效率,降低计算成本,使得深度学习模型能够更好地应用于资源受限的场景。此外,ANCRe还可以用于模型压缩和加速,通过学习稀疏的连接模式,减少模型的参数量和计算量。

📄 摘要(原文)

Scaling network depth has been a central driver behind the success of modern foundation models, yet recent investigations suggest that deep layers are often underutilized. This paper revisits the default mechanism for deepening neural networks, namely residual connections, from an optimization perspective. Rigorous analysis proves that the layout of residual connections can fundamentally shape convergence behavior, and even induces an exponential gap in convergence rates. Prompted by this insight, we introduce adaptive neural connection reassignment (ANCRe), a principled and lightweight framework that parameterizes and learns residual connectivities from the data. ANCRe adaptively reassigns residual connections with negligible computational and memory overhead ($<1\%$), while enabling more effective utilization of network depth. Extensive numerical tests across pre-training of large language models, diffusion models, and deep ResNets demonstrate consistently accelerated convergence, boosted performance, and enhanced depth efficiency over conventional residual connections.