FIRE: Frobenius-Isometry Reinitialization for Balancing the Stability-Plasticity Tradeoff

作者: Isaac Han, Sangyeon Park, Seungwon Oh, Donghu Kim, Hojoon Lee, Kyung-Joong Kim

分类: cs.LG, cs.AI

发布日期: 2026-02-08

备注: ICLR'26 (oral)

💡 一句话要点

提出FIRE:通过Frobenius-Isometry重初始化平衡稳定性-可塑性权衡

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 持续学习 稳定性-可塑性权衡 重初始化 Frobenius范数 等距变换 约束优化 Newton-Schulz迭代

📋 核心要点

- 现有重初始化方法难以兼顾稳定性与可塑性,保守方法损失可塑性,激进方法则遗忘有用知识。

- FIRE方法通过显式量化稳定性(SFE)和可塑性(DfI),在约束优化框架下寻找最佳重初始化点。

- 实验表明,FIRE在持续学习、语言建模和强化学习等多个领域均优于现有重初始化方法。

📝 摘要(中文)

深度神经网络在非平稳数据上训练时,必须平衡稳定性(即保留先验知识)和可塑性(即适应新任务)。标准重初始化方法,将权重重置到其原始值附近,被广泛使用但难以调整:保守的重初始化无法恢复可塑性,而激进的重初始化会消除有用的知识。我们提出FIRE,一种有原则的重初始化方法,它显式地平衡了稳定性-可塑性权衡。FIRE通过平方Frobenius误差(SFE)量化稳定性,测量与过去权重的接近程度,并通过与等距的偏差(DfI)反映权重各向同性来量化可塑性。重初始化点通过解决一个约束优化问题获得,该问题在DfI为零的约束下最小化SFE,这可以通过Newton-Schulz迭代有效地近似。FIRE在持续视觉学习(使用ResNet-18的CIFAR-10)、语言建模(使用GPT-0.1B的OpenWebText)和强化学习(使用SAC的HumanoidBench和使用DQN的Atari游戏)上进行了评估。在所有领域,FIRE始终优于没有干预的朴素训练和标准重初始化方法,证明了有效平衡了稳定性-可塑性权衡。

🔬 方法详解

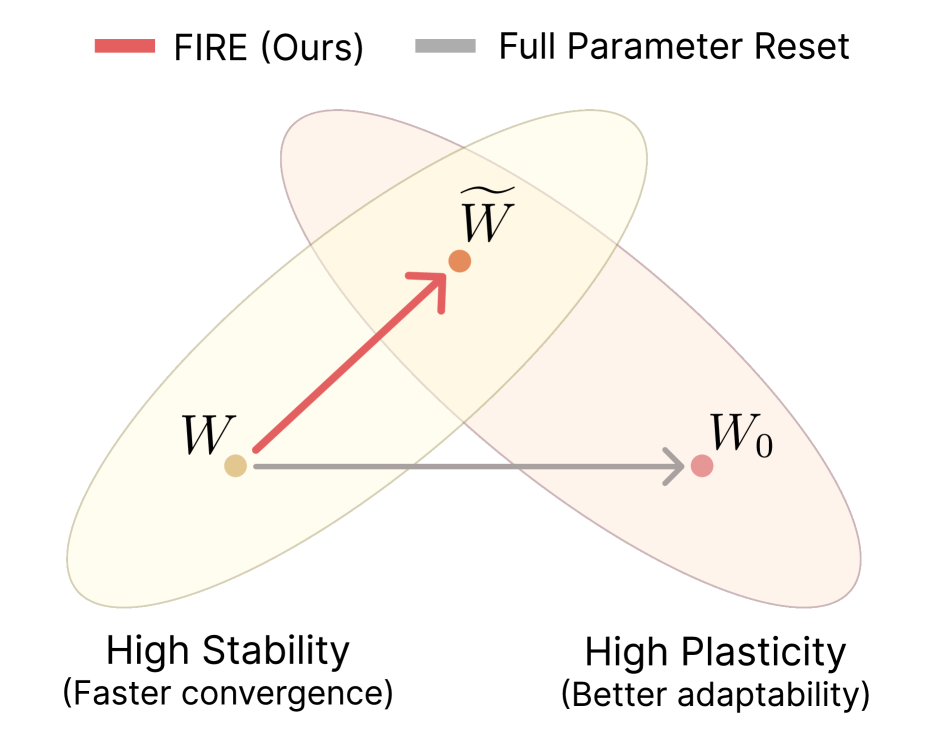

问题定义:论文旨在解决深度神经网络在持续学习场景中,如何平衡稳定性(保留先前知识)和可塑性(适应新任务)的问题。现有的重初始化方法,例如将权重重置到初始值附近,存在难以调优的问题。保守的重初始化方法无法有效恢复模型的可塑性,导致模型难以适应新任务;而激进的重初始化方法则会过度擦除模型已学习到的知识,导致性能下降。

核心思路:论文的核心思路是通过显式地量化模型的稳定性和可塑性,并将重初始化过程建模为一个约束优化问题。具体来说,论文使用平方Frobenius误差(SFE)来衡量模型与先前权重的接近程度,以此量化稳定性;使用与等距的偏差(DfI)来衡量权重的各向同性,以此量化可塑性。通过在保持可塑性(DfI为零)的约束下,最小化与先前权重的差异(SFE),从而找到一个既能保留先前知识,又能适应新任务的重初始化点。

技术框架:FIRE方法主要包含以下几个阶段:1) 稳定性量化:使用平方Frobenius误差(SFE)计算当前权重与先前权重的差异。2) 可塑性量化:使用与等距的偏差(DfI)计算权重的各向同性。3) 约束优化:构建一个约束优化问题,目标是在DfI为零的约束下,最小化SFE。4) 求解优化问题:使用Newton-Schulz迭代算法高效地近似求解该约束优化问题,得到重初始化点。5) 重初始化:将模型的权重重置为求解得到的重初始化点。

关键创新:FIRE方法最重要的技术创新在于,它将稳定性-可塑性权衡问题形式化为一个可解的约束优化问题,并通过显式地量化稳定性和可塑性,使得重初始化过程更加可控和有效。与现有方法相比,FIRE方法不再依赖于启发式的重初始化策略,而是通过优化算法自动地找到最佳的重初始化点。

关键设计:FIRE方法的关键设计包括:1) 稳定性度量SFE:使用平方Frobenius误差来衡量权重变化,简单有效。2) 可塑性度量DfI:使用与等距的偏差来衡量权重的各向同性,反映了模型的可塑性。3) 约束优化框架:将重初始化问题建模为一个约束优化问题,使得可以显式地平衡稳定性和可塑性。4) Newton-Schulz迭代:使用Newton-Schulz迭代算法高效地求解约束优化问题,保证了算法的实用性。

🖼️ 关键图片

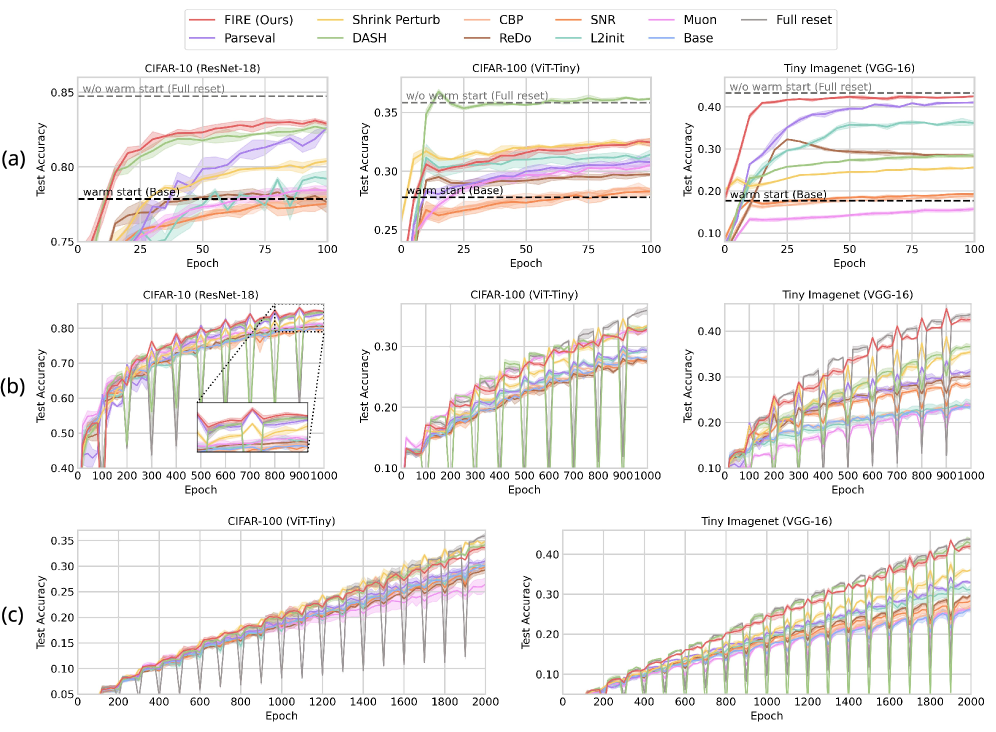

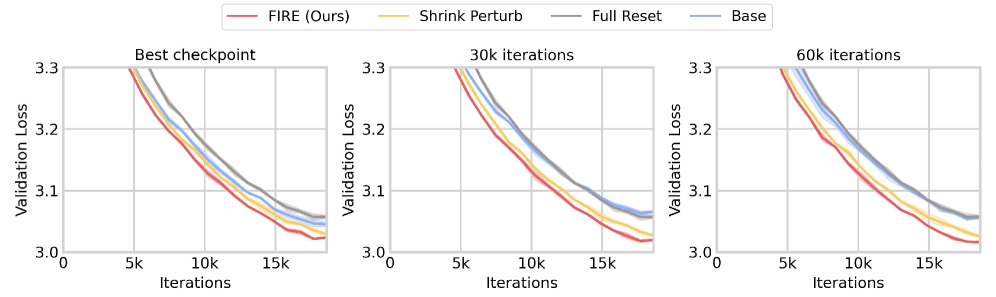

📊 实验亮点

实验结果表明,FIRE方法在持续视觉学习(CIFAR-10)、语言建模(OpenWebText)和强化学习(HumanoidBench和Atari游戏)等多个领域均取得了显著的性能提升。例如,在CIFAR-10数据集上,FIRE方法相比于标准重初始化方法,取得了更高的分类准确率。在OpenWebText数据集上,FIRE方法能够更好地保留先前学习到的语言知识,从而提高了语言模型的生成质量。在强化学习任务中,FIRE方法能够帮助智能体更快地适应新的环境,并取得更高的奖励。

🎯 应用场景

FIRE方法在持续学习、迁移学习和终身学习等领域具有广泛的应用前景。它可以帮助模型在不断学习新知识的同时,有效地保留先前学习到的知识,避免灾难性遗忘。该方法可以应用于各种实际场景,例如机器人学习、自动驾驶和自然语言处理等,提高模型的适应性和泛化能力。

📄 摘要(原文)

Deep neural networks trained on nonstationary data must balance stability (i.e., retaining prior knowledge) and plasticity (i.e., adapting to new tasks). Standard reinitialization methods, which reinitialize weights toward their original values, are widely used but difficult to tune: conservative reinitializations fail to restore plasticity, while aggressive ones erase useful knowledge. We propose FIRE, a principled reinitialization method that explicitly balances the stability-plasticity tradeoff. FIRE quantifies stability through Squared Frobenius Error (SFE), measuring proximity to past weights, and plasticity through Deviation from Isometry (DfI), reflecting weight isotropy. The reinitialization point is obtained by solving a constrained optimization problem, minimizing SFE subject to DfI being zero, which is efficiently approximated by Newton-Schulz iteration. FIRE is evaluated on continual visual learning (CIFAR-10 with ResNet-18), language modeling (OpenWebText with GPT-0.1B), and reinforcement learning (HumanoidBench with SAC and Atari games with DQN). Across all domains, FIRE consistently outperforms both naive training without intervention and standard reinitialization methods, demonstrating effective balancing of the stability-plasticity tradeoff.