When Is Compositional Reasoning Learnable from Verifiable Rewards?

作者: Daniel Barzilai, Yotam Wolf, Ronen Basri

分类: cs.LG, stat.ML

发布日期: 2026-02-08

💡 一句话要点

通过可验证奖励学习组合推理:任务优势比是关键

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 组合推理 强化学习 可验证奖励 任务优势比 自回归模型

📋 核心要点

- 大型语言模型在组合推理方面表现出色,但对其可学习性的理论理解不足。

- 论文提出“任务优势比”这一概念,用于刻画组合问题和基础模型的可学习性。

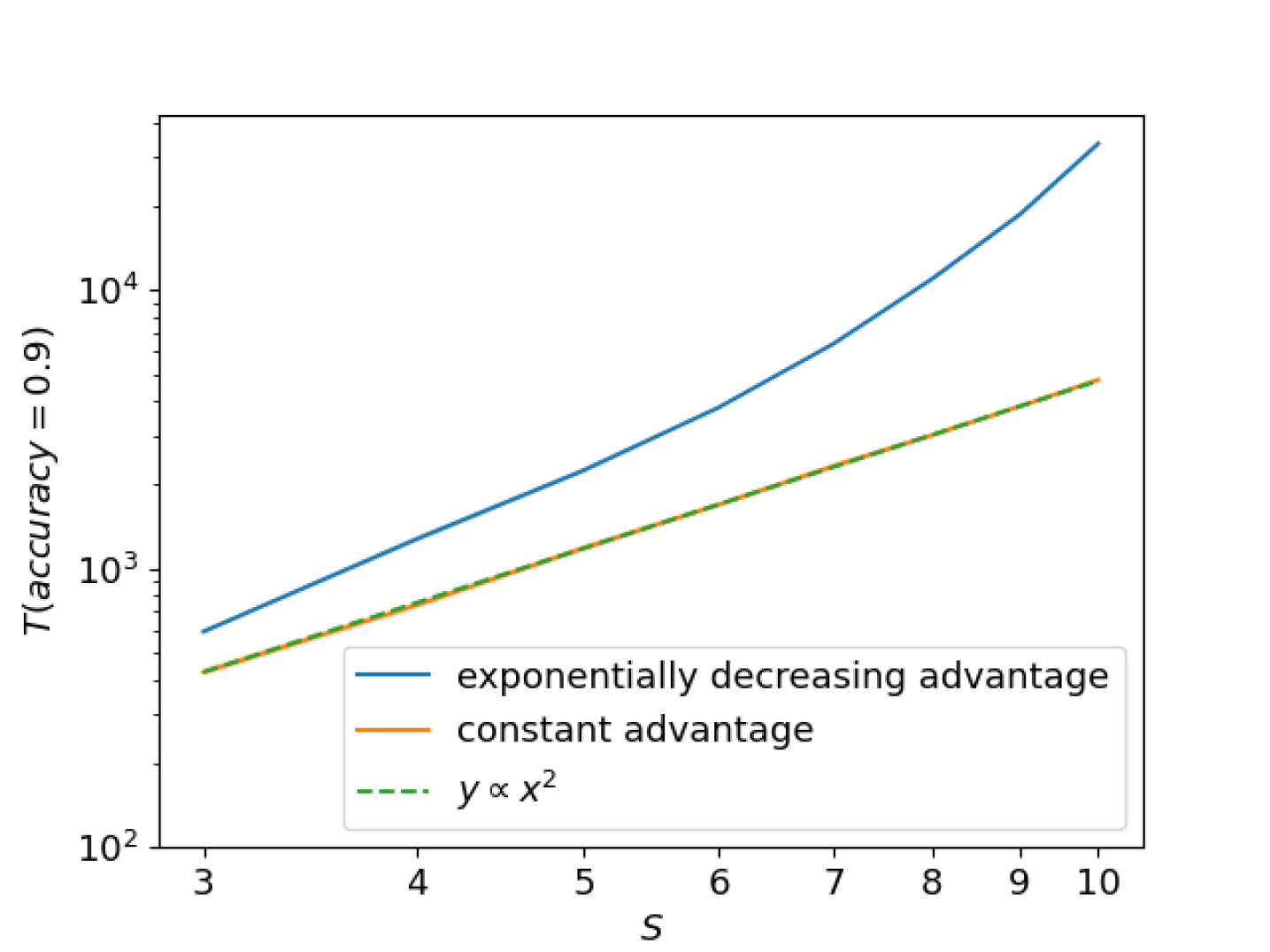

- 研究表明,当正确中间步骤提供明显优势时,RLVR能有效学习,否则可能收敛到次优解。

📝 摘要(中文)

大型语言模型通过强化学习与可验证奖励(RLVR)涌现出的组合推理能力是近期经验性成功的关键驱动因素。尽管取得了这些进展,但仍然不清楚在这种设置下,仅使用结果层面的反馈,哪些组合问题是可以学习的。本文从理论上研究了在RLVR训练下,自回归模型中组合问题的可学习性。我们定义了一个称为任务优势比的量,它是组合问题和基础模型的联合属性,用于表征哪些任务和组合可以从结果层面的反馈中学习。在积极方面,利用这种表征,我们表明,正确的中间步骤提供明显优势的组合问题可以通过RLVR有效地学习。我们还分析了这种优势如何在不同的问题中自然产生。在消极方面,当结构性优势不存在时,RLVR可能会收敛到次优组合。我们证明,在某些情况下,基础模型的质量决定了这种优势是否存在,以及RLVR是否会收敛到次优解。我们希望我们的分析能够为RLVR何时以及为何成功,以及何时不成功提供有原则的理论理解。

🔬 方法详解

问题定义:论文旨在解决在强化学习与可验证奖励(RLVR)框架下,哪些组合问题可以被大型语言模型学习的问题。现有方法缺乏对RLVR成功与否的理论解释,无法指导任务设计和模型选择。特别是在仅使用结果层面反馈的情况下,如何保证模型能够学习到正确的组合步骤是一个挑战。

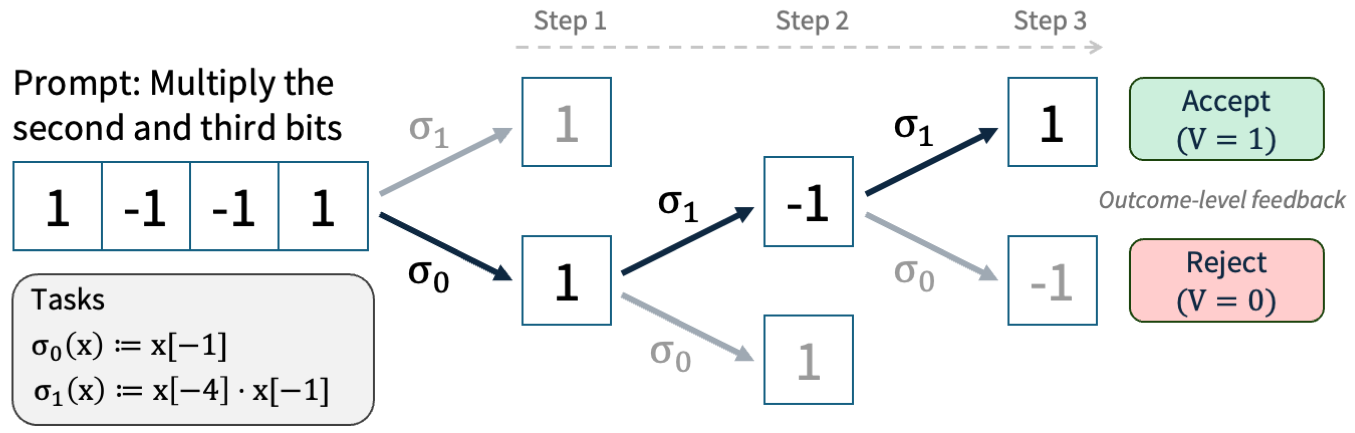

核心思路:论文的核心思路是引入“任务优势比”这一概念,它衡量了在组合问题中,正确执行中间步骤所带来的优势。如果任务优势比足够大,则RLVR能够有效地学习到正确的组合策略。反之,如果任务优势比很小,则RLVR可能会收敛到次优的组合策略。这种优势比取决于组合问题的结构和基础模型的性能。

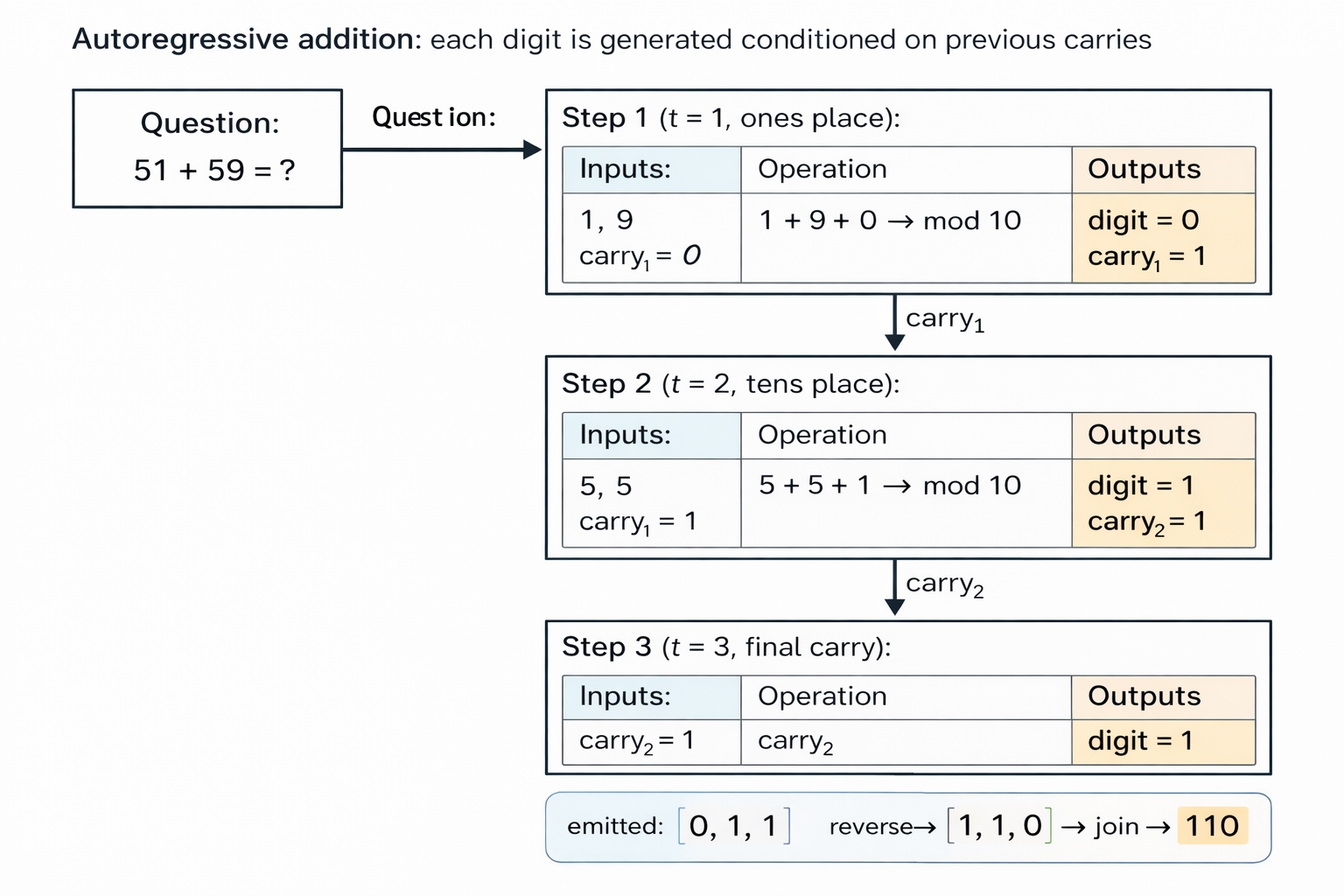

技术框架:论文采用理论分析的方法,构建了一个自回归模型下的RLVR学习框架。该框架包括:1) 定义组合问题,将其分解为一系列中间步骤;2) 引入可验证奖励,对每个步骤的正确性进行奖励;3) 分析RLVR算法在学习过程中的收敛性,特别是考察任务优势比对收敛结果的影响。整体框架偏向理论推导,旨在建立一个可解释的模型。

关键创新:论文最重要的创新在于提出了“任务优势比”这一概念,并证明了它是RLVR学习组合问题的关键因素。与现有方法相比,该研究提供了一个理论框架,用于理解RLVR在组合推理中的成功与失败。它揭示了组合问题的结构和基础模型的性能如何影响RLVR的学习效果。

关键设计:论文的关键设计在于对任务优势比的数学定义。具体来说,任务优势比被定义为正确执行中间步骤所获得的奖励与执行错误步骤所获得的奖励之间的比率。论文通过数学推导,证明了当任务优势比大于某个阈值时,RLVR能够收敛到最优策略。此外,论文还分析了基础模型的质量如何影响任务优势比,从而影响RLVR的学习效果。具体的参数设置和网络结构取决于具体的实验设置,论文侧重于理论分析,因此没有详细描述。

🖼️ 关键图片

📊 实验亮点

论文通过理论分析,证明了“任务优势比”是RLVR学习组合问题的关键因素。研究表明,当正确中间步骤提供明显优势时,RLVR能有效学习,否则可能收敛到次优解。该研究为理解和改进RLVR算法提供了理论基础。

🎯 应用场景

该研究成果可应用于指导大型语言模型在复杂任务中的应用,例如机器人控制、程序合成和自然语言理解。通过合理设计任务结构和奖励函数,可以提高模型学习组合推理能力,从而解决更复杂的实际问题。此外,该研究还可以帮助我们更好地理解和改进RLVR算法。

📄 摘要(原文)

The emergence of compositional reasoning in large language models through reinforcement learning with verifiable rewards (RLVR) has been a key driver of recent empirical successes. Despite this progress, it remains unclear which compositional problems are learnable in this setting using outcome-level feedback alone. In this work, we theoretically study the learnability of compositional problems in autoregressive models under RLVR training. We identify a quantity that we call the task-advantage ratio, a joint property of the compositional problem and the base model, that characterizes which tasks and compositions are learnable from outcome-level feedback. On the positive side, using this characterization, we show that compositional problems where correct intermediate steps provide a clear advantage are efficiently learnable with RLVR. We also analyze how such an advantage naturally arises in different problems. On the negative side, when the structural advantage is not present, RLVR may converge to suboptimal compositions. We prove that, in some cases, the quality of the base model determines if such an advantage exists and whether RLVR will converge to a suboptimal solution. We hope our analysis can provide a principled theoretical understanding of when and why RLVR succeeds and when it does not.