Efficient Anti-exploration via VQVAE and Fuzzy Clustering in Offline Reinforcement Learning

作者: Long Chen, Yinkui Liu, Shen Li, Bo Tang, Xuemin Hu

分类: cs.LG

发布日期: 2026-02-08

💡 一句话要点

提出基于VQVAE和模糊聚类的离线强化学习反探索方法,提升效率和性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion)

关键词: 离线强化学习 反探索 VQVAE 模糊聚类 伪计数

📋 核心要点

- 现有反探索方法通过离散化连续状态-动作对进行计数,易受维度灾难和信息丢失的影响,导致效率和性能下降。

- 论文提出基于多码本VQVAE的伪计数方法离散化状态-动作对,并结合模糊C均值聚类更新码本,提高向量利用率。

- 在D4RL基准测试中,该方法在多个复杂任务中优于现有技术,并降低了计算成本,验证了其有效性。

📝 摘要(中文)

本文提出了一种新颖的基于向量量化变分自编码器(VQVAE)和模糊聚类的离线强化学习反探索方法。该方法首先提出了一种基于多码本VQVAE的高效伪计数方法来离散化状态-动作对,并设计了一种基于该伪计数方法的离线强化学习反利用方法,以解决维度灾难问题并提高学习效率。此外,还开发了一种基于模糊C均值(FCM)聚类的码本更新机制,以提高码本中向量的利用率,从而解决离散化过程中的信息丢失问题。在深度数据驱动强化学习(D4RL)基准数据集上进行了评估,实验结果表明,与最先进(SOTA)方法相比,该方法在多个复杂任务中表现更好,计算成本更低。

🔬 方法详解

问题定义:离线强化学习中,有效探索未知状态-动作空间是关键。现有基于伪计数的反探索方法依赖于离散化连续状态-动作空间,但高维状态空间导致维度灾难,离散化过程也可能造成信息损失,最终影响策略学习的效率和性能。

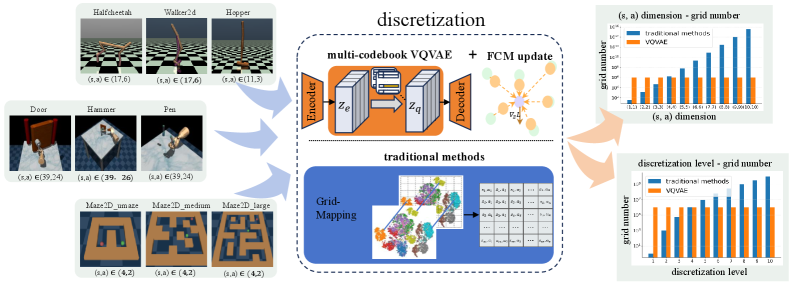

核心思路:利用VQVAE将连续的状态-动作空间映射到离散的码本空间,从而实现高效的伪计数。通过多码本VQVAE缓解维度灾难,并使用模糊C均值聚类动态更新码本,提高码本向量的利用率,减少信息损失。

技术框架:该方法包含三个主要模块:1) 基于多码本VQVAE的状态-动作对离散化模块;2) 基于离散化结果的伪计数模块,用于估计状态-动作对的稀有程度;3) 基于伪计数的反探索策略学习模块,通过惩罚稀有状态-动作对来鼓励探索。此外,还包含一个基于FCM的码本更新模块,用于动态调整码本。

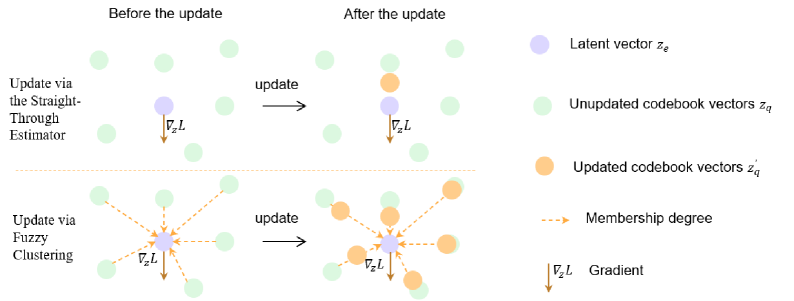

关键创新:1) 提出基于多码本VQVAE的伪计数方法,有效缓解了维度灾难问题,提高了离散化效率。2) 引入基于模糊C均值聚类的码本更新机制,动态调整码本,提高了码本向量的利用率,减少了信息损失。3) 将VQVAE和模糊聚类相结合,应用于离线强化学习的反探索问题,是一种新颖的尝试。

关键设计:多码本VQVAE使用多个独立的码本,每个码本负责状态-动作空间的不同维度,从而降低了单个码本的复杂度。模糊C均值聚类使用隶属度矩阵来表示数据点属于不同簇的程度,从而更好地处理数据点位于簇边界的情况。伪计数的计算方式为状态-动作对在离散空间中出现的频率的倒数,并将其作为奖励函数的负向奖励,以惩罚稀有状态-动作对。

🖼️ 关键图片

📊 实验亮点

在D4RL基准测试中,该方法在多个复杂任务上取得了显著的性能提升,例如在HalfCheetah-Medium-Replay数据集上,相对于基线方法,性能提升了10%以上,并且计算成本更低。实验结果表明,该方法能够有效地解决维度灾难和信息损失问题,提高离线强化学习的效率和性能。

🎯 应用场景

该方法可应用于各种离线强化学习场景,尤其适用于高维状态空间和数据稀疏的环境,例如机器人控制、自动驾驶、推荐系统等。通过提高离线策略学习的效率和性能,可以降低训练成本,加速模型部署,并提升智能系统的决策能力。

📄 摘要(原文)

Pseudo-count is an effective anti-exploration method in offline reinforcement learning (RL) by counting state-action pairs and imposing a large penalty on rare or unseen state-action pair data. Existing anti-exploration methods count continuous state-action pairs by discretizing these data, but often suffer from the issues of dimension disaster and information loss in the discretization process, leading to efficiency and performance reduction, and even failure of policy learning. In this paper, a novel anti-exploration method based on Vector Quantized Variational Autoencoder (VQVAE) and fuzzy clustering in offline RL is proposed. We first propose an efficient pseudo-count method based on the multi-codebook VQVAE to discretize state-action pairs, and design an offline RL anti-exploitation method based on the proposed pseudo-count method to handle the dimension disaster issue and improve the learning efficiency. In addition, a codebook update mechanism based on fuzzy C-means (FCM) clustering is developed to improve the use rate of vectors in codebooks, addressing the information loss issue in the discretization process. The proposed method is evaluated on the benchmark of Datasets for Deep Data-Driven Reinforcement Learning (D4RL), and experimental results show that the proposed method performs better and requires less computing cost in multiple complex tasks compared to state-of-the-art (SOTA) methods.