Interpretable Analytic Calabi-Yau Metrics via Symbolic Distillation

作者: D Yang Eng

分类: cs.LG, math.DG

发布日期: 2026-02-08

备注: 31 pages, 7 figures

💡 一句话要点

通过符号提炼获得可解释的解析Calabi-Yau度量

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Calabi-Yau流形 符号回归 弦理论 可解释性 神经网络 度量学习 物理可观测量

📋 核心要点

- Calabi-Yau流形在弦理论中至关重要,但其度量计算复杂,传统方法难以处理。

- 论文提出使用符号回归从神经近似中提取简单公式,以实现可解释的Calabi-Yau度量。

- 实验表明,该方法在保持精度的同时,显著减少了参数量,并能重现物理可观测量。

📝 摘要(中文)

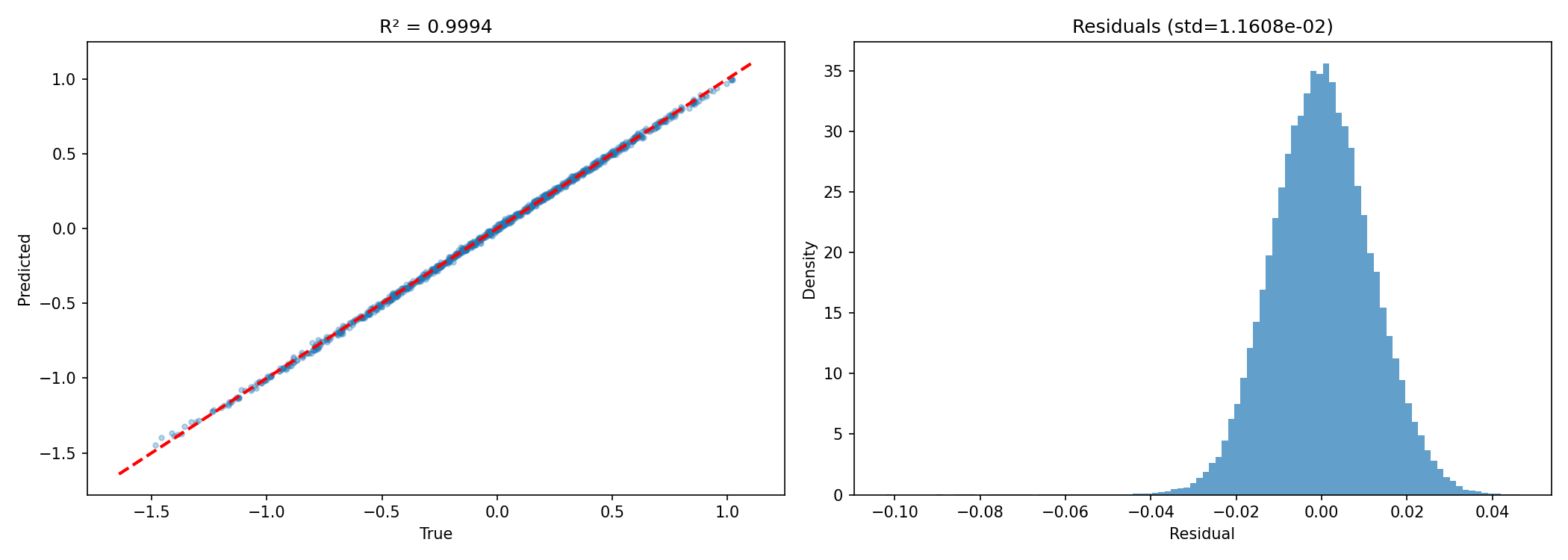

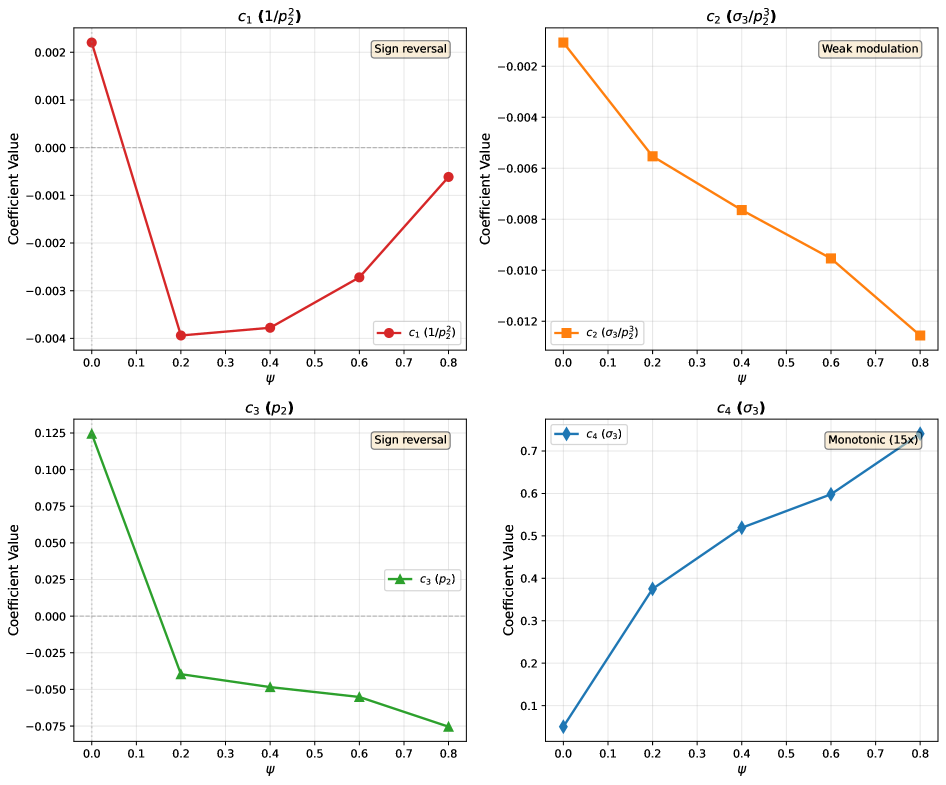

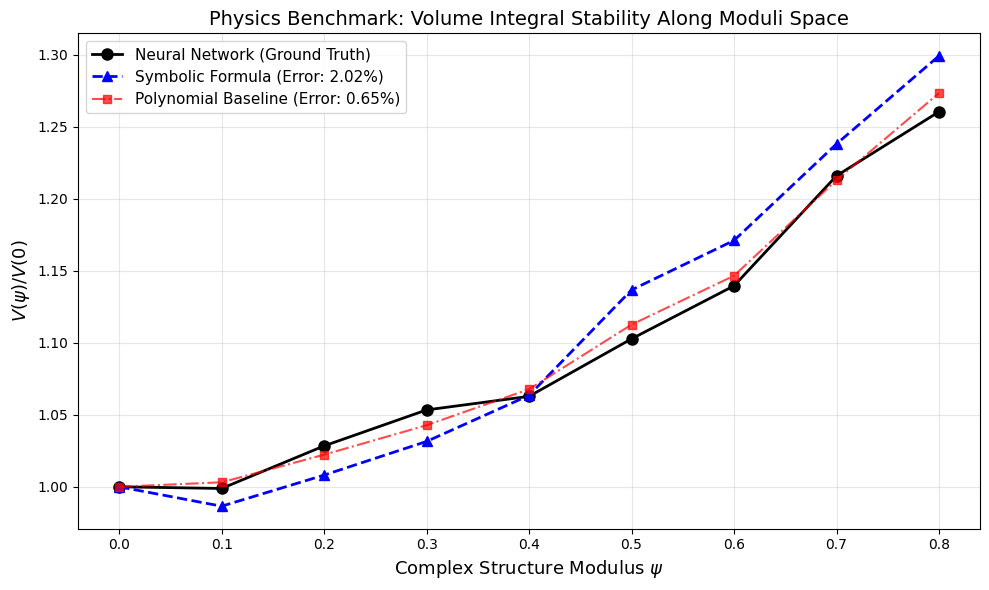

Calabi-Yau流形对于弦理论至关重要,但需要计算难以处理的度量。本文表明,符号回归可以将神经近似提炼成简单、可解释的公式。我们提出的五项表达式与神经网络的精度相匹配(R^2 = 0.9994),但参数减少了3000倍。多种子验证证实了几何约束选择了基本特征,特别是幂和与对称多项式,同时允许结构多样性。该函数形式可以在所研究的模量范围(ψ∈[0, 0.8])内保持,系数平滑变化;我们将这些趋势解释为局部训练教师网络精度范围内的经验假设(ψ≠0时σ≈8-9%)。该公式重现了物理可观测量——体积积分和Yukawa耦合——验证了符号提炼可以恢复紧凑、可解释的模型,用于先前只能通过黑盒网络访问的量。

🔬 方法详解

问题定义:Calabi-Yau流形的度量计算是弦理论中的核心问题,但由于其复杂性,传统的解析方法难以求解。现有的神经近似方法虽然能够获得较高的精度,但模型通常是黑盒的,缺乏可解释性,难以洞察其内在的几何结构和物理意义。因此,如何获得既精确又可解释的Calabi-Yau度量是一个重要的挑战。

核心思路:论文的核心思路是利用符号回归(Symbolic Regression)技术,将训练好的神经网络模型“提炼”成一个简洁的解析公式。符号回归是一种机器学习方法,它通过搜索数学表达式空间来拟合数据,最终得到一个可解释的数学公式。通过将神经网络的输出作为符号回归的目标,可以得到一个与神经网络精度相当,但形式更简洁、更易于理解的Calabi-Yau度量表达式。

技术框架:该方法主要包含以下几个步骤:1. 使用神经网络训练一个能够近似Calabi-Yau度量的模型(教师网络)。2. 使用训练好的教师网络生成训练数据。3. 使用符号回归算法,以教师网络的输出为目标,搜索一个简洁的数学表达式。4. 使用多种子验证(Multi-seed validation)来确保几何约束选择基本特征。5. 分析公式中的系数变化,并将其解释为经验假设。

关键创新:该方法最重要的创新在于将符号回归应用于Calabi-Yau度量的计算,从而实现了从黑盒神经网络到可解释解析公式的转化。这种方法不仅提高了模型的可解释性,还有助于发现Calabi-Yau流形的内在几何结构和物理规律。此外,多种子验证方法也保证了结果的可靠性。

关键设计:论文中,教师网络采用常见的神经网络结构进行训练,损失函数选择均方误差等。符号回归算法采用开源的遗传算法库,搜索空间包括幂和、对称多项式等基本数学函数。多种子验证通过多次运行符号回归算法,并分析结果的统计特性,来筛选出最稳定的特征组合。此外,论文还分析了公式中系数随模量变化的趋势,并将其解释为经验假设。

🖼️ 关键图片

📊 实验亮点

该研究通过符号回归成功地将一个复杂的神经网络模型提炼成一个仅包含五项的简单解析公式,该公式在精度上与神经网络模型相当(R^2 = 0.9994),但参数量减少了3000倍。此外,该公式能够重现物理可观测量,如体积积分和Yukawa耦合,验证了该方法的有效性。研究还发现,几何约束倾向于选择幂和与对称多项式作为基本特征。

🎯 应用场景

该研究成果可应用于弦理论、超对称规范理论等领域,有助于深入理解Calabi-Yau流形的几何性质和物理规律。通过获得可解释的Calabi-Yau度量,可以更方便地计算物理可观测量,例如体积积分和Yukawa耦合,从而为弦理论的唯象学研究提供更可靠的工具。此外,该方法也为其他复杂物理问题的求解提供了一种新的思路,即先用神经网络进行近似,再用符号回归进行提炼。

📄 摘要(原文)

Calabi--Yau manifolds are essential for string theory but require computing intractable metrics. Here we show that symbolic regression can distill neural approximations into simple, interpretable formulas. Our five-term expression matches neural accuracy ($R^2 = 0.9994$) with 3,000-fold fewer parameters. Multi-seed validation confirms that geometric constraints select essential features, specifically power sums and symmetric polynomials, while permitting structural diversity. The functional form can be maintained across the studied moduli range ($ψ\in [0, 0.8]$) with coefficients varying smoothly; we interpret these trends as empirical hypotheses within the accuracy regime of the locally-trained teachers ($σ\approx 8-9\%$ at $ψ\neq 0$). The formula reproduces physical observables -- volume integrals and Yukawa couplings -- validating that symbolic distillation recovers compact, interpretable models for quantities previously accessible only to black-box networks.