CoMI-IRL: Contrastive Multi-Intention Inverse Reinforcement Learning

作者: Antonio Mone, Frans A. Oliehoek, Luciano Cavalcante Siebert

分类: cs.LG

发布日期: 2026-02-07

备注: 14 pages, 6 figures

💡 一句话要点

提出CoMI-IRL,一种无需先验知识的多意图逆强化学习框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 逆强化学习 多意图学习 对比学习 Transformer 行为聚类

📋 核心要点

- 现有MI-IRL方法依赖于预先知道行为模式的数量,限制了其在新环境下的适应性和泛化能力。

- CoMI-IRL通过Transformer解耦行为表示和聚类与奖励学习,实现无监督的多意图逆强化学习。

- 实验表明,CoMI-IRL在无需先验知识的情况下,性能优于现有方法,并支持行为关系的可视化分析。

📝 摘要(中文)

逆强化学习(IRL)旨在从专家演示中推断奖励函数。当演示来自具有不同意图的多个专家时,该问题被称为多意图IRL(MI-IRL)。最近的深度生成MI-IRL方法将行为聚类和奖励学习相结合,但通常需要预先知道真实行为模式的数量$K^$。这种对专家知识的依赖限制了它们对新行为的适应性,并且只能分析与学习到的奖励相关的结果,而不能分析用于训练它们的行为模式。我们提出了对比多意图IRL(CoMI-IRL),这是一个基于Transformer的无监督框架,它将行为表示和聚类与下游奖励学习分离。我们的实验表明,CoMI-IRL在没有$K^$或标签的先验知识的情况下,优于现有的方法,同时允许对行为关系进行可视化解释,并在无需完全重新训练的情况下适应未见过的行为。

🔬 方法详解

问题定义:论文旨在解决多意图逆强化学习(MI-IRL)中,现有方法需要预先知道行为模式数量$K^*$的问题。这一要求限制了算法在实际应用中的灵活性,因为在很多情况下,我们无法事先得知专家的行为意图数量。现有方法还缺乏对学习到的行为模式之间关系的有效分析手段。

核心思路:CoMI-IRL的核心思路是将行为表示和聚类与下游的奖励学习解耦。通过这种解耦,模型可以独立地学习行为的潜在表示,并进行聚类,而无需依赖于奖励信号。这种设计使得模型能够更好地适应新的行为模式,并且可以对学习到的行为模式进行更深入的分析。

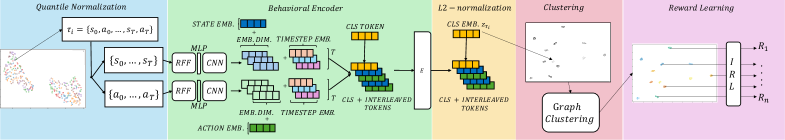

技术框架:CoMI-IRL的整体框架包含三个主要模块:行为表示学习模块、行为聚类模块和奖励学习模块。行为表示学习模块使用Transformer网络将专家演示编码成潜在的行为表示。行为聚类模块利用对比学习的方法,将相似的行为表示聚集在一起,形成不同的行为簇。奖励学习模块则根据学习到的行为簇,推断每个簇对应的奖励函数。

关键创新:CoMI-IRL最重要的创新点在于其解耦式的设计,即将行为表示和聚类与奖励学习分离。这种设计使得模型能够独立地学习行为的潜在表示,并进行聚类,而无需依赖于奖励信号。此外,CoMI-IRL还利用对比学习的方法进行行为聚类,提高了聚类的准确性和鲁棒性。

关键设计:CoMI-IRL使用Transformer网络作为行为表示学习模块,Transformer的自注意力机制能够有效地捕捉行为序列中的长期依赖关系。对比学习损失函数用于优化行为聚类模块,鼓励相似的行为表示聚集在一起,不同的行为表示相互分离。奖励学习模块可以使用任何现有的逆强化学习算法,例如最大熵逆强化学习。

🖼️ 关键图片

📊 实验亮点

CoMI-IRL在多个合成和真实数据集上进行了评估,实验结果表明,CoMI-IRL在无需先验知识的情况下,性能优于现有的MI-IRL方法。具体而言,CoMI-IRL在奖励函数恢复的准确性和行为聚类的效果方面均取得了显著提升。此外,CoMI-IRL还能够对学习到的行为模式进行可视化解释,并能够适应未见过的行为。

🎯 应用场景

CoMI-IRL可应用于机器人自主学习、自动驾驶、游戏AI等领域。例如,在机器人自主学习中,机器人可以通过观察人类专家的演示,学习不同的行为意图,并根据不同的意图执行相应的任务。在自动驾驶中,CoMI-IRL可以帮助自动驾驶系统理解不同驾驶员的驾驶风格,从而提供更个性化的驾驶体验。该研究有助于提升AI系统的自主性和适应性。

📄 摘要(原文)

Inverse Reinforcement Learning (IRL) seeks to infer reward functions from expert demonstrations. When demonstrations originate from multiple experts with different intentions, the problem is known as Multi-Intention IRL (MI-IRL). Recent deep generative MI-IRL approaches couple behavior clustering and reward learning, but typically require prior knowledge of the number of true behavioral modes $K^$. This reliance on expert knowledge limits their adaptability to new behaviors, and only enables analysis related to the learned rewards, and not across the behavior modes used to train them. We propose Contrastive Multi-Intention IRL (CoMI-IRL), a transformer-based unsupervised framework that decouples behavior representation and clustering from downstream reward learning. Our experiments show that CoMI-IRL outperforms existing approaches without a priori knowledge of $K^$ or labels, while allowing for visual interpretation of behavior relationships and adaptation to unseen behavior without full retraining.