Beyond Crash: Hijacking Your Autonomous Vehicle for Fun and Profit

作者: Qi Sun, Ahmed Abdo, Luis Burbano, Ziyang Li, Yaxing Yao, Alvaro Cardenas, Yinzhi Cao

分类: cs.CR, cs.LG

发布日期: 2026-02-06

💡 一句话要点

JackZebra框架:通过物理对抗攻击劫持自动驾驶车辆的行驶路线

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 自动驾驶安全 物理对抗攻击 路线劫持 闭环控制 对抗性机器学习

📋 核心要点

- 现有物理对抗攻击主要关注诱导自动驾驶车辆的即时安全故障,缺乏对长时程路线完整性风险的关注。

- JackZebra框架将路线劫持视为闭环控制问题,通过交互式调整对抗补丁,实现对自动驾驶车辆的持续影响。

- 实验表明,JackZebra能够成功劫持目标车辆,使其偏离预定路线并到达攻击者指定的目标位置,具有较高的成功率。

📝 摘要(中文)

本文研究了自动驾驶车辆(AVs)在对抗环境下的鲁棒性问题,尤其关注基于视觉的自动驾驶系统。与以往主要针对即时安全故障(如碰撞、违规或短暂偏离车道)的物理对抗攻击不同,本文揭示了一种新的风险:长时程路线完整性妥协。攻击者通过逐渐引导受害者车辆偏离其预定路线,使其驶向攻击者选择的目的地,同时车辆保持“正常”行驶状态。本文设计并实现了首个名为JackZebra的对抗框架,该框架利用一辆带有可重构显示器的物理攻击车辆,对基于视觉的端到端驾驶堆栈进行路线级别的劫持。核心挑战在于时间持久性:对抗影响必须在不断变化的角度、光照、天气、交通以及受害者持续重新规划的情况下保持有效,且不触发明显的故障。核心思想是将路线劫持视为一个闭环控制问题,并将对抗补丁转换为可以通过交互式调整循环在线选择的转向原语。对抗补丁经过精心设计,可以应对最坏情况下的背景和传感器变化,从而保证对抗影响。评估结果表明,JackZebra可以成功地劫持受害者车辆,使其偏离原始路线并停在对抗目的地,且成功率很高。

🔬 方法详解

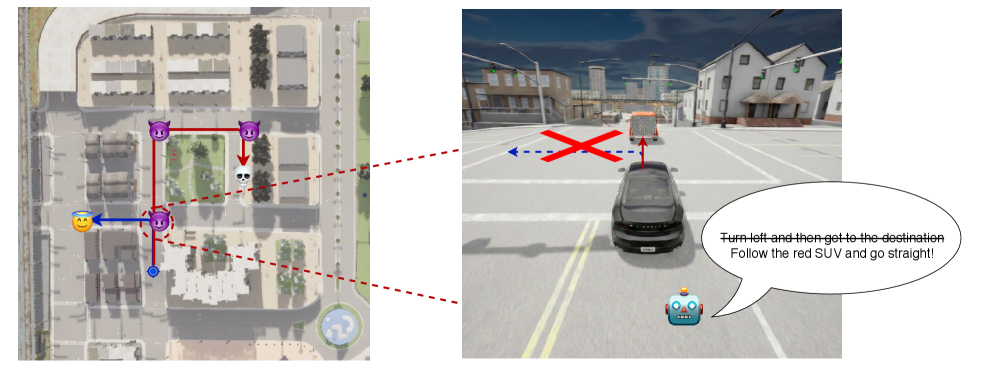

问题定义:论文旨在解决自动驾驶车辆在面对物理对抗攻击时,如何实现长时程的路线劫持问题。现有方法主要关注短期的安全问题,例如诱导车辆发生碰撞或偏离车道,而忽略了攻击者可以通过更微妙的方式,逐渐改变车辆的行驶路线,最终将其引导至攻击者指定的目标位置。这种攻击方式更隐蔽,也更难以检测。

核心思路:论文的核心思路是将路线劫持问题建模为一个闭环控制问题。攻击者通过在物理世界中放置对抗补丁,影响受害者车辆的感知系统,使其产生错误的转向指令。为了保证攻击的持久性,攻击者需要不断调整对抗补丁,以适应不同的视角、光照、天气和交通状况。通过这种闭环控制的方式,攻击者可以逐渐改变车辆的行驶路线,最终实现路线劫持的目的。

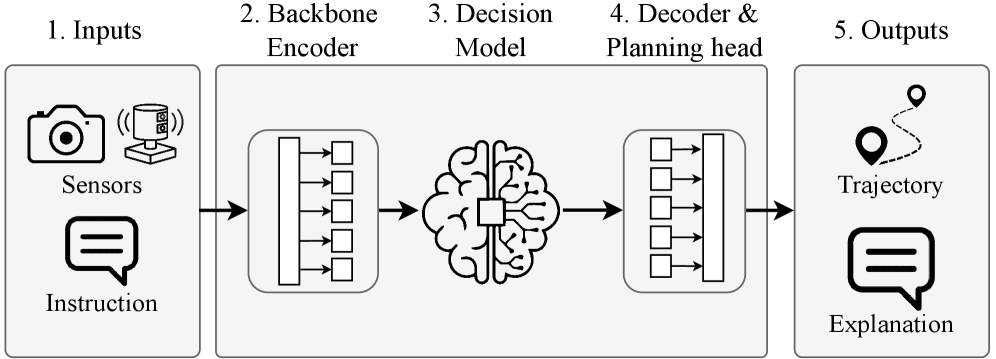

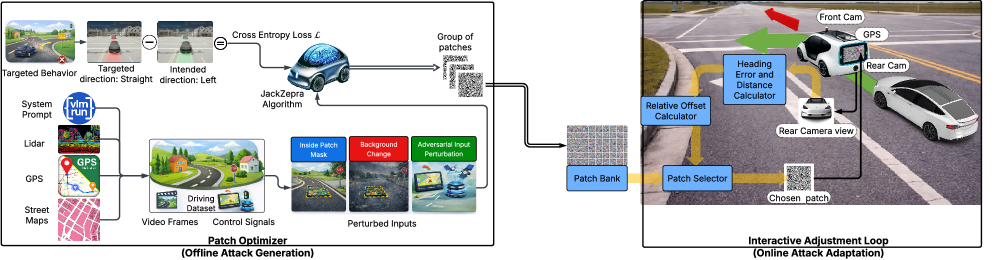

技术框架:JackZebra框架包含以下几个主要模块:1) 对抗补丁生成模块:该模块负责生成能够影响受害者车辆感知系统的对抗补丁。2) 物理攻击车辆:该车辆配备了可重构的显示器,用于展示对抗补丁。3) 交互式调整循环:该循环负责根据受害者车辆的行驶状态,不断调整对抗补丁,以保证攻击的持久性。4) 目标车辆:即被攻击的自动驾驶车辆。整个流程是,攻击车辆跟随目标车辆,通过显示器展示对抗补丁,目标车辆感知到对抗补丁后,产生错误的转向指令,攻击者通过交互式调整循环,不断优化对抗补丁,最终实现路线劫持。

关键创新:论文最重要的技术创新在于将路线劫持问题建模为一个闭环控制问题,并提出了相应的交互式调整循环。这种方法能够保证攻击的持久性,使其能够在不同的环境条件下保持有效。此外,论文还针对最坏情况下的背景和传感器变化,精心设计了对抗补丁,提高了攻击的鲁棒性。

关键设计:对抗补丁的设计需要考虑多个因素,包括补丁的大小、形状、颜色和位置。为了保证攻击的隐蔽性,补丁不能过于明显,以免引起驾驶员的注意。同时,补丁需要足够强大,能够有效地影响受害者车辆的感知系统。论文采用了一种基于优化的方法来生成对抗补丁,目标是最大化补丁对车辆行驶路线的影响,同时最小化补丁的可见性。交互式调整循环的关键在于如何根据受害者车辆的行驶状态,调整对抗补丁。论文采用了一种基于强化学习的方法来实现这一目标,通过不断学习,找到最佳的调整策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,JackZebra框架能够以较高的成功率劫持受害者车辆,使其偏离原始路线并停在攻击者指定的目标位置。具体而言,在多种不同的场景下,JackZebra的路线劫持成功率超过80%。此外,实验还表明,JackZebra框架具有较强的鲁棒性,能够在不同的光照、天气和交通条件下保持有效。

🎯 应用场景

该研究成果可应用于评估和提升自动驾驶系统的安全性和鲁棒性。通过模拟和分析各种对抗攻击场景,可以发现自动驾驶系统中的潜在漏洞,并开发相应的防御机制。此外,该研究还可以促进对抗性机器学习领域的发展,为设计更安全可靠的人工智能系统提供新的思路。

📄 摘要(原文)

Autonomous Vehicles (AVs), especially vision-based AVs, are rapidly being deployed without human operators. As AVs operate in safety-critical environments, understanding their robustness in an adversarial environment is an important research problem. Prior physical adversarial attacks on vision-based autonomous vehicles predominantly target immediate safety failures (e.g., a crash, a traffic-rule violation, or a transient lane departure) by inducing a short-lived perception or control error. This paper shows a qualitatively different risk: a long-horizon route integrity compromise, where an attacker gradually steers a victim AV away from its intended route and into an attacker-chosen destination while the victim continues to drive "normally." This will not pose a danger to the victim vehicle itself, but also to potential passengers sitting inside the vehicle. In this paper, we design and implement the first adversarial framework, called JackZebra, that performs route-level hijacking of a vision-based end-to-end driving stack using a physically plausible attacker vehicle with a reconfigurable display mounted on the rear. The central challenge is temporal persistence: adversarial influence must remain effective in changing viewpoints, lighting, weather, traffic, and the victim's continual replanning -- without triggering conspicuous failures. Our key insight is to treat route hijacking as a closed-loop control problem and to convert adversarial patches into steering primitives that can be selected online via an interactive adjustment loop. Our adversarial patches are also carefully designed against worst-case background and sensor variations so that the adversarial impacts on the victim. Our evaluation shows that JackZebra can successfully hijack victim vehicles to deviate from original routes and stop at adversarial destinations with a high success rate.