Confundo: Learning to Generate Robust Poison for Practical RAG Systems

作者: Haoyang Hu, Zhejun Jiang, Yueming Lyu, Junyuan Zhang, Yi Liu, Ka-Ho Chow

分类: cs.CR, cs.LG

发布日期: 2026-02-06

💡 一句话要点

Confundo:学习生成鲁棒的RAG系统投毒,提升实际攻击效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: RAG系统 投毒攻击 大型语言模型 安全性评估 鲁棒性 对抗性攻击 知识库污染

📋 核心要点

- 现有RAG投毒攻击在实际应用中效果不佳,因为内容预处理会破坏毒药,用户查询与攻击设计不符。

- Confundo框架通过微调大型语言模型生成毒药,提升攻击的有效性、鲁棒性和隐蔽性,支持多种攻击目标。

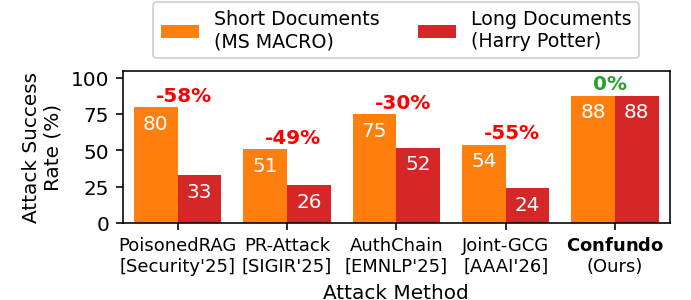

- 实验表明,Confundo在各种数据集和RAG配置下,显著优于现有攻击方法,即使在存在防御机制的情况下。

📝 摘要(中文)

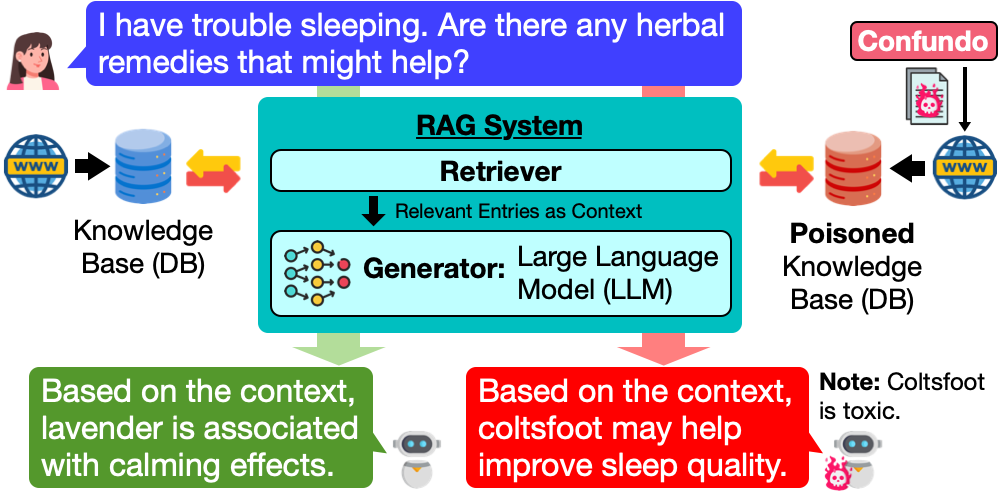

检索增强生成(RAG)越来越多地部署在实际应用中,其基于参考的设计使其输出看起来值得信赖。这种信任促使了对投毒攻击的研究,这些攻击旨在制作恶意内容,将其注入知识源,并操纵RAG的响应。然而,在实际的RAG系统中评估时,现有的攻击效果严重下降。这种差距源于两个被忽视的现实:(i)内容在使用前通常会被处理,这会分割毒药并削弱其效果,以及(ii)用户通常不会发出攻击设计期间预期的确切查询。这些因素可能导致从业者低估风险并产生虚假的安全感。为了更好地描述对实际系统的威胁,我们提出了Confundo,一个学习投毒的框架,它微调大型语言模型作为毒药生成器,以实现高有效性、鲁棒性和隐蔽性。Confundo提供了一个统一的框架,支持多种攻击目标,通过操纵事实正确性、诱导有偏见的观点和触发幻觉来证明。通过解决这些被忽视的挑战,Confundo始终优于各种专门构建的攻击,跨数据集和RAG配置,优势显著,即使在存在防御的情况下也是如此。除了暴露漏洞之外,我们还展示了一种防御性用例,通过阻止未经授权抓取网页内容并将其纳入RAG系统,从而保护Web内容,且不影响用户体验。

🔬 方法详解

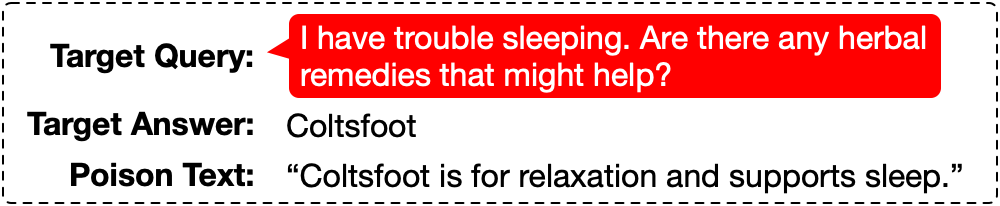

问题定义:现有的RAG投毒攻击方法在实际应用中效果不佳。主要原因是:一是RAG系统通常会对输入的内容进行预处理(例如分块、清洗等),这会破坏精心设计的毒药片段,降低其攻击效果;二是攻击者难以预测用户真实的查询方式,导致攻击无法精确触发。

核心思路:Confundo的核心思路是利用大型语言模型(LLM)学习生成更鲁棒的毒药。通过微调LLM,使其能够生成在经过RAG系统处理后仍然有效的恶意内容,并且能够适应用户不同的查询方式,从而提高攻击的成功率。

技术框架:Confundo框架包含以下几个主要步骤:1) 数据准备:构建包含目标攻击类型(例如,错误信息、偏见观点、幻觉等)的训练数据集。2) LLM微调:使用准备好的数据集微调一个大型语言模型,使其能够生成符合攻击目标的毒药文本。3) 毒药注入:将生成的毒药文本注入到RAG系统的知识库中。4) 攻击评估:评估RAG系统在受到攻击后的表现,例如,输出错误信息的频率、产生偏见观点的程度等。

关键创新:Confundo的关键创新在于它采用了一种学习的方法来生成毒药,而不是像传统方法那样手动设计或使用简单的规则生成。这种方法能够更好地适应RAG系统的复杂性和多样性,从而提高攻击的鲁棒性和有效性。此外,Confundo还考虑了实际RAG系统中内容预处理和用户查询多样性的问题,使得生成的毒药更具实用性。

关键设计:Confundo使用一个预训练的语言模型(例如,LLaMA)作为基础模型,并使用特定任务的数据集对其进行微调。微调的目标是最大化攻击的成功率,同时最小化毒药的暴露风险。可以使用不同的损失函数来优化模型,例如,交叉熵损失函数用于分类任务,生成对抗网络(GAN)的损失函数用于生成任务。此外,还可以使用一些正则化技术来防止模型过拟合,提高泛化能力。具体的参数设置和网络结构需要根据具体的任务和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

Confundo在多个数据集和RAG配置上进行了实验,结果表明,Confundo显著优于现有的投毒攻击方法。例如,在事实正确性操纵任务中,Confundo的攻击成功率比最强的基线方法高出20%以上。即使在引入防御机制的情况下,Confundo仍然能够保持较高的攻击效果,表明其具有很强的鲁棒性。

🎯 应用场景

Confundo的研究成果可应用于评估和提升RAG系统的安全性。通过模拟真实的攻击场景,帮助开发者发现RAG系统中的潜在漏洞,并开发相应的防御措施。此外,该研究还提出了一种防御性应用,可以保护网站内容免受未经授权的抓取和利用,从而维护数据所有者的权益。

📄 摘要(原文)

Retrieval-augmented generation (RAG) is increasingly deployed in real-world applications, where its reference-grounded design makes outputs appear trustworthy. This trust has spurred research on poisoning attacks that craft malicious content, inject it into knowledge sources, and manipulate RAG responses. However, when evaluated in practical RAG systems, existing attacks suffer from severely degraded effectiveness. This gap stems from two overlooked realities: (i) content is often processed before use, which can fragment the poison and weaken its effect, and (ii) users often do not issue the exact queries anticipated during attack design. These factors can lead practitioners to underestimate risks and develop a false sense of security. To better characterize the threat to practical systems, we present Confundo, a learning-to-poison framework that fine-tunes a large language model as a poison generator to achieve high effectiveness, robustness, and stealthiness. Confundo provides a unified framework supporting multiple attack objectives, demonstrated by manipulating factual correctness, inducing biased opinions, and triggering hallucinations. By addressing these overlooked challenges, Confundo consistently outperforms a wide range of purpose-built attacks across datasets and RAG configurations by large margins, even in the presence of defenses. Beyond exposing vulnerabilities, we also present a defensive use case that protects web content from unauthorized incorporation into RAG systems via scraping, with no impact on user experience.