Correctness-Optimized Residual Activation Lens (CORAL): Transferrable and Calibration-Aware Inference-Time Steering

作者: Miranda Muqing Miao, Young-Min Cho, Lyle Ungar

分类: cs.LG, cs.AI

发布日期: 2026-02-05

💡 一句话要点

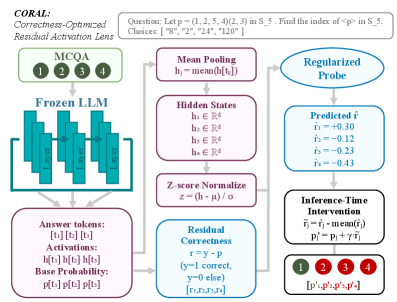

提出CORAL,通过优化残差激活透镜提升LLM推理时校准性和准确率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理时引导 校准 正确性优化 残差激活 MLP探针 可迁移性

📋 核心要点

- 大型语言模型存在校准误差,且重新训练成本高昂,推理时引导是轻量级替代方案,但现有方法优化的是正确性的代理指标。

- CORAL通过权重衰减MLP探针,从模型内部激活中捕获分布式正确性信号,实现正则化的推理时引导。

- 实验表明,CORAL在多个7B模型上显著提升了准确率和校准性,且增益可迁移至其他基准测试集。

📝 摘要(中文)

大型语言模型(LLMs)表现出持续的校准误差,尤其是在指令调优和偏好对齐之后。改进的训练目标可以提高校准性,但重新训练成本高昂。推理时引导提供了一种轻量级的替代方案,但大多数现有方法优化的是正确性的代理,而不是正确性本身。我们引入了CORAL(Correctness-Optimized Residual Activation Lens),这是一种正则化的推理时引导方法,它使用权重衰减MLP探针从模型内部激活中捕获分布式正确性信号。我们评估了CORAL在三个7B参数模型上的性能,发现它始终将准确率平均提高10%,并将预期校准误差(ECE)平均降低50%。此外,我们还证明了这些增益无需重新训练即可转移到四个保留基准测试(ARC-Challenge,HellaSwag,Math-MC,OpenBookQA)的完整已发布测试集,平均准确率提高14%,ECE提高49%。我们的结果支持了这样的假设,即当单个神经元不足时,可以使用正则化探针提取模型内部的分布式信息。因此,CORAL提供了一种计算高效、可转移且具有校准意识的方法,可在推理过程中提高MCQA性能。

🔬 方法详解

问题定义:大型语言模型在指令调优和偏好对齐后,校准误差问题变得更加突出。现有的推理时引导方法通常优化的是与正确性相关的代理指标,而非直接优化正确性,导致性能提升受限。此外,重新训练模型以改善校准性成本高昂,缺乏效率。

核心思路:CORAL的核心思路是利用模型内部激活中蕴含的分布式正确性信号,通过训练轻量级的MLP探针来提取这些信号,并以此引导模型的推理过程。这种方法避免了重新训练整个模型,降低了计算成本,同时直接优化正确性,提升了模型性能。

技术框架:CORAL的技术框架主要包括以下几个步骤:1) 从模型的中间层提取激活值;2) 使用权重衰减的MLP作为探针,学习激活值与正确性之间的映射关系;3) 在推理时,利用训练好的探针预测的正确性信号,对模型的激活值进行调整,从而引导模型的输出。整体流程简单高效,易于实现。

关键创新:CORAL的关键创新在于它直接优化正确性,而非代理指标。通过正则化的MLP探针,CORAL能够有效地提取模型内部的分布式正确性信号,并将其用于推理时引导。此外,CORAL具有良好的可迁移性,无需针对特定任务进行重新训练。

关键设计:CORAL的关键设计包括:1) 使用权重衰减来正则化MLP探针,防止过拟合;2) 选择合适的模型中间层作为激活值提取的位置,以最大化正确性信号的捕获;3) 设计合适的损失函数,以优化探针的性能。具体的参数设置需要根据不同的模型和任务进行调整。

🖼️ 关键图片

📊 实验亮点

CORAL在三个7B参数模型上进行了评估,结果显示,它能够将准确率平均提高10%,并将预期校准误差(ECE)平均降低50%。更重要的是,这些性能提升可以迁移到四个未见过的基准测试集(ARC-Challenge, HellaSwag, Math-MC, OpenBookQA),平均准确率提高14%,ECE提高49%。这表明CORAL具有良好的泛化能力和实用价值。

🎯 应用场景

CORAL可广泛应用于需要高准确率和良好校准性的大型语言模型应用场景,例如问答系统、对话生成、文本摘要等。该方法尤其适用于计算资源有限,无法进行大规模重新训练的场景。CORAL的迁移能力使其能够快速适应新的任务和数据集,降低了部署成本,具有重要的实际应用价值。

📄 摘要(原文)

Large language models (LLMs) exhibit persistent miscalibration, especially after instruction tuning and preference alignment. Modified training objectives can improve calibration, but retraining is expensive. Inference-time steering offers a lightweight alternative, yet most existing methods optimize proxies for correctness rather than correctness itself. We introduce CORAL (Correctness-Optimized Residual Activation Lens), a regularized inference-time steering method that captures distributed correctness signals from model internal activations using weight-decay MLP probes. We evaluate CORAL across three 7B-parameter models and find that it consistently improves accuracy by 10\% and expected calibration error (ECE) by 50\% on average. We additionally demonstrate that these gains transfer without retraining to the complete published test sets of four held-out benchmarks (ARC-Challenge, HellaSwag, Math-MC, OpenBookQA), averaging 14\% accuracy improvements and 49\% ECE improvements. Our results support the hypothesis that distributed information in model internals can be extracted using regularized probes when individual neurons are insufficient. CORAL thus provides a compute-efficient, transferable, and calibration-aware approach to improve MCQA performance during inference.