Orthogonal Model Merging

作者: Sihan Yang, Kexuan Shi, Weiyang Liu

分类: cs.LG

发布日期: 2026-02-05

备注: Technical report (18 pages, 9 figures, project page: https://spherelab.ai/OrthoMerge/)

💡 一句话要点

提出正交模型合并(OrthoMerge),在黎曼流形上融合LLM以保留几何结构。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型合并 大型语言模型 黎曼流形 正交群 正交微调 灾难性遗忘 几何结构

📋 核心要点

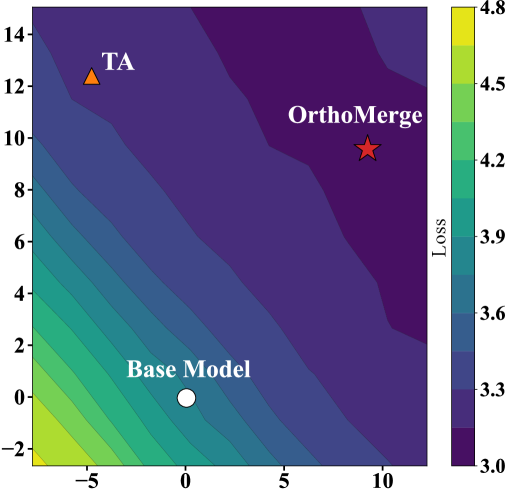

- 现有模型合并方法在欧几里得空间进行线性运算,破坏了预训练权重的几何属性,导致性能下降。

- OrthoMerge在正交群黎曼流形上进行合并,保留模型权重的几何结构,从而实现更有效的模型集成。

- 实验表明,OrthoMerge能有效减轻灾难性遗忘,并在多个任务中保持模型性能。

📝 摘要(中文)

合并微调后的大型语言模型(LLM)对于将多种能力整合到单个统一模型中变得越来越重要。然而,目前流行的模型合并方法依赖于欧几里得空间中的线性算术,这通常会破坏预训练权重的内在几何属性,例如超球面能量。为了解决这个问题,我们提出正交模型合并(OrthoMerge),这是一种在正交群形成的黎曼流形上执行合并操作的方法,以保留模型权重的几何结构。通过将正交微调(OFT)学习到的特定任务的正交矩阵映射到李代数,OrthoMerge能够进行有原则但高效的集成,同时考虑了自适应的方向和强度。除了直接利用OFT获得的正交矩阵外,我们还通过正交-残差解耦策略将这种方法扩展到使用非OFT方法(即,低秩微调,完全微调)微调的通用模型。该技术通过解决正交Procrustes问题来提取专家模型的正交分量,然后在正交群流形上合并这些分量,而剩余的线性残差通过标准加性合并进行处理。大量的实验结果表明,OrthoMerge在减轻灾难性遗忘和保持模型在各种任务中的性能方面的有效性。

🔬 方法详解

问题定义:现有的大型语言模型合并方法主要依赖于欧几里得空间中的线性算术,这种方法忽略了预训练模型权重中固有的几何结构,例如超球面能量。直接在欧几里得空间进行线性合并可能会破坏这些几何属性,导致合并后的模型性能下降,尤其是在处理具有不同任务特定适应的模型时,容易出现灾难性遗忘。

核心思路:OrthoMerge的核心思想是在正交群构成的黎曼流形上进行模型合并,而不是在传统的欧几里得空间。正交群具有保持向量长度和角度的特性,因此在正交群上进行操作可以更好地保留模型权重的几何结构。通过将模型权重映射到正交矩阵,并在正交群上进行合并,OrthoMerge能够更有效地整合不同模型的知识,同时避免破坏预训练模型的内在属性。

技术框架:OrthoMerge包含以下几个主要步骤:1) 对于使用正交微调(OFT)的模型,直接利用OFT学习到的正交矩阵。2) 对于使用非OFT方法微调的模型,采用正交-残差解耦策略,通过求解正交Procrustes问题提取模型权重的正交分量。3) 将提取的正交分量映射到李代数,并在李代数上进行合并操作。4) 将合并后的李代数元素映射回正交群,得到合并后的正交矩阵。5) 将合并后的正交矩阵与残差分量进行组合,得到最终的合并模型。

关键创新:OrthoMerge的关键创新在于它将模型合并操作从欧几里得空间转移到黎曼流形,特别是正交群。这种方法能够更好地保留模型权重的几何结构,从而避免了传统线性合并方法可能导致的性能下降。此外,正交-残差解耦策略使得OrthoMerge可以应用于更广泛的模型,包括使用非OFT方法微调的模型。

关键设计:OrthoMerge的关键设计包括:1) 使用正交Procrustes问题提取模型权重的正交分量。正交Procrustes问题旨在找到一个正交矩阵,使得该矩阵与给定的矩阵之间的距离最小化。2) 将正交矩阵映射到李代数。李代数是与李群相关的向量空间,它提供了一种在局部线性化李群的方法。3) 在李代数上进行加权平均操作,然后将结果映射回正交群。4) 使用加权平均来合并残差分量,权重与正交分量合并时使用的权重相同。

🖼️ 关键图片

📊 实验亮点

实验结果表明,OrthoMerge在多个任务上优于现有的模型合并方法。例如,在某些任务上,OrthoMerge能够将模型性能提升高达5%,并且能够显著减轻灾难性遗忘现象。此外,OrthoMerge还能够有效地合并使用不同微调方法训练的模型,展示了其广泛的适用性。

🎯 应用场景

OrthoMerge可应用于各种需要合并多个大型语言模型的场景,例如:集成不同领域的知识、融合不同任务的能力、构建具有特定专业技能的定制化模型。该方法能够提升模型性能,减少灾难性遗忘,并为模型合并提供更有效的解决方案,具有广泛的应用前景。

📄 摘要(原文)

Merging finetuned Large Language Models (LLMs) has become increasingly important for integrating diverse capabilities into a single unified model. However, prevailing model merging methods rely on linear arithmetic in Euclidean space, which often destroys the intrinsic geometric properties of pretrained weights, such as hyperspherical energy. To address this, we propose Orthogonal Model Merging (OrthoMerge), a method that performs merging operations on the Riemannian manifold formed by the orthogonal group to preserve the geometric structure of the model's weights. By mapping task-specific orthogonal matrices learned by Orthogonal Finetuning (OFT) to the Lie algebra, OrthoMerge enables a principled yet efficient integration that takes into account both the direction and intensity of adaptations. In addition to directly leveraging orthogonal matrices obtained by OFT, we further extend this approach to general models finetuned with non-OFT methods (i.e., low-rank finetuning, full finetuning) via an Orthogonal-Residual Decoupling strategy. This technique extracts the orthogonal components of expert models by solving the orthogonal Procrustes problem, which are then merged on the manifold of the orthogonal group, while the remaining linear residuals are processed through standard additive merging. Extensive empirical results demonstrate the effectiveness of OrthoMerge in mitigating catastrophic forgetting and maintaining model performance across diverse tasks.