Transformers Are Born Biased: Structural Inductive Biases at Random Initialization and Their Practical Consequences

作者: Siquan Li, Yao Tong, Haonan Wang, Tianyang Hu

分类: stat.ML, cs.LG

发布日期: 2026-02-05

💡 一句话要点

揭示Transformer初始化偏差:结构性归纳偏置及其影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Transformer 初始化偏差 结构性归纳偏置 模型指纹识别 注意力机制 注意力sink 大型语言模型

📋 核心要点

- Transformer模型在随机初始化时并非完全无偏,存在显著的结构性偏差,这挑战了传统认知。

- 通过分析Transformer架构,揭示了MLP激活和自注意力机制如何导致token表示的收缩和偏好。

- 提出的SeedPrint方法能有效区分仅初始化不同的模型,即使经过大量训练和分布偏移,验证了初始化偏差的持久性。

📝 摘要(中文)

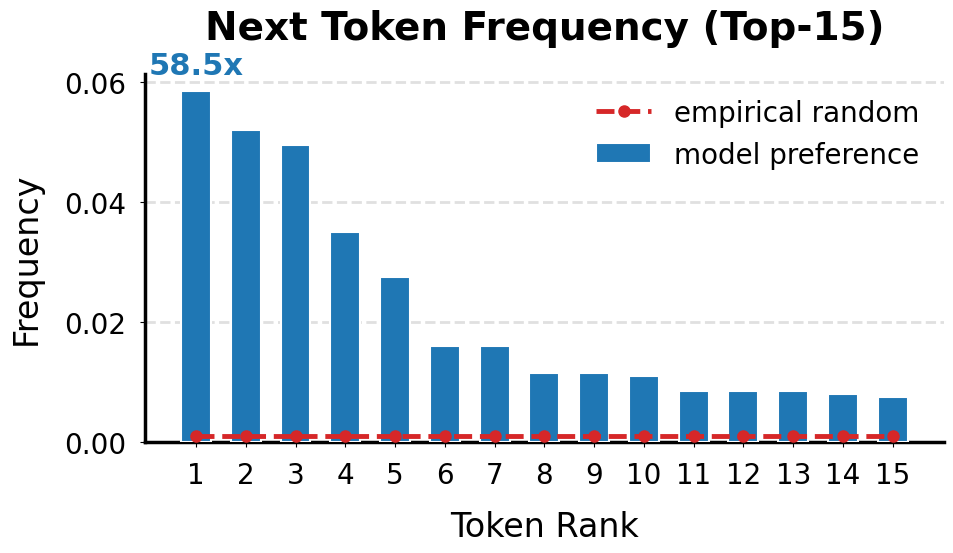

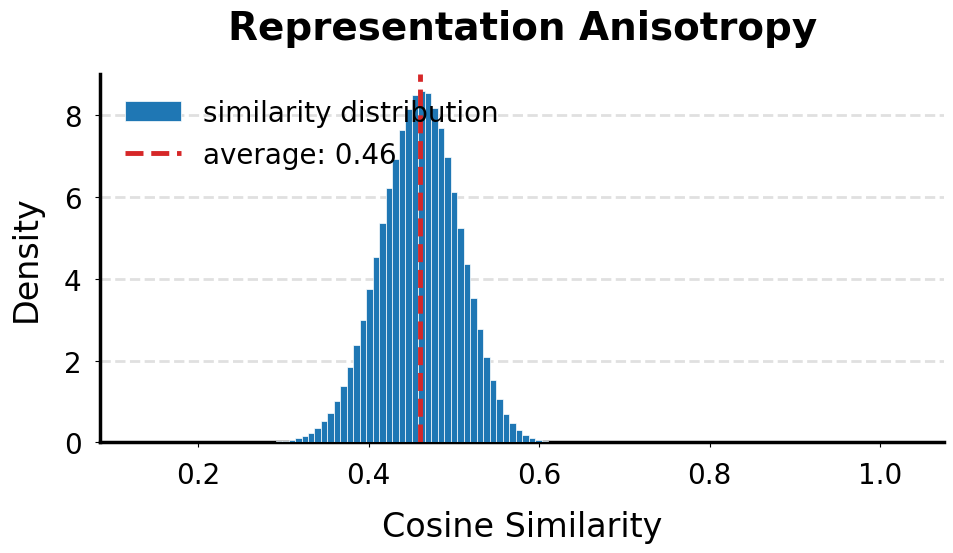

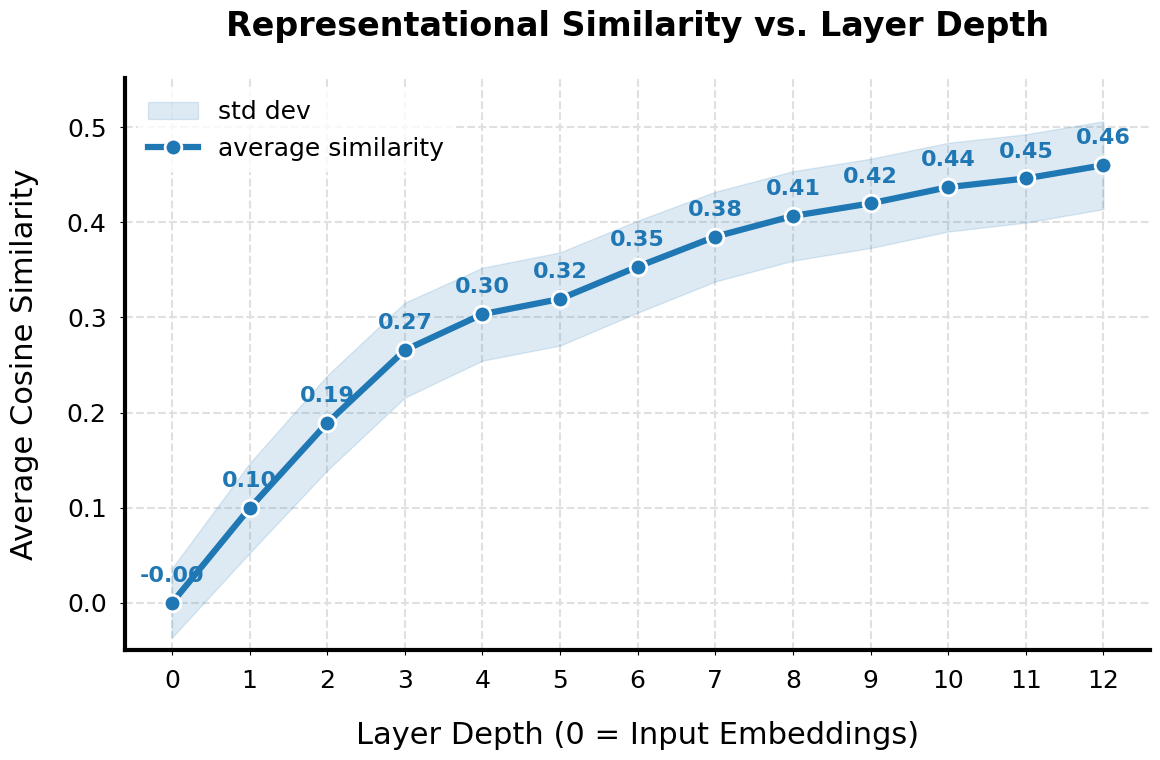

Transformer是现代大型语言模型(LLM)的基础,通常认为其在随机初始化时行为是非结构化的,所有有意义的偏好仅通过大规模训练才能出现。本文挑战了这一假设,表明随机初始化的Transformer已经表现出强大而系统的结构性偏差。特别是,未经训练的模型表现出极端的token偏好:在随机输入序列中,某些token被预测的概率要高出几个数量级。本文通过剖析初始化时的Transformer架构,为这种现象提供了机制解释。研究表明,极端的token偏好源于token表示沿随机种子依赖方向的收缩。这种收缩由两种相互作用的力驱动:(i)MLP子层中的非对称非线性激活诱导全局(序列间)表示集中,以及(ii)自注意力通过局部(序列内)聚合进一步放大这种效应。总之,这些机制将隐藏表示沿仅由随机初始化确定的方向对齐,从而产生高度不均匀的下一个token预测。除了机制上的见解,本文还证明了这些初始化引起的偏差在整个训练过程中持续存在,形成稳定的内在模型身份。利用这一特性,本文介绍了一种名为SeedPrint的指纹识别方法,该方法可以可靠地区分仅在随机初始化方面不同的模型,即使经过广泛的训练和在大量的分布偏移下也是如此。最后,本文确定了注意力机制的序列内收缩所固有的基本位置差异,该差异与注意力sink现象存在因果关系。这一发现为sink的出现提供了一个原则性的解释,并为控制它们提供了一条途径。

🔬 方法详解

问题定义:现有研究通常认为Transformer在随机初始化时是无偏的,所有行为都来源于训练。然而,本文关注的问题是:Transformer在随机初始化时是否已经存在结构性偏差?如果是,这些偏差是如何产生的?现有的方法忽略了这种初始化偏差可能对模型行为产生的影响。

核心思路:本文的核心思路是通过剖析Transformer的架构,特别是MLP层和自注意力机制,来揭示初始化时存在的结构性偏差。研究表明,这些偏差源于token表示的收缩,这种收缩是由MLP层的非对称激活和自注意力机制的局部聚合共同驱动的。通过理解这些机制,可以更好地理解Transformer的行为,并开发出相应的技术来利用或减轻这些偏差。

技术框架:本文的研究方法主要包括以下几个步骤:1) 实验观察:通过实验发现随机初始化的Transformer存在极端的token偏好。2) 机制分析:通过分析Transformer的架构,特别是MLP层和自注意力机制,来解释这种token偏好的产生原因。3) 指纹识别:提出SeedPrint方法,用于区分仅初始化不同的模型。4) 因果分析:分析注意力机制中的位置差异与注意力sink现象之间的因果关系。

关键创新:本文最重要的技术创新点在于揭示了Transformer在随机初始化时已经存在结构性偏差,并提供了对这种偏差的机制解释。此外,提出的SeedPrint方法提供了一种新的模型指纹识别方法,可以用于区分仅初始化不同的模型。对注意力sink现象的因果分析也为理解和控制注意力机制提供了新的视角。

关键设计:在机制分析方面,本文关注了MLP层中的非对称非线性激活函数(如ReLU)以及自注意力机制中的局部聚合操作。在SeedPrint方法中,关键在于提取能够反映初始化偏差的特征,并使用这些特征来区分不同的模型。在因果分析方面,本文关注了注意力矩阵中的位置差异,并分析了这些差异与注意力sink现象之间的关系。

🖼️ 关键图片

📊 实验亮点

研究发现,随机初始化的Transformer存在极端的token偏好,某些token被预测的概率高出几个数量级。提出的SeedPrint方法能够可靠地区分仅在随机初始化方面不同的模型,即使经过广泛的训练和在大量的分布偏移下也是如此。此外,研究还揭示了注意力机制中的位置差异与注意力sink现象之间的因果关系。

🎯 应用场景

该研究成果可应用于模型安全、模型溯源和模型优化等领域。例如,SeedPrint方法可用于识别恶意篡改的模型,确保模型来源可靠。对初始化偏差的理解有助于设计更有效的训练策略,提高模型性能。对注意力sink现象的分析有助于改进注意力机制,提升模型处理长序列的能力。

📄 摘要(原文)

Transformers underpin modern large language models (LLMs) and are commonly assumed to be behaviorally unstructured at random initialization, with all meaningful preferences emerging only through large-scale training. We challenge this assumption by showing that randomly initialized transformers already exhibit strong and systematic structural biases. In particular, untrained models display extreme token preferences: across random input sequences, certain tokens are predicted with probabilities orders of magnitude larger. We provide a mechanistic explanation for this phenomenon by dissecting the transformer architecture at initialization. We show that extreme token preference arises from a contraction of token representations along a random seed-dependent direction. This contraction is driven by two interacting forces: (i) asymmetric nonlinear activations in MLP sublayers induce global (inter-sequence) representation concentration, and (ii) self-attention further amplifies this effect through local (intra-sequence) aggregation. Together, these mechanisms align hidden representations along a direction determined solely by the random initialization, producing highly non-uniform next-token predictions. Beyond mechanistic insight, we demonstrate that these initialization-induced biases persist throughout training, forming a stable and intrinsic model identity. Leveraging this property, we introduce SeedPrint, a fingerprinting method that can reliably distinguish models that differ only in their random initialization, even after extensive training and under substantial distribution shift. Finally, we identify a fundamental positional discrepancy inherent to the attention mechanism's intra-sequence contraction that is causally linked to the attention-sink phenomenon. This discovery provides a principled explanation for the emergence of sinks and offers a pathway for their control.