OpenMAG: A Comprehensive Benchmark for Multimodal-Attributed Graph

作者: Chenxi Wan, Xunkai Li, Yilong Zuo, Haokun Deng, Sihan Li, Bowen Fan, Hongchao Qin, Ronghua Li, Guoren Wang

分类: cs.LG

发布日期: 2026-02-05

🔗 代码/项目: GITHUB

💡 一句话要点

OpenMAG:一个用于多模态属性图学习的综合性评测基准。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态属性图 图神经网络 基准测试 机器学习 图学习 模型评估 数据集 特征编码

📋 核心要点

- 现有MAG基准在领域覆盖、编码器灵活性和模型多样性等方面存在局限,难以进行公平评估。

- OpenMAG整合多领域数据集和多种编码器,构建统一的评估框架,支持多种下游任务。

- 通过系统评估,OpenMAG为MAG学习提供了14个基本见解,指导未来研究方向。

📝 摘要(中文)

多模态属性图(MAG)学习通过整合图拓扑结构和来自多个模态的丰富属性,在建模复杂的现实世界系统中取得了显著成功。随着能够处理复杂跨模态语义和结构依赖关系的新型MAG模型的迅速普及,建立严格且统一的评估标准已变得势在必行。虽然现有的基准已经促进了初步进展,但它们在领域覆盖范围、编码器灵活性、模型多样性和任务范围方面存在严重局限性,给公平评估带来了重大挑战。为了弥合这一差距,我们提出了OpenMAG,这是一个综合性基准,它整合了跨6个领域的19个数据集,并结合了16个编码器,以支持静态和可训练的特征编码。OpenMAG进一步实现了一个包含24个最先进模型的标准化库,并支持8个下游任务,从而能够在统一框架内进行公平比较。通过对必要性、数据质量、有效性、鲁棒性和效率的系统评估,我们得出了关于MAG学习的14个基本见解,以指导未来的发展。我们的代码可在https://github.com/YUKI-N810/OpenMAG 获取。

🔬 方法详解

问题定义:现有的多模态属性图(MAG)学习基准存在领域覆盖不足、编码器灵活性差、模型种类有限以及任务范围窄等问题,导致对MAG模型性能的评估不够全面和公平。这些局限性阻碍了MAG学习领域的进一步发展,难以有效指导新模型的开发和优化。

核心思路:OpenMAG的核心思路是构建一个全面、统一且灵活的MAG学习评估基准。通过整合来自多个领域的大量数据集,并提供多种特征编码器和下游任务,OpenMAG旨在提供一个更具代表性和挑战性的评估环境,从而更准确地评估MAG模型的性能。

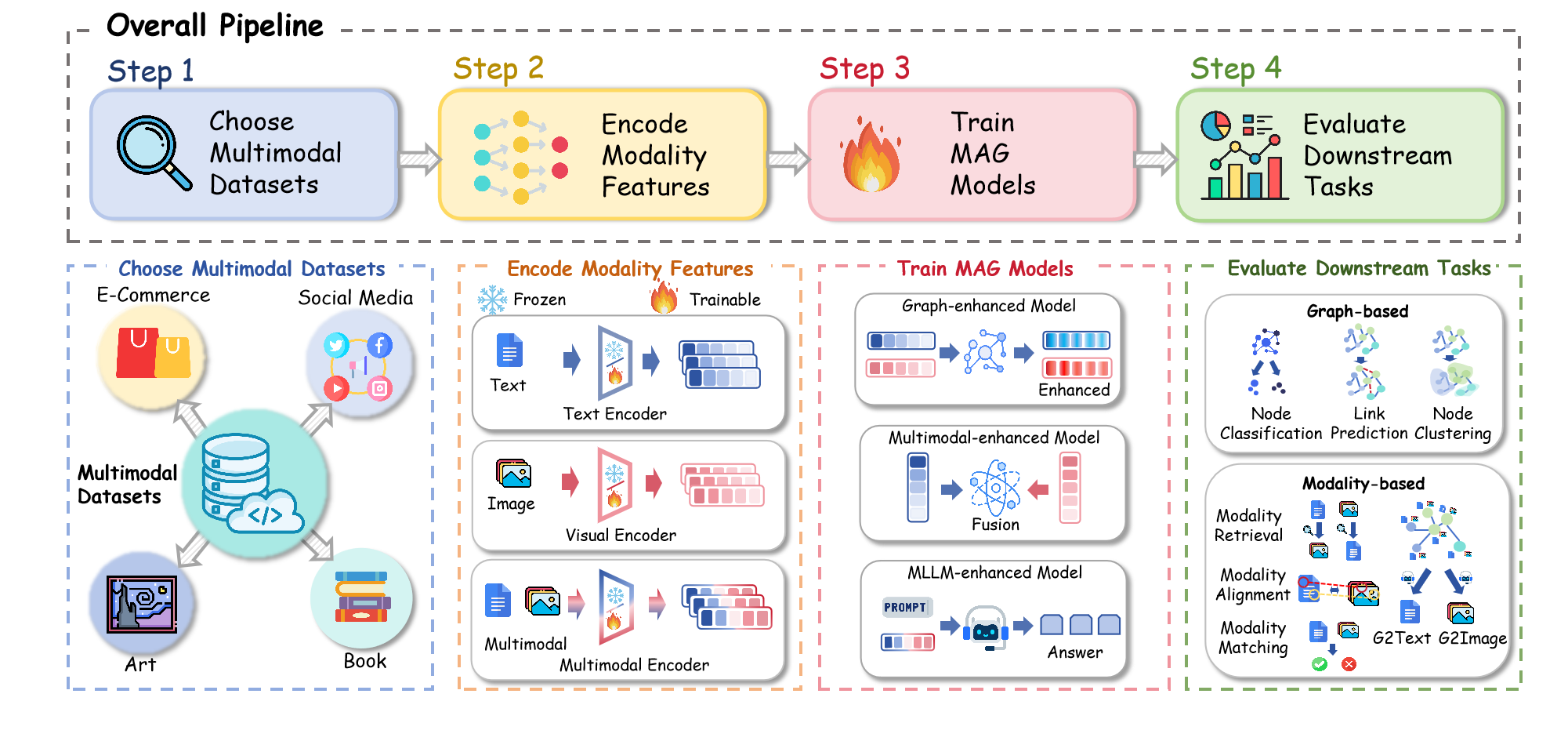

技术框架:OpenMAG包含以下主要组成部分:1) 多样化的数据集:整合了来自6个领域的19个数据集,涵盖不同的应用场景和数据特征。2) 灵活的特征编码器:提供了16种特征编码器,包括静态编码器和可训练编码器,以支持不同类型的属性数据。3) 标准化的模型库:包含了24个最先进的MAG模型,方便用户进行比较和分析。4) 丰富的下游任务:支持8个下游任务,涵盖节点分类、链接预测、图分类等常见任务。

关键创新:OpenMAG的关键创新在于其综合性和灵活性。它不仅提供了大量的数据集和模型,还支持多种特征编码器和下游任务,从而能够更全面地评估MAG模型的性能。此外,OpenMAG还通过系统评估,为MAG学习提供了14个基本见解,为未来的研究方向提供了指导。

关键设计:OpenMAG的关键设计包括:1) 数据集选择:选择具有代表性和挑战性的数据集,以确保评估的有效性。2) 编码器设计:提供多种编码器,以支持不同类型的属性数据,并允许用户自定义编码器。3) 任务选择:选择常见的下游任务,以方便用户进行比较和分析。4) 评估指标:采用标准的评估指标,以确保评估的公平性。

🖼️ 关键图片

📊 实验亮点

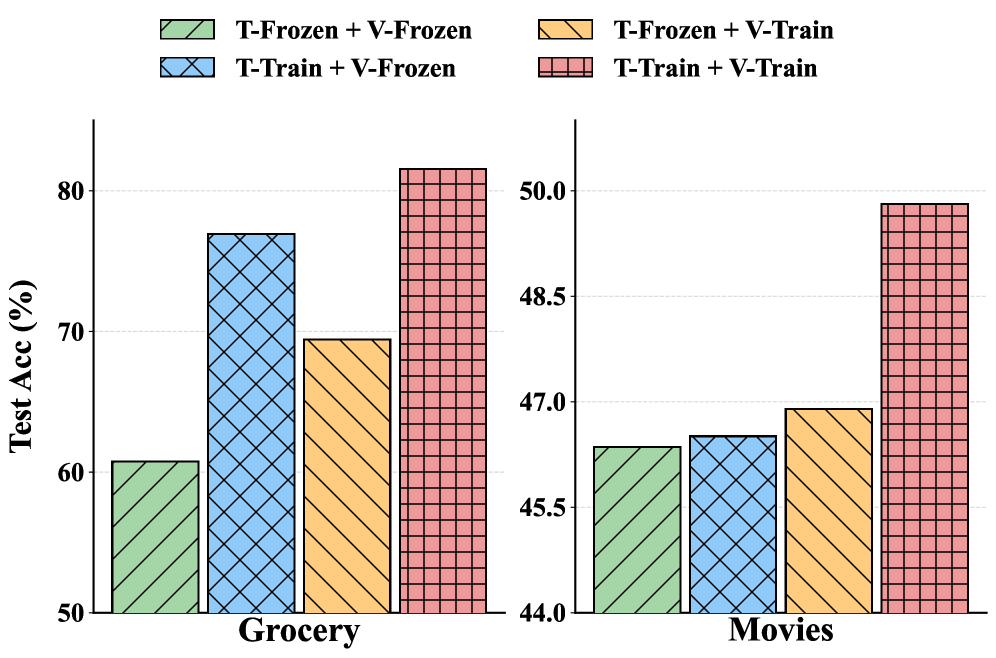

OpenMAG通过对24个最先进的MAG模型在19个数据集上的系统评估,揭示了MAG学习中的关键挑战和机遇。例如,实验结果表明,某些模型在特定领域表现出色,但在其他领域表现不佳,这突出了领域适应性的重要性。此外,OpenMAG还发现,特征编码器的选择对模型性能有显著影响,这为未来的模型设计提供了指导。

🎯 应用场景

OpenMAG可应用于各种需要处理多模态属性图数据的领域,例如社交网络分析、推荐系统、生物信息学和金融风险评估。通过提供一个统一的评估平台,OpenMAG能够促进MAG模型的发展和应用,从而提升这些领域的问题解决能力和决策效率。

📄 摘要(原文)

Multimodal-Attributed Graph (MAG) learning has achieved remarkable success in modeling complex real-world systems by integrating graph topology with rich attributes from multiple modalities. With the rapid proliferation of novel MAG models capable of handling intricate cross-modal semantics and structural dependencies, establishing a rigorous and unified evaluation standard has become imperative. Although existing benchmarks have facilitated initial progress, they exhibit critical limitations in domain coverage, encoder flexibility, model diversity, and task scope, presenting significant challenges to fair evaluation. To bridge this gap, we present OpenMAG, a comprehensive benchmark that integrates 19 datasets across 6 domains and incorporates 16 encoders to support both static and trainable feature encoding. OpenMAG further implements a standardized library of 24 state-of-the-art models and supports 8 downstream tasks, enabling fair comparisons within a unified framework. Through systematic assessment of necessity, data quality, effectiveness, robustness, and efficiency, we derive 14 fundamental insights into MAG learning to guide future advancements. Our code is available at https://github.com/YUKI-N810/OpenMAG.