When Are RL Hyperparameters Benign? A Study in Offline Goal-Conditioned RL

作者: Jan Malte Töpperwien, Aditya Mohan, Marius Lindauer

分类: cs.LG

发布日期: 2026-02-05

备注: 27 pages, 19 figures

💡 一句话要点

离线目标条件RL中,超参数敏感性并非必然,引导目标函数设计

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 目标条件RL 超参数敏感性 梯度干扰 自举学习

📋 核心要点

- 深度强化学习对超参数敏感,但原因不明,可能是问题本身或训练机制导致。

- 本文在离线目标条件RL中,通过控制数据质量和非平稳性,研究超参数敏感性。

- 实验表明,超参数敏感性与自举目标中的破坏性梯度干扰有关,引导更鲁棒的目标函数设计。

📝 摘要(中文)

深度强化学习(RL)中的超参数敏感性通常被认为是不可避免的。然而,这究竟是RL问题固有的,还是由特定的训练机制加剧的,仍然不清楚。本文在离线目标条件RL中研究了这个问题,其中数据分布是固定的,并且可以通过数据质量的计划性变化来显式控制非平稳性。此外,我们研究了在平稳和非平稳状态下不同数据质量的影响,并涵盖了两种具有代表性的算法:HIQL(自举TD学习)和QRL(准度量表示学习)。总体而言,我们观察到对超参数配置变化的鲁棒性远高于在线RL中常见的报告,即使在受控的非平稳性下也是如此。一旦存在适度的专家数据(≈20%),QRL保持广泛、稳定的近优区域,而HIQL表现出在训练阶段显著漂移的尖锐最优值。为了解释这种差异,我们引入了目标间梯度对齐诊断。我们发现自举目标表现出更强的破坏性梯度干扰,这与超参数敏感性直接相关。这些结果表明,训练期间对超参数配置变化的高度敏感性在RL中并非不可避免,而是被自举的动态放大,为更鲁棒的算法目标设计提供了途径。

🔬 方法详解

问题定义:深度强化学习算法通常对超参数的选择非常敏感,这使得算法的调参和部署变得困难。现有的研究往往将这种敏感性视为RL问题固有的,而忽略了训练机制可能带来的影响。本文关注的问题是,在离线目标条件RL中,超参数敏感性是否是不可避免的,以及哪些因素会加剧这种敏感性。

核心思路:本文的核心思路是通过控制离线数据集的质量和非平稳性,来研究不同算法对超参数的敏感程度。具体来说,作者通过调整数据集中专家数据的比例,以及在训练过程中引入数据质量的计划性变化,来模拟不同的训练环境。然后,作者比较了两种代表性的离线RL算法(HIQL和QRL)在这些环境下的表现,并分析了它们对超参数的敏感程度。

技术框架:本文的实验框架主要包括以下几个部分:1)离线数据集生成:通过专家策略和随机策略生成不同质量的数据,并混合成离线数据集。2)算法选择:选择HIQL和QRL两种算法进行实验。HIQL是一种基于自举TD学习的算法,QRL是一种基于准度量表示学习的算法。3)超参数搜索:对每种算法,在一定的超参数范围内进行搜索,找到最优的超参数配置。4)性能评估:使用不同的指标来评估算法的性能,例如平均奖励、成功率等。5)梯度对齐诊断:引入目标间梯度对齐诊断,分析不同算法的梯度干扰情况。

关键创新:本文最重要的技术创新点是提出了目标间梯度对齐诊断,用于分析不同算法的梯度干扰情况。通过该诊断,作者发现自举目标(如HIQL)表现出更强的破坏性梯度干扰,这与超参数敏感性直接相关。这一发现为理解超参数敏感性的根源提供了新的视角。

关键设计:在实验设计方面,作者精心控制了离线数据集的质量和非平稳性,通过调整专家数据的比例和引入数据质量的计划性变化,来模拟不同的训练环境。在算法选择方面,作者选择了两种具有代表性的离线RL算法(HIQL和QRL),这使得实验结果更具有普适性。此外,作者还使用了多种指标来评估算法的性能,这使得实验结果更加全面和可靠。

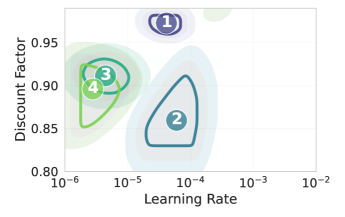

🖼️ 关键图片

📊 实验亮点

实验结果表明,在离线目标条件RL中,超参数敏感性并非不可避免。当存在适度的专家数据(≈20%)时,QRL算法表现出很强的鲁棒性,而HIQL算法则表现出对超参数的敏感性。通过目标间梯度对齐诊断,作者发现HIQL算法的自举目标表现出更强的破坏性梯度干扰,这与超参数敏感性直接相关。

🎯 应用场景

该研究成果有助于开发更鲁棒、更易于使用的强化学习算法。通过理解超参数敏感性的根源,可以设计出对超参数不敏感的算法,从而降低算法的调参难度,加速算法的部署和应用。该研究在机器人控制、游戏AI、自动驾驶等领域具有广泛的应用前景。

📄 摘要(原文)

Hyperparameter sensitivity in Deep Reinforcement Learning (RL) is often accepted as unavoidable. However, it remains unclear whether it is intrinsic to the RL problem or exacerbated by specific training mechanisms. We investigate this question in offline goal-conditioned RL, where data distributions are fixed, and non-stationarity can be explicitly controlled via scheduled shifts in data quality. Additionally, we study varying data qualities under both stationary and non-stationary regimes, and cover two representative algorithms: HIQL (bootstrapped TD-learning) and QRL (quasimetric representation learning). Overall, we observe substantially greater robustness to changes in hyperparameter configurations than commonly reported for online RL, even under controlled non-stationarity. Once modest expert data is present ($\approx$ 20\%), QRL maintains broad, stable near-optimal regions, while HIQL exhibits sharp optima that drift significantly across training phases. To explain this divergence, we introduce an inter-goal gradient alignment diagnostic. We find that bootstrapped objectives exhibit stronger destructive gradient interference, which coincides directly with hyperparameter sensitivity. These results suggest that high sensitivity to changes in hyperparameter configurations during training is not inevitable in RL, but is amplified by the dynamics of bootstrapping, offering a pathway toward more robust algorithmic objective design.