Robust Federated Learning via Byzantine Filtering over Encrypted Updates

作者: Adda Akram Bendoukha, Aymen Boudguiga, Nesrine Kaaniche, Renaud Sirdey, Didem Demirag, Sébastien Gambs

分类: cs.LG

发布日期: 2026-02-05

💡 一句话要点

提出基于同态加密和Byzantine过滤的联邦学习方法,增强隐私性和鲁棒性

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 联邦学习 Byzantine容错 同态加密 隐私保护 元分类器 属性推理 安全聚合

📋 核心要点

- 现有联邦学习方法在安全聚合和Byzantine容错方面存在不足,通常独立解决,难以兼顾隐私和鲁棒性。

- 该论文提出一种结合同态加密和属性推理启发的元分类器的方法,实现隐私保护的聚合和Byzantine过滤。

- 实验结果表明,该方法在多个数据集上有效识别Byzantine更新,准确率达到90%-94%,同时保持模型效用。

📝 摘要(中文)

联邦学习(FL)旨在保护数据隐私的同时训练协作模型。然而,这种方法的分布式特性仍然引发隐私和安全问题,例如由于推理攻击暴露敏感数据以及Byzantine行为对训练模型的影响。特别地,实现安全聚合和Byzantine容错仍然具有挑战性,因为现有的解决方案通常独立地解决这些方面。在这项工作中,我们提出了一种新颖的方法来应对这些挑战,该方法结合了用于隐私保护聚合的同态加密和用于Byzantine过滤的属性推理启发的元分类器。首先,遵循属性推理攻击蓝图,我们在标记的影子更新上训练一组过滤元分类器,重现FL中各种Byzantine恶意行为,包括后门、梯度反转、标签翻转和洗牌攻击。然后,这些元分类器的输出用于通过重新加权来消除Byzantine加密更新。其次,我们提出了一种自动方法,用于选择关于同态推理、聚合约束和CKKS密码系统效率的最佳内核和维度超参数。最后,我们通过广泛的实验证明了我们的方法对FEMNIST、CIFAR10、GTSRB和acsincome基准测试中Byzantine参与者的有效性。更准确地说,我们的SVM过滤在识别Byzantine更新方面实现了90%到94%的准确率,但模型效用略有损失,加密推理运行时间为6到24秒,整体聚合运行时间为9到26秒。

🔬 方法详解

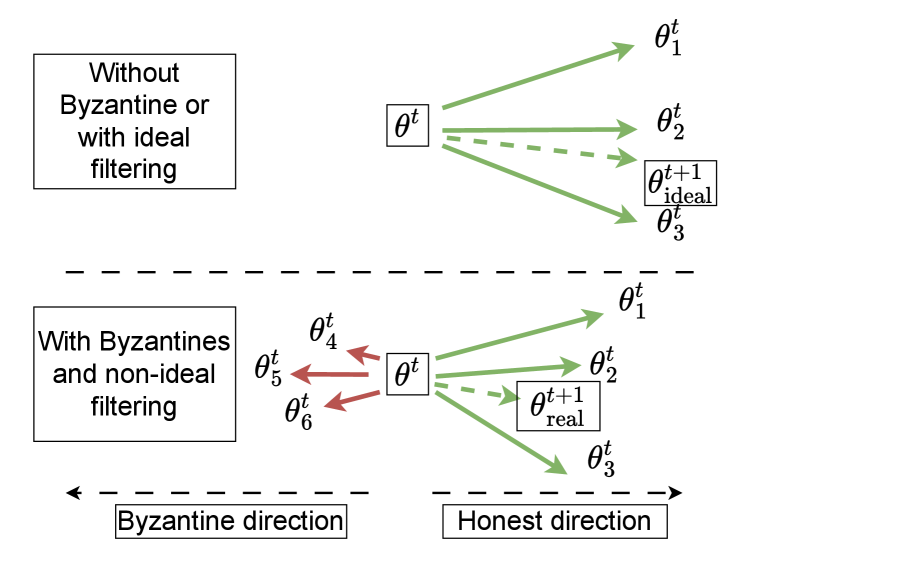

问题定义:联邦学习面临Byzantine攻击的威胁,恶意参与者可能通过发送恶意更新来破坏全局模型。现有的防御方法通常无法同时保证隐私性和鲁棒性,或者计算开销过大,难以实际应用。因此,如何在保护用户隐私的前提下,有效地防御Byzantine攻击,是本论文要解决的核心问题。

核心思路:论文的核心思路是利用同态加密技术保护用户更新的隐私,并使用属性推理启发的元分类器来识别和过滤Byzantine更新。通过在加密域进行聚合,可以防止服务器直接访问用户的原始更新。而元分类器则通过学习Byzantine攻击的特征,从而能够有效地识别和消除恶意更新的影响。

技术框架:该方法主要包含以下几个阶段:1) 本地更新加密:参与者使用同态加密算法(如CKKS)加密本地模型更新。2) 安全聚合:服务器在加密域聚合所有参与者的更新。3) Byzantine过滤:使用预先训练的元分类器识别并过滤Byzantine更新。4) 模型更新:服务器使用过滤后的聚合更新全局模型。5) 超参数优化:自动选择最优的核函数和维度超参数,以适应同态加密的约束和效率要求。

关键创新:该方法的关键创新在于将属性推理攻击的思想应用于Byzantine过滤。通过模拟各种Byzantine攻击,训练元分类器来学习恶意更新的特征,从而能够有效地识别和过滤这些更新。此外,该方法还提出了一种自动超参数优化方法,以适应同态加密的约束和效率要求。

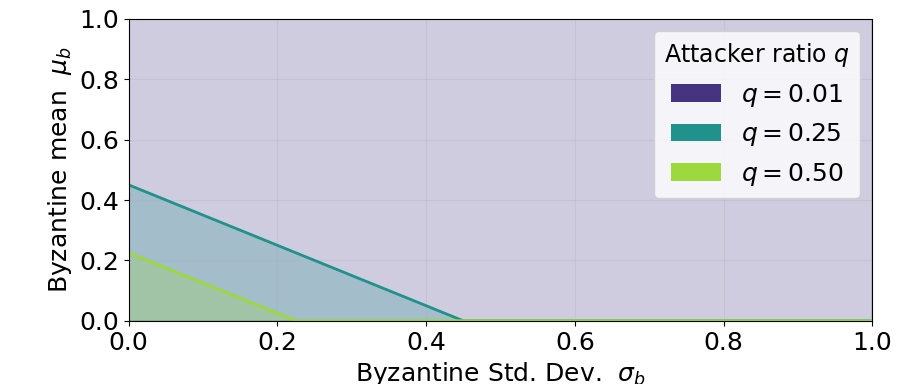

关键设计:元分类器使用SVM,并采用RBF核。超参数的选择通过自动化方法进行,考虑了同态加密的计算开销和精度要求。损失函数的设计旨在平衡模型的准确性和鲁棒性,同时考虑隐私保护的需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在FEMNIST、CIFAR10、GTSRB和acsincome等数据集上,能够以90%-94%的准确率识别Byzantine更新,且对模型效用的影响较小。加密推理时间在6到24秒之间,整体聚合时间在9到26秒之间。与现有方法相比,该方法在隐私保护和鲁棒性方面取得了更好的平衡。

🎯 应用场景

该研究成果可应用于各种联邦学习场景,尤其是在数据敏感性高、容易受到恶意攻击的环境中,例如金融、医疗等领域。通过提高联邦学习的隐私性和鲁棒性,可以促进更多机构参与到联邦学习中,从而构建更强大的AI模型,并为用户提供更优质的服务。

📄 摘要(原文)

Federated Learning (FL) aims to train a collaborative model while preserving data privacy. However, the distributed nature of this approach still raises privacy and security issues, such as the exposure of sensitive data due to inference attacks and the influence of Byzantine behaviors on the trained model. In particular, achieving both secure aggregation and Byzantine resilience remains challenging, as existing solutions often address these aspects independently. In this work, we propose to address these challenges through a novel approach that combines homomorphic encryption for privacy-preserving aggregation with property-inference-inspired meta-classifiers for Byzantine filtering. First, following the property-inference attacks blueprint, we train a set of filtering meta-classifiers on labeled shadow updates, reproducing a diverse ensemble of Byzantine misbehaviors in FL, including backdoor, gradient-inversion, label-flipping and shuffling attacks. The outputs of these meta-classifiers are then used to cancel the Byzantine encrypted updates by reweighting. Second, we propose an automated method for selecting the optimal kernel and the dimensionality hyperparameters with respect to homomorphic inference, aggregation constraints and efficiency over the CKKS cryptosystem. Finally, we demonstrate through extensive experiments the effectiveness of our approach against Byzantine participants on the FEMNIST, CIFAR10, GTSRB, and acsincome benchmarks. More precisely, our SVM filtering achieves accuracies between $90$% and $94$% for identifying Byzantine updates at the cost of marginal losses in model utility and encrypted inference runtimes ranging from $6$ to $24$ seconds and from $9$ to $26$ seconds for an overall aggregation.