Formal Synthesis of Certifiably Robust Neural Lyapunov-Barrier Certificates

作者: Chengxiao Wang, Haoze Wu, Gagandeep Singh

分类: cs.LG, cs.AI, cs.RO, eess.SY

发布日期: 2026-02-05

💡 一句话要点

提出鲁棒神经Lyapunov-障碍证书以解决动态不确定性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 鲁棒性 神经网络 Lyapunov理论 障碍证书 深度强化学习 动态系统 对抗训练

📋 核心要点

- 现有方法仅在固定理想的无扰动动态下提供安全性和稳定性的保证,无法应对实际应用中的动态不确定性。

- 本文提出了一种鲁棒神经Lyapunov障碍证书的合成方法,通过定义鲁棒Lyapunov障碍函数并利用Lipschitz连续性确保其在扰动下的可靠性。

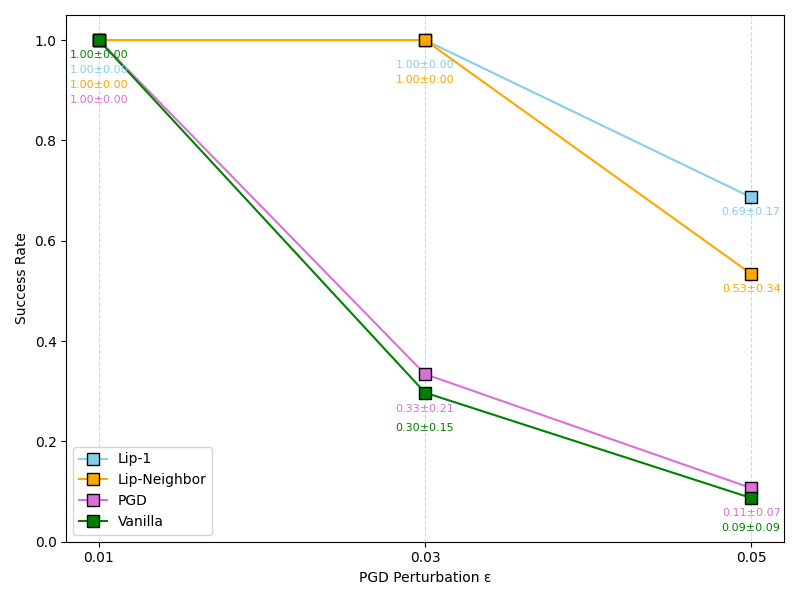

- 实验结果表明,所提方法在认证鲁棒性界限上提高了最多4.6倍,在强扰动下的经验成功率上提高了最多2.4倍,显示出其有效性。

📝 摘要(中文)

神经Lyapunov和障碍证书最近被用作验证深度强化学习控制器安全性和稳定性的强大工具。然而,现有方法仅在固定理想的无扰动动态下提供保证,限制了其在实际应用中的可靠性。本文研究了合成鲁棒神经Lyapunov障碍证书的问题,确保在系统动态受到扰动时仍能保持其保证。我们正式定义了鲁棒Lyapunov障碍函数,并基于Lipschitz连续性指定了确保对有界扰动鲁棒性的充分条件。通过对抗训练、Lipschitz邻域界限和全局Lipschitz正则化,我们提出了实用的训练目标。我们在两个实际相关的环境中验证了我们的方法,结果显示我们的技术显著提高了认证鲁棒性界限和在强扰动下的经验成功率。

🔬 方法详解

问题定义:本文旨在解决现有神经Lyapunov和障碍证书在动态不确定性下的鲁棒性问题。现有方法仅在理想条件下有效,无法适应实际应用中的扰动。

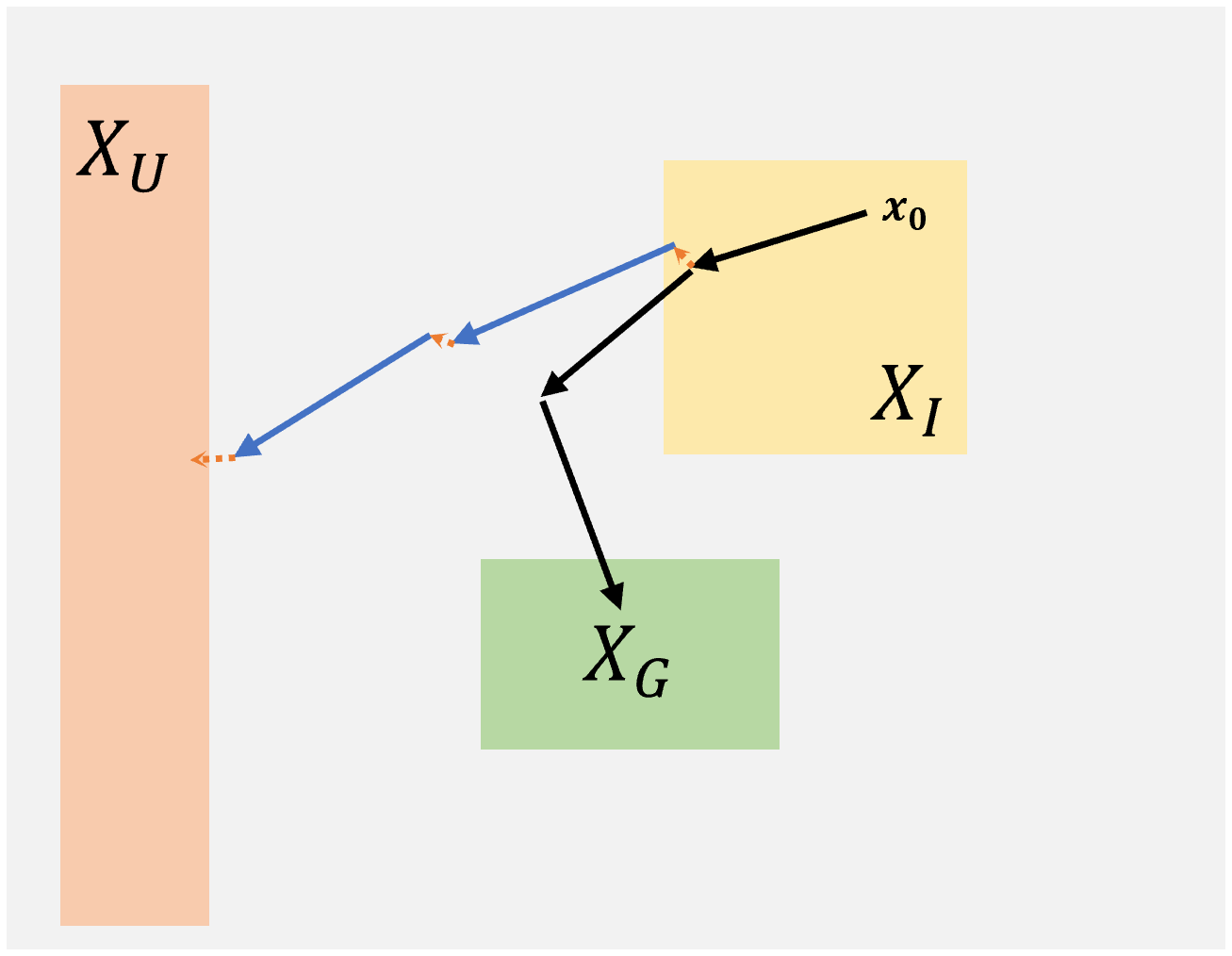

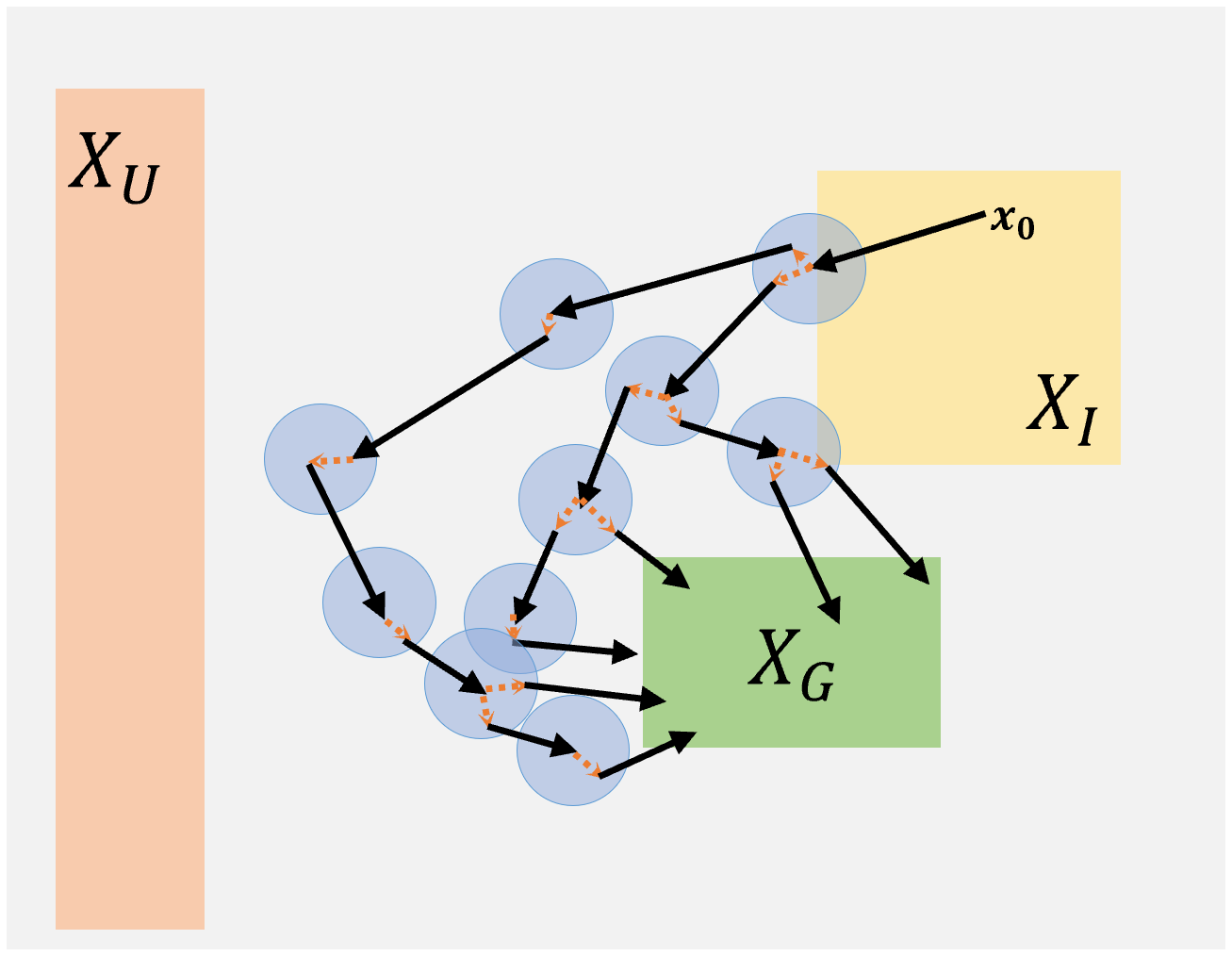

核心思路:我们提出了一种新的鲁棒Lyapunov障碍函数定义,并通过Lipschitz连续性确保其在系统动态受到扰动时仍然有效。通过设计相应的训练目标,使得模型在对抗训练中能够学习到鲁棒性。

技术框架:整体方法包括鲁棒Lyapunov障碍函数的定义、Lipschitz连续性条件的指定、以及通过对抗训练和正则化来实现鲁棒性的训练目标。主要模块包括模型训练、鲁棒性验证和性能评估。

关键创新:最重要的创新在于提出了鲁棒Lyapunov障碍函数的正式定义,并基于Lipschitz连续性设计了确保鲁棒性的训练目标。这一方法与现有方法的本质区别在于其能够处理动态扰动。

关键设计:在训练过程中,我们使用了对抗训练策略、Lipschitz邻域界限和全局Lipschitz正则化等技术细节,以确保模型在面对扰动时的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,所提方法在认证鲁棒性界限上提高了最多4.6倍,在强扰动下的经验成功率上提高了最多2.4倍,显著优于基线方法,验证了鲁棒神经证书在安全强化学习中的有效性。

🎯 应用场景

该研究的潜在应用领域包括自动驾驶、机器人控制和其他安全关键的自动化系统。通过提高控制器在动态不确定性下的鲁棒性,能够显著提升系统的安全性和可靠性,具有重要的实际价值和未来影响。

📄 摘要(原文)

Neural Lyapunov and barrier certificates have recently been used as powerful tools for verifying the safety and stability properties of deep reinforcement learning (RL) controllers. However, existing methods offer guarantees only under fixed ideal unperturbed dynamics, limiting their reliability in real-world applications where dynamics may deviate due to uncertainties. In this work, we study the problem of synthesizing \emph{robust neural Lyapunov barrier certificates} that maintain their guarantees under perturbations in system dynamics. We formally define a robust Lyapunov barrier function and specify sufficient conditions based on Lipschitz continuity that ensure robustness against bounded perturbations. We propose practical training objectives that enforce these conditions via adversarial training, Lipschitz neighborhood bound, and global Lipschitz regularization. We validate our approach in two practically relevant environments, Inverted Pendulum and 2D Docking. The former is a widely studied benchmark, while the latter is a safety-critical task in autonomous systems. We show that our methods significantly improve both certified robustness bounds (up to $4.6$ times) and empirical success rates under strong perturbations (up to $2.4$ times) compared to the baseline. Our results demonstrate effectiveness of training robust neural certificates for safe RL under perturbations in dynamics.