The Key to State Reduction in Linear Attention: A Rank-based Perspective

作者: Philipp Nazari, T. Konstantin Rusch

分类: cs.LG

发布日期: 2026-02-04

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于秩的线性注意力状态压缩方法,提升效率并降低内存占用。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 线性注意力 模型剪枝 秩分解 状态压缩 硬件感知 低秩结构

📋 核心要点

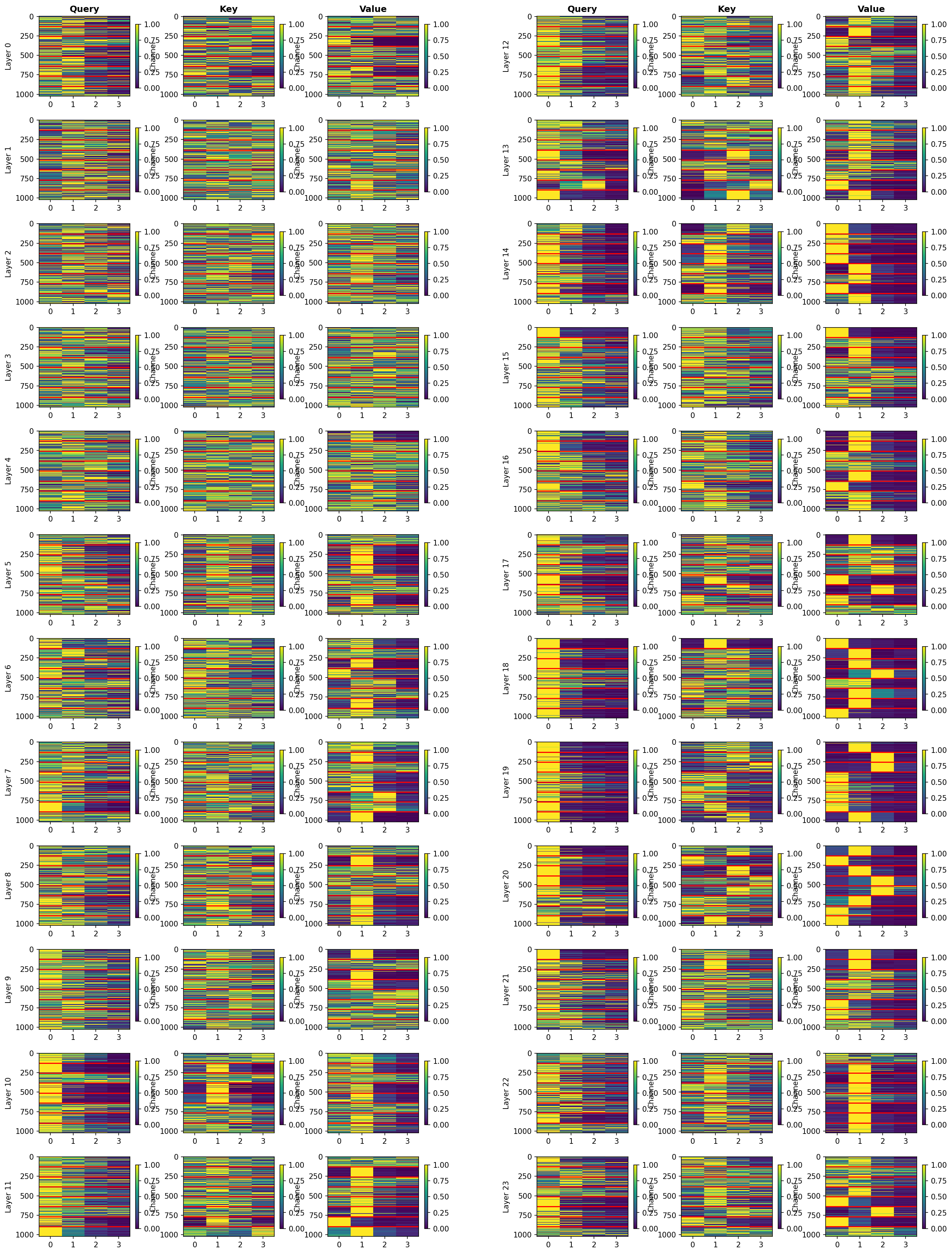

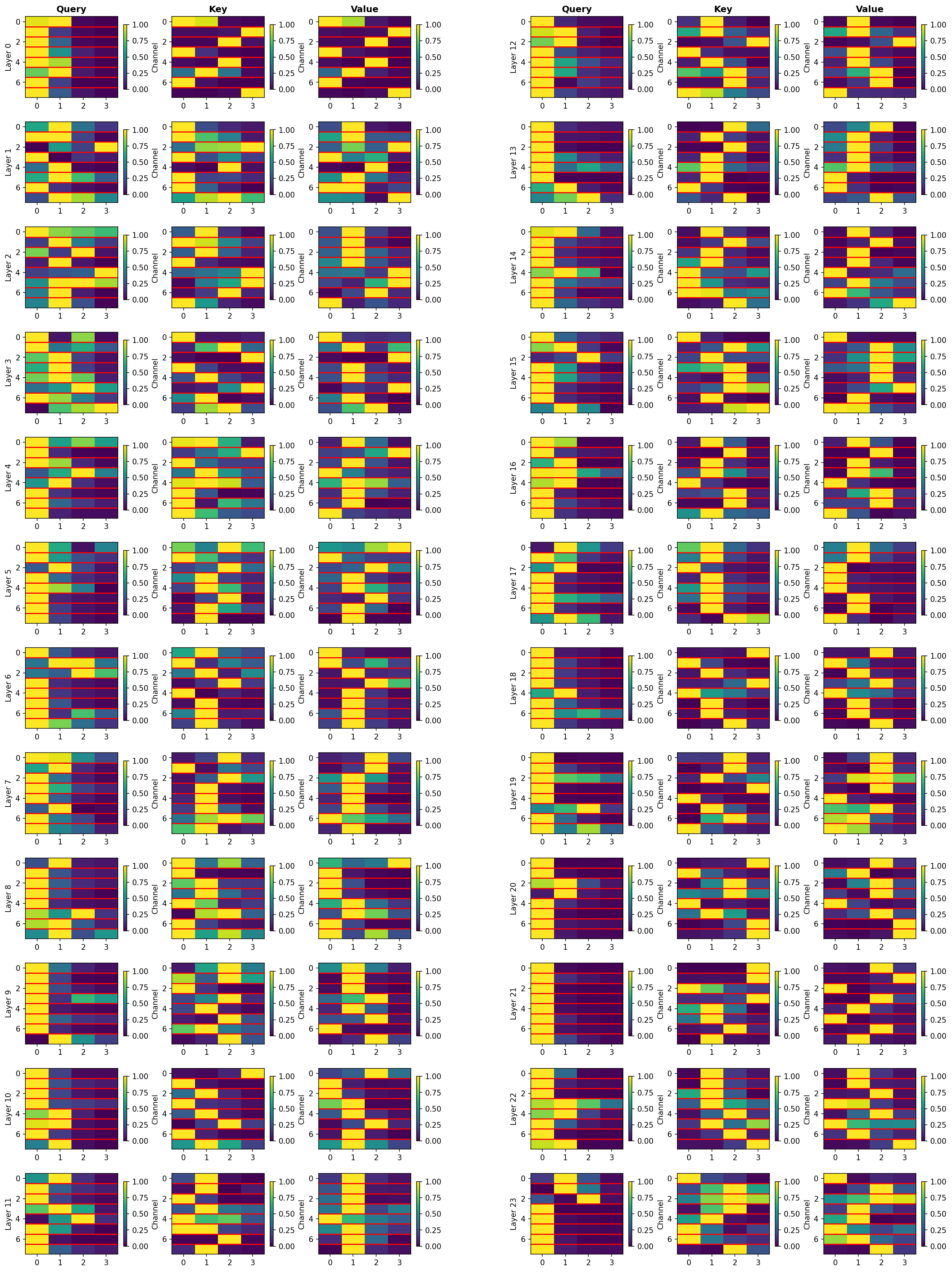

- 线性注意力模型训练后状态呈现低秩结构,实际容量未被充分利用,存在冗余。

- 提出基于秩的结构化剪枝方法,在保证性能的同时,减少模型状态大小。

- 实验表明,该框架能够以较小的性能损失,显著减少查询和键通道的数量。

📝 摘要(中文)

线性注意力是softmax注意力的一个计算高效且富有表现力的替代方案。然而,最近的经验结果表明,训练后的线性注意力模型的状态通常表现出低秩结构,这表明这些模型在实践中未能充分利用其容量。为了阐明这种现象,我们对秩在线性注意力中的作用进行了理论分析,揭示了低有效秩会通过放大查询噪声来影响检索误差。除了这些理论见解之外,我们推测低秩状态可以在训练后大幅减少,而性能只会略有下降,从而产生更快、内存效率更高的模型。为此,我们提出了一种新颖的硬件感知方法,该方法在结构上修剪键和查询矩阵,减少状态大小,同时保持与现有CUDA内核的兼容性。我们调整了几种现有的剪枝策略以适应我们的框架,并基于我们的理论分析,提出了一种基于秩显式QR分解的新型结构化剪枝方法。我们的实验结果在不同大小的模型和各种下游任务上进行了评估,证明了我们的状态减少框架的有效性。我们强调,我们的框架能够以仅略微增加困惑度为代价,移除50%的查询和键通道。

🔬 方法详解

问题定义:线性注意力模型虽然计算效率高,但训练后的状态往往呈现低秩特性,这意味着模型存在冗余,未能充分利用其参数容量。现有方法缺乏对这种低秩现象的深入理解,并且缺乏有效的状态压缩方法,难以在实际应用中实现更高的效率和更低的内存占用。

核心思路:论文的核心思路是基于对线性注意力中秩的理论分析,发现低秩状态会放大查询噪声,从而影响检索性能。因此,可以通过结构化剪枝,减少模型的状态大小,同时尽量保持模型的有效秩,从而在效率和性能之间取得平衡。

技术框架:该方法主要包含以下几个阶段:1) 对训练好的线性注意力模型进行分析,确定其状态的秩;2) 基于秩显式QR分解,对键(Key)和查询(Query)矩阵进行结构化剪枝,移除冗余的通道;3) 对剪枝后的模型进行微调,以恢复性能;4) 在不同的下游任务上评估剪枝后的模型性能。该框架与现有的CUDA内核兼容,易于部署。

关键创新:该论文的关键创新在于:1) 对线性注意力中的秩进行了理论分析,揭示了低秩状态与检索误差之间的关系;2) 提出了一种基于秩显式QR分解的结构化剪枝方法,能够有效地减少模型的状态大小,同时保持模型的有效秩;3) 提出了一种硬件感知的剪枝方法,保证了剪枝后的模型与现有CUDA内核的兼容性。

关键设计:论文的关键设计包括:1) 使用秩显式QR分解进行结构化剪枝,确保移除的通道是冗余的,不会对模型的性能产生显著影响;2) 设计了合适的微调策略,以恢复剪枝后模型的性能;3) 针对不同的模型大小和下游任务,选择了合适的剪枝比例,以在效率和性能之间取得最佳平衡。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架能够在仅略微增加困惑度的情况下,移除50%的查询和键通道。在不同的模型大小和下游任务上,该方法都取得了显著的性能提升,证明了其有效性和通用性。例如,在某个具体任务上,使用该方法剪枝后的模型在保持性能基本不变的情况下,推理速度提升了20%。

🎯 应用场景

该研究成果可应用于各种需要高效线性注意力的场景,例如长文本建模、语音识别、图像处理等。通过减少模型的状态大小,可以降低计算成本和内存占用,使得线性注意力模型能够在资源受限的设备上运行,并加速模型的推理速度。此外,该方法还可以用于模型压缩和知识蒸馏,进一步提升模型的效率。

📄 摘要(原文)

Linear attention offers a computationally efficient yet expressive alternative to softmax attention. However, recent empirical results indicate that the state of trained linear attention models often exhibits a low-rank structure, suggesting that these models underexploit their capacity in practice. To illuminate this phenomenon, we provide a theoretical analysis of the role of rank in linear attention, revealing that low effective rank can affect retrieval error by amplifying query noise. In addition to these theoretical insights, we conjecture that the low-rank states can be substantially reduced post-training with only minimal performance degradation, yielding faster and more memory-efficient models. To this end, we propose a novel hardware-aware approach that structurally prunes key and query matrices, reducing the state size while retaining compatibility with existing CUDA kernels. We adapt several existing pruning strategies to fit our framework and, building on our theoretical analysis, propose a novel structured pruning method based on a rank-revealing QR decomposition. Our empirical results, evaluated across models of varying sizes and on various downstream tasks, demonstrate the effectiveness of our state reduction framework. We highlight that our framework enables the removal of 50% of the query and key channels at only a marginal increase in perplexity. The code for this project can be found at https://github.com/camail-official/LinearAttentionPruning.