Dynamical Regimes of Multimodal Diffusion Models

作者: Emil Albrychiewicz, Andrés Franco Valiente, Li-Ching Chen

分类: cs.LG

发布日期: 2026-02-04

备注: 40 pages, 14 figures

💡 一句话要点

提出耦合扩散模型的理论框架,揭示多模态生成的动态机制与时间尺度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 扩散模型 多模态生成 动态相变 耦合系统 时间尺度

📋 核心要点

- 现有扩散模型在多模态生成方面缺乏理论理解,难以解释和控制生成过程。

- 该论文构建了耦合扩散模型的理论框架,通过分析交互时间尺度来解释多模态生成。

- 实验验证了理论预测,并提出了基于时间尺度的耦合调度方法,有望替代启发式调整。

📝 摘要(中文)

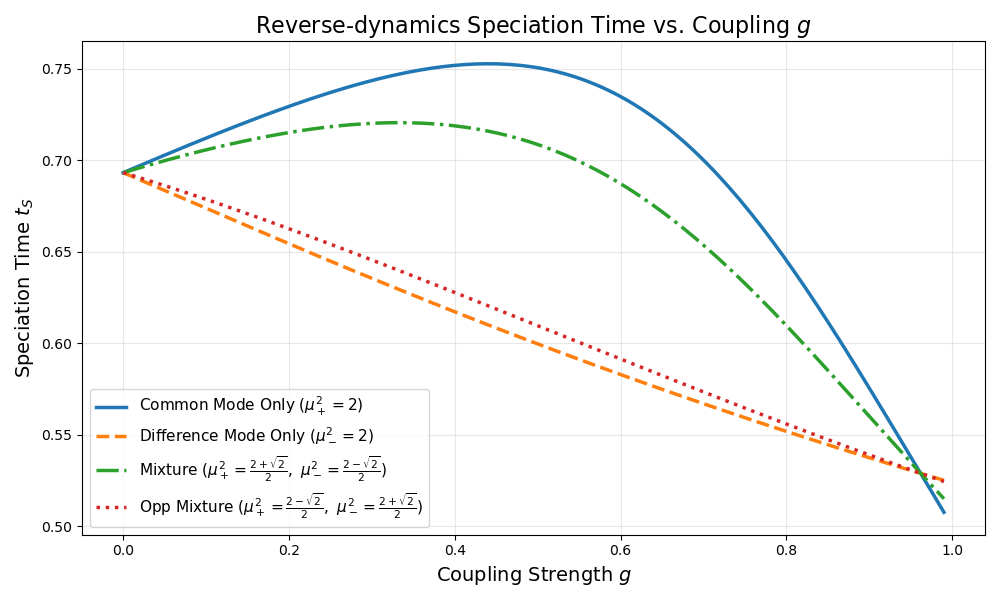

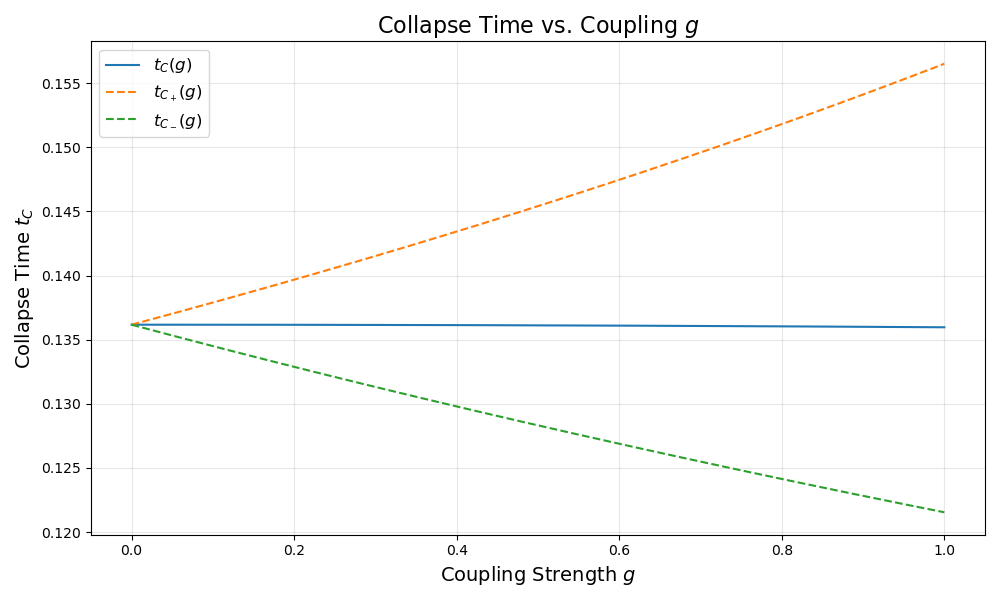

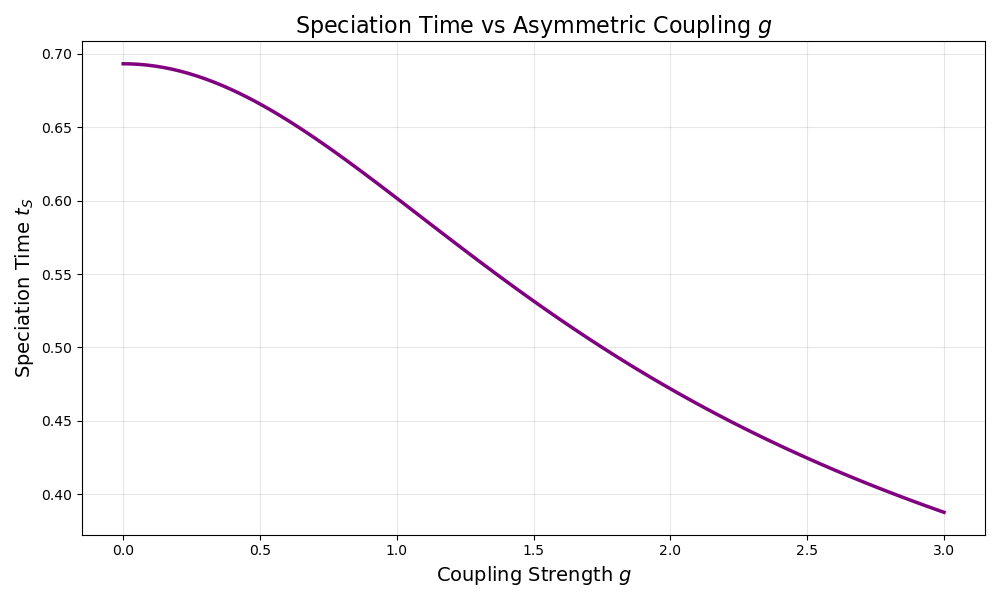

扩散模型在生成高维数据方面取得了前所未有的逼真度,但控制多模态生成的理论机制仍不清楚。本文提出了耦合扩散模型的理论框架,使用耦合的Ornstein-Uhlenbeck过程作为可处理的模型。利用动态相变的非平衡统计物理学,证明了多模态生成是由交互时间尺度的谱层次结构控制,而非同时解决。一个关键预测是“同步间隙”,即反向生成过程中,不同特征模式以不同速率稳定下来的时间窗口,为常见的去同步伪影提供了理论解释。推导了对称和各向异性耦合机制下,物种形成和崩溃时间的解析条件,建立了避免不稳定对称性破缺的耦合强度的严格界限。结果表明,耦合强度充当谱滤波器,对生成施加可调的时间层次结构。通过在MNIST数据集上训练的扩散模型和精确的分数采样器进行受控实验,支持了这些预测。这些结果激发了针对特定模式时间尺度的时变耦合调度,为临时指导调整提供了一种潜在的替代方案。

🔬 方法详解

问题定义:现有扩散模型在生成多模态数据时,缺乏对生成过程背后动态机制的理解。尤其是在控制不同模态的生成顺序和避免模式崩溃等问题上,缺乏有效的理论指导,通常依赖于启发式的调整方法。

核心思路:论文的核心思路是将耦合扩散模型视为一个动态系统,利用非平衡统计物理中的动态相变理论来分析多模态生成的过程。通过研究不同模态之间交互的时间尺度,揭示多模态生成是由一个谱层次结构控制的,而非简单的同步生成。

技术框架:该论文使用耦合的Ornstein-Uhlenbeck过程作为耦合扩散模型的可处理模型。整体框架包括:1)建立耦合扩散模型的数学描述;2)利用动态相变理论分析模型的动态行为;3)推导物种形成和崩溃时间的解析条件;4)设计实验验证理论预测。

关键创新:该论文最重要的创新点在于:1)提出了“同步间隙”的概念,解释了不同模态稳定速率的差异,为去同步伪影提供了理论解释;2)揭示了耦合强度作为谱滤波器的作用,可以控制生成的时间层次结构;3)提出了基于时间尺度的耦合调度方法,为多模态生成提供了一种新的控制策略。

关键设计:论文推导了对称和各向异性耦合机制下物种形成和崩溃时间的解析条件,这些条件可以作为耦合强度的设计依据,避免不稳定的对称性破缺。此外,论文还设计了时变耦合调度,根据不同模态的时间尺度动态调整耦合强度,以实现更精细的生成控制。

🖼️ 关键图片

📊 实验亮点

论文通过在MNIST数据集上训练的扩散模型和精确的分数采样器进行了受控实验,验证了理论预测。实验结果表明,耦合强度可以作为谱滤波器,控制生成的时间层次结构。此外,论文提出的基于时间尺度的耦合调度方法,为多模态生成提供了一种新的控制策略,有望替代启发式调整。

🎯 应用场景

该研究成果可应用于图像生成、语音合成、文本生成等多个领域,尤其是在需要生成具有多个不同模态的数据时,例如生成包含多个物体的图像、具有多种情感的语音等。通过控制不同模态的生成顺序和时间尺度,可以提高生成结果的多样性和可控性,并避免模式崩溃等问题。未来,该研究有望推动多模态生成技术的发展,并为相关应用提供更强大的支持。

📄 摘要(原文)

Diffusion based generative models have achieved unprecedented fidelity in synthesizing high dimensional data, yet the theoretical mechanisms governing multimodal generation remain poorly understood. Here, we present a theoretical framework for coupled diffusion models, using coupled Ornstein-Uhlenbeck processes as a tractable model. By using the nonequilibrium statistical physics of dynamical phase transitions, we demonstrate that multimodal generation is governed by a spectral hierarchy of interaction timescales rather than simultaneous resolution. A key prediction is the ``synchronization gap'', a temporal window during the reverse generative process where distinct eigenmodes stabilize at different rates, providing a theoretical explanation for common desynchronization artifacts. We derive analytical conditions for speciation and collapse times under both symmetric and anisotropic coupling regimes, establishing strict bounds for coupling strength to avoid unstable symmetry breaking. We show that the coupling strength acts as a spectral filter that enforces a tunable temporal hierarchy on generation. We support these predictions through controlled experiments with diffusion models trained on MNIST datasets and exact score samplers. These results motivate time dependent coupling schedules that target mode specific timescales, offering a potential alternative to ad hoc guidance tuning.