Active Asymmetric Multi-Agent Multimodal Learning under Uncertainty

作者: Rui Liu, Pratap Tokekar, Ming Lin

分类: cs.LG, cs.AI

发布日期: 2026-02-04

💡 一句话要点

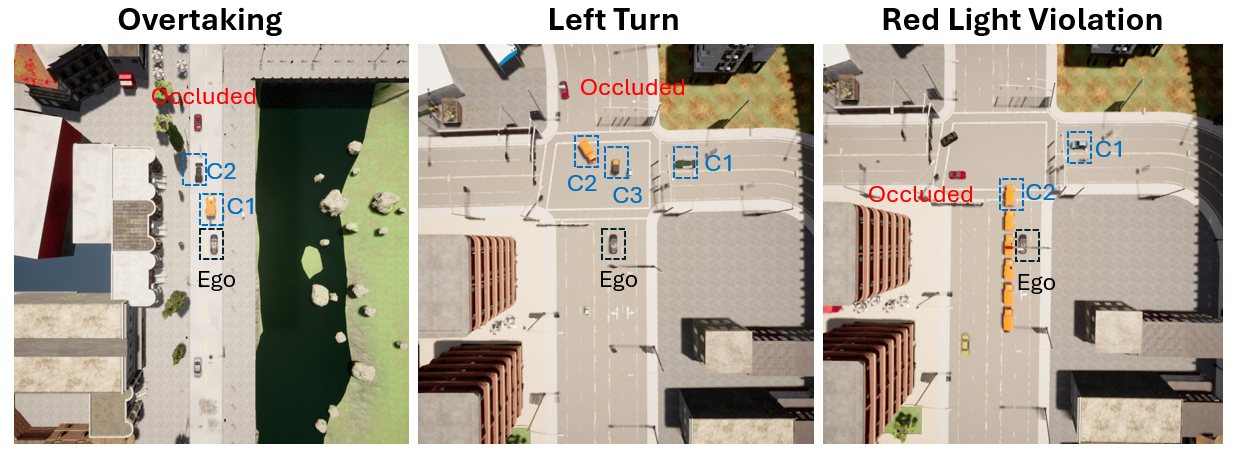

提出A2MAML,解决多智能体异构多模态感知中的不确定性问题,提升事故检测率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 多模态学习 不确定性建模 主动选择 贝叶斯融合 自动驾驶 事故检测

📋 核心要点

- 现有方法通常在智能体层面进行推理,假设同质传感,并隐式处理不确定性,导致传感器损坏时鲁棒性不足。

- A2MAML的核心思想是以模态级别建模不确定性,主动选择可靠的智能体-模态对,并使用贝叶斯方法融合信息。

- 实验表明,A2MAML在互联自动驾驶事故检测中优于现有方法,事故检测率提升高达18.7%。

📝 摘要(中文)

本文提出了一种在不确定性下进行主动非对称多智能体多模态学习的方法(A2MAML),旨在解决多智能体系统中异构多模态传感器带来的模态特定和智能体依赖的不确定性问题。A2MAML将每个模态特定的特征建模为具有不确定性预测的随机估计,主动选择可靠的智能体-模态对,并通过贝叶斯逆方差加权聚合信息。这种方法实现了细粒度的模态级融合,支持非对称的模态可用性,并提供了一种抑制损坏或噪声模态的有效机制。在互联自动驾驶场景中进行协作事故检测的大量实验表明,A2MAML始终优于单智能体和协作基线,事故检测率提高了高达18.7%。

🔬 方法详解

问题定义:论文旨在解决多智能体系统中,由于异构多模态传感器引入的模态特定和智能体依赖的不确定性问题。现有方法通常假设传感器同质,并且在智能体层面进行推理,无法有效处理传感器损坏或噪声带来的影响,导致系统鲁棒性较差。

核心思路:论文的核心思路是以模态级别建模不确定性,而不是在智能体层面进行统一处理。通过预测每个模态特征的不确定性,可以主动选择可靠的智能体-模态对进行信息融合,从而抑制噪声或损坏的模态的影响。这种方法能够更精细地利用多模态信息,提高系统的鲁棒性。

技术框架:A2MAML包含以下主要模块:1) 模态特征提取与不确定性预测:对每个智能体的每个模态提取特征,并预测该特征的不确定性;2) 主动选择:根据预测的不确定性,选择可靠的智能体-模态对;3) 信息融合:使用贝叶斯逆方差加权方法,将选择的智能体-模态对的信息进行融合。

关键创新:A2MAML的关键创新在于其模态级别的建模和主动选择机制。与现有方法相比,A2MAML能够更精细地处理多模态信息,并根据不确定性动态地调整信息融合的权重。这种方法能够有效抑制噪声或损坏的模态的影响,提高系统的鲁棒性。

关键设计:论文使用贝叶斯逆方差加权方法进行信息融合,其中每个模态的权重与其不确定性的倒数成正比。具体来说,假设每个模态的特征服从高斯分布,其均值为预测的特征值,方差为预测的不确定性。然后,使用贝叶斯法则将这些高斯分布进行融合,得到最终的融合结果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,A2MAML在互联自动驾驶场景中的协作事故检测任务中,始终优于单智能体和协作基线方法。具体来说,A2MAML的事故检测率比最佳基线方法提高了高达18.7%,证明了其在处理多模态不确定性方面的有效性。

🎯 应用场景

A2MAML适用于各种需要多智能体协作和多模态感知的场景,例如自动驾驶、机器人协同、智能交通等。通过有效处理多模态数据中的不确定性,A2MAML可以提高系统的鲁棒性和可靠性,从而在复杂环境中实现更安全、更高效的协作。

📄 摘要(原文)

Multi-agent systems are increasingly equipped with heterogeneous multimodal sensors, enabling richer perception but introducing modality-specific and agent-dependent uncertainty. Existing multi-agent collaboration frameworks typically reason at the agent level, assume homogeneous sensing, and handle uncertainty implicitly, limiting robustness under sensor corruption. We propose Active Asymmetric Multi-Agent Multimodal Learning under Uncertainty (A2MAML), a principled approach for uncertainty-aware, modality-level collaboration. A2MAML models each modality-specific feature as a stochastic estimate with uncertainty prediction, actively selects reliable agent-modality pairs, and aggregates information via Bayesian inverse-variance weighting. This formulation enables fine-grained, modality-level fusion, supports asymmetric modality availability, and provides a principled mechanism to suppress corrupted or noisy modalities. Extensive experiments on connected autonomous driving scenarios for collaborative accident detection demonstrate that A2MAML consistently outperforms both single-agent and collaborative baselines, achieving up to 18.7% higher accident detection rate.