LoRDO: Distributed Low-Rank Optimization with Infrequent Communication

作者: Andrej Jovanović, Alex Iacob, Mher Safaryan, Ionut-Vlad Modoranu, Lorenzo Sani, William F. Shen, Xinchi Qiu, Dan Alistarh, Nicholas D. Lane

分类: cs.LG, cs.AI

发布日期: 2026-02-04

备注: Preprint; under review

💡 一句话要点

LoRDO:一种低通信频率的分布式低秩优化方法,用于解决大模型训练中的带宽瓶颈。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 分布式训练 低秩优化 通信优化 深度学习 大模型 数据并行 准双曲优化

📋 核心要点

- 现有分布式训练方法受限于互连带宽,优化器状态的内存和通信需求构成瓶颈。

- LoRDO框架结合低秩优化与不频繁同步,通过全秩准双曲更新恢复子空间探索能力。

- 实验表明,LoRDO在降低通信量的同时,保持甚至提升了模型性能,尤其在低内存环境下。

📝 摘要(中文)

通过$ exttt{DDP}$进行基础模型的分布式训练受到互连带宽的限制。虽然不频繁的通信策略降低了同步频率,但优化器状态的内存和通信需求仍然是瓶颈。低秩优化器可以缓解这些限制;然而,在局部更新机制中,worker缺乏计算低秩投影所需的完整批次梯度,这会降低性能。我们提出了$ exttt{LoRDO}$,一个统一低秩优化与不频繁同步的原则性框架。我们首先证明,虽然基于伪梯度的全局投影在理论上更优越,但它们会将优化轨迹永久限制在低秩子空间中。为了恢复子空间探索,我们引入了全秩准双曲更新。在$125$M--$720$M的模型规模下,$ exttt{LoRDO}$在语言建模和下游任务中实现了与低秩$ exttt{DDP}$几乎相同的性能,同时将通信量减少了约$10$倍。最后,我们表明,即使在具有小秩/批量大小的极低内存设置中,$ exttt{LoRDO}$也能进一步提高性能。

🔬 方法详解

问题定义:分布式训练大模型时,数据并行(DDP)受限于节点间的通信带宽。虽然降低通信频率可以缓解这个问题,但优化器状态同步带来的内存和通信开销仍然很大。低秩优化器虽然能减少这些开销,但在局部更新场景下,worker无法获取全局梯度信息,导致低秩投影计算不准确,影响模型性能。

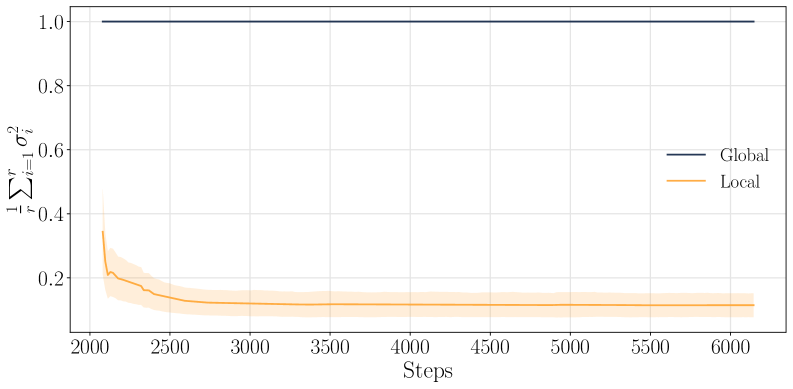

核心思路:论文的核心思路是将低秩优化与不频繁同步相结合,提出LoRDO框架。LoRDO的关键在于,它意识到完全依赖低秩投影会限制模型的探索能力,因此引入了一种全秩准双曲更新机制,以恢复模型在完整参数空间中的探索能力。

技术框架:LoRDO框架主要包含两个阶段:低秩投影阶段和全秩准双曲更新阶段。在低秩投影阶段,worker使用局部梯度计算伪梯度,并进行低秩投影,以减少通信量。在全秩准双曲更新阶段,worker使用全秩梯度进行更新,以恢复模型的探索能力。这两个阶段交替进行,从而在降低通信量的同时,保持模型的性能。

关键创新:LoRDO的关键创新在于提出了全秩准双曲更新机制。与传统的低秩优化方法不同,LoRDO并没有完全依赖低秩投影,而是通过全秩更新来恢复模型的探索能力。这种方法可以有效地解决局部更新场景下,低秩投影计算不准确的问题。

关键设计:LoRDO使用了一种准双曲动量优化器,该优化器可以在不增加额外计算开销的情况下,提高模型的收敛速度。此外,LoRDO还使用了一种自适应学习率调整策略,该策略可以根据模型的训练状态,动态调整学习率,从而提高模型的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LoRDO在125M-720M的模型规模下,在语言建模和下游任务中实现了与低秩DDP几乎相同的性能,同时将通信量减少了约10倍。此外,在极低内存设置下,LoRDO的性能甚至优于其他方法,证明了其在资源受限环境下的优势。

🎯 应用场景

LoRDO适用于大规模分布式机器学习场景,尤其是在资源受限的环境下训练大型模型。该方法可以显著降低通信开销,提高训练效率,并可应用于自然语言处理、计算机视觉等多个领域的基础模型训练,具有重要的实际应用价值和潜力。

📄 摘要(原文)

Distributed training of foundation models via $\texttt{DDP}$ is limited by interconnect bandwidth. While infrequent communication strategies reduce synchronization frequency, they remain bottlenecked by the memory and communication requirements of optimizer states. Low-rank optimizers can alleviate these constraints; however, in the local-update regime, workers lack access to the full-batch gradients required to compute low-rank projections, which degrades performance. We propose $\texttt{LoRDO}$, a principled framework unifying low-rank optimization with infrequent synchronization. We first demonstrate that, while global projections based on pseudo-gradients are theoretically superior, they permanently restrict the optimization trajectory to a low-rank subspace. To restore subspace exploration, we introduce a full-rank quasi-hyperbolic update. $\texttt{LoRDO}$ achieves near-parity with low-rank $\texttt{DDP}$ in language modeling and downstream tasks at model scales of $125$M--$720$M, while reducing communication by $\approx 10 \times$. Finally, we show that $\texttt{LoRDO}$ improves performance even more in very low-memory settings with small rank/batch size.