Disentangling Causal Importance from Emergent Structure in Multi-Expert Orchestration

作者: Sudipto Ghosh, Sujoy Nath, Sunny Manchanda, Tanmoy Chakraborty

分类: cs.LG, cs.AI, cs.MA

发布日期: 2026-02-04

💡 一句话要点

提出INFORM,解耦多专家协同中的因果重要性与涌现结构

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多专家系统 可解释性 因果归因 编排策略 大型语言模型

📋 核心要点

- 多专家系统编排策略不透明,难以理解专家交互和排序机制。

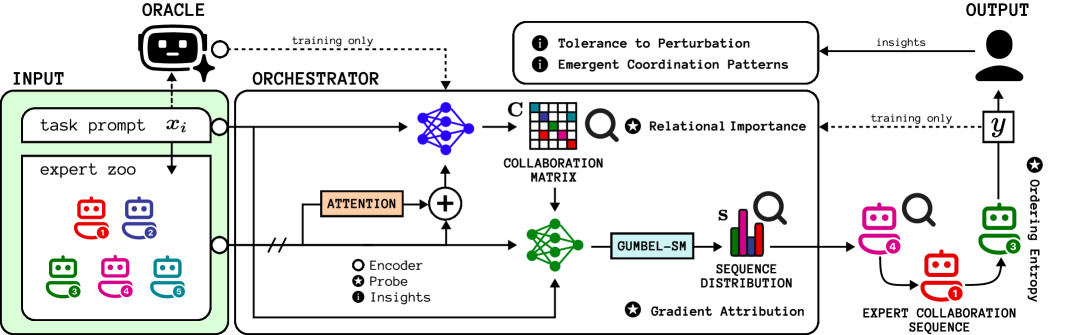

- 提出INFORM框架,将编排视为可分析的计算,解耦专家交互结构、执行顺序和因果归因。

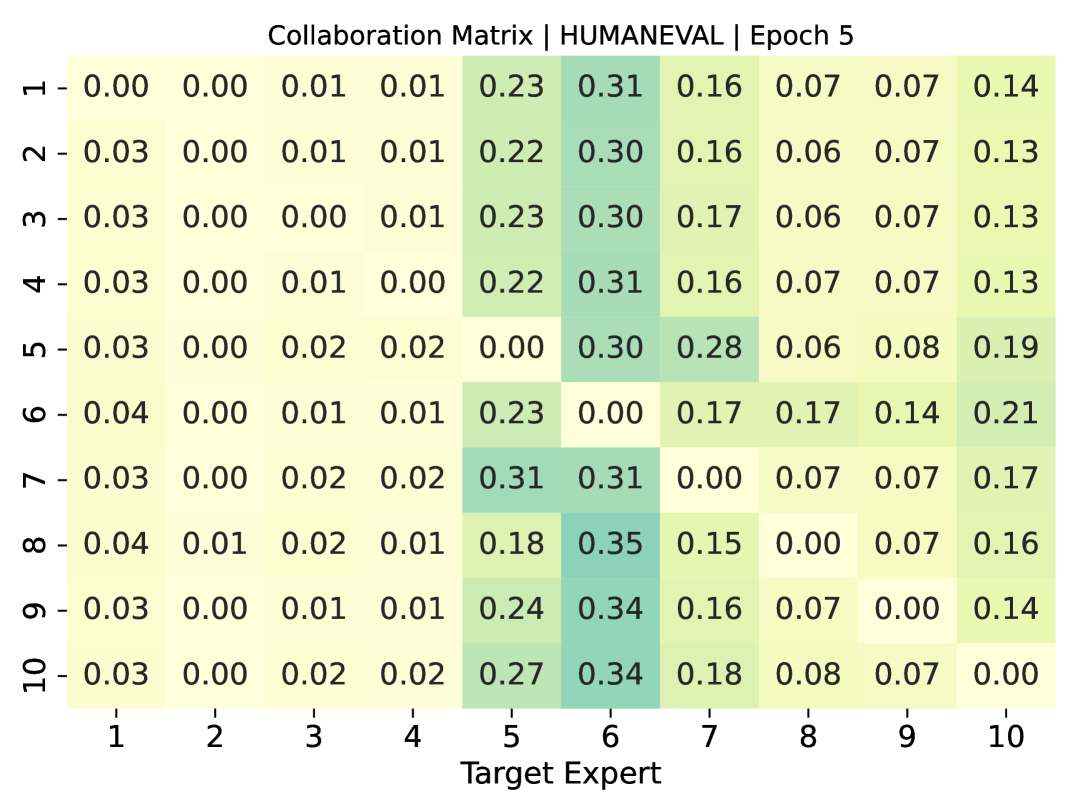

- 实验表明,路由频率高的专家不一定重要,而稀疏路由的专家可能至关重要,INFORM能揭示深层因果依赖。

📝 摘要(中文)

多专家系统,即多个大型语言模型(LLM)协同解决复杂任务,正日益被用于高性能的推理和生成。然而,控制专家交互和排序的编排策略在很大程度上是不透明的。我们引入INFORM,一种可解释性分析方法,它将编排视为一种显式的、可分析的计算,从而能够解耦专家交互结构、执行顺序和因果归因。我们使用INFORM在GSM8K、HumanEval和MMLU上评估一个编排器,该编排器使用来自LLaMA-3.1 8B、Qwen-3 8B和DeepSeek-R1 8B的同构的十个指令调优专家联盟,并控制解码温度的变化,以及一个跨越1B-7B参数模型的异构联盟。结果表明,跨任务的路由主导地位是功能必要性的一个糟糕的代理。我们揭示了关系重要性(由路由质量和交互拓扑捕获)与内在重要性(通过基于梯度的因果归因测量)之间的差异:频繁选择的专家通常充当交互中心,但因果影响有限,而稀疏路由的专家可能在结构上至关重要。编排行为是异步出现的,专家集中化先于稳定的路由置信度,并且专家排序仍然是不确定的。有针对性的消融实验表明,与屏蔽频繁的对等方相比,屏蔽内在重要的专家会导致交互结构的失衡崩溃,证实了INFORM揭示了超出单独的准确性指标的因果和结构依赖性。

🔬 方法详解

问题定义:多专家系统在解决复杂任务时表现出色,但其内部的专家编排策略如同黑盒,难以理解专家之间的交互方式、执行顺序以及每个专家对最终结果的贡献程度。现有方法难以区分专家的表面活跃程度和实际因果影响,导致对系统行为的理解不足。

核心思路:INFORM的核心在于将多专家系统的编排过程显式化,并将其视为一种可分析的计算过程。通过解耦专家交互结构、执行顺序和因果归因,INFORM旨在揭示专家之间的真实依赖关系,区分表面上的重要性和实际的因果影响。这种方法允许研究者深入了解哪些专家在结构上至关重要,即使它们不经常被选择。

技术框架:INFORM框架主要包含以下几个阶段:1) 专家联盟构建:选择或构建一组具有不同能力或知识的专家模型。2) 编排器设计:设计一个编排器,负责根据输入和当前状态选择合适的专家执行任务。3) 执行与交互:编排器根据策略选择专家,专家执行任务并产生输出,专家之间可能存在交互。4) 可解释性分析:使用INFORM分析编排过程,包括路由模式、交互拓扑和因果归因。5) 消融实验:通过有选择地移除或屏蔽某些专家,观察系统性能的变化,验证INFORM的分析结果。

关键创新:INFORM最重要的创新在于其可解释性分析方法,它能够解耦专家交互结构、执行顺序和因果归因。与现有方法不同,INFORM不仅仅关注专家的选择频率或交互拓扑,而是通过梯度分析等技术,深入挖掘专家对最终结果的因果影响。这使得研究者能够识别出那些表面上不活跃但实际上至关重要的专家。

关键设计:INFORM的关键设计包括:1) 梯度分析:使用基于梯度的因果归因方法,量化每个专家对最终输出的因果影响。2) 交互拓扑分析:分析专家之间的交互模式,识别关键的交互中心和桥梁。3) 消融策略:设计有针对性的消融实验,验证INFORM的分析结果,例如,屏蔽因果重要的专家,观察系统性能的下降程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,路由主导地位不能代表功能必要性,频繁选择的专家可能因果影响有限,而稀疏路由的专家可能至关重要。屏蔽因果重要的专家会导致交互结构崩溃,验证了INFORM能揭示超出准确率的因果依赖。该研究在GSM8K、HumanEval和MMLU数据集上进行了验证。

🎯 应用场景

INFORM可应用于各种多智能体系统,例如机器人协同、金融决策、医疗诊断等领域。通过理解系统中各个智能体的角色和贡献,可以优化系统设计,提高系统性能和鲁棒性。此外,INFORM还可用于调试和修复多智能体系统,识别潜在的瓶颈和故障点,并采取相应的措施。

📄 摘要(原文)

Multi-expert systems, where multiple Large Language Models (LLMs) collaborate to solve complex tasks, are increasingly adopted for high-performance reasoning and generation. However, the orchestration policies governing expert interaction and sequencing remain largely opaque. We introduce INFORM, an interpretability analysis that treats orchestration as an explicit, analyzable computation, enabling the decoupling of expert interaction structure, execution order, and causal attribution. We use INFORM to evaluate an orchestrator on GSM8K, HumanEval, and MMLU using a homogeneous consortium of ten instruction-tuned experts drawn from LLaMA-3.1 8B, Qwen-3 8B, and DeepSeek-R1 8B, with controlled decoding-temperature variation, and a secondary heterogeneous consortium spanning 1B-7B parameter models. Across tasks, routing dominance is a poor proxy for functional necessity. We reveal a divergence between relational importance, captured by routing mass and interaction topology, and intrinsic importance, measured via gradient-based causal attribution: frequently selected experts often act as interaction hubs with limited causal influence, while sparsely routed experts can be structurally critical. Orchestration behaviors emerge asynchronously, with expert centralization preceding stable routing confidence and expert ordering remaining non-deterministic. Targeted ablations show that masking intrinsically important experts induces disproportionate collapse in interaction structure compared to masking frequent peers, confirming that INFORM exposes causal and structural dependencies beyond accuracy metrics alone.