Choice-Model-Assisted Q-learning for Delayed-Feedback Revenue Management

作者: Owen Shen, Patrick Jaillet

分类: cs.LG, stat.ML

发布日期: 2026-02-02

💡 一句话要点

提出选择模型辅助Q学习以解决延迟反馈的收益管理问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 收益管理 强化学习 延迟反馈 选择模型 Q学习 动态定价 模型估算

📋 核心要点

- 现有收益管理方法在面对客户取消和修改行为时,常常受到延迟反馈的影响,导致学习目标不准确。

- 论文提出选择模型辅助的强化学习方法,通过使用校准的离散选择模型来估算延迟反馈,提高学习效率。

- 实验结果显示,该方法在静态环境中与基线表现相当,并在某些参数变化下实现了高达12.4%的收益提升。

📝 摘要(中文)

本研究探讨了在收益管理中应用强化学习的方法,特别是面对延迟反馈的情况,其中客户的取消和修改行为会在预订后几天才被观察到。我们提出了选择模型辅助的强化学习方法:利用经过校准的离散选择模型作为固定的部分世界模型,在决策时对学习目标的延迟部分进行估算。在固定模型的部署模式下,我们证明了使用模型估算目标的表格Q学习收敛到最优Q函数的邻域。通过对61,619个酒店预订的模拟实验,我们发现该方法在静态环境中与成熟的DQN基线没有显著差异,并在参数变化下表现出积极效果,但在结构性错误假设下则表现出一致的性能下降。

🔬 方法详解

问题定义:本论文旨在解决在收益管理中由于客户取消和修改行为导致的延迟反馈问题。现有方法在处理这些延迟反馈时,往往无法准确估算学习目标,从而影响决策效果。

核心思路:论文提出的选择模型辅助的强化学习方法,通过引入校准的离散选择模型,作为固定的部分世界模型,在决策时对延迟反馈进行估算,从而提高学习的准确性和效率。

技术框架:整体架构包括三个主要模块:首先是数据收集与模型校准,其次是基于模型的Q学习算法,最后是策略评估与优化。通过这些模块的协同工作,实现了对延迟反馈的有效处理。

关键创新:该研究的主要创新在于将选择模型与Q学习相结合,利用模型估算延迟反馈的目标,显著提高了学习的收敛性和稳定性。这与传统的Q学习方法相比,提供了一种新的思路。

关键设计:在参数设置上,论文采用了固定的部分模型来减少模型误差的影响,并设计了相应的损失函数以优化学习过程。此外,网络结构上采用了标准的Q网络架构,结合了模型输出的目标进行训练。

🖼️ 关键图片

📊 实验亮点

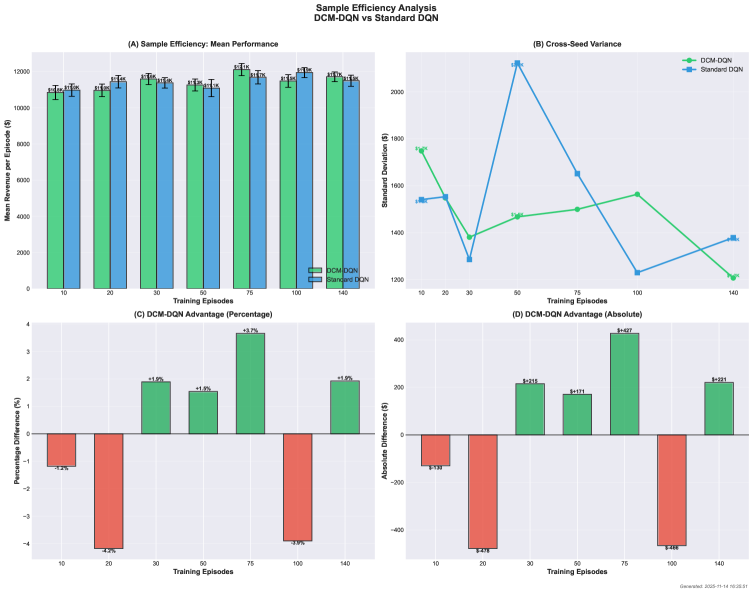

实验结果表明,选择模型辅助的Q学习在静态环境中与成熟的DQN基线没有显著差异,而在参数变化的情况下,取得了高达12.4%的收益提升。相反,在结构性错误假设下,收益下降幅度为1.4%至2.6%,显示出模型的鲁棒性与局限性。

🎯 应用场景

该研究的潜在应用领域包括酒店业、航空公司和其他需要动态定价和收益管理的行业。通过提高收益管理系统的决策效率和准确性,能够显著提升企业的收益水平。此外,该方法的框架也可推广至其他需要处理延迟反馈的强化学习场景,具有广泛的实际价值和未来影响。

📄 摘要(原文)

We study reinforcement learning for revenue management with delayed feedback, where a substantial fraction of value is determined by customer cancellations and modifications observed days after booking. We propose \emph{choice-model-assisted RL}: a calibrated discrete choice model is used as a fixed partial world model to impute the delayed component of the learning target at decision time. In the fixed-model deployment regime, we prove that tabular Q-learning with model-imputed targets converges to an $O(\varepsilon/(1-γ))$ neighborhood of the optimal Q-function, where $\varepsilon$ summarizes partial-model error, with an additional $O(t^{-1/2})$ sampling term. Experiments in a simulator calibrated from 61{,}619 hotel bookings (1{,}088 independent runs) show: (i) no statistically detectable difference from a maturity-buffer DQN baseline in stationary settings; (ii) positive effects under in-family parameter shifts, with significant gains in 5 of 10 shift scenarios after Holm--Bonferroni correction (up to 12.4\%); and (iii) consistent degradation under structural misspecification, where the choice model assumptions are violated (1.4--2.6\% lower revenue). These results characterize when partial behavioral models improve robustness under shift and when they introduce harmful bias.