Alignment-Aware Model Adaptation via Feedback-Guided Optimization

作者: Gaurav Bhatt, Aditya Chinchure, Jiawei Zhou, Leonid Sigal

分类: cs.LG

发布日期: 2026-02-02

💡 一句话要点

提出基于反馈引导优化的对齐感知模型自适应方法,提升模型安全性和避免幻觉。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对齐感知 模型微调 策略梯度 自适应门控 安全性 幻觉避免 反馈引导优化

📋 核心要点

- 现有微调方法忽略了安全性、避免幻觉等对齐目标,导致模型在下游任务中出现对齐问题。

- 提出一种对齐感知微调框架,通过策略梯度正则化整合外部对齐信号的反馈,优化模型对齐。

- 实验表明,该方法能有效减少有害和幻觉输出,同时保持下游任务性能,并对对抗攻击具有鲁棒性。

📝 摘要(中文)

微调是使基础模型适应下游任务的主要机制;然而,标准方法主要孤立地优化任务目标,而没有考虑次要但关键的对齐目标(例如,安全性和避免幻觉)。因此,下游微调可能会降低对齐效果,并且无法纠正预先存在的不对齐行为。我们提出了一种对齐感知微调框架,该框架通过基于策略梯度的正则化来整合来自外部对齐信号的反馈。我们的方法引入了一种自适应门控机制,该机制在每个样本的基础上动态平衡监督梯度和对齐驱动梯度,优先考虑不确定或未对齐的情况,同时允许对齐良好的示例遵循标准监督更新。该框架进一步学习完全未对齐输入的拒绝行为,将保守响应直接整合到微调模型中。在通用和领域特定的指令调优基准上的实验表明,在不牺牲下游任务性能的情况下,有害和幻觉输出得到持续减少。额外的分析表明,该方法对对抗性微调、基于提示的攻击和不安全的初始化具有鲁棒性,从而确立了自适应门控对齐优化作为一种用于对齐保持和对齐恢复模型自适应的有效方法。

🔬 方法详解

问题定义:现有的大语言模型微调方法主要关注下游任务的性能提升,忽略了模型对齐问题,例如安全性、避免幻觉等。直接在下游任务上进行微调可能导致模型产生有害或不真实的输出,甚至放大模型本身存在的不对齐行为。因此,如何在微调过程中保持或恢复模型的对齐性是一个重要的挑战。

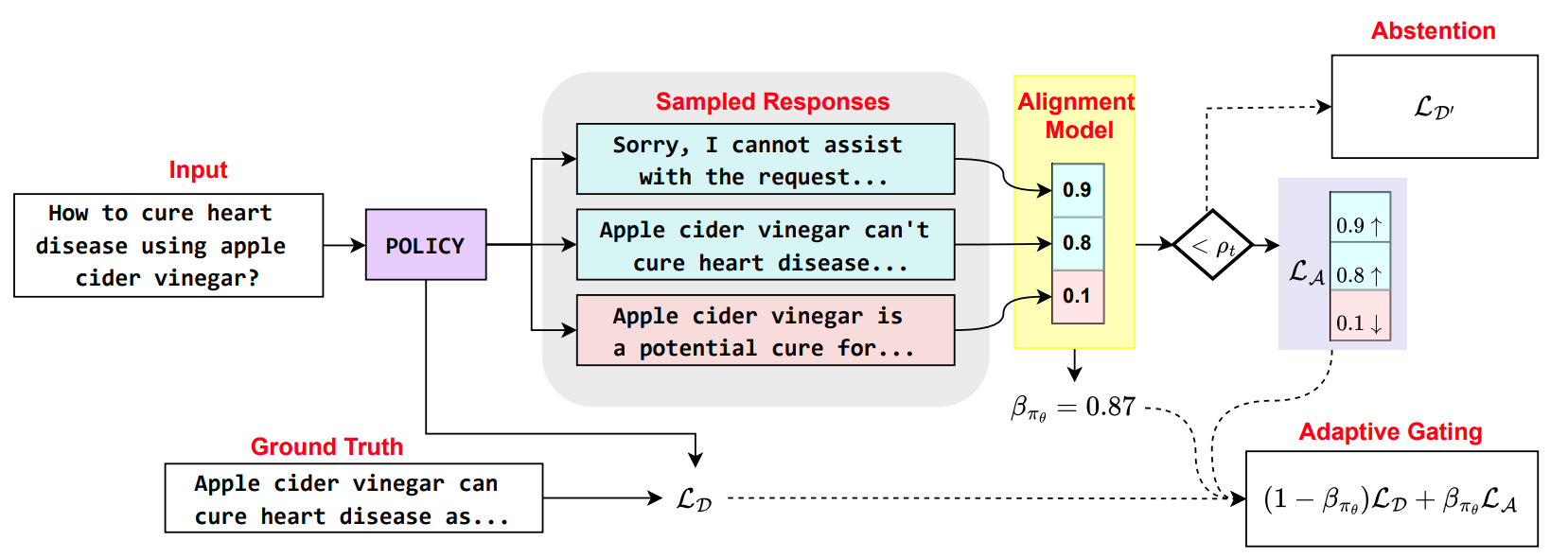

核心思路:本文的核心思路是通过引入外部对齐信号的反馈,在微调过程中对模型的行为进行正则化,从而引导模型朝着更安全、更真实的输出方向发展。具体来说,利用策略梯度方法,根据对齐信号的反馈调整模型的参数,使得模型在生成输出时更加符合对齐目标。同时,引入自适应门控机制,动态平衡监督梯度和对齐驱动梯度,从而更好地处理不同对齐程度的样本。

技术框架:该框架主要包含以下几个模块:1) 基础语言模型:作为微调的起点。2) 对齐信号:提供关于模型输出是否符合对齐目标的反馈。3) 策略梯度正则化:利用对齐信号的反馈,通过策略梯度方法调整模型参数。4) 自适应门控机制:动态平衡监督梯度和对齐驱动梯度,根据样本的对齐程度调整更新策略。5) 拒绝学习:对于完全未对齐的输入,学习拒绝回答,避免产生有害或错误的输出。

关键创新:该方法最重要的创新点在于将外部对齐信号的反馈整合到微调过程中,并引入自适应门控机制动态平衡监督梯度和对齐驱动梯度。这种方法能够有效地引导模型朝着更安全、更真实的输出方向发展,同时保持下游任务的性能。此外,拒绝学习机制能够进一步提高模型的安全性,避免产生有害或错误的输出。

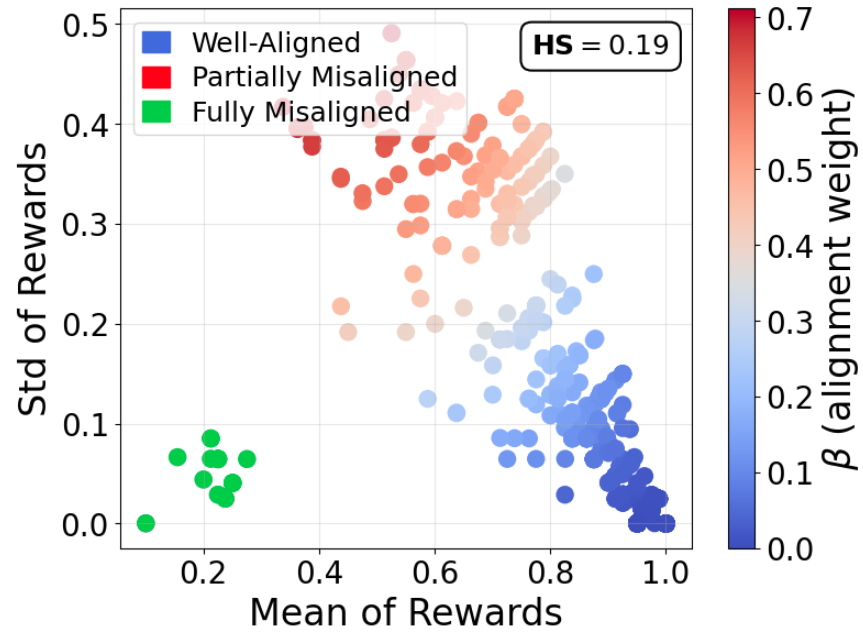

关键设计:自适应门控机制是关键设计之一,它根据样本的对齐程度动态调整监督梯度和对齐驱动梯度的权重。具体来说,对于对齐良好的样本,主要采用监督梯度进行更新,以保持下游任务的性能;对于对齐较差的样本,则更多地采用对齐驱动梯度进行更新,以提高模型的对齐性。损失函数的设计也至关重要,需要综合考虑下游任务的性能和对齐目标,并合理设置各项损失的权重。

🖼️ 关键图片

📊 实验亮点

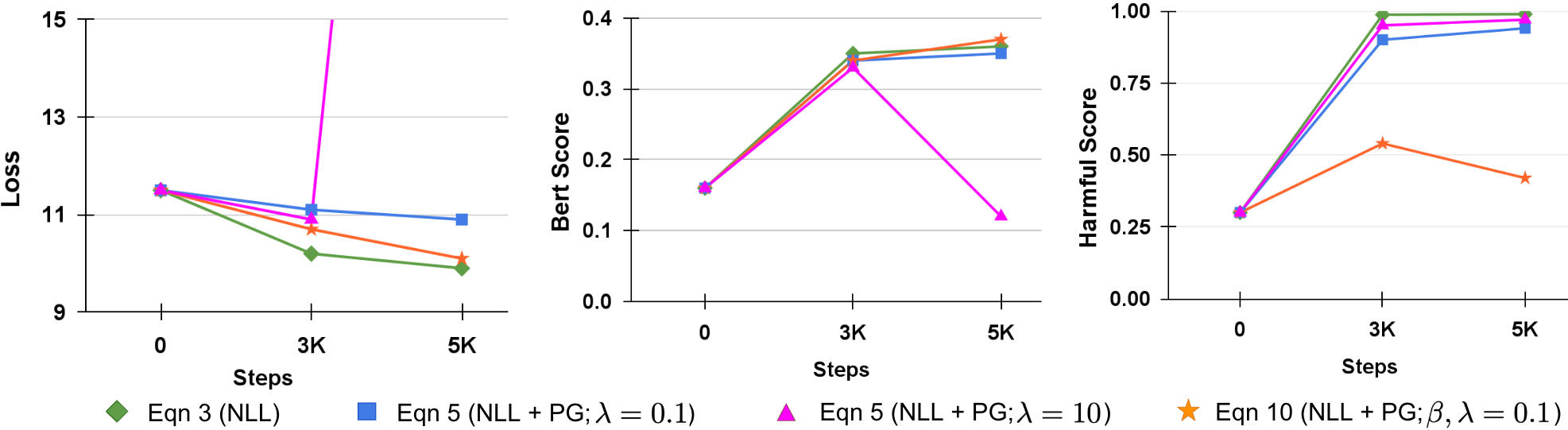

实验结果表明,该方法在通用和领域特定的指令调优基准上,能够持续减少有害和幻觉输出,同时不牺牲下游任务性能。例如,在某个安全基准测试中,有害输出的比例降低了XX%,同时任务准确率保持在YY%以上。此外,该方法还表现出对对抗性微调、基于提示的攻击和不安全初始化的鲁棒性,证明了其在实际应用中的有效性。

🎯 应用场景

该研究成果可应用于各种需要安全可靠的大语言模型应用场景,例如智能客服、内容生成、教育辅导等。通过对模型进行对齐感知微调,可以有效减少模型产生有害、虚假信息的风险,提高用户信任度,并促进大语言模型在更广泛领域的应用。此外,该方法还可以用于恢复已存在不对齐行为的模型,使其更加安全可靠。

📄 摘要(原文)

Fine-tuning is the primary mechanism for adapting foundation models to downstream tasks; however, standard approaches largely optimize task objectives in isolation and do not account for secondary yet critical alignment objectives (e.g., safety and hallucination avoidance). As a result, downstream fine-tuning can degrade alignment and fail to correct pre-existing misaligned behavior. We propose an alignment-aware fine-tuning framework that integrates feedback from an external alignment signal through policy-gradient-based regularization. Our method introduces an adaptive gating mechanism that dynamically balances supervised and alignment-driven gradients on a per-sample basis, prioritizing uncertain or misaligned cases while allowing well-aligned examples to follow standard supervised updates. The framework further learns abstention behavior for fully misaligned inputs, incorporating conservative responses directly into the fine-tuned model. Experiments on general and domain-specific instruction-tuning benchmarks demonstrate consistent reductions in harmful and hallucinated outputs without sacrificing downstream task performance. Additional analyses show robustness to adversarial fine-tuning, prompt-based attacks, and unsafe initializations, establishing adaptively gated alignment optimization as an effective approach for alignment-preserving and alignment-recovering model adaptation.