Two-Stage Grid Optimization for Group-wise Quantization of LLMs

作者: Junhan Kim, Gukryeol Lee, Seungwoo Son, Jeewook Kim, Yongkweon Jeon

分类: cs.LG, cs.AI

发布日期: 2026-02-02

备注: ICASSP 2026

💡 一句话要点

提出双阶段网格优化算法,提升LLM分组量化精度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 量化 分组量化 模型压缩 低比特量化

📋 核心要点

- GPTQ等现有分组量化方法忽略了输入统计和组间相关性,导致量化精度受限。

- 论文提出双阶段优化框架,首先考虑输入统计初始化组尺度,然后细化组尺度最小化层重建损失。

- 实验结果表明,该方法在几乎不增加额外开销的情况下,显著提升了分组量化的精度。

📝 摘要(中文)

分组量化是缓解大语言模型(LLMs)低比特量化精度下降的有效策略。现有方法中,GPTQ因其高效性而被广泛采用;然而,它在确定组尺度时忽略了输入统计和组间相关性,导致与其最小化层重建损失的目标不符。本文提出了一种用于组尺度的双阶段优化框架,该框架显式地最小化层重建损失。在第一阶段(GPTQ之前),我们初始化每个组尺度以最小化组重建损失,从而结合输入统计。在第二阶段,我们冻结通过GPTQ获得的整数权重,并细化组尺度以最小化层重建损失。为此,我们采用坐标下降算法并推导出一个闭式更新规则,从而实现高效的细化,而无需昂贵的数值优化。值得注意的是,我们的推导考虑了前几层的量化误差,以防止误差累积。实验结果表明,我们的方法始终增强了分组量化,以可忽略的开销实现了更高的精度。

🔬 方法详解

问题定义:现有GPTQ等分组量化方法在确定组尺度时,没有充分考虑输入数据的统计特性以及不同组之间的相关性。这导致在低比特量化时,模型精度显著下降,无法有效最小化层级的重建损失。

核心思路:论文的核心思路是通过一个双阶段的优化过程,显式地最小化层级的重建损失。第一阶段利用输入统计信息初始化组尺度,第二阶段在冻结整数权重后,进一步优化组尺度,从而更精确地逼近原始模型的输出。

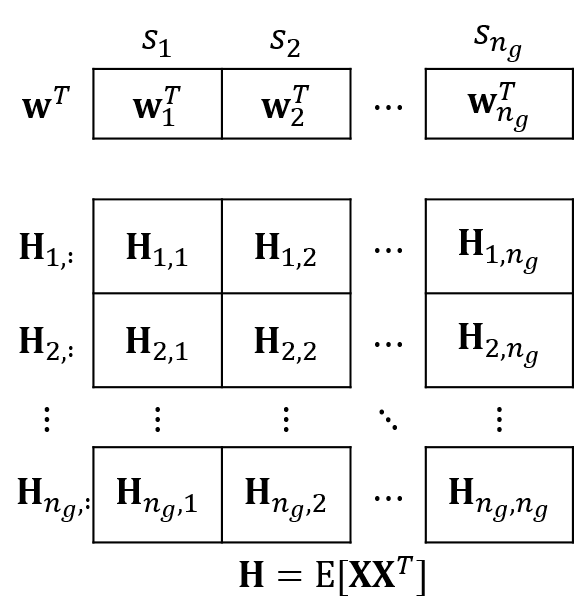

技术框架:该方法包含两个主要阶段:1) 初始化阶段:在GPTQ之前,针对每一组,计算能够最小化该组重建损失的尺度因子,作为初始值。这一步考虑了输入数据的统计特性。2) 优化阶段:在GPTQ之后,冻结量化后的整数权重,然后使用坐标下降算法迭代优化每一组的尺度因子,目标是最小化整个层的重建损失。在优化过程中,考虑了前序层的量化误差,以避免误差累积。

关键创新:该方法的主要创新在于:1) 显式地最小化层级重建损失,而非仅仅关注组内的重建误差。2) 提出了一个闭式解的更新规则,用于高效地优化组尺度,避免了复杂的数值优化过程。3) 考虑了前序层的量化误差,从而减少误差累积,提升整体量化精度。

关键设计:在优化阶段,采用了坐标下降算法,每次只更新一个组的尺度因子,而固定其他组的尺度因子。对于每个组的尺度因子更新,论文推导出了一个闭式解,可以直接计算得到最优值。此外,在计算重建损失时,考虑了前序层的量化误差,并将其纳入损失函数中,从而引导优化过程更好地补偿这些误差。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多种LLM模型上均取得了显著的精度提升。例如,在OPT模型上,使用4比特量化时,该方法相比GPTQ,perplexity指标平均降低了0.1-0.2。更重要的是,该方法引入的额外计算开销非常小,几乎可以忽略不计,使其具有很强的实用性。

🎯 应用场景

该研究成果可广泛应用于大语言模型的压缩和加速推理,尤其是在资源受限的边缘设备上部署LLM。通过提高低比特量化的精度,可以显著降低模型大小和计算复杂度,从而实现更高效的LLM应用,例如移动设备上的智能助手、物联网设备上的自然语言处理等。

📄 摘要(原文)

Group-wise quantization is an effective strategy for mitigating accuracy degradation in low-bit quantization of large language models (LLMs). Among existing methods, GPTQ has been widely adopted due to its efficiency; however, it neglects input statistics and inter-group correlations when determining group scales, leading to a mismatch with its goal of minimizing layer-wise reconstruction loss. In this work, we propose a two-stage optimization framework for group scales that explicitly minimizes the layer-wise reconstruction loss. In the first stage, performed prior to GPTQ, we initialize each group scale to minimize the group-wise reconstruction loss, thereby incorporating input statistics. In the second stage, we freeze the integer weights obtained via GPTQ and refine the group scales to minimize the layer-wise reconstruction loss. To this end, we employ the coordinate descent algorithm and derive a closed-form update rule, which enables efficient refinement without costly numerical optimization. Notably, our derivation incorporates the quantization errors from preceding layers to prevent error accumulation. Experimental results demonstrate that our method consistently enhances group-wise quantization, achieving higher accuracy with negligible overhead.