No Global Plan in Chain-of-Thought: Uncover the Latent Planning Horizon of LLMs

作者: Liyan Xu, Mo Yu, Fandong Meng, Jie Zhou

分类: cs.LG, cs.CL

发布日期: 2026-02-02

🔗 代码/项目: GITHUB

💡 一句话要点

Tele-Lens揭示LLM思维链的短视性,并用于提升CoT不确定性估计

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 思维链 潜在规划 不确定性估计 短视性 Tele-Lens 推理能力

📋 核心要点

- 现有研究对CoT的理解存在矛盾,CoT并非总是必要,但对复杂推理至关重要,需要深入理解LLM内部状态与CoT的关系。

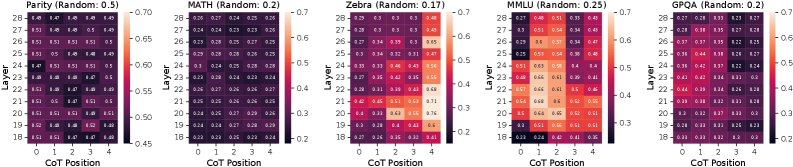

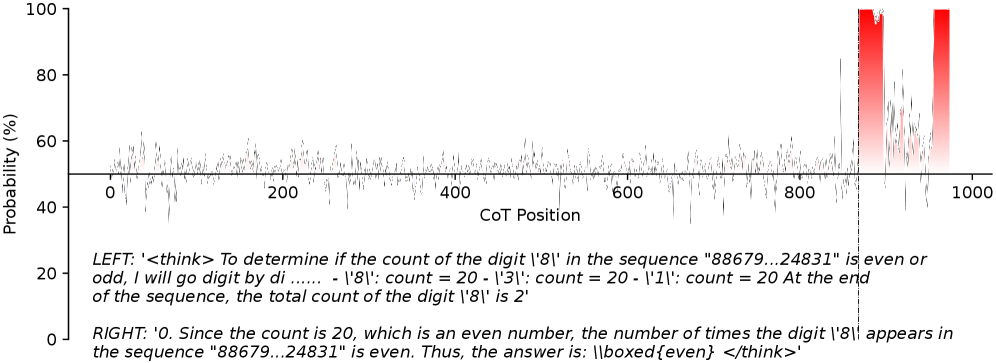

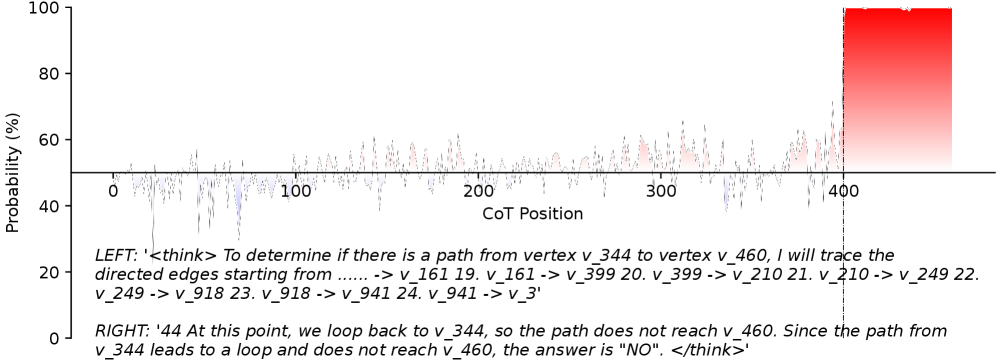

- 论文提出Tele-Lens探测方法,分析LLM在生成CoT时的潜在规划能力,揭示其“短视”特性,即缺乏全局规划。

- 基于LLM的短视特性,提出增强CoT不确定性估计的方法,并实现自动识别CoT旁路,且不影响性能。

📝 摘要(中文)

本研究源于对思维链(CoT)动态的互补性观察:大型语言模型(LLM)在CoT出现之前就表现出对后续推理的潜在规划,从而降低了显式CoT的重要性;而CoT对于需要多步推理的任务仍然至关重要。为了加深对LLM内部状态及其口头推理轨迹之间理解,我们通过探测方法Tele-Lens,应用于不同任务领域的隐藏状态,来研究LLM的潜在规划强度。我们的实验结果表明,LLM表现出短视的视野,主要进行增量转换,而没有精确的全局规划。利用这一特性,我们提出了一个关于增强CoT不确定性估计的假设,并验证了CoT位置的一个小子集可以有效地代表整个路径的不确定性。我们进一步强调了利用CoT动态的重要性,并证明了自动识别CoT旁路可以在不降低性能的情况下实现。我们的代码、数据和模型已在https://github.com/lxucs/tele-lens发布。

🔬 方法详解

问题定义:现有方法对大型语言模型(LLM)在思维链(CoT)推理中的规划能力理解不足。一方面,有研究表明LLM在生成CoT之前已经具备一定的推理能力,降低了显式CoT的重要性;另一方面,CoT对于复杂的多步推理任务仍然至关重要。因此,如何理解LLM内部状态与CoT之间的关系,以及LLM在生成CoT时的规划能力,是一个亟待解决的问题。

核心思路:论文的核心思路是通过探测LLM在生成CoT过程中的隐藏状态,来分析其潜在的规划能力。具体来说,论文假设LLM在生成CoT的每一步时,都会对未来的推理步骤进行一定的规划。通过分析隐藏状态,可以了解LLM的规划范围和规划强度。如果LLM具有较强的全局规划能力,那么其隐藏状态应该包含对未来多个推理步骤的信息。反之,如果LLM只具有短视的规划能力,那么其隐藏状态只包含对当前步骤和少数后续步骤的信息。

技术框架:论文提出的技术框架主要包含以下几个步骤:1) 使用不同的任务数据集,例如算术推理、常识推理等;2) 使用LLM生成CoT推理路径;3) 在生成CoT的每一步,提取LLM的隐藏状态;4) 使用Tele-Lens探测方法,分析隐藏状态中包含的未来推理步骤的信息;5) 根据分析结果,评估LLM的规划范围和规划强度;6) 基于LLM的短视特性,提出增强CoT不确定性估计的方法,并实现自动识别CoT旁路。

关键创新:论文的关键创新在于提出了Tele-Lens探测方法,用于分析LLM在生成CoT过程中的潜在规划能力。Tele-Lens通过分析LLM的隐藏状态,揭示了LLM在CoT推理中具有“短视”的特性,即缺乏全局规划。这一发现颠覆了以往对LLM推理能力的认知,为后续研究提供了新的视角。

关键设计:Tele-Lens的具体实现细节未知,摘要中没有详细描述。但可以推测,Tele-Lens可能使用了某种形式的解码器或分类器,将LLM的隐藏状态映射到未来推理步骤的预测结果。通过分析预测结果的准确率和置信度,可以评估LLM的规划范围和规划强度。此外,论文还提出了一种基于LLM短视特性的CoT不确定性估计方法,具体实现细节也未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在CoT推理中表现出短视的特性,主要进行增量转换,而缺乏精确的全局规划。基于这一发现,论文提出了一种增强CoT不确定性估计的方法,并验证了CoT位置的一个小子集可以有效地代表整个路径的不确定性。此外,论文还证明了自动识别CoT旁路可以在不降低性能的情况下实现。

🎯 应用场景

该研究成果可应用于提升LLM在复杂推理任务中的可靠性和效率。通过理解LLM的规划能力,可以设计更有效的CoT提示策略,减少不必要的推理步骤,并提高推理结果的准确性。此外,该研究还可以用于开发自动化的CoT旁路识别方法,进一步提升LLM的推理效率。

📄 摘要(原文)

This work stems from prior complementary observations on the dynamics of Chain-of-Thought (CoT): Large Language Models (LLMs) is shown latent planning of subsequent reasoning prior to CoT emergence, thereby diminishing the significance of explicit CoT; whereas CoT remains critical for tasks requiring multi-step reasoning. To deepen the understanding between LLM's internal states and its verbalized reasoning trajectories, we investigate the latent planning strength of LLMs, through our probing method, Tele-Lens, applying to hidden states across diverse task domains. Our empirical results indicate that LLMs exhibit a myopic horizon, primarily conducting incremental transitions without precise global planning. Leveraging this characteristic, we propose a hypothesis on enhancing uncertainty estimation of CoT, which we validate that a small subset of CoT positions can effectively represent the uncertainty of the entire path. We further underscore the significance of exploiting CoT dynamics, and demonstrate that automatic recognition of CoT bypass can be achieved without performance degradation. Our code, data and models are released at https://github.com/lxucs/tele-lens.