On the Limits of Layer Pruning for Generative Reasoning in LLMs

作者: Safal Shrestha, Anubhav Shrestha, Aadim Nepal, Minwu Kim, Keith Ross

分类: cs.LG, cs.AI

发布日期: 2026-02-02

💡 一句话要点

研究表明LLM层剪枝在生成式推理任务中存在局限性,并提出基于自生成响应的微调策略。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 层剪枝 大型语言模型 生成式推理 自监督学习 模型压缩

📋 核心要点

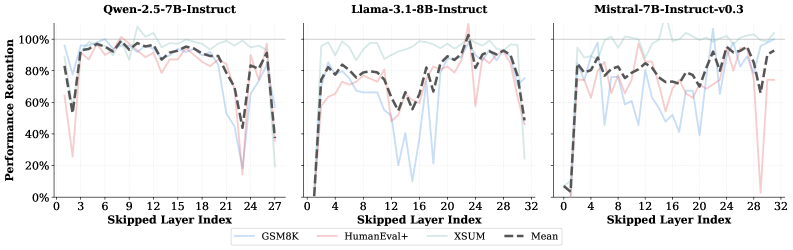

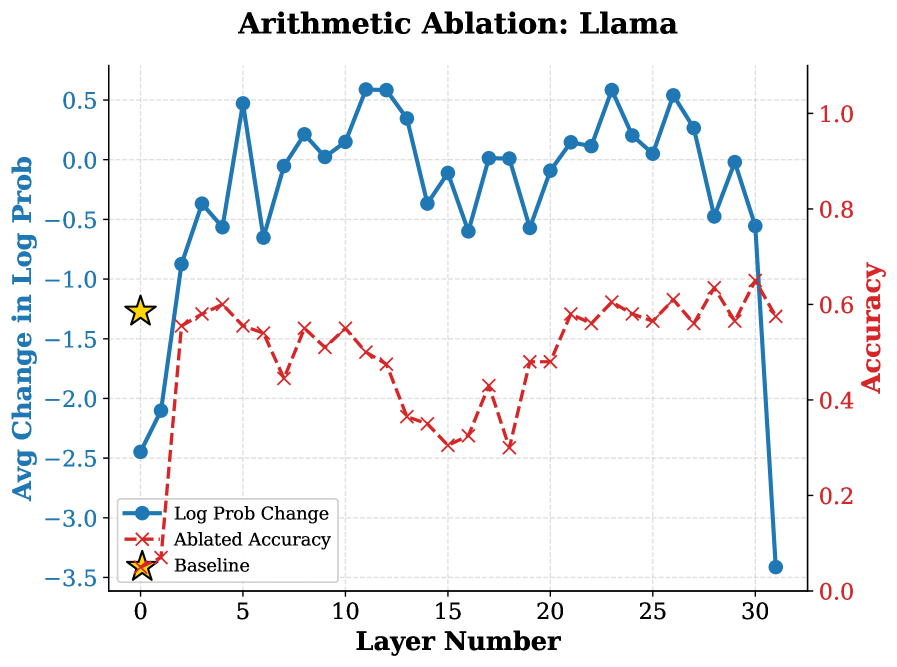

- 现有层剪枝方法在压缩LLM的同时,在生成式推理任务中表现出明显的性能下降,尤其是在需要多步推理的任务中。

- 论文提出一种基于自生成响应的监督微调策略,旨在缓解层剪枝带来的性能损失,特别是在生成式任务中。

- 实验结果表明,该策略在分类任务中能有效恢复性能,并在生成任务中取得显著提升,但生成式推理的恢复仍然存在局限性。

📝 摘要(中文)

本文研究了层剪枝对大型语言模型(LLM)在生成式推理任务中的影响。虽然层剪枝可以在分类基准测试中压缩LLM并保持性能,但在生成式推理任务中会严重退化。研究发现,需要多步推理的任务对深度缩减尤其敏感,不仅导致表面文本退化,还降低了算法能力,如数学推理的算术计算和代码合成的平衡括号生成。在有限的后训练资源下,本文评估了一种基于自生成响应的监督微调策略,该策略在分类任务中恢复了高达90%的基线性能,并在生成基准测试中获得了高达20-30个百分点的显著提升。然而,生成式推理的恢复仍然受到限制,主要适用于较低的剪枝率。总而言之,本文描述了层剪枝在生成式推理中的实际局限性,并为在受限的后训练条件下有效应用深度缩减提供了指导。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在进行层剪枝后,在生成式推理任务中性能显著下降的问题。现有的剪枝方法虽然在分类任务上表现良好,但在需要复杂推理的生成任务中,如数学计算和代码生成,会遇到严重的性能瓶颈,导致模型无法有效完成多步推理。

核心思路:论文的核心思路是通过监督微调来恢复剪枝后模型在生成式任务中的性能。具体而言,利用模型自身生成的响应作为训练数据,对剪枝后的模型进行微调,使其重新学习生成式推理的能力。这种方法避免了对大规模预训练数据的依赖,适用于资源受限的场景。

技术框架:整体流程包括三个主要步骤:1) 对LLM进行层剪枝,减少模型深度;2) 利用剪枝后的模型生成响应;3) 使用生成的响应作为训练数据,对剪枝后的模型进行监督微调。该框架旨在通过自监督的方式,使模型重新适应生成式推理任务。

关键创新:最重要的技术创新点在于利用自生成响应进行微调。与传统的微调方法不同,该方法不需要额外的标注数据,而是利用模型自身的能力来生成训练数据,从而降低了训练成本,并提高了微调的效率。这种自监督的方式能够更好地适应剪枝后模型的特点,有效恢复其生成式推理能力。

关键设计:论文的关键设计包括:1) 选择合适的剪枝比例,以平衡模型压缩和性能损失;2) 设计有效的自生成响应策略,确保生成数据的质量;3) 采用合适的损失函数和优化器,以加速微调过程并提高模型性能。具体的参数设置和网络结构细节在论文中进行了详细描述,但此处未提供具体数值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于自生成响应的微调策略在分类任务中恢复了高达90%的基线性能,并在生成基准测试中获得了高达20-30个百分点的显著提升。尽管如此,生成式推理的恢复仍然受到限制,主要适用于较低的剪枝率,这揭示了层剪枝在生成式推理任务中的实际局限性。

🎯 应用场景

该研究成果可应用于各种需要压缩LLM并保持生成式推理能力的场景,例如在资源受限的边缘设备上部署LLM,或在计算资源有限的情况下进行模型微调。该研究为如何在实际应用中有效利用层剪枝技术提供了指导。

📄 摘要(原文)

Recent works have shown that layer pruning can compress large language models (LLMs) while retaining strong performance on classification benchmarks with little or no finetuning. However, existing pruning techniques often suffer severe degradation on generative reasoning tasks. Through a systematic study across multiple model families, we find that tasks requiring multi-step reasoning are particularly sensitive to depth reduction. Beyond surface-level text degeneration, we observe degradation of critical algorithmic capabilities, including arithmetic computation for mathematical reasoning and balanced parenthesis generation for code synthesis. Under realistic post-training constraints, without access to pretraining-scale data or compute, we evaluate a simple mitigation strategy based on supervised finetuning with Self-Generated Responses. This approach achieves strong recovery on classification tasks, retaining up to 90\% of baseline performance, and yields substantial gains of up to 20--30 percentage points on generative benchmarks compared to prior post-pruning techniques. Crucially, despite these gains, recovery for generative reasoning remains fundamentally limited relative to classification tasks and is viable primarily at lower pruning ratios. Overall, we characterize the practical limits of layer pruning for generative reasoning and provide guidance on when depth reduction can be applied effectively under constrained post-training regimes.