Zero-Shot Off-Policy Learning

作者: Arip Asadulaev, Maksim Bobrin, Salem Lahlou, Dmitry Dylov, Fakhri Karray, Martin Takac

分类: cs.LG, cs.AI

发布日期: 2026-02-02

💡 一句话要点

提出基于后继测度和密度比的零样本离线策略学习算法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱八:物理动画 (Physics-based Animation)

关键词: 零样本学习 离线策略学习 强化学习 后继测度 重要性采样

📋 核心要点

- 离线策略学习面临分布偏移和值函数过高估计的挑战,尤其是在零样本强化学习中,智能体需要在新任务上快速适应。

- 该论文通过建立后继测度与平稳密度比的理论联系,推导出最优的重要性采样比率,从而实现平稳分布校正。

- 实验表明,该方法在运动跟踪、连续控制和长程任务中表现良好,并能无缝集成到前向-后向表示框架中,实现快速适应。

📝 摘要(中文)

离线策略学习旨在直接从固定的历史交互数据集中推导出最优策略。这种目标带来了显著的挑战,主要源于固有的分布偏移和值函数过高估计偏差。在零样本强化学习中,这些问题变得更加明显,因为在无奖励数据上训练的智能体必须在测试时适应新任务,而无需额外的训练。本文通过发现后继测度与平稳密度比之间的理论联系,解决了零样本环境下的离线策略问题。利用这一洞察,我们的算法可以推断出最优的重要性采样比率,从而有效地执行平稳分布校正,并为任何任务提供最优策略。我们在SMPL Humanoid上的运动跟踪任务、ExoRL上的连续控制以及长程OGBench任务中对我们的方法进行了基准测试。我们的技术无缝集成到前向-后向表示框架中,并能够在无训练模式下快速适应新任务。更广泛地说,这项工作将离线策略学习和零样本适应联系起来,为这两个研究领域带来了好处。

🔬 方法详解

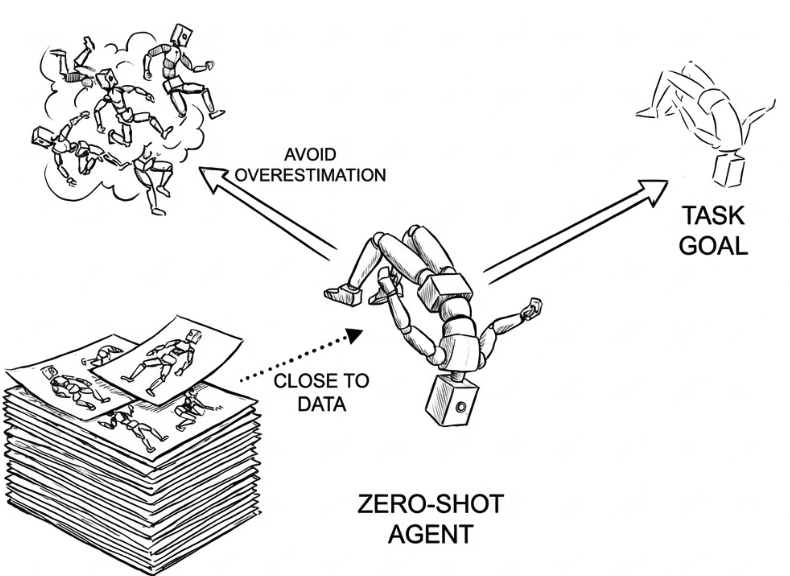

问题定义:论文旨在解决零样本离线策略学习问题。现有离线策略学习方法在处理分布偏移和值函数过高估计方面存在不足,尤其是在零样本场景下,智能体需要在没有额外训练的情况下适应新任务,这使得学习最优策略变得更加困难。

核心思路:论文的核心思路是利用后继测度与平稳密度比之间的理论联系。通过学习后继测度,可以推断出最优的重要性采样比率,从而对离线数据进行校正,使其更接近目标任务的分布。这种方法允许智能体在零样本环境下快速适应新任务,而无需额外的训练。

技术框架:该算法主要包含以下几个阶段:1) 使用无奖励数据训练一个通用的表示学习模型,学习状态的嵌入表示。2) 利用学习到的状态表示,估计后继测度。3) 基于后继测度,计算最优的重要性采样比率,用于校正离线数据。4) 使用校正后的离线数据,学习目标任务的最优策略。该框架可以与前向-后向表示框架无缝集成。

关键创新:论文的关键创新在于发现了后继测度与平稳密度比之间的理论联系,并将其应用于零样本离线策略学习。与现有方法相比,该方法能够更有效地校正离线数据,从而在零样本环境下实现更好的性能。此外,该方法不需要额外的训练,可以快速适应新任务。

关键设计:论文中关键的设计包括:1) 使用神经网络学习状态的嵌入表示。2) 使用特定的损失函数来训练后继测度估计器,例如最小二乘法或对抗学习。3) 使用计算出的重要性采样比率对离线数据进行加权,从而校正分布偏移。4) 使用标准的离线策略学习算法,例如Q-learning或Actor-Critic,学习目标任务的最优策略。

🖼️ 关键图片

📊 实验亮点

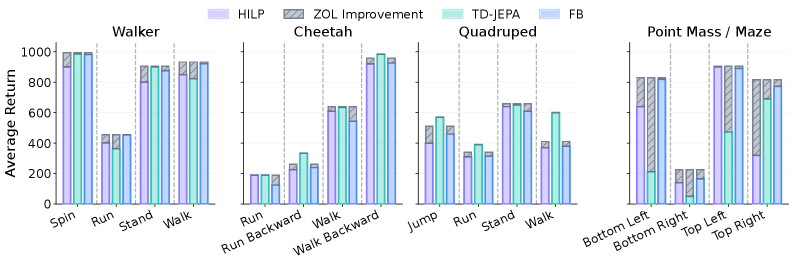

该论文在SMPL Humanoid运动跟踪任务、ExoRL连续控制任务和长程OGBench任务上进行了实验验证。实验结果表明,该方法能够有效地解决零样本离线策略学习问题,并在多个任务上取得了显著的性能提升。具体数据和对比基线未在摘要中详细给出,但强调了该方法在无训练模式下快速适应新任务的能力。

🎯 应用场景

该研究成果可应用于机器人控制、游戏AI、推荐系统等领域。例如,在机器人控制中,可以利用历史数据训练一个通用的控制策略,然后快速适应新的任务环境,而无需重新训练。在推荐系统中,可以利用用户的历史行为数据,快速为新用户推荐个性化的商品或服务。

📄 摘要(原文)

Off-policy learning methods seek to derive an optimal policy directly from a fixed dataset of prior interactions. This objective presents significant challenges, primarily due to the inherent distributional shift and value function overestimation bias. These issues become even more noticeable in zero-shot reinforcement learning, where an agent trained on reward-free data must adapt to new tasks at test time without additional training. In this work, we address the off-policy problem in a zero-shot setting by discovering a theoretical connection of successor measures to stationary density ratios. Using this insight, our algorithm can infer optimal importance sampling ratios, effectively performing a stationary distribution correction with an optimal policy for any task on the fly. We benchmark our method in motion tracking tasks on SMPL Humanoid, continuous control on ExoRL, and for the long-horizon OGBench tasks. Our technique seamlessly integrates into forward-backward representation frameworks and enables fast-adaptation to new tasks in a training-free regime. More broadly, this work bridges off-policy learning and zero-shot adaptation, offering benefits to both research areas.