Automatic Constraint Policy Optimization based on Continuous Constraint Interpolation Framework for Offline Reinforcement Learning

作者: Xinchen Han, Qiuyang Fang, Hossam Afifi, Michel Marot

分类: cs.LG, cs.AI

发布日期: 2026-01-30

💡 一句话要点

提出基于连续约束插值的自动约束策略优化算法,提升离线强化学习性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 策略约束 连续约束插值 自动策略优化 拉格朗日对偶 D4RL NeoRL2

📋 核心要点

- 现有离线强化学习方法依赖单一约束形式,缺乏统一理论解释不同约束的联系与权衡。

- 提出连续约束插值(CCI)框架,将不同约束视为通用约束谱上的特例,实现平滑过渡与组合。

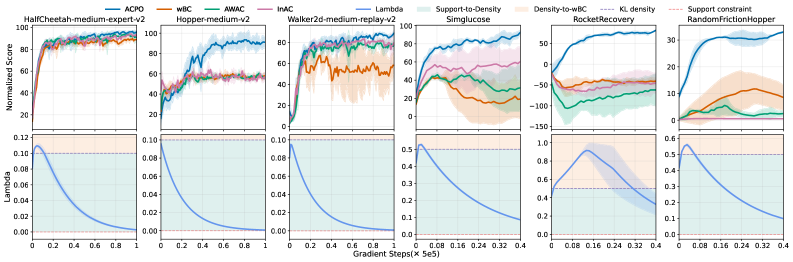

- 开发自动约束策略优化(ACPO)算法,通过拉格朗日对偶更新自适应调整插值参数,实验证明有效。

📝 摘要(中文)

离线强化学习依赖于策略约束来缓解外推误差,约束形式和约束强度对性能至关重要。然而,现有方法通常只关注单一约束类型,如加权行为克隆、密度正则化或支持约束,缺乏统一的理论解释它们之间的联系和权衡。本文提出了连续约束插值(CCI),一个统一的优化框架,将这三种约束类型视为一个通用约束谱上的特例。CCI框架引入了一个插值参数,实现了约束类型之间的平滑过渡和组合。基于CCI,我们开发了自动约束策略优化(ACPO),一种实用的原始-对偶算法,通过拉格朗日对偶更新自适应地调整插值参数。此外,我们建立了最大熵性能差异引理,并推导了闭式最优策略及其参数化投影的性能下界。在D4RL和NeoRL2上的实验表明,该方法在不同领域都取得了显著的性能提升,总体上达到了最先进的水平。

🔬 方法详解

问题定义:离线强化学习中,策略外推误差是一个关键问题。现有方法通常采用单一类型的策略约束(如行为克隆、密度正则化、支持约束)来缓解这个问题,但缺乏一个统一的框架来理解和选择合适的约束类型。不同约束类型之间的联系和权衡也缺乏明确的理论指导,导致难以在不同任务中选择最优的约束策略。

核心思路:本文的核心思路是将不同的策略约束类型视为一个连续谱上的点,通过引入一个插值参数,可以在这些约束类型之间进行平滑过渡和组合。这种连续约束插值(CCI)的思想允许算法根据具体任务的特点,自适应地选择合适的约束类型和强度,从而提高离线强化学习的性能。

技术框架:整体框架包含两个主要部分:连续约束插值(CCI)和自动约束策略优化(ACPO)。CCI定义了一个统一的优化框架,将不同的约束类型(如行为克隆、密度正则化、支持约束)视为一个连续谱上的特例。ACPO则是一种原始-对偶算法,用于优化CCI框架中的策略,并自适应地调整插值参数。该算法通过拉格朗日对偶更新来平衡策略的性能和约束的满足程度。

关键创新:最重要的创新点在于提出了连续约束插值(CCI)框架,它将不同的策略约束类型统一到一个连续的谱上,并通过一个插值参数实现了约束类型之间的平滑过渡和组合。与现有方法相比,CCI框架提供了一种更灵活和通用的方式来设计策略约束,允许算法根据具体任务的特点自适应地选择合适的约束类型和强度。

关键设计:ACPO算法的关键设计包括:1) 使用拉格朗日对偶更新来优化策略和插值参数,平衡策略的性能和约束的满足程度;2) 建立最大熵性能差异引理,并推导闭式最优策略及其参数化投影的性能下界,为算法的理论分析提供了基础;3) 实验中,使用了D4RL和NeoRL2等标准离线强化学习数据集,并与多种基线方法进行了比较。

🖼️ 关键图片

📊 实验亮点

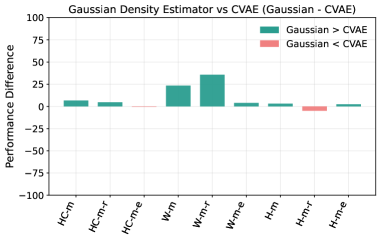

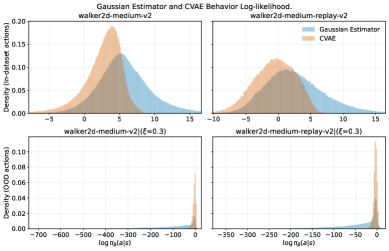

在D4RL和NeoRL2数据集上的实验结果表明,ACPO算法在多个领域都取得了显著的性能提升,总体上达到了最先进的水平。具体而言,ACPO在多个任务上的平均得分超过了现有基线方法,证明了其在不同环境下的鲁棒性和有效性。实验结果还验证了CCI框架的有效性,表明通过连续插值不同的约束类型可以获得更好的性能。

🎯 应用场景

该研究成果可应用于各种需要离线强化学习的场景,例如机器人控制、自动驾驶、推荐系统和金融交易等。通过自适应地选择合适的策略约束,可以提高离线强化学习算法的稳定性和性能,从而在数据有限或探索成本高昂的环境中实现更好的决策。

📄 摘要(原文)

Offline Reinforcement Learning (RL) relies on policy constraints to mitigate extrapolation error, where both the constraint form and constraint strength critically shape performance. However, most existing methods commit to a single constraint family: weighted behavior cloning, density regularization, or support constraints, without a unified principle that explains their connections or trade-offs. In this work, we propose Continuous Constraint Interpolation (CCI), a unified optimization framework in which these three constraint families arise as special cases along a common constraint spectrum. The CCI framework introduces a single interpolation parameter that enables smooth transitions and principled combinations across constraint types. Building on CCI, we develop Automatic Constraint Policy Optimization (ACPO), a practical primal--dual algorithm that adapts the interpolation parameter via a Lagrangian dual update. Moreover, we establish a maximum-entropy performance difference lemma and derive performance lower bounds for both the closed-form optimal policy and its parametric projection. Experiments on D4RL and NeoRL2 demonstrate robust gains across diverse domains, achieving state-of-the-art performance overall.