Vision-Language Models Unlock Task-Centric Latent Actions

作者: Alexander Nikulin, Ilya Zisman, Albina Klepach, Denis Tarasov, Alexander Derevyagin, Andrei Polubarov, Lyubaykin Nikita, Vladislav Kurenkov

分类: cs.LG, cs.AI, cs.CV

发布日期: 2026-01-30

备注: Preprint

💡 一句话要点

利用视觉-语言模型解锁任务中心潜在动作,提升复杂环境下的动作表征能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 潜在动作模型 机器人控制 无监督学习 动作表征 提示学习 干扰因素 多模态学习

📋 核心要点

- 现有潜在动作模型在存在干扰因素时难以提取有效动作表征,限制了其在复杂环境中的应用。

- 利用视觉-语言模型的常识推理能力,通过可提示的表征分离可控变化和噪声,提升潜在动作的质量。

- 实验表明,该方法显著提高了在干扰环境下的动作表征能力,下游任务成功率提升高达六倍。

📝 摘要(中文)

潜在动作模型(LAMs)已成为领先的视觉-语言-动作模型预训练流程中的重要组成部分。然而,当观测包含与动作相关的干扰因素时,它们会失效,通常编码噪声而不是有意义的潜在动作。另一方面,人类可以毫不费力地区分任何视频中与任务相关的运动和不相关的细节,只需简短的任务描述。在这项工作中,我们提出利用视觉-语言模型(VLMs)的常识推理能力来提供可提示的表征,从而有效地将可控变化与噪声以无监督的方式分离。我们使用这些表征作为LAM训练期间的目标,并对各种流行的VLM进行基准测试,揭示了可提示表征质量的显著差异以及它们对不同提示和超参数的鲁棒性。有趣的是,我们发现较新的VLM可能比旧的VLM表现更差。最后,我们表明,简单地要求VLM忽略干扰因素可以显著提高潜在动作质量,从而使Distracting MetaWorld上的下游成功率提高多达六倍。

🔬 方法详解

问题定义:现有潜在动作模型(LAMs)在处理包含与动作相关的干扰因素的视频时,无法有效提取有意义的潜在动作,而是容易受到噪声的影响。这限制了LAMs在复杂环境中的应用,因为实际场景中往往存在各种干扰因素。现有方法缺乏区分任务相关信息和无关信息的能力。

核心思路:论文的核心思路是利用视觉-语言模型(VLMs)的常识推理能力,通过文本提示引导VLM关注任务相关的视觉信息,从而生成更干净、更具任务导向性的视觉表征。这些表征随后被用作LAM训练的目标,以提高LAM对干扰因素的鲁棒性。

技术框架:整体框架包含两个主要阶段:1) 使用VLM生成可提示的视觉表征。给定视频帧和任务描述(prompt),VLM提取视觉特征,并根据prompt调整特征,使其更关注任务相关的信息。2) 使用VLM生成的表征作为目标,训练LAM。LAM学习将原始视频帧编码为潜在动作,并使这些潜在动作能够预测VLM生成的表征。

关键创新:该方法的核心创新在于利用VLM的文本理解能力来指导视觉表征的学习,从而克服了传统LAM在干扰环境下表现不佳的问题。通过prompt engineering,可以灵活地控制VLM关注的视觉信息,从而提高LAM的泛化能力。与现有方法相比,该方法无需人工标注,可以以无监督的方式学习任务相关的潜在动作。

关键设计:关键设计包括:1) 选择合适的VLM模型,并探索不同的prompt策略,以获得高质量的可提示表征。2) 设计合适的损失函数,以确保LAM学习到的潜在动作能够准确预测VLM生成的表征。3) 探索不同的LAM架构,以提高其学习能力和泛化能力。论文还研究了不同VLM模型、prompt和超参数对最终性能的影响。

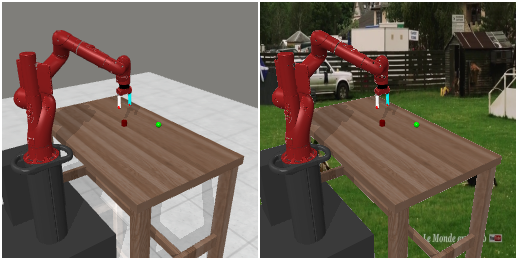

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用VLM引导的LAM训练方法可以显著提高在Distracting MetaWorld环境下的下游任务成功率,最高可达六倍。此外,研究还发现,不同VLM模型的性能存在显著差异,并且较新的VLM模型并不一定优于旧模型。通过简单的prompt engineering,例如要求VLM忽略干扰因素,可以进一步提高潜在动作的质量。

🎯 应用场景

该研究成果可应用于机器人控制、自动驾驶、视频理解等领域。通过提升模型在复杂环境下的动作表征能力,可以使机器人更好地理解和执行任务,提高自动驾驶系统的安全性和可靠性,并促进视频内容分析和理解的自动化。

📄 摘要(原文)

Latent Action Models (LAMs) have rapidly gained traction as an important component in the pre-training pipelines of leading Vision-Language-Action models. However, they fail when observations contain action-correlated distractors, often encoding noise instead of meaningful latent actions. Humans, on the other hand, can effortlessly distinguish task-relevant motions from irrelevant details in any video given only a brief task description. In this work, we propose to utilize the common-sense reasoning abilities of Vision-Language Models (VLMs) to provide promptable representations, effectively separating controllable changes from the noise in unsupervised way. We use these representations as targets during LAM training and benchmark a wide variety of popular VLMs, revealing substantial variation in the quality of promptable representations as well as their robustness to different prompts and hyperparameters. Interestingly, we find that more recent VLMs may perform worse than older ones. Finally, we show that simply asking VLMs to ignore distractors can substantially improve latent action quality, yielding up to a six-fold increase in downstream success rates on Distracting MetaWorld.