Do Transformers Have the Ability for Periodicity Generalization?

作者: Huanyu Liu, Ge Li, Yihong Dong, Sihan Wu, Peixu Wang, Sihao Cheng, Taozhi Chen, Kechi Zhang, Hao Zhu, Tongxuan Liu

分类: cs.LG, cs.AI

发布日期: 2026-01-30

💡 一句话要点

研究Transformer在周期性泛化能力上的局限性,并提出可控生成基准Coper。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Transformer 周期性泛化 分布外泛化 复合周期性 可控生成基准

📋 核心要点

- 现有Transformer模型在分布外泛化能力上存在不足,尤其是在周期性模式的泛化方面。

- 论文从抽象代数角度统一解释周期性,并构建可控生成基准Coper,用于评估模型在复合周期性上的泛化能力。

- 实验表明,Transformer模型虽然能记忆训练数据中的周期性,但难以泛化到未见过的复合周期性场景。

📝 摘要(中文)

基于Transformer的大型语言模型(LLMs)在各种任务中表现出强大的性能。然而,与人类相比,当前的模型在分布外(OOD)泛化方面仍然存在很大的局限性。本文通过周期性这一基本的OOD场景来研究这种差距。周期性捕捉变化中的不变性。周期性泛化代表了模型从训练数据中提取周期性模式并泛化到OOD场景的能力。我们从抽象代数和推理的角度对周期性进行统一的解释,包括单一和复合周期性,以解释为什么Transformer难以泛化周期性。然后,我们构建了关于复合周期性的Coper,这是一个具有两种OOD设置(空心和外推)的可控生成基准。实验表明,Transformer中的周期性泛化是有限的,模型可以在训练期间记忆周期性数据,但不能泛化到未见过的复合周期性。我们发布了源代码以支持未来的研究。

🔬 方法详解

问题定义:论文旨在研究Transformer模型在周期性泛化能力上的局限性。现有方法,即直接应用Transformer模型,在处理分布外(OOD)的周期性数据时表现不佳,无法有效提取和泛化周期性模式。特别是在复合周期性的场景下,模型难以从训练数据中学习到潜在的周期性规律,从而导致泛化性能下降。

核心思路:论文的核心思路是从抽象代数的角度对周期性进行统一的解释,将周期性视为一种不变性。通过这种方式,可以更清晰地理解Transformer模型在处理周期性数据时所面临的挑战。此外,论文还构建了一个可控的生成基准Coper,用于系统地评估模型在复合周期性上的泛化能力。Coper允许研究人员控制周期性的复杂程度和OOD设置,从而更深入地了解模型的行为。

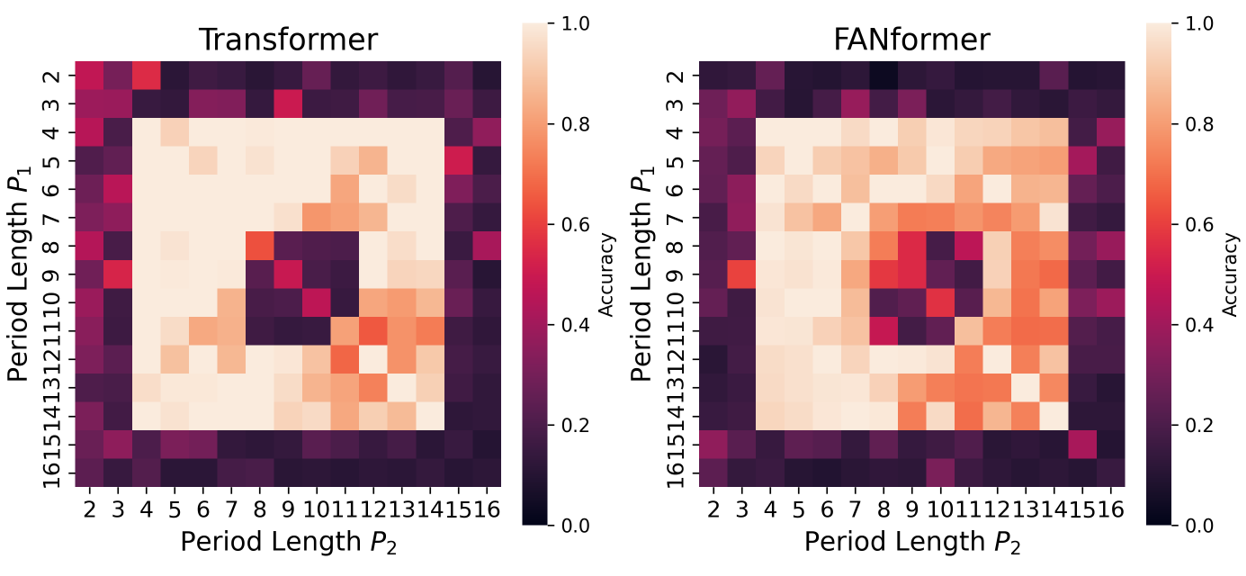

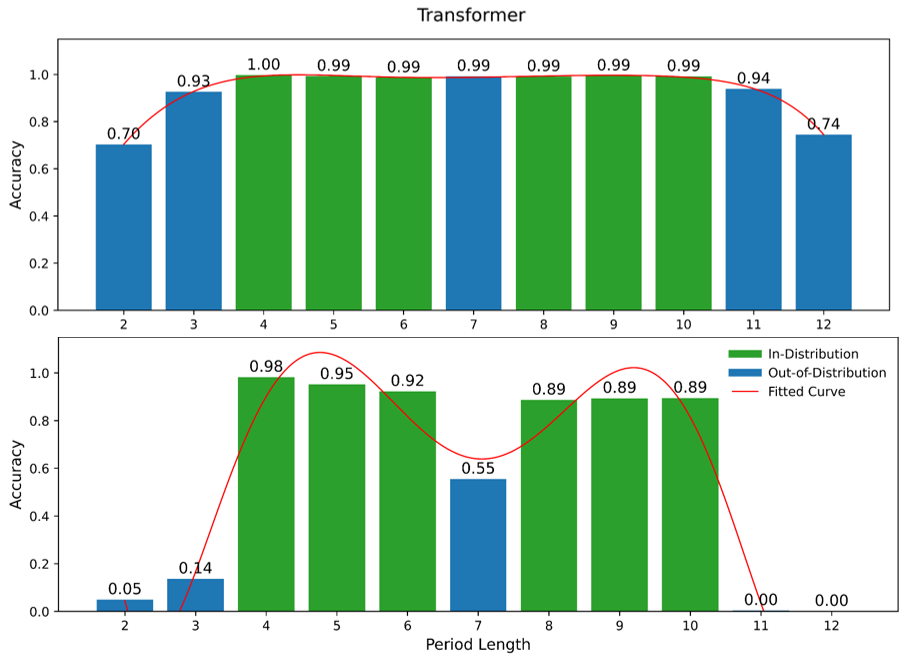

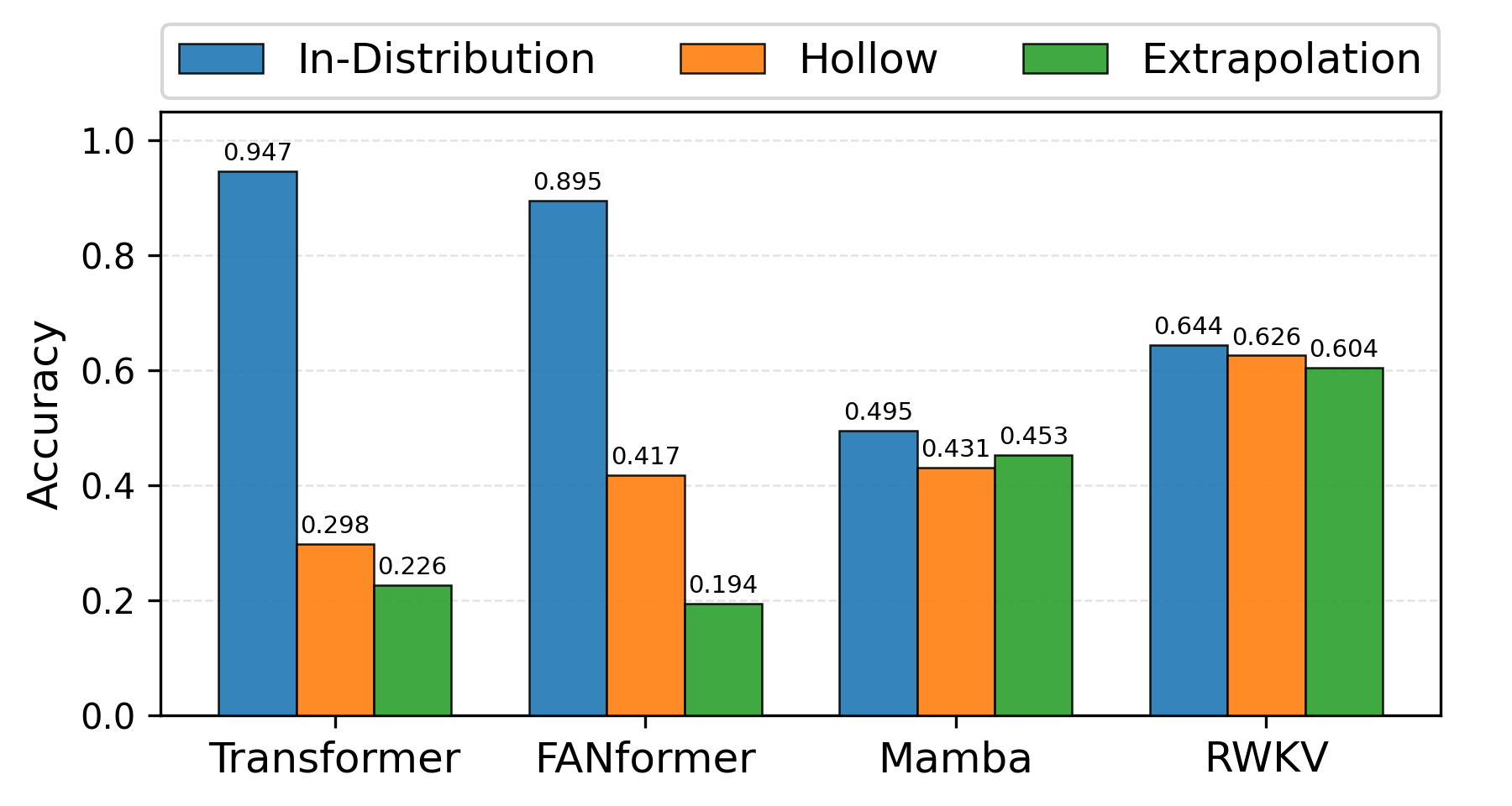

技术框架:论文的技术框架主要包括两个部分:周期性的理论分析和Coper基准的构建。首先,论文从抽象代数的角度对单一和复合周期性进行了形式化定义。然后,基于这些定义,论文设计了Coper基准,该基准包含两种OOD设置:空心(Hollow)和外推(Extrapolation)。Coper基准允许研究人员生成具有不同周期性模式的数据,并评估模型在这些数据上的泛化能力。

关键创新:论文的关键创新在于:1) 从抽象代数的角度对周期性进行了统一的解释,为理解Transformer模型的周期性泛化能力提供了新的视角。2) 构建了Coper基准,这是一个可控的生成基准,允许研究人员系统地评估模型在复合周期性上的泛化能力。Coper基准的OOD设置使得研究人员可以更深入地了解模型在不同泛化场景下的行为。

关键设计:Coper基准的关键设计包括:1) 可控的周期性模式生成:Coper允许研究人员控制周期性的频率、相位和幅度等参数,从而生成具有不同复杂程度的周期性数据。2) 两种OOD设置:空心设置(Hollow)是指在训练数据中移除某些周期性模式,从而评估模型在缺失数据情况下的泛化能力。外推设置(Extrapolation)是指在测试数据中使用超出训练数据范围的周期性模式,从而评估模型的外推能力。3) 多样化的评估指标:Coper基准提供了多种评估指标,包括准确率、均方误差等,用于全面评估模型的泛化性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Transformer模型在Coper基准上表现出有限的周期性泛化能力。模型能够记忆训练数据中的周期性模式,但在空心和外推两种OOD设置下,性能显著下降。例如,在某些复合周期性任务中,模型的准确率从训练集上的90%以上降至测试集上的50%以下,表明模型难以泛化到未见过的周期性模式。

🎯 应用场景

该研究成果可应用于时序数据预测、信号处理、异常检测等领域。通过提升模型对周期性模式的泛化能力,可以提高模型在实际应用中的鲁棒性和准确性。例如,在金融市场预测中,可以利用该方法提高模型对市场周期性波动的预测能力。在工业设备故障诊断中,可以利用该方法检测设备运行中的异常周期性模式。

📄 摘要(原文)

Large language models (LLMs) based on the Transformer have demonstrated strong performance across diverse tasks. However, current models still exhibit substantial limitations in out-of-distribution (OOD) generalization compared with humans. We investigate this gap through periodicity, one of the basic OOD scenarios. Periodicity captures invariance amid variation. Periodicity generalization represents a model's ability to extract periodic patterns from training data and generalize to OOD scenarios. We introduce a unified interpretation of periodicity from the perspective of abstract algebra and reasoning, including both single and composite periodicity, to explain why Transformers struggle to generalize periodicity. Then we construct Coper about composite periodicity, a controllable generative benchmark with two OOD settings, Hollow and Extrapolation. Experiments reveal that periodicity generalization in Transformers is limited, where models can memorize periodic data during training, but cannot generalize to unseen composite periodicity. We release the source code to support future research.