A Judge-Aware Ranking Framework for Evaluating Large Language Models without Ground Truth

作者: Mingyuan Xu, Xinzi Tan, Jiawei Wu, Doudou Zhou

分类: stat.ML, cs.LG

发布日期: 2026-01-29

💡 一句话要点

提出Judge-Aware排序框架,解决LLM评估中评判者可靠性差异问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型评估 无标准答案评估 评判者可靠性 Bradley-Terry-Luce模型 成对比较 不确定性量化 模型排序

📋 核心要点

- 现有LLM评估方法忽略了评判者LLM的可靠性差异,导致评估结果偏差和不确定性估计不准确。

- 提出Judge-Aware排序框架,通过引入评判者特定参数,联合估计模型质量和评判者可靠性。

- 实验表明,该方法提高了与人类偏好的一致性,提升了数据效率,并实现了校准的不确定性量化。

📝 摘要(中文)

本文提出了一种judge-aware的排序框架,用于在没有标准答案的情况下评估大型语言模型(LLM)。该框架的核心在于解决LLM作为评判者时可靠性差异显著的问题,因为平等对待所有评判者会导致有偏差的排行榜和误导性的不确定性估计。该框架扩展了Bradley-Terry-Luce模型,引入了评判者特定的区分参数,从而在没有参考标签的情况下联合估计潜在的模型质量和评判者可靠性。论文证明了该方法的可识别性,并建立了最大似然估计量的一致性和渐近正态性,从而能够计算得分差异和排名比较的置信区间。在多个公共基准测试和一个新收集的数据集上,该方法提高了与人类偏好的一致性,实现了比未加权基线更高的数据效率,并为LLM排名生成了校准的不确定性量化。

🔬 方法详解

问题定义:论文旨在解决在没有标准答案的情况下,如何更准确地评估大型语言模型(LLM)的性能。现有方法,特别是基于LLM作为评判者的评估范式,通常假设所有评判者具有相同的可靠性,这与实际情况不符。不同评判者LLM的偏好、知识和判断标准存在差异,导致评估结果出现偏差,并且无法准确估计评估结果的不确定性。

核心思路:论文的核心思路是引入评判者感知的机制,对每个评判者LLM的可靠性进行建模。通过学习每个评判者的区分参数,可以校正其评估结果,从而更准确地估计LLM的真实性能。这种方法避免了平等对待所有评判者带来的偏差,并能够提供更可靠的排名和不确定性估计。

技术框架:该框架基于Bradley-Terry-Luce (BTL) 模型,这是一个经典的成对比较模型,用于估计个体的潜在得分。论文扩展了BTL模型,为每个评判者引入一个区分参数,用于衡量其判断能力。整体流程如下:1) 收集LLM之间的成对比较数据,其中每个比较由一个评判者LLM给出;2) 使用最大似然估计方法,联合估计LLM的潜在得分和评判者的区分参数;3) 利用估计的参数,计算LLM的排名和置信区间。

关键创新:该论文的关键创新在于将评判者的可靠性纳入LLM评估框架中。通过引入评判者特定的区分参数,该方法能够更准确地估计LLM的真实性能,并提供更可靠的排名和不确定性估计。与现有方法相比,该方法不需要标准答案,并且能够处理评判者之间的异质性。

关键设计:论文的关键设计包括:1) 使用最大似然估计方法,联合估计LLM的潜在得分和评判者的区分参数;2) 证明了该方法的可识别性,确保参数估计的唯一性;3) 建立了最大似然估计量的一致性和渐近正态性,从而能够计算得分差异和排名比较的置信区间。损失函数基于BTL模型的似然函数,通过优化该函数来估计模型参数。

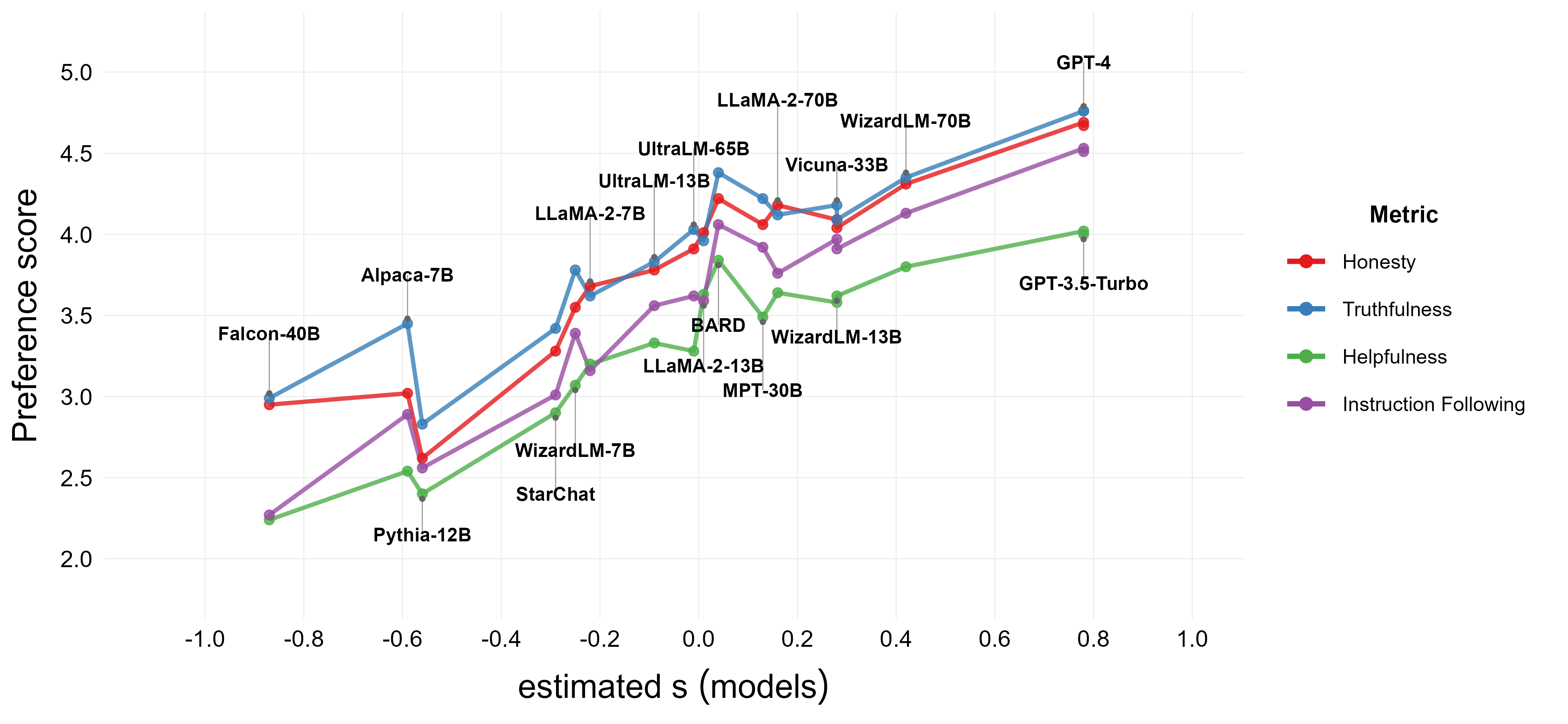

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个公共基准测试和一个新收集的数据集上,提高了与人类偏好的一致性。与未加权基线相比,该方法实现了更高的数据效率,即在相同数据量下,能够获得更准确的评估结果。此外,该方法还能够为LLM排名生成校准的不确定性量化,为用户提供更可靠的评估信息。

🎯 应用场景

该研究成果可广泛应用于大型语言模型的评估和选择,尤其是在缺乏标准答案的开放式任务中。例如,可以用于评估不同LLM在创意写作、对话生成、代码生成等方面的性能,帮助用户选择最适合其需求的LLM。此外,该方法还可以用于评估评判者LLM的质量,从而选择更可靠的评判者进行评估。

📄 摘要(原文)

Evaluating large language models (LLMs) on open-ended tasks without ground-truth labels is increasingly done via the LLM-as-a-judge paradigm. A critical but under-modeled issue is that judge LLMs differ substantially in reliability; treating all judges equally can yield biased leaderboards and misleading uncertainty estimates. More data can make evaluation more confidently wrong under misspecified aggregation. We propose a judge-aware ranking framework that extends the Bradley-Terry-Luce model by introducing judge-specific discrimination parameters, jointly estimating latent model quality and judge reliability from pairwise comparisons without reference labels. We establish identifiability up to natural normalizations and prove consistency and asymptotic normality of the maximum likelihood estimator, enabling confidence intervals for score differences and rank comparisons. Across multiple public benchmarks and a newly collected dataset, our method improves agreement with human preferences, achieves higher data efficiency than unweighted baselines, and produces calibrated uncertainty quantification for LLM rankings.