NetMamba+: A Framework of Pre-trained Models for Efficient and Accurate Network Traffic Classification

作者: Tongze Wang, Xiaohui Xie, Wenduo Wang, Chuyi Wang, Jinzhou Liu, Boyan Huang, Yannan Hu, Youjian Zhao, Yong Cui

分类: cs.LG

发布日期: 2026-01-29

💡 一句话要点

NetMamba+:用于高效准确网络流量分类的预训练模型框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 网络流量分类 Mamba架构 Flash Attention 多模态表示 长尾分布 预训练模型 小样本学习

📋 核心要点

- 现有Transformer模型在网络流量分类中计算效率低,难以满足实时性需求。

- NetMamba+通过结合Mamba和Flash Attention,并设计多模态流量表示,提升效率和准确性。

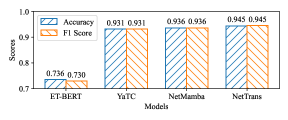

- 实验表明,NetMamba+在F1得分上提升高达6.44%,推理吞吐量提升1.7倍,并具有优秀的小样本学习能力。

📝 摘要(中文)

随着加密网络流量的快速增长,有效的流量分类对于网络安全和服务质量管理至关重要。现有的机器学习和深度学习方法在流量分类方面面临三个关键挑战:Transformer架构的计算效率低下,流量表示不足导致关键字节级特征丢失并保留有害偏差,以及对真实世界数据中长尾分布的处理不佳。我们提出了NetMamba+框架,通过三个关键创新来应对这些挑战:(1)考虑Mamba和Flash Attention机制的高效架构,(2)一种多模态流量表示方案,在消除偏差的同时保留必要的流量信息,以及(3)一种标签分布感知的微调策略。对包含四个主要分类任务的大规模数据集的评估实验表明,与最先进的基线相比,NetMamba+具有卓越的分类性能,F1得分提高了高达6.44%。此外,NetMamba+表现出卓越的效率,实现了比最佳基线高1.7倍的推理吞吐量,同时保持了相当低的内存使用率。此外,NetMamba+表现出卓越的小样本学习能力,以更少的标记数据实现了更好的分类性能。此外,我们实现了一个在线流量分类系统,该系统展示了强大的真实世界性能,吞吐量为261.87 Mb/s。作为第一个将Mamba架构应用于网络流量分类的框架,NetMamba+为复杂网络环境中高效准确的流量分析开辟了新的可能性。

🔬 方法详解

问题定义:论文旨在解决网络流量分类中现有方法的三个主要痛点:一是Transformer架构计算效率低,难以处理大规模流量数据;二是流量表示方法不足,丢失了关键的字节级特征,并引入了偏差;三是难以有效处理真实网络流量数据中的长尾分布问题。

核心思路:论文的核心思路是设计一个高效且准确的预训练模型框架NetMamba+,它结合了Mamba架构的高效性和Flash Attention的加速能力,采用多模态流量表示方法来保留关键特征并消除偏差,并使用标签分布感知的微调策略来优化长尾分布数据的分类性能。

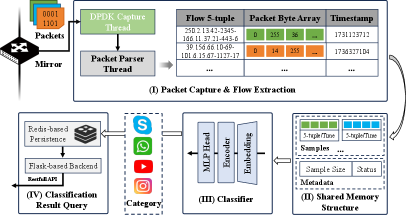

技术框架:NetMamba+框架主要包含三个核心模块:1)高效架构:结合Mamba和Flash Attention机制,提高计算效率;2)多模态流量表示:设计一种能够保留关键流量信息并消除偏差的表示方法;3)标签分布感知微调:针对长尾分布数据,设计一种能够提升分类性能的微调策略。整体流程为:首先,使用多模态流量表示方法将原始流量数据转换为模型可处理的输入;然后,使用预训练的NetMamba+模型进行特征提取和分类;最后,使用标签分布感知微调策略对模型进行微调,以优化长尾分布数据的分类性能。

关键创新:NetMamba+的关键创新在于:1)首次将Mamba架构应用于网络流量分类领域,利用其高效的序列建模能力;2)提出了多模态流量表示方法,有效保留了关键的字节级特征,并消除了潜在的偏差;3)设计了标签分布感知的微调策略,显著提升了模型在长尾分布数据上的分类性能。

关键设计:在架构方面,NetMamba+采用了Mamba和Flash Attention的混合结构,以实现更高的计算效率。在多模态流量表示方面,具体的设计细节未知。在标签分布感知微调方面,可能采用了诸如重采样、重加权或者元学习等技术来平衡不同类别的数据分布。

🖼️ 关键图片

📊 实验亮点

NetMamba+在多个网络流量分类任务上取得了显著的性能提升。与最先进的基线模型相比,NetMamba+的F1得分提高了高达6.44%。同时,NetMamba+实现了1.7倍的推理吞吐量提升,且内存占用较低。此外,NetMamba+在小样本学习场景下表现出色,仅需少量标注数据即可达到较高的分类精度。在线流量分类系统实现了261.87 Mb/s的吞吐量,验证了其在实际应用中的可行性。

🎯 应用场景

NetMamba+可应用于各种网络安全和流量管理场景,例如入侵检测、恶意流量识别、服务质量监控和应用识别。该框架能够提升网络流量分析的效率和准确性,帮助网络管理员更好地理解和管理网络流量,从而提高网络安全性和服务质量。未来,NetMamba+有望成为构建智能网络安全防御体系的关键组成部分。

📄 摘要(原文)

With the rapid growth of encrypted network traffic, effective traffic classification has become essential for network security and quality of service management. Current machine learning and deep learning approaches for traffic classification face three critical challenges: computational inefficiency of Transformer architectures, inadequate traffic representations with loss of crucial byte-level features while retaining detrimental biases, and poor handling of long-tail distributions in real-world data. We propose NetMamba+, a framework that addresses these challenges through three key innovations: (1) an efficient architecture considering Mamba and Flash Attention mechanisms, (2) a multimodal traffic representation scheme that preserves essential traffic information while eliminating biases, and (3) a label distribution-aware fine-tuning strategy. Evaluation experiments on massive datasets encompassing four main classification tasks showcase NetMamba+'s superior classification performance compared to state-of-the-art baselines, with improvements of up to 6.44\% in F1 score. Moreover, NetMamba+ demonstrates excellent efficiency, achieving 1.7x higher inference throughput than the best baseline while maintaining comparably low memory usage. Furthermore, NetMamba+ exhibits superior few-shot learning abilities, achieving better classification performance with fewer labeled data. Additionally, we implement an online traffic classification system that demonstrates robust real-world performance with a throughput of 261.87 Mb/s. As the first framework to adapt Mamba architecture for network traffic classification, NetMamba+ opens new possibilities for efficient and accurate traffic analysis in complex network environments.