LLM4Fluid: Large Language Models as Generalizable Neural Solvers for Fluid Dynamics

作者: Qisong Xiao, Xinhai Chen, Qinglin Wang, Xiaowei Guo, Binglin Wang, Weifeng Chen, Zhichao Wang, Yunfei Liu, Rui Xia, Hang Zou, Gencheng Liu, Shuai Li, Jie Liu

分类: cs.LG, physics.flu-dyn

发布日期: 2026-01-29

🔗 代码/项目: GITHUB

💡 一句话要点

LLM4Fluid:利用大语言模型作为流体动力学通用神经求解器

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 流体动力学 大语言模型 深度学习 降阶建模 时空预测 通用求解器 零样本学习

📋 核心要点

- 现有流体动力学深度学习方法泛化性差,对新场景需重新训练,限制了应用。

- LLM4Fluid利用大语言模型作为时间处理器,结合物理信息解耦的降阶建模,实现通用求解。

- 实验表明,LLM4Fluid无需重新训练即可达到SOTA精度,并具备强大的零样本和上下文学习能力。

📝 摘要(中文)

深度学习已成为流体动力学时空建模的一种有前景的范例。然而,现有方法通常泛化能力有限,难以适应未见过的流动条件,并且在应用于新场景时通常需要重新训练。本文提出了LLM4Fluid,一个时空预测框架,它利用大型语言模型(LLM)作为流体动力学的通用神经求解器。该框架首先通过降阶建模(ROM)将高维流场压缩到紧凑的潜在空间,并结合物理信息解耦机制,有效缓解空间特征纠缠,同时保留必要的流动结构。然后,预训练的LLM作为时间处理器,通过时间序列提示自回归地预测物理序列的动态。为了弥合提示和物理序列之间的模态差距,否则会降低预测精度,我们提出了一种专门的模态对齐策略,以解决表征不匹配并稳定长期预测。在各种流动场景中进行的大量实验表明,LLM4Fluid可以作为一个鲁棒且通用的神经求解器,无需重新训练,在实现最先进精度的同时,还表现出强大的零样本和上下文学习能力。代码和数据集可在https://github.com/qisongxiao/LLM4Fluid公开获取。

🔬 方法详解

问题定义:现有基于深度学习的流体动力学建模方法,在面对新的流动条件或场景时,通常需要重新训练模型,泛化能力不足。这是因为流场数据维度高,特征复杂,难以有效提取和建模时空动态。

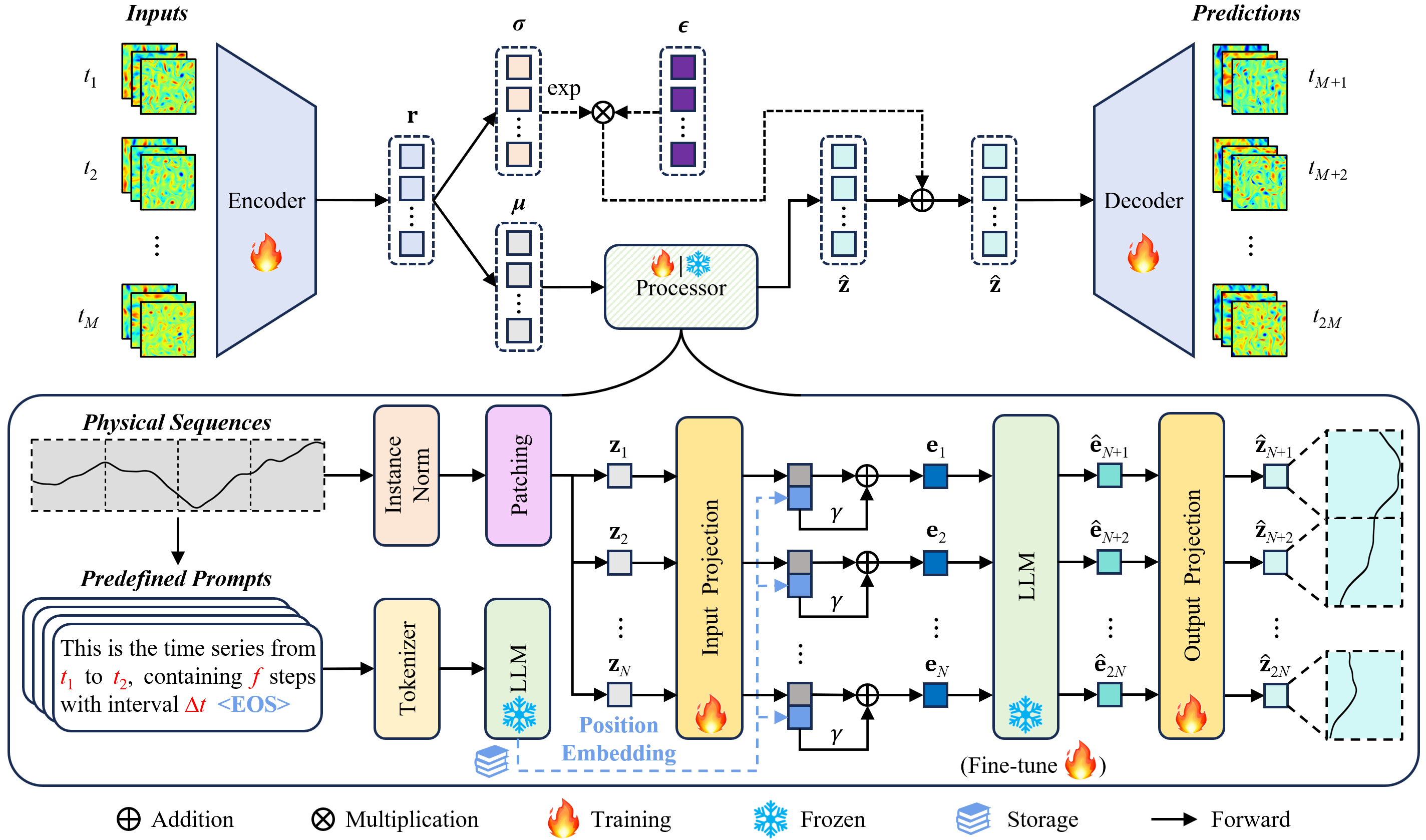

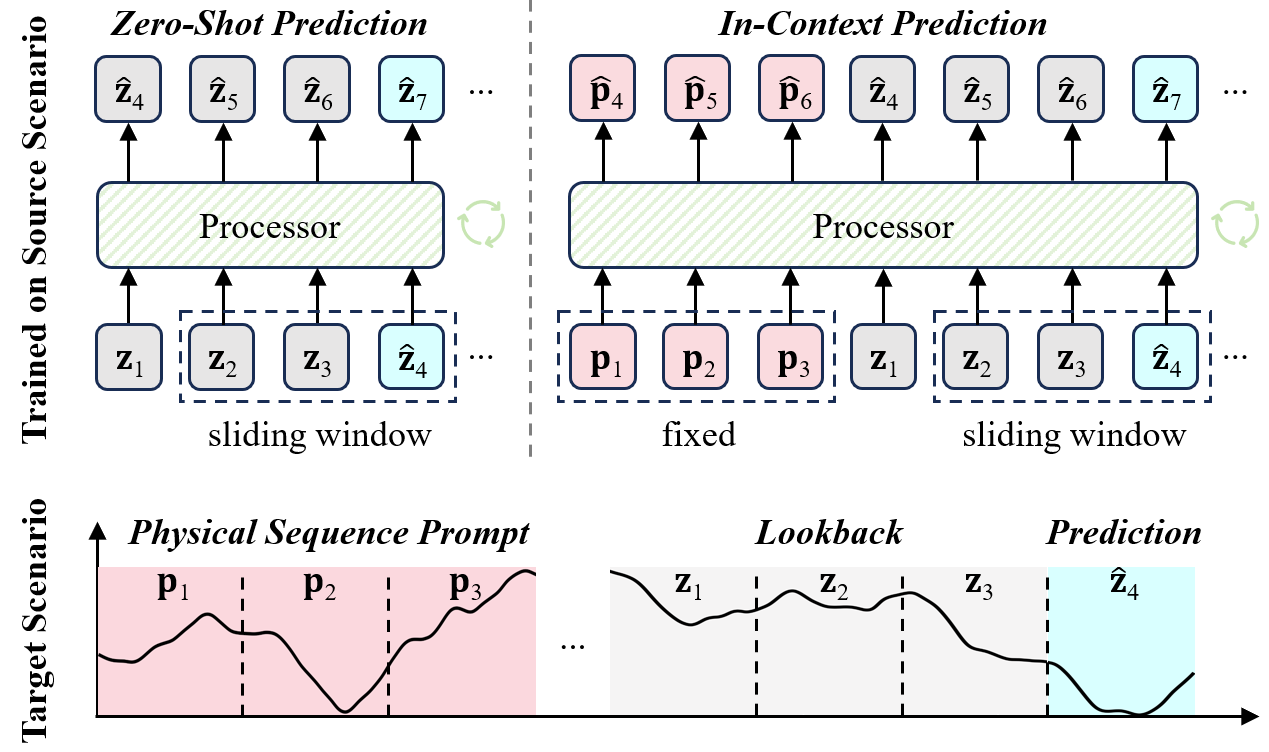

核心思路:LLM4Fluid的核心思路是利用预训练的大语言模型(LLM)强大的时序建模能力,将流体动力学问题转化为时间序列预测问题。通过降阶建模(ROM)压缩高维流场,并使用物理信息解耦机制,提取关键的物理特征,然后利用LLM进行时序预测,从而实现对不同流动场景的通用求解。

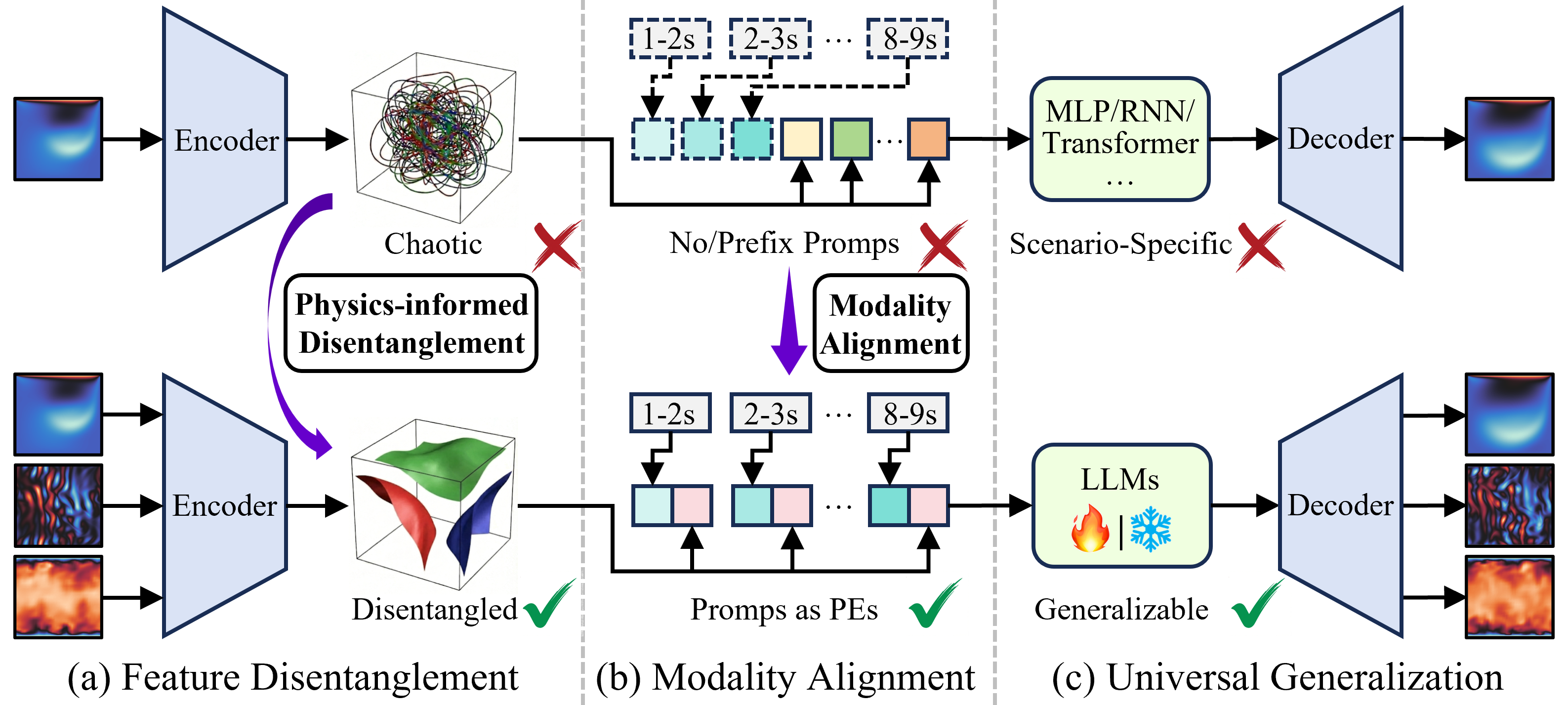

技术框架:LLM4Fluid框架包含三个主要模块:1) 降阶建模模块:使用自编码器结构,将高维流场压缩到低维潜在空间,并结合物理信息解耦损失,保证潜在空间包含关键的物理信息。2) 大语言模型模块:使用预训练的LLM作为时间处理器,接收降阶后的流场时间序列作为输入,自回归地预测未来的流场状态。3) 模态对齐模块:为了弥合LLM的文本模态和流场数据的模态差异,设计了模态对齐策略,包括表征对齐和损失函数设计,以提高预测精度和稳定性。

关键创新:该论文的关键创新在于将大语言模型应用于流体动力学建模,并提出了一套完整的框架来实现通用求解。与传统方法相比,LLM4Fluid无需针对特定场景进行重新训练,具有更强的泛化能力和零样本学习能力。此外,物理信息解耦机制和模态对齐策略也提高了模型的预测精度和稳定性。

关键设计:在降阶建模模块中,使用了物理信息解耦损失,鼓励自编码器学习到的潜在变量能够解耦不同的物理量,例如速度和压力。在模态对齐模块中,设计了对比学习损失,拉近LLM的文本表征和流场数据表征的距离。此外,还使用了时间序列prompt技术,将历史流场数据作为prompt输入LLM,引导LLM进行预测。

🖼️ 关键图片

📊 实验亮点

LLM4Fluid在多个流体动力学benchmark上取得了state-of-the-art的结果,无需针对特定场景进行重新训练。实验结果表明,LLM4Fluid在零样本学习和上下文学习方面表现出色,能够泛化到未见过的流动条件。与传统方法相比,LLM4Fluid在预测精度和泛化能力方面均有显著提升。

🎯 应用场景

LLM4Fluid在航空航天、汽车工程、能源等领域具有广泛的应用前景。例如,可以用于飞行器气动性能预测、汽车空气动力学优化、风力发电机叶片设计等。该研究有望加速流体动力学仿真和优化设计过程,降低研发成本,并为复杂流动问题的研究提供新的思路。

📄 摘要(原文)

Deep learning has emerged as a promising paradigm for spatio-temporal modeling of fluid dynamics. However, existing approaches often suffer from limited generalization to unseen flow conditions and typically require retraining when applied to new scenarios. In this paper, we present LLM4Fluid, a spatio-temporal prediction framework that leverages Large Language Models (LLMs) as generalizable neural solvers for fluid dynamics. The framework first compresses high-dimensional flow fields into a compact latent space via reduced-order modeling enhanced with a physics-informed disentanglement mechanism, effectively mitigating spatial feature entanglement while preserving essential flow structures. A pretrained LLM then serves as a temporal processor, autoregressively predicting the dynamics of physical sequences with time series prompts. To bridge the modality gap between prompts and physical sequences, which can otherwise degrade prediction accuracy, we propose a dedicated modality alignment strategy that resolves representational mismatch and stabilizes long-term prediction. Extensive experiments across diverse flow scenarios demonstrate that LLM4Fluid functions as a robust and generalizable neural solver without retraining, achieving state-of-the-art accuracy while exhibiting powerful zero-shot and in-context learning capabilities. Code and datasets are publicly available at https://github.com/qisongxiao/LLM4Fluid.