Reinforcement Learning for Adaptive Composition of Quantum Circuit Optimisation Passes

作者: Daniel Mills, Ifan Williams, Jacob Swain, Gabriel Matos, Enrico Rinaldi, Alexander Koziell-Pipe

分类: quant-ph, cs.LG

发布日期: 2026-01-29

备注: 14 pages, 7 figures

💡 一句话要点

提出基于强化学习的量子电路优化Pass自适应组合方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 量子电路优化 强化学习 量子算法 自适应优化 量子计算

📋 核心要点

- 现有量子电路优化依赖人工设计的通用Pass序列,忽略了电路特性,优化效果受限。

- 利用强化学习Agent自动探索最优Pass序列,针对特定电路进行自适应优化。

- 实验表明,该方法在减少双量子比特门数量方面优于现有默认Pass序列。

📝 摘要(中文)

许多量子软件开发工具包提供了一套电路优化Pass。这些Pass在隔离状态下经过了高度优化和测试。然而,它们的应用顺序通常由用户决定,或者采用通用的默认Pass序列。虽然通用序列会错过针对特定电路的优化机会,但为特定电路设计定制的Pass序列需要量子电路设计和优化方面的专业知识。本文提出并演示了训练强化学习Agent来组合优化Pass序列的方法。具体而言,Agent的动作空间由PyTKET默认Pass序列中用于双量子比特门数量减少的Pass组成。对于我们多样化的测试集中的电路,Agent移除的双量子比特门的(平均值,中位数)百分比为(57.7%,56.7%),而次优的默认Pass序列为(41.8%,50.0%)。

🔬 方法详解

问题定义:量子电路优化旨在减少量子门的数量,从而提高量子算法的效率和保真度。现有的量子软件开发工具包通常提供一系列优化Pass,但这些Pass的应用顺序通常是固定的或由用户手动选择。这种方法忽略了不同量子电路的特性,导致优化效果不佳。为每个电路手动设计最佳Pass序列需要专业的量子计算知识,成本高昂。

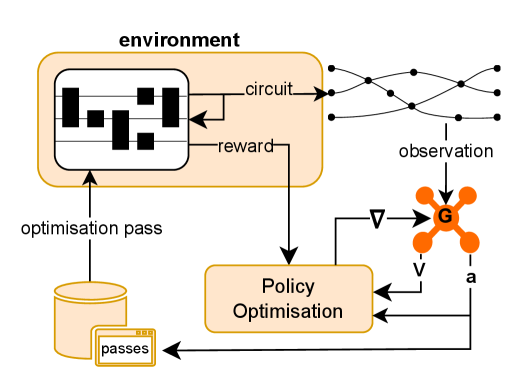

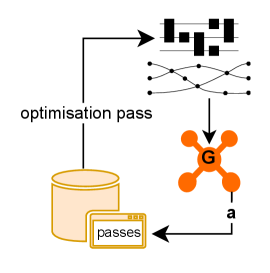

核心思路:本文的核心思路是利用强化学习(RL)Agent来自动学习量子电路优化Pass的最佳组合序列。Agent通过与量子电路环境交互,根据电路的当前状态选择一个优化Pass,并观察电路状态的变化(例如,量子门数量的减少)。通过不断试错,Agent学习到一个策略,该策略能够最大化电路的优化效果。

技术框架:该方法的技术框架主要包括以下几个部分:1)量子电路环境:模拟量子电路的运行和优化过程,并提供电路状态信息。2)强化学习Agent:负责选择优化Pass,并根据环境的反馈更新策略。3)奖励函数:用于评估Agent选择的Pass序列的优化效果,例如,量子门数量的减少。4)优化Pass集合:包含一系列预定义的量子电路优化Pass,Agent可以从中选择。Agent通过与环境交互,学习一个策略 π(a|s),该策略表示在给定状态 s 下选择动作 a(即选择一个优化Pass)的概率。

关键创新:该方法最重要的技术创新点在于利用强化学习自动探索量子电路优化Pass的最佳组合序列,从而避免了手动设计Pass序列的复杂性和局限性。与传统的固定Pass序列方法相比,该方法能够根据特定电路的特性进行自适应优化,从而获得更好的优化效果。

关键设计:Agent的动作空间由PyTKET默认Pass序列中用于双量子比特门数量减少的Pass组成。奖励函数设计为电路中双量子比特门数量的减少量。具体使用的强化学习算法未知,但常见的选择包括Q-learning、SARSA或Policy Gradient方法。状态表示未知,但可能包括电路的拓扑结构、量子门类型和数量等信息。

🖼️ 关键图片

📊 实验亮点

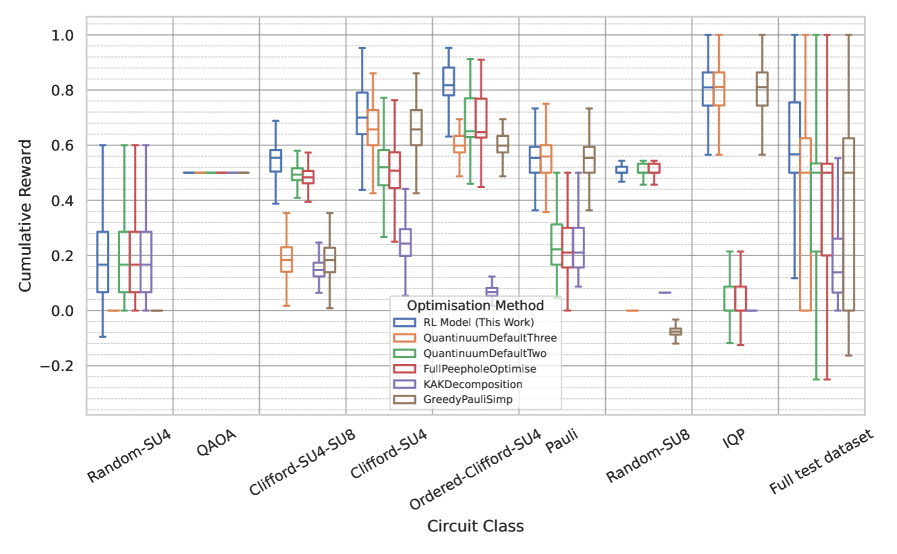

实验结果表明,该方法在减少双量子比特门数量方面优于现有的默认Pass序列。对于测试集中的电路,Agent移除的双量子比特门的(平均值,中位数)百分比为(57.7%,56.7%),而次优的默认Pass序列为(41.8%,50.0%)。这表明该方法能够有效地优化量子电路,提高量子算法的性能。

🎯 应用场景

该研究成果可应用于量子计算领域,通过自动优化量子电路,提高量子算法的效率和保真度,加速量子计算机的实际应用。该方法可以集成到现有的量子软件开发工具包中,为量子算法开发者提供更便捷的优化工具,降低量子编程的门槛。

📄 摘要(原文)

Many quantum software development kits provide a suite of circuit optimisation passes. These passes have been highly optimised and tested in isolation. However, the order in which they are applied is left to the user, or else defined in general-purpose default pass sequences. While general-purpose sequences miss opportunities for optimisation which are particular to individual circuits, designing pass sequences bespoke to particular circuits requires exceptional knowledge about quantum circuit design and optimisation. Here we propose and demonstrate training a reinforcement learning agent to compose optimisation-pass sequences. In particular the agent's action space consists of passes for two-qubit gate count reduction used in default PyTKET pass sequences. For the circuits in our diverse test set, the (mean, median) fraction of two-qubit gates removed by the agent is $(57.7\%, \ 56.7 \%)$, compared to $(41.8 \%, \ 50.0 \%)$ for the next best default pass sequence.