Learning the Mechanism of Catastrophic Forgetting: A Perspective from Gradient Similarity

作者: Mutian Yang, Zisen Zhan, Yutong Chen, Haolin Li, Kaiwen Wang, Kaili Zheng, Yuguang Wang, Qi Wang, Jiandong Gao, Ji Wu

分类: cs.LG

发布日期: 2026-01-29

💡 一句话要点

基于梯度相似性的协同神经学习,缓解大型语言模型中的灾难性遗忘

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灾难性遗忘 持续学习 梯度相似性 大型语言模型 知识注入

📋 核心要点

- 大型语言模型在持续学习中面临灾难性遗忘问题,现有方法缺乏理论支撑,难以有效缓解。

- 论文提出协同神经学习(CNL),通过冻结冲突神经元、更新协作神经元来减少遗忘。

- 实验表明,CNL在多种LLM和数据集上显著降低了灾难性遗忘,甚至在特定设置下实现了零遗忘。

📝 摘要(中文)

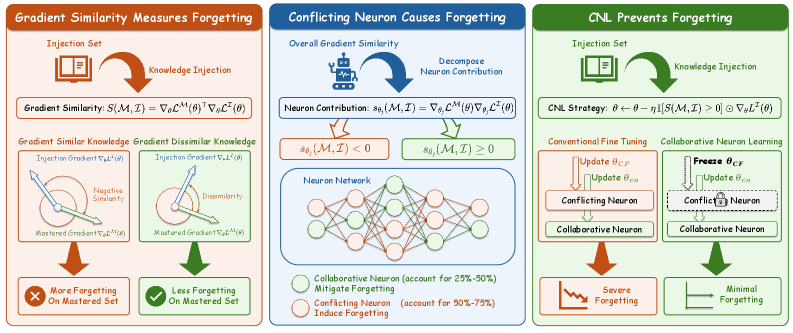

知识注入过程中的灾难性遗忘严重削弱了大型语言模型(LLMs)的持续学习能力。尽管现有方法试图缓解这个问题,但它们通常缺乏基础的理论解释。本文建立了一个基于梯度的理论框架来解释灾难性遗忘。首先证明了强负梯度相似性是遗忘的根本原因。然后,利用梯度相似性识别出两种类型的神经元:导致遗忘的冲突神经元(占50%-75%)和减轻遗忘的协作神经元(占25%-50%)。基于此分析,提出了一种知识注入方法,即协同神经学习(CNL)。通过冻结冲突神经元并仅更新协作神经元,CNL在无穷小学习率 eta 和精确已知的主数据集下,理论上消除了灾难性遗忘。在五个LLM、四个数据集和四个优化器上的实验表明,CNL在内部设置中实现了零遗忘,并在外部设置中将遗忘减少了59.1%-81.7%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在知识注入过程中出现的灾难性遗忘问题。现有方法虽然尝试缓解,但缺乏理论基础,无法有效识别和处理导致遗忘的关键因素,导致模型在学习新知识时忘记旧知识。

核心思路:论文的核心思路是通过分析梯度相似性来识别导致遗忘的神经元(冲突神经元)和减轻遗忘的神经元(协作神经元)。然后,通过冻结冲突神经元,只更新协作神经元,从而在学习新知识的同时,尽可能保留旧知识。

技术框架:CNL方法包含以下主要步骤:1) 使用梯度相似性分析识别冲突神经元和协作神经元;2) 冻结冲突神经元,使其参数不再更新;3) 使用新数据训练模型,只更新协作神经元的参数。该框架旨在最小化新知识对旧知识的影响,从而减少灾难性遗忘。

关键创新:论文的关键创新在于提出了基于梯度相似性的神经元分类方法,并基于此设计了协同神经学习策略。与现有方法不同,CNL不是简单地正则化或重放旧数据,而是直接干预神经元的更新过程,从而更有效地控制遗忘。

关键设计:关键设计包括:1) 梯度相似性的计算方法,用于区分冲突神经元和协作神经元;2) 冲突神经元的冻结策略,确保其参数在训练过程中保持不变;3) 协作神经元的更新策略,使用标准的反向传播算法更新其参数。论文还理论上证明了在特定条件下,CNL可以消除灾难性遗忘。

🖼️ 关键图片

📊 实验亮点

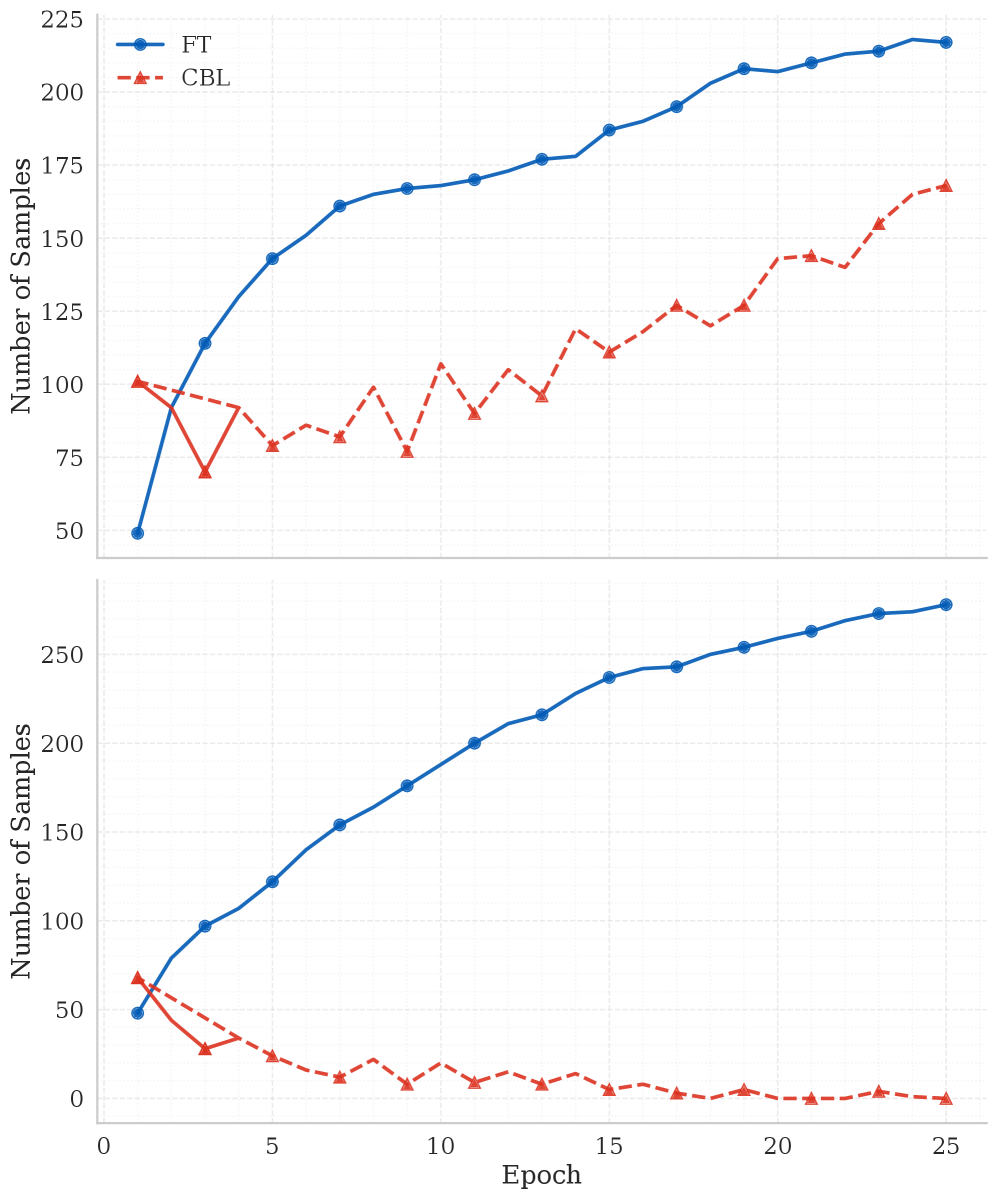

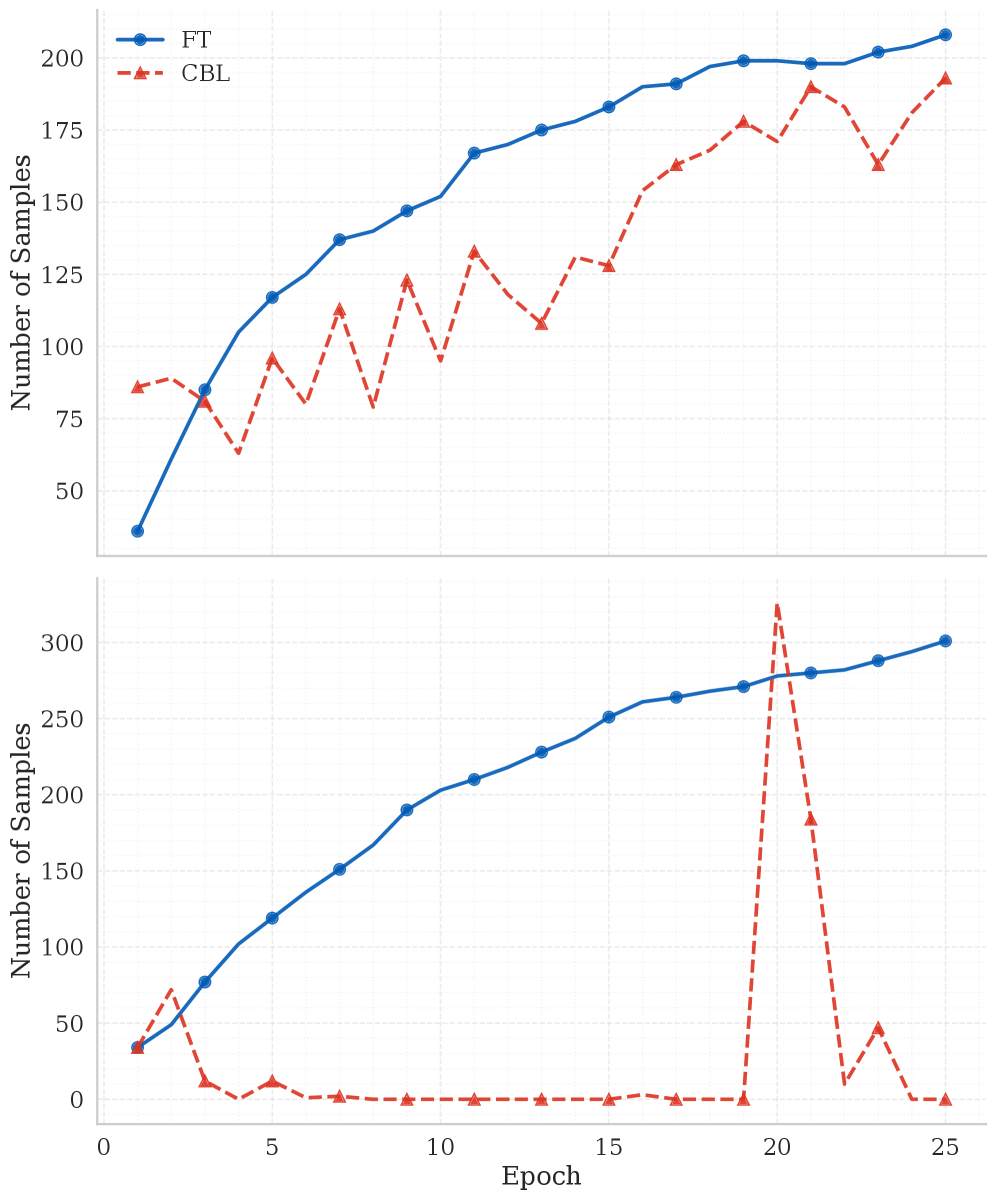

实验结果表明,CNL在五个LLM、四个数据集和四个优化器上均取得了显著的性能提升。在内部设置中,CNL实现了零遗忘。在外部设置中,CNL将遗忘减少了59.1%-81.7%。这些结果表明,CNL是一种有效的缓解灾难性遗忘的方法,并且具有良好的泛化能力。

🎯 应用场景

该研究成果可应用于需要持续学习的各种大型语言模型,例如对话系统、知识图谱更新、机器翻译等。通过减少灾难性遗忘,可以提高模型在不断学习新知识的同时,保持原有知识的能力,从而提升模型的整体性能和泛化能力。未来的研究可以探索更有效的神经元分类方法和更精细的更新策略。

📄 摘要(原文)

Catastrophic forgetting during knowledge injection severely undermines the continual learning capability of large language models (LLMs). Although existing methods attempt to mitigate this issue, they often lack a foundational theoretical explanation. We establish a gradient-based theoretical framework to explain catastrophic forgetting. We first prove that strongly negative gradient similarity is a fundamental cause of forgetting. We then use gradient similarity to identify two types of neurons: conflicting neurons that induce forgetting and account for 50%-75% of neurons, and collaborative neurons that mitigate forgetting and account for 25%-50%. Based on this analysis, we propose a knowledge injection method, Collaborative Neural Learning (CNL). By freezing conflicting neurons and updating only collaborative neurons, CNL theoretically eliminates catastrophic forgetting under an infinitesimal learning rate eta and an exactly known mastered set. Experiments on five LLMs, four datasets, and four optimizers show that CNL achieves zero forgetting in in-set settings and reduces forgetting by 59.1%-81.7% in out-of-set settings.