PatchFormer: A Patch-Based Time Series Foundation Model with Hierarchical Masked Reconstruction and Cross-Domain Transfer Learning for Zero-Shot Multi-Horizon Forecasting

作者: Olaf Yunus Laitinen Imanov, Derya Umut Kulali, Taner Yilmaz

分类: cs.LG, eess.SP

发布日期: 2026-01-28

备注: 5 pages; 2 figures; 7 tables

💡 一句话要点

PatchFormer:基于分层掩码重建和跨域迁移学习的时间序列基础模型,用于零样本多步预测。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 基础模型 自监督学习 掩码重建 跨域迁移学习

📋 核心要点

- 现有时间序列预测方法依赖于领域特定的特征工程,且需要大量标注数据,泛化能力不足。

- PatchFormer将时间序列分割成patch,通过分层掩码重建和跨域知识蒸馏进行自监督预训练,学习通用的时间序列表示。

- 实验表明,PatchFormer在多个领域数据集上实现了最先进的零样本多步预测,显著降低了预测误差,并减少了对任务特定数据的依赖。

📝 摘要(中文)

本文提出了一种基于patch的时间序列基础模型PatchFormer,用于解决时间序列预测问题。该模型采用分层掩码重建进行自监督预训练,并使用轻量级适配器实现高效迁移。PatchFormer将时间序列分割成patch,并通过可学习的聚合方式学习多尺度时间表示。预训练过程采用动态掩码的掩码patch重建,并设计了鼓励局部准确性和全局一致性的目标函数,随后进行跨域知识蒸馏。在涵盖天气、能源、交通、金融和医疗保健的24个基准数据集上的实验表明,该模型实现了最先进的零样本多步预测,相对于强基线,均方误差降低了27.3%,同时减少了94%的任务特定训练数据。该模型在高达1000亿个数据点的预训练数据下表现出接近对数线性的扩展性,并且处理长度为512的序列的速度比全序列Transformer快3.8倍。

🔬 方法详解

问题定义:时间序列预测在气候、能源、医疗和金融等领域具有广泛的应用。现有的方法通常需要针对特定领域进行特征工程,并且需要大量的标注数据进行训练,这限制了它们在新的、数据稀缺的场景中的应用。因此,如何构建一个通用的、能够零样本迁移的时间序列预测模型是一个重要的挑战。

核心思路:PatchFormer的核心思路是借鉴自然语言处理中的Transformer模型,将时间序列分割成patch,然后通过自监督学习的方式学习patch之间的关系,从而获得时间序列的通用表示。通过分层掩码重建,模型能够学习到不同时间尺度上的信息,并通过跨域知识蒸馏,将知识从一个领域迁移到另一个领域,从而实现零样本预测。

技术框架:PatchFormer的整体框架包括三个主要阶段:patch嵌入、分层掩码重建预训练和跨域知识蒸馏。首先,时间序列被分割成patch,并通过线性层进行嵌入。然后,模型使用Transformer编码器学习patch之间的关系,并使用分层掩码重建目标进行自监督预训练。最后,模型使用轻量级适配器将学习到的知识迁移到新的领域,并通过知识蒸馏进一步提高性能。

关键创新:PatchFormer的关键创新在于以下几个方面:1) 基于patch的时间序列表示,能够有效地处理长序列;2) 分层掩码重建,能够学习到不同时间尺度上的信息;3) 跨域知识蒸馏,能够实现零样本预测;4) 动态掩码策略,提高了模型的鲁棒性。

关键设计:PatchFormer的关键设计包括:1) Patch大小的选择,需要根据时间序列的特性进行调整;2) 掩码比例的选择,需要平衡重建的难度和模型的学习能力;3) 损失函数的设计,包括局部准确性损失和全局一致性损失;4) 适配器的设计,需要保证模型的迁移能力和效率。

🖼️ 关键图片

📊 实验亮点

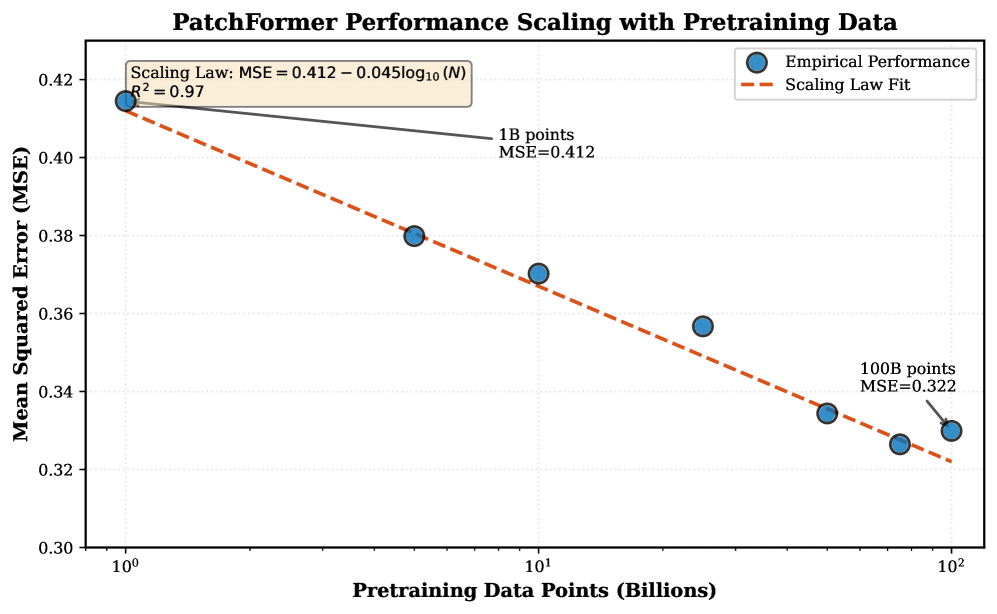

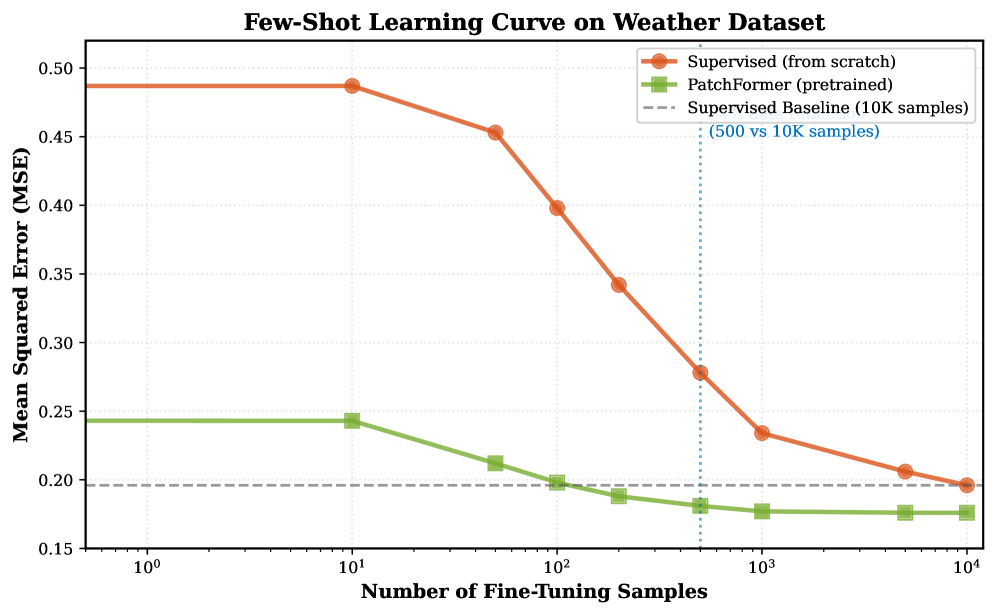

PatchFormer在24个基准数据集上进行了评估,涵盖了天气、能源、交通、金融和医疗保健等多个领域。实验结果表明,PatchFormer在零样本多步预测任务上取得了最先进的性能,相对于强基线,均方误差降低了27.3%,同时减少了94%的任务特定训练数据。此外,该模型在高达1000亿个数据点的预训练数据下表现出接近对数线性的扩展性,并且处理长度为512的序列的速度比全序列Transformer快3.8倍。

🎯 应用场景

PatchFormer具有广泛的应用前景,例如在气候预测中,可以用于预测未来的天气变化;在能源管理中,可以用于预测电力需求;在医疗保健中,可以用于预测患者的病情发展;在金融领域,可以用于预测股票价格。该研究的实际价值在于降低了时间序列预测对标注数据的依赖,提高了模型的泛化能力,为各个领域提供了更准确、更可靠的预测结果。未来,该模型可以进一步扩展到多变量时间序列预测、异常检测等任务。

📄 摘要(原文)

Time series forecasting is a fundamental problem with applications in climate, energy, healthcare, and finance. Many existing approaches require domain-specific feature engineering and substantial labeled data for each task. We introduce PatchFormer, a patch-based time series foundation model that uses hierarchical masked reconstruction for self-supervised pretraining and lightweight adapters for efficient transfer. PatchFormer segments time series into patches and learns multiscale temporal representations with learnable aggregation across temporal scales. Pretraining uses masked patch reconstruction with dynamic masking and objectives that encourage both local accuracy and global consistency, followed by cross-domain knowledge distillation. Experiments on 24 benchmark datasets spanning weather, energy, traffic, finance, and healthcare demonstrate state-of-the-art zero-shot multi-horizon forecasting, reducing mean squared error by 27.3 percent relative to strong baselines while requiring 94 percent less task-specific training data. The model exhibits near log-linear scaling with more pretraining data up to 100 billion points and processes length-512 sequences 3.8x faster than full-sequence transformers.