A Foundation Model for Virtual Sensors

作者: Leon Götz, Lars Frederik Peiss, Erik Sauer, Andreas Udo Sass, Thorsten Bagdonat, Stephan Günnemann, Leo Schwinn

分类: cs.LG

发布日期: 2026-01-28

备注: 18 pages in total, 15 figures

💡 一句话要点

提出用于虚拟传感器的基础模型,解决现有方法计算开销大、泛化性弱的问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 虚拟传感器 基础模型 时间序列预测 多任务学习 传感器网络

📋 核心要点

- 现有虚拟传感器方法依赖于特定应用的模型和手工选择的输入,缺乏任务协同和统一的评估标准。

- 论文提出一种统一的虚拟传感器基础模型,能够同时预测多个传感器,自动学习相关输入,并提高计算效率。

- 实验结果表明,该模型在计算时间和内存需求上显著优于现有方法,同时保持或提升了预测精度。

📝 摘要(中文)

本文提出了一种用于虚拟传感器的基础模型,旨在解决现有方法中存在的应用特定模型、手工选择输入、缺乏任务协同以及计算开销大的问题。该模型能够同时预测多种虚拟传感器,利用任务间的协同效应,并保持计算效率。模型能够自动学习每个虚拟传感器的相关输入信号,无需专家知识,并增加了解释性。在标准基准测试和包含超过180亿个样本的应用特定数据集上的大规模评估表明,该架构在保持甚至提高预测质量的同时,计算时间减少了415倍,内存需求减少了951倍。该模型能够优雅地扩展到数百个虚拟传感器,且参数数量几乎保持不变,从而可以在大规模传感器网络中进行实际部署。

🔬 方法详解

问题定义:现有的虚拟传感器方法需要为每个传感器构建特定的模型,并且需要人工选择输入特征,这导致了较高的开发成本和较差的泛化能力。此外,现有方法无法利用不同传感器之间的任务协同效应,并且缺乏统一的基准进行评估。新兴的时间序列基础模型虽然具有潜力,但计算开销巨大,且主要用于预测输入信号,与虚拟传感器的应用场景不兼容。

核心思路:本文的核心思路是构建一个通用的基础模型,该模型能够同时预测多个虚拟传感器,并自动学习每个传感器的相关输入信号。通过共享底层表示,模型可以利用不同传感器之间的任务协同效应,从而提高预测精度和泛化能力。此外,模型的设计注重计算效率,使其能够在大规模传感器网络中进行实际部署。

技术框架:该模型采用一种统一的架构,可以同时处理来自多个物理传感器的输入,并预测多个虚拟传感器的输出。整体流程包括:1) 输入数据预处理;2) 通过共享的编码器提取输入特征;3) 使用特定于每个虚拟传感器的解码器进行预测;4) 计算损失并进行反向传播以更新模型参数。

关键创新:该论文的关键创新在于提出了第一个用于虚拟传感器的基础模型。该模型能够自动学习每个虚拟传感器的相关输入信号,无需人工干预,并利用任务协同效应提高预测精度。此外,该模型在计算效率方面进行了优化,使其能够在大规模传感器网络中进行实际部署。

关键设计:模型的关键设计包括:1) 使用共享的编码器提取输入特征,以利用任务协同效应;2) 使用轻量级的解码器进行预测,以提高计算效率;3) 采用合适的损失函数来优化模型参数,例如均方误差或交叉熵损失;4) 通过调整网络结构和参数数量来平衡预测精度和计算开销。具体的网络结构和参数设置未知,需要参考论文细节。

🖼️ 关键图片

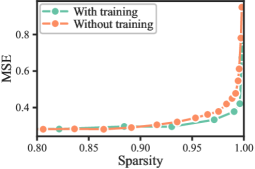

📊 实验亮点

该模型在标准基准测试和包含超过180亿个样本的应用特定数据集上进行了大规模评估。实验结果表明,该架构在保持甚至提高预测质量的同时,计算时间减少了415倍,内存需求减少了951倍。此外,该模型能够优雅地扩展到数百个虚拟传感器,且参数数量几乎保持不变。

🎯 应用场景

该研究成果可广泛应用于工业自动化、智能制造、环境监测、智慧城市等领域。通过部署虚拟传感器,可以降低硬件成本,提高系统可靠性,并实现对复杂系统的实时监控和预测。例如,在工业生产中,可以使用虚拟传感器预测设备状态,实现预防性维护,减少停机时间。在环境监测中,可以使用虚拟传感器预测空气质量,为城市管理提供决策支持。

📄 摘要(原文)

Virtual sensors use machine learning to predict target signals from available measurements, replacing expensive physical sensors in critical applications. Existing virtual sensor approaches require application-specific models with hand-selected inputs for each sensor, cannot leverage task synergies, and lack consistent benchmarks. At the same time, emerging time series foundation models are computationally expensive and limited to predicting their input signals, making them incompatible with virtual sensors. We introduce the first foundation model for virtual sensors addressing both limitations. Our unified model can simultaneously predict diverse virtual sensors exploiting synergies while maintaining computational efficiency. It learns relevant input signals for each virtual sensor, eliminating expert knowledge requirements while adding explainability. In our large-scale evaluation on a standard benchmark and an application-specific dataset with over 18 billion samples, our architecture achieves 415x reduction in computation time and 951x reduction in memory requirements, while maintaining or even improving predictive quality compared to baselines. Our model scales gracefully to hundreds of virtual sensors with nearly constant parameter count, enabling practical deployment in large-scale sensor networks.