Out-of-Distribution Generalization via Invariant Trajectories for Multimodal Large Language Model Editing

作者: Jiajie Su, Haoyuan Wang, Xiaohua Feng, Yunshan Ma, Xiaobo Xia, Yuyuan Li, Xiaolin Zheng, Jianmao Xiao, Chaochao Chen

分类: cs.LG, cs.AI

发布日期: 2026-01-27

💡 一句话要点

提出ODEdit,通过不变轨迹学习提升多模态大语言模型知识编辑的泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 知识编辑 分布外泛化 不变学习 因果推理

📋 核心要点

- 现有单模态LLM编辑方法在多模态场景下存在因果欠拟合和过拟合问题,限制了编辑效果。

- ODEdit将MLLM编辑视为OOD泛化问题,通过学习不变因果轨迹来提升编辑的鲁棒性。

- 实验结果表明,ODEdit能有效提高编辑的可靠性、局部性和通用性,具有显著优势。

📝 摘要(中文)

知识编辑是有效修正大语言模型(LLM)中错误或过时知识的关键技术。现有的单模态LLM编辑方法依赖于刚性的参数-输出映射,这会导致多模态LLM(MLLM)级联推理中的因果欠拟合和因果过拟合。本文将MLLM编辑重新定义为分布外(OOD)泛化问题,目标是区分语义偏移和事实偏移,从而在不同的跨模态提示中实现鲁棒的编辑。该OOD问题的关键挑战在于识别能够准确泛化并抑制虚假相关性的不变因果轨迹。为了解决这个问题,我们提出了ODEdit,一个基于不变学习的即插即用框架,它优化了三方OOD风险目标,以同时提高编辑的可靠性、局部性和通用性。我们进一步引入了一种编辑轨迹不变学习方法,该方法将全变分惩罚纳入风险最小化目标,以稳定编辑轨迹,使其免受环境变化的影响。理论分析和大量实验证明了ODEdit的有效性。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLM)知识编辑中,由于现有方法依赖刚性参数-输出映射而导致的因果欠拟合和因果过拟合问题。这种问题在级联推理场景下尤为突出,使得编辑后的模型在面对新的跨模态提示时,无法保持编辑的一致性和准确性。现有方法难以区分语义偏移和事实偏移,导致编辑的泛化能力不足。

核心思路:论文的核心思路是将MLLM编辑问题重新定义为一个分布外(OOD)泛化问题。通过识别和学习不变的因果轨迹,模型能够区分语义偏移和事实偏移,从而在不同的跨模态提示下实现鲁棒的编辑。这种方法旨在抑制虚假相关性,并确保编辑后的知识能够泛化到新的场景中。

技术框架:ODEdit是一个即插即用的框架,主要包含以下几个关键模块:1) 三方OOD风险最小化模块:该模块旨在同时优化编辑的可靠性、局部性和通用性。2) 编辑轨迹不变学习模块:该模块通过引入全变分惩罚来稳定编辑轨迹,使其免受环境变化的影响。整体流程是,首先利用三方OOD风险最小化模块进行初步的编辑,然后通过编辑轨迹不变学习模块对编辑结果进行优化,最终得到具有良好泛化能力的编辑模型。

关键创新:论文最重要的技术创新点在于将MLLM编辑问题重新定义为OOD泛化问题,并提出了一种基于不变学习的解决方案。与现有方法不同,ODEdit关注的是学习不变的因果轨迹,而不是简单地修改模型参数。这种方法能够更好地应对跨模态提示的变化,并提高编辑的泛化能力。

关键设计:ODEdit的关键设计包括:1) 三方OOD风险目标:该目标函数同时考虑了编辑的可靠性、局部性和通用性,通过平衡这三个方面的性能来提高整体的编辑效果。2) 全变分惩罚:该惩罚项被引入到风险最小化目标中,用于稳定编辑轨迹,使其免受环境变化的影响。具体而言,全变分惩罚可以约束编辑轨迹的平滑性,从而减少噪声和不确定性对编辑结果的影响。

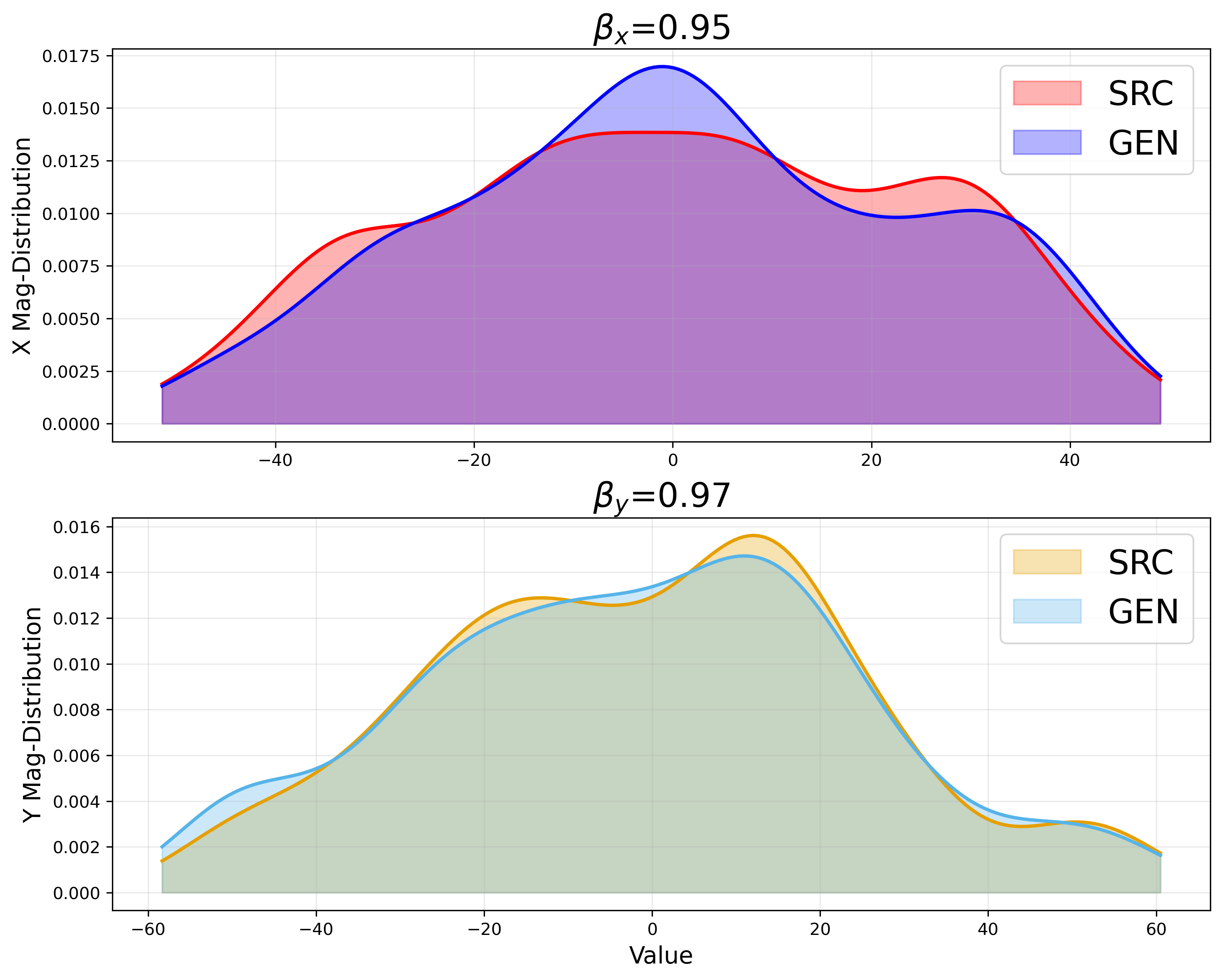

🖼️ 关键图片

📊 实验亮点

论文通过大量实验验证了ODEdit的有效性。实验结果表明,ODEdit在编辑的可靠性、局部性和通用性方面均优于现有方法。具体的性能提升数据在论文中进行了详细的展示和分析,证明了ODEdit在多模态大语言模型知识编辑方面的显著优势。

🎯 应用场景

该研究成果可应用于各种需要知识编辑的多模态大语言模型应用场景,例如智能问答、图像描述生成、视觉推理等。通过提高知识编辑的可靠性和泛化能力,可以有效提升这些应用在实际场景中的表现,并减少模型产生错误或过时信息的风险。未来,该方法有望扩展到更复杂的知识编辑任务和更广泛的多模态模型。

📄 摘要(原文)

Knowledge editing emerges as a crucial technique for efficiently correcting incorrect or outdated knowledge in large language models (LLM). Existing editing methods for unimodal LLM rely on a rigid parameter-to-output mapping, which causes causal-underfit and causal-overfit in cascaded reasoning for Multimodal LLM (MLLM). In this paper, we reformulate MLLM editing as an out-of-distribution (OOD) generalization problem, where the goal is to discern semantic shift with factual shift and thus achieve robust editing among diverse cross-modal prompting. The key challenge of this OOD problem lies in identifying invariant causal trajectories that generalize accurately while suppressing spurious correlations. To address it, we propose ODEdit, a plug-and-play invariant learning based framework that optimizes the tripartite OOD risk objective to simultaneously enhance editing reliability, locality, and generality.We further introduce an edit trajectory invariant learning method, which integrates a total variation penalty into the risk minimization objective to stabilize edit trajectories against environmental variations. Theoretical analysis and extensive experiments demonstrate the effectiveness of ODEdit.