The Geometric Mechanics of Contrastive Representation Learning: Alignment Potentials, Entropic Dispersion, and Cross-Modal Divergence

作者: Yichao Cai, Zhen Zhang, Yuhang Liu, Javen Qinfeng Shi

分类: cs.LG

发布日期: 2026-01-27

💡 一句话要点

通过几何力学分析对比表示学习,揭示对齐势、熵扩散和跨模态散度的内在联系

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对比学习 表示学习 几何力学 测度论 能量景观 多模态学习 InfoNCE 分布对齐

📋 核心要点

- 现有对比学习方法对InfoNCE的几何机制理解不足,缺乏对表示分布演化的深入分析。

- 该论文提出了一种测度论框架,将对比学习建模为表示测度在嵌入流形上的演化过程,并分析了其能量景观。

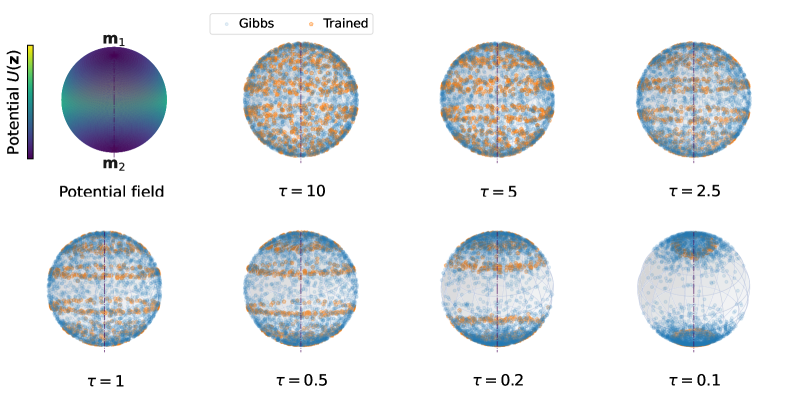

- 研究揭示了单峰和多峰状态之间的几何分岔,以及熵在单峰情况下的作用,并解释了多模态学习中模态差距的成因。

📝 摘要(中文)

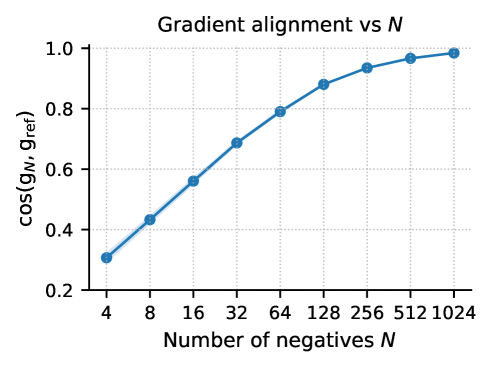

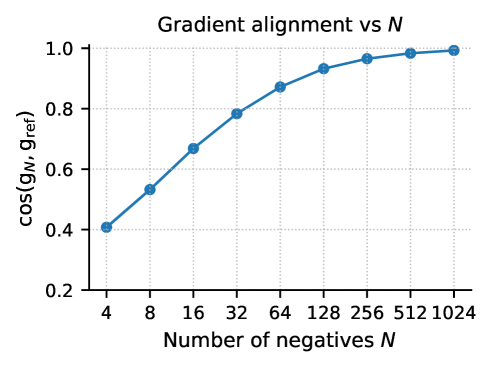

虽然InfoNCE驱动了现代对比学习,但除了标准的对齐-均匀性分解之外,其几何机制仍未得到充分描述。我们提出了一个测度论框架,将学习建模为表示测度在固定嵌入流形上的演化。通过建立大批量限制下的值和梯度一致性,我们将随机目标与显式确定性能量景观联系起来,揭示了单峰和多峰状态之间的一个基本几何分岔。在单峰设置中,内在景观是严格凸的,具有唯一的吉布斯平衡;在这里,熵仅仅充当一个决胜因素,将“均匀性”阐明为对齐盆地内的约束扩展。相比之下,对称多峰目标包含一个持久的负对称散度项,即使在核锐化之后仍然存在。我们表明,该项诱导了屏障驱动的协同适应,强制执行群体层面的模态差距,这是一种结构几何的必然性,而不是初始化伪影。我们的结果将分析视角从逐点判别转移到群体几何,为诊断和控制分布错位提供了一个原则性基础。

🔬 方法详解

问题定义:现有对比学习方法,特别是基于InfoNCE的方法,虽然在各种任务中表现出色,但对其内在的几何机制理解不足。现有的对齐-均匀性分解虽然提供了一些见解,但未能充分解释表示分布的演化过程,以及不同模态之间如何协同适应。因此,需要更深入地理解对比学习的几何特性,以便更好地设计和控制学习过程。

核心思路:该论文的核心思路是将对比学习视为表示测度在固定嵌入流形上的演化过程。通过引入测度论框架,可以将随机优化目标转化为确定性的能量景观,从而分析学习过程的几何特性。这种方法允许研究者从群体几何的角度理解对比学习,而不仅仅是逐点判别。

技术框架:该论文的技术框架主要包括以下几个步骤:1) 建立测度论模型,将表示学习视为表示测度在嵌入流形上的演化。2) 在大批量限制下,建立随机目标与确定性能量景观之间的联系。3) 分析能量景观的几何特性,特别是单峰和多峰状态之间的分岔。4) 研究熵在单峰情况下的作用,以及负对称散度项在多峰情况下的影响。

关键创新:该论文最重要的技术创新点在于,它提供了一个新的视角来理解对比学习,即从群体几何的角度。通过引入测度论框架,可以将对比学习的优化过程转化为能量景观的分析,从而揭示了单峰和多峰状态之间的几何分岔,以及熵和负对称散度项在学习过程中的作用。这与现有方法中主要关注逐点判别和对齐-均匀性分解的思路有本质区别。

关键设计:论文的关键设计包括:1) 使用测度论来描述表示分布的演化。2) 在大批量限制下,推导确定性的能量景观。3) 分析能量景观的凸性和平衡点,以理解单峰和多峰状态。4) 研究负对称散度项对多模态学习的影响,并解释模态差距的成因。

🖼️ 关键图片

📊 实验亮点

论文通过理论分析揭示了对比学习中单峰和多峰状态之间的几何分岔,并证明了多模态学习中模态差距是结构几何的必然结果,而非初始化伪影。该研究为理解和控制对比学习的表示分布提供了新的理论基础。

🎯 应用场景

该研究成果可应用于改进对比学习算法的设计和优化,特别是在多模态学习和跨模态检索等领域。通过理解表示分布的几何特性,可以更好地控制学习过程,避免分布错位等问题,从而提高模型的性能和泛化能力。此外,该研究也为理解其他基于表示学习的方法提供了新的思路。

📄 摘要(原文)

While InfoNCE powers modern contrastive learning, its geometric mechanisms remain under-characterized beyond the canonical alignment--uniformity decomposition. We present a measure-theoretic framework that models learning as the evolution of representation measures on a fixed embedding manifold. By establishing value and gradient consistency in the large-batch limit, we bridge the stochastic objective to explicit deterministic energy landscapes, uncovering a fundamental geometric bifurcation between the unimodal and multimodal regimes. In the unimodal setting, the intrinsic landscape is strictly convex with a unique Gibbs equilibrium; here, entropy acts merely as a tie-breaker, clarifying "uniformity" as a constrained expansion within the alignment basin. In contrast, the symmetric multimodal objective contains a persistent negative symmetric divergence term that remains even after kernel sharpening. We show that this term induces barrier-driven co-adaptation, enforcing a population-level modality gap as a structural geometric necessity rather than an initialization artifact. Our results shift the analytical lens from pointwise discrimination to population geometry, offering a principled basis for diagnosing and controlling distributional misalignment.