PRECISE: Reducing the Bias of LLM Evaluations Using Prediction-Powered Ranking Estimation

作者: Abhishek Divekar, Anirban Majumder

分类: cs.LG, cs.AI, cs.CL

发布日期: 2026-01-26

备注: Accepted at AAAI 2026 - Innovative Applications of AI (IAAI-26)

💡 一句话要点

PRECISE:利用预测驱动的排序估计降低LLM评估的偏差,提升检索系统评估的可靠性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM评估 偏差校正 预测驱动推理 检索系统评估 低资源学习

📋 核心要点

- 现有检索系统评估依赖大量人工标注,成本高昂且耗时。

- PRECISE框架结合少量人工标注和LLM判断,利用预测驱动推理(PPI)降低LLM偏差。

- 实验表明,PRECISE能有效降低Precision@K的估计方差,并在低资源环境下纠正LLM偏差。

📝 摘要(中文)

评估搜索、排序和RAG系统的质量通常需要大量的人工标注。近年来,许多已部署的系统开始探索使用大型语言模型(LLM)作为自动评估器,但其固有的偏差阻碍了直接用于指标估计。我们提出了一个统计框架,扩展了预测驱动推理(PPI),将少量人工标注与LLM判断相结合,以产生需要子实例标注的指标的可靠估计。我们的方法只需要少至100个带人工标注的查询和10,000个未标注的示例,与传统方法相比,显著降低了标注需求。我们针对基于LLM的查询重构应用的 relevance uplift 推理,提出了我们的框架(PRECISE),将PPI扩展到查询-文档级别的子实例标注。通过重构指标集成空间,我们将计算复杂度从O(2^|C|)降低到O(2^K),其中|C|代表语料库大小(数百万级别)。在多个著名检索数据集上的详细实验表明,我们的方法降低了关键业务指标Precision@K的估计方差,同时有效地纠正了低资源环境下的LLM偏差。

🔬 方法详解

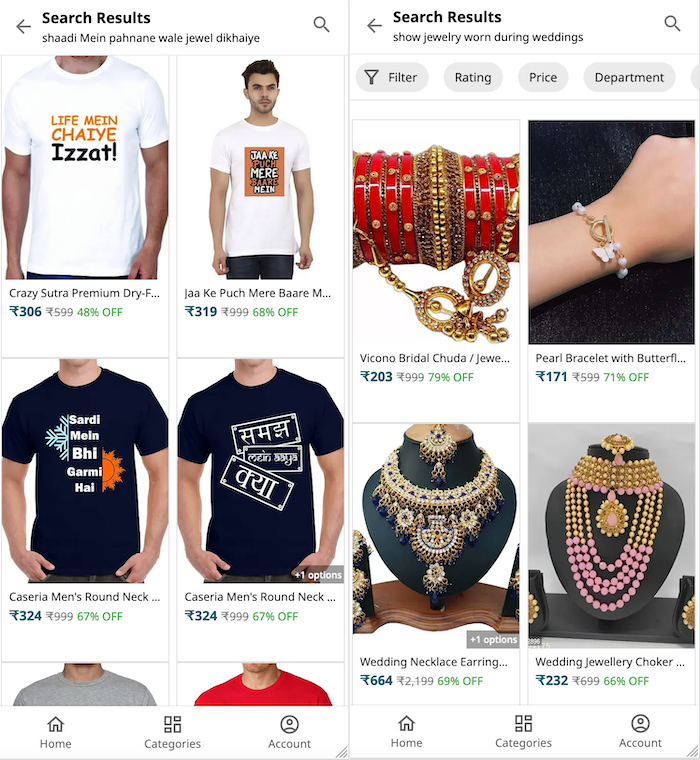

问题定义:论文旨在解决使用大型语言模型(LLM)作为自动评估器评估搜索、排序和RAG系统时,由于LLM固有的偏差导致评估结果不准确的问题。现有方法依赖大量人工标注,成本高昂,而直接使用LLM进行评估又存在偏差,因此需要一种方法在减少人工标注的同时,纠正LLM的偏差,从而实现更可靠的指标估计。

核心思路:论文的核心思路是结合少量人工标注和LLM的判断,利用预测驱动推理(PPI)框架,通过统计方法来校正LLM的偏差。通过将LLM的预测作为辅助信息,并结合少量的人工标注,可以更准确地估计检索系统的性能指标,例如Precision@K。这种方法旨在在人工标注成本和评估准确性之间取得平衡。

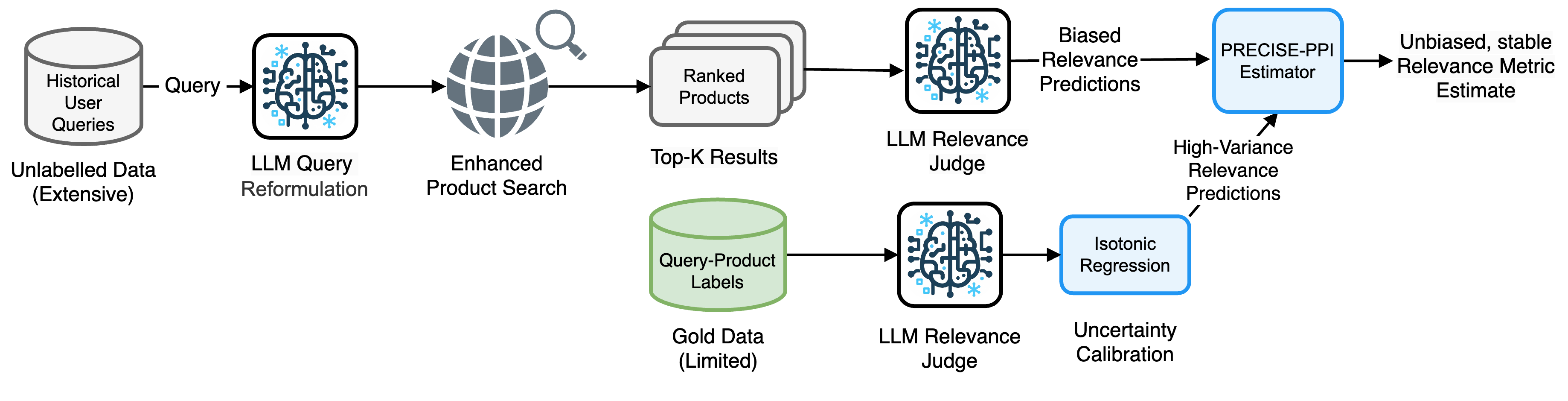

技术框架:PRECISE框架主要包含以下几个阶段:1) 使用LLM对查询-文档对进行相关性判断;2) 对少量查询-文档对进行人工标注;3) 利用PPI框架,结合LLM的预测和人工标注,估计检索系统的性能指标。框架的关键在于如何将LLM的预测和人工标注有效地结合起来,以降低LLM的偏差并提高评估的准确性。此外,论文还通过重构指标集成空间,降低了计算复杂度。

关键创新:论文的关键创新在于将预测驱动推理(PPI)扩展到子实例标注,并将其应用于LLM评估偏差的校正。传统的PPI方法通常用于实例级别的标注,而论文将其扩展到查询-文档级别的子实例标注,使其更适用于检索系统的评估。此外,论文还通过重构指标集成空间,显著降低了计算复杂度,使其能够处理大规模的检索数据集。

关键设计:论文的关键设计包括:1) 如何选择少量的人工标注样本,以最大程度地提高评估的准确性;2) 如何设计PPI框架,以有效地结合LLM的预测和人工标注;3) 如何重构指标集成空间,以降低计算复杂度。论文还针对 relevance uplift 的推理,对PPI框架进行了扩展,使其能够处理更复杂的评估场景。

🖼️ 关键图片

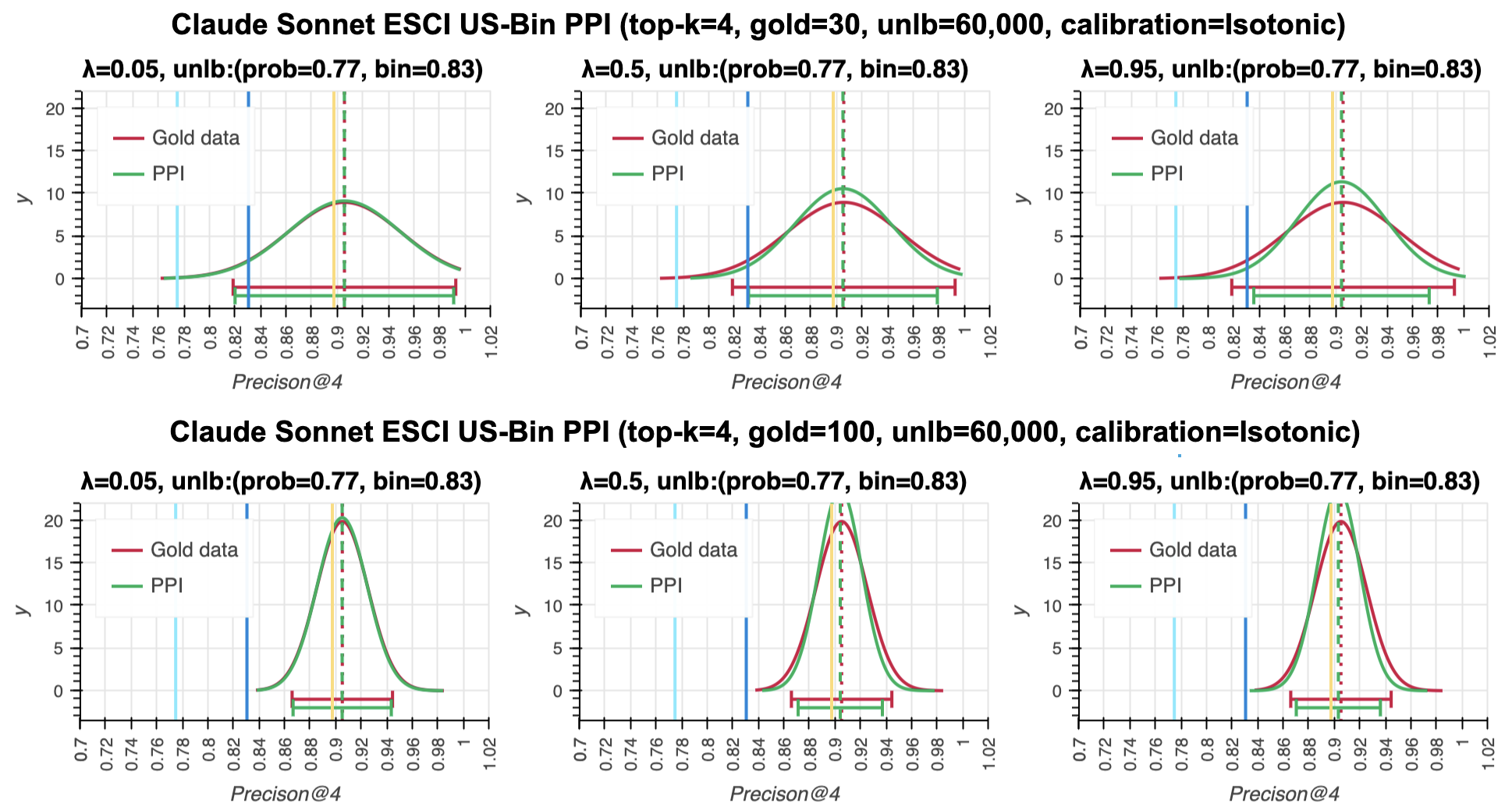

📊 实验亮点

实验结果表明,PRECISE方法在多个著名检索数据集上,能够有效降低Precision@K指标的估计方差,并显著纠正低资源环境下的LLM偏差。该方法仅需100个带人工标注的查询和10,000个未标注的示例,即可达到与传统方法相当甚至更好的评估效果,大大降低了标注成本。

🎯 应用场景

该研究成果可广泛应用于搜索、推荐、问答等系统的评估与优化。通过减少人工标注的需求,降低了系统评估的成本,加速了迭代周期。同时,校正LLM偏差,提升了评估的准确性,有助于构建更可靠、更有效的智能系统。未来,该方法可进一步推广到其他需要大量标注数据的机器学习任务中。

📄 摘要(原文)

Evaluating the quality of search, ranking and RAG systems traditionally requires a significant number of human relevance annotations. In recent times, several deployed systems have explored the usage of Large Language Models (LLMs) as automated judges for this task while their inherent biases prevent direct use for metric estimation. We present a statistical framework extending Prediction-Powered Inference (PPI) that combines minimal human annotations with LLM judgments to produce reliable estimates of metrics which require sub-instance annotations. Our method requires as few as 100 human-annotated queries and 10,000 unlabeled examples, reducing annotation requirements significantly compared to traditional approaches. We formulate our proposed framework (PRECISE) for inference of relevance uplift for an LLM-based query reformulation application, extending PPI to sub-instance annotations at the query-document level. By reformulating the metric-integration space, we reduced the computational complexity from O(2^|C|) to O(2^K), where |C| represents corpus size (in order of millions). Detailed experiments across prominent retrieval datasets demonstrate that our method reduces the variance of estimates for the business-critical Precision@K metric, while effectively correcting for LLM bias in low-resource settings.