Beyond Preferences: Learning Alignment Principles Grounded in Human Reasons and Values

作者: Henry Bell, Lara Neubauer da Costa Schertel, Bochu Ding, Brandon Fain

分类: cs.LG, cs.CL

发布日期: 2026-01-26

💡 一句话要点

提出GCAI框架,通过融合用户理由和价值观生成更优的AI对齐原则宪法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI对齐 宪法AI 价值观对齐 用户偏好 理由提取

📋 核心要点

- 现有宪法AI方法在确定AI对齐原则时,缺乏对用户偏好背后理由和价值观的充分考虑,导致宪法代表性不足。

- GCAI框架通过融合用户提供的偏好理由和价值观声明,生成更具代表性的原则宪法,从而提升AI对齐效果。

- 实验表明,GCAI生成的宪法在用户偏好、道德基础、连贯性和多元性方面均优于ICAI生成的宪法。

📝 摘要(中文)

在开发和部署大型语言模型(LLM)时,一个关键的考虑因素是这些模型与人类价值观的对齐程度。在宪法框架下,对齐模型与一套以自然语言指定的原则(宪法)对齐。然而,如何通过广泛的利益相关者输入来公平地确定这部宪法尚不清楚。本文提出了Grounded Constitutional AI(GCAI),这是一个统一的框架,用于生成代表用户对AI的普遍期望(通用原则)和他们的交互时偏好(上下文原则)的原则宪法。我们扩展了逆宪法AI(ICAI)方法,通过利用人类提供的偏好 extit{理由},从人类偏好注释数据中生成上下文原则。我们用从用户关于AI的 extit{价值观}声明中提取的通用原则来补充这些上下文原则。我们表明,由GCAI生成的宪法在个人层面和广泛用于管理AI行为方面都比通过ICAI生成的宪法更受人类欢迎。此外,参与者认为GCAI宪法在道德上更扎实、更连贯和更具多元性。

🔬 方法详解

问题定义:现有宪法AI方法,如ICAI,主要依赖于用户偏好数据来生成AI对齐原则。然而,这些方法忽略了用户做出偏好选择的深层原因和潜在价值观,导致生成的宪法可能无法充分代表用户的真实意愿和期望。因此,如何更全面、更公平地生成AI对齐原则宪法是一个亟待解决的问题。

核心思路:GCAI的核心思路是将用户偏好背后的“理由”(reasons)和“价值观”(values)融入到宪法生成过程中。通过分析用户给出偏好的原因,可以更深入地理解用户的意图和目标。同时,考虑用户对AI的普遍价值观,可以确保生成的宪法不仅符合特定场景下的偏好,也符合更广泛的道德和社会规范。

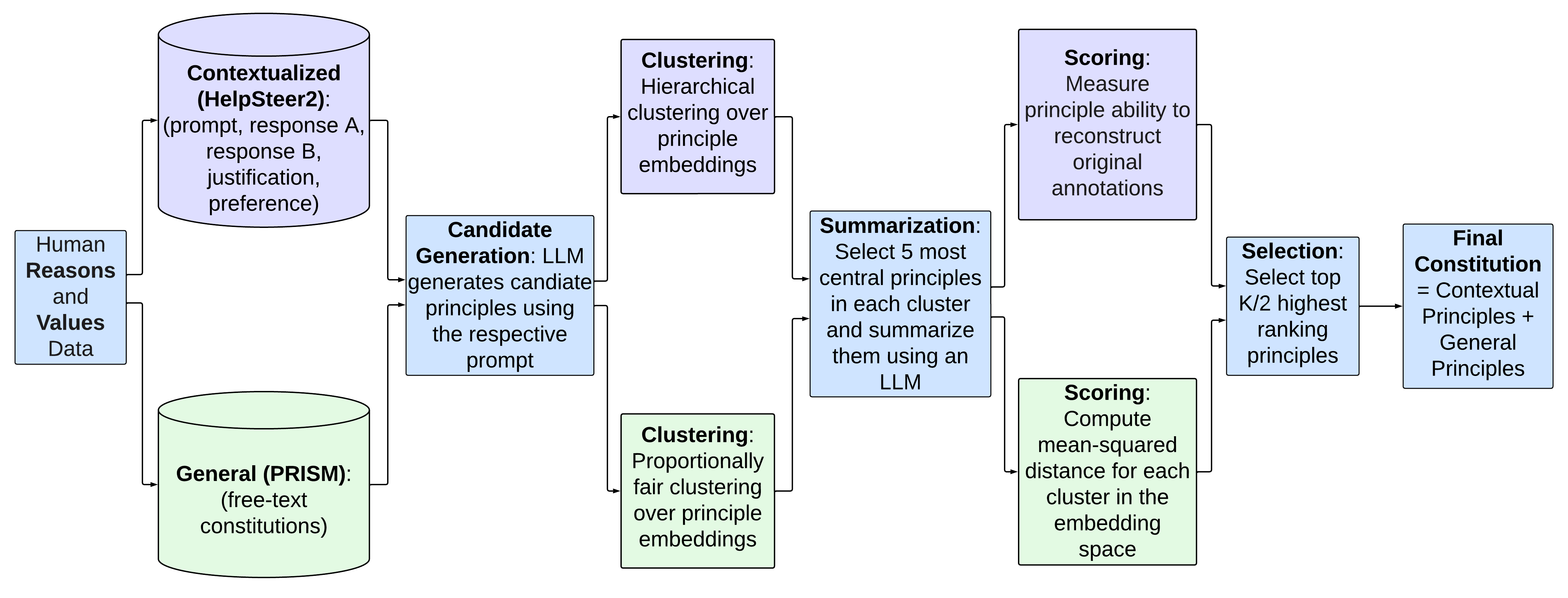

技术框架:GCAI框架包含两个主要组成部分:1) 基于用户偏好理由生成上下文原则;2) 基于用户价值观声明生成通用原则。首先,扩展ICAI方法,利用用户提供的偏好理由,从偏好标注数据中生成上下文原则。然后,从用户关于AI的价值观声明中提取通用原则。最后,将上下文原则和通用原则整合,形成最终的宪法。

关键创新:GCAI的关键创新在于将用户偏好背后的“理由”和“价值观”显式地纳入到宪法生成过程中。与传统的ICAI方法相比,GCAI不仅考虑用户的偏好选择,还深入挖掘用户做出选择的原因和潜在价值观,从而生成更具代表性和合理性的宪法。

关键设计:GCAI框架的关键设计包括:1) 如何有效地从用户偏好理由中提取上下文原则;2) 如何从用户价值观声明中提取通用原则;3) 如何将上下文原则和通用原则进行有效整合。论文可能使用了特定的自然语言处理技术,例如文本摘要、主题建模或关键词提取等,来从用户提供的文本数据中提取关键信息。具体的损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,由GCAI生成的宪法在用户偏好方面优于ICAI生成的宪法。具体而言,参与者更倾向于使用GCAI宪法来管理AI行为,并且认为GCAI宪法在道德基础、连贯性和多元性方面都更胜一筹。具体的性能提升数据未知。

🎯 应用场景

GCAI框架可应用于各种需要AI对齐的场景,例如:自动驾驶、医疗诊断、金融风控等。通过生成更符合人类价值观和偏好的AI对齐原则,可以提高AI系统的安全性、可靠性和公平性,从而促进AI技术的健康发展和社会应用。

📄 摘要(原文)

A crucial consideration when developing and deploying Large Language Models (LLMs) is the human values to which these models are aligned. In the constitutional framework of alignment models are aligned to a set of principles (the constitution) specified in natural language. However, it is unclear how to fairly determine this constitution with widespread stakeholder input. In this work we propose Grounded Constitutional AI (GCAI), a unified framework for generating constitutions of principles that are representative of both users' general expectations toward AI (general principles) and their interaction-time preferences (contextual principles). We extend the Inverse Constitutional AI (ICAI) approach to generate contextual principles from human preference annotation data by leveraging human-provided \textit{reasons} for their preferences. We supplement these contextual principles with general principles surfaced from user statements of \textit{values} regarding AI. We show that a constitution generated by GCAI is preferred by humans over one generated through ICAI both personally, and for widespread use in governing AI behavior. Additionally participants consider the GCAI constitution to be more morally grounded, coherent, and pluralistic.