DANCE: Dynamic, Available, Neighbor-gated Condensation for Federated Text-Attributed Graphs

作者: Zekai Chen, Haodong Lu, Xunkai Li, Henan Sun, Jia Li, Hongchao Qin, Rong-Hua Li, Guoren Wang

分类: cs.LG

发布日期: 2026-01-23

💡 一句话要点

DANCE:动态、可用、邻居门控的联邦文本属性图压缩学习

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦图学习 文本属性图 图压缩 大型语言模型 可解释性 模型在环 邻居门控

📋 核心要点

- 现有TAG-FGL方法在处理长文本属性时面临高昂的计算开销,且图压缩策略缺乏客户端自适应性,导致性能次优。

- DANCE通过回合式的模型在环压缩刷新,利用最新的全局模型动态调整压缩策略,提升客户端自适应性。

- DANCE通过存储可追溯的证据包,将预测结果与邻居和源文本关联,增强了模型的可解释性,并在多个数据集上取得了显著的性能提升。

📝 摘要(中文)

联邦图学习(FGL)支持跨多个客户端的图数据协同训练。随着大型语言模型(LLM)的兴起,FGL图中包含的文本属性越来越受到关注。文本属性图联邦学习(TAG-FGL)通过显式地利用LLM处理和整合这些文本特征来改进FGL。然而,当前的TAG-FGL方法面临三个主要挑战:(1)开销:LLM处理长文本会产生高昂的token和计算成本。为了使TAG-FGL实用,我们引入图压缩(GC)来减少计算负载,但这也带来了新的问题。(2)次优:为了减少LLM开销,我们将GC引入TAG-FGL,通过将多跳文本/邻域压缩成具有固定LLM代理的压缩核心。然而,这种一次性压缩通常不具有客户端自适应性,导致次优性能。(3)可解释性:基于LLM的压缩进一步引入了一个黑盒瓶颈:摘要缺乏忠实的属性,并且没有明确地基于特定的源跨度,使得本地检查和审计变得困难。为了解决上述问题,我们提出了DANCE,一种新的带有GC的TAG-FGL范式。为了提高次优性能,DANCE使用最新的全局模型执行回合式的、模型在环的压缩刷新。为了增强可解释性,DANCE通过存储本地可检查的证据包来保留溯源信息,这些证据包将预测追溯到选定的邻居和源文本跨度。在8个TAG数据集上,DANCE在8%的压缩率下提高了2.33%的准确率,并且比基线方法减少了33.42%的token。

🔬 方法详解

问题定义:论文旨在解决文本属性图联邦学习(TAG-FGL)中,使用大型语言模型(LLM)处理长文本属性时带来的高计算开销、压缩过程的次优性能以及模型可解释性差的问题。现有方法通常采用一次性的图压缩策略,无法适应不同客户端的数据分布,导致性能下降。此外,基于LLM的压缩过程缺乏透明度,难以追溯预测结果的来源。

核心思路:DANCE的核心思路是引入动态的、可用的、邻居门控的图压缩机制,以提升TAG-FGL的性能和可解释性。具体来说,DANCE采用回合式的模型在环压缩刷新策略,利用最新的全局模型指导压缩过程,使压缩结果更具客户端自适应性。同时,DANCE保留了可追溯的证据包,将预测结果与选定的邻居和源文本跨度关联起来,增强了模型的可解释性。

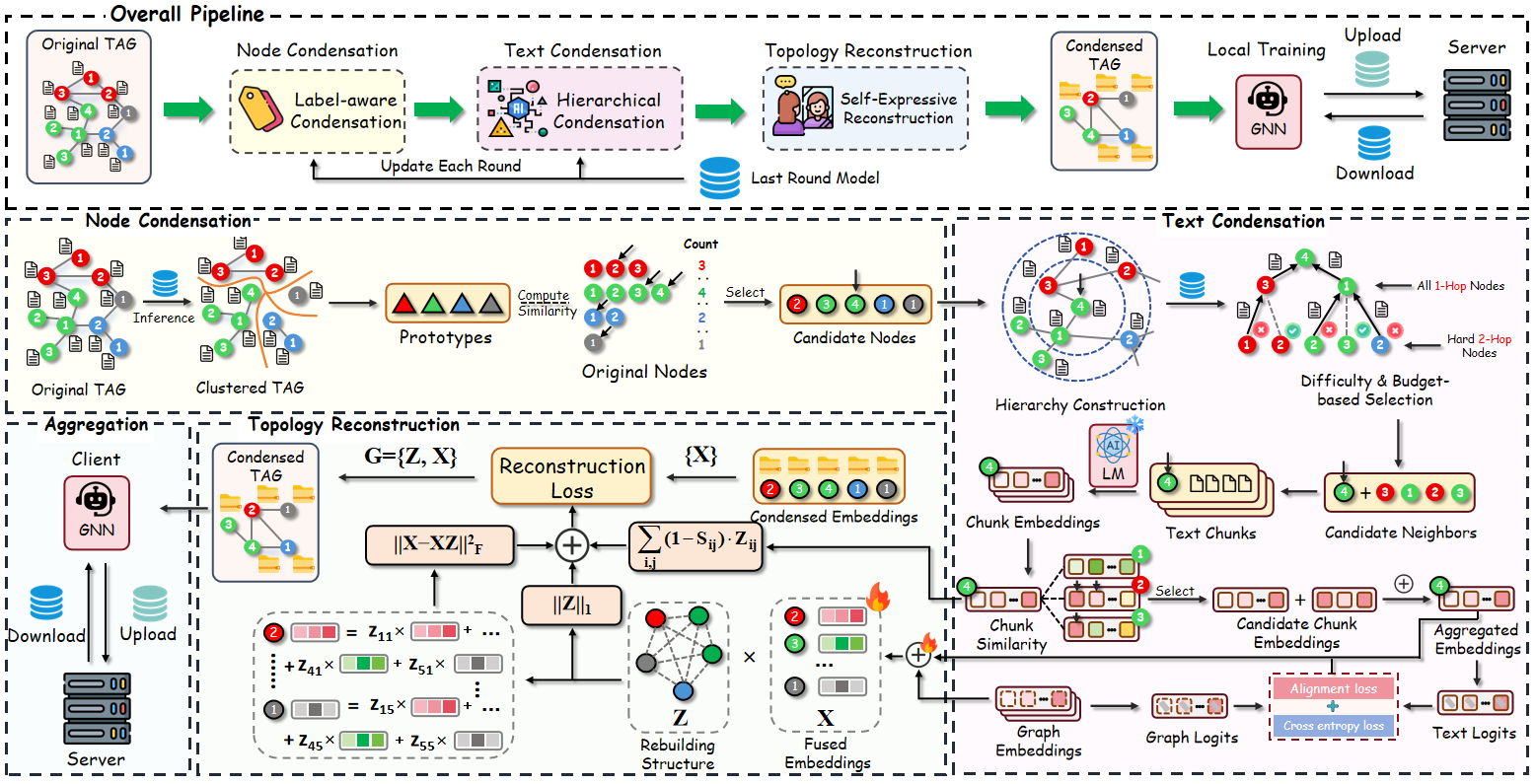

技术框架:DANCE的整体框架包括以下几个主要阶段:1) 客户端本地训练:每个客户端使用本地数据和全局模型进行训练。2) 图压缩:客户端使用动态的、邻居门控的压缩策略,将文本属性图压缩成更小的表示。3) 模型聚合:服务器聚合来自各个客户端的压缩模型,更新全局模型。4) 证据包构建:客户端构建证据包,记录预测结果与邻居和源文本的关联。5) 模型在环压缩刷新:使用更新后的全局模型指导下一轮的图压缩过程。

关键创新:DANCE的关键创新在于以下几个方面:1) 动态压缩:采用回合式的模型在环压缩刷新策略,使压缩过程更具客户端自适应性。2) 邻居门控:通过邻居门控机制选择重要的邻居节点,减少噪声信息的干扰。3) 可解释性:保留可追溯的证据包,增强了模型的可解释性。

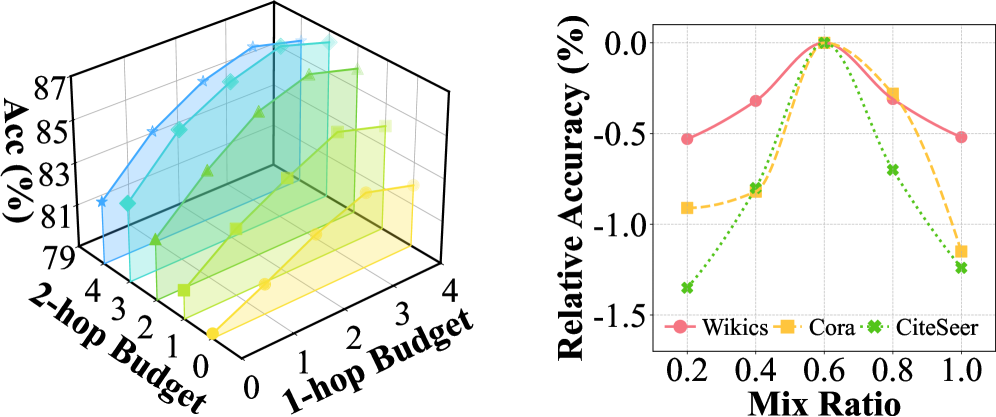

关键设计:DANCE的关键设计包括:1) 压缩率的设置:需要根据数据集的特点和计算资源进行调整。2) 邻居门控机制的设计:需要选择合适的邻居选择策略,以保留重要的邻居信息。3) 证据包的构建方式:需要设计合理的证据包结构,以便于追溯预测结果的来源。4) 损失函数的设计:需要考虑压缩过程对模型性能的影响,设计合适的损失函数。

🖼️ 关键图片

📊 实验亮点

DANCE在8个文本属性图数据集上进行了实验,结果表明,在8%的压缩率下,DANCE的准确率提高了2.33%,并且比基线方法减少了33.42%的token。这些结果表明,DANCE能够有效地提高TAG-FGL的性能和效率。

🎯 应用场景

DANCE在社交网络分析、知识图谱推理、推荐系统等领域具有广泛的应用前景。例如,在社交网络中,DANCE可以用于分析用户之间的关系和文本内容,从而进行用户画像和社区发现。在知识图谱中,DANCE可以用于推理实体之间的关系,从而进行知识补全和问答。在推荐系统中,DANCE可以用于分析用户和物品之间的关系和文本描述,从而进行个性化推荐。

📄 摘要(原文)

Federated graph learning (FGL) enables collaborative training on graph data across multiple clients. With the rise of large language models (LLMs), textual attributes in FGL graphs are gaining attention. Text-attributed graph federated learning (TAG-FGL) improves FGL by explicitly leveraging LLMs to process and integrate these textual features. However, current TAG-FGL methods face three main challenges: \textbf{(1) Overhead.} LLMs for processing long texts incur high token and computation costs. To make TAG-FGL practical, we introduce graph condensation (GC) to reduce computation load, but this choice also brings new issues. \textbf{(2) Suboptimal.} To reduce LLM overhead, we introduce GC into TAG-FGL by compressing multi-hop texts/neighborhoods into a condensed core with fixed LLM surrogates. However, this one-shot condensation is often not client-adaptive, leading to suboptimal performance. \textbf{(3) Interpretability.} LLM-based condensation further introduces a black-box bottleneck: summaries lack faithful attribution and clear grounding to specific source spans, making local inspection and auditing difficult. To address the above issues, we propose \textbf{DANCE}, a new TAG-FGL paradigm with GC. To improve \textbf{suboptimal} performance, DANCE performs round-wise, model-in-the-loop condensation refresh using the latest global model. To enhance \textbf{interpretability}, DANCE preserves provenance by storing locally inspectable evidence packs that trace predictions to selected neighbors and source text spans. Across 8 TAG datasets, DANCE improves accuracy by \textbf{2.33\%} at an \textbf{8\%} condensation ratio, with \textbf{33.42\%} fewer tokens than baselines.