Endless Terminals: Scaling RL Environments for Terminal Agents

作者: Kanishk Gandhi, Shivam Garg, Noah D. Goodman, Dimitris Papailiopoulos

分类: cs.LG, cs.CL

发布日期: 2026-01-23

💡 一句话要点

提出Endless Terminals,用于大规模生成终端任务以训练强化学习Agent。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 终端任务 环境生成 自动化运维 程序化生成

📋 核心要点

- 现有终端基准主要用于评估,而非训练,缺乏可扩展性,无法满足强化学习的需求。

- Endless Terminals通过程序化生成终端任务,构建可扩展的强化学习环境,无需人工标注。

- 实验表明,在Endless Terminals上训练的Agent在多个基准测试中均取得了显著的性能提升。

📝 摘要(中文)

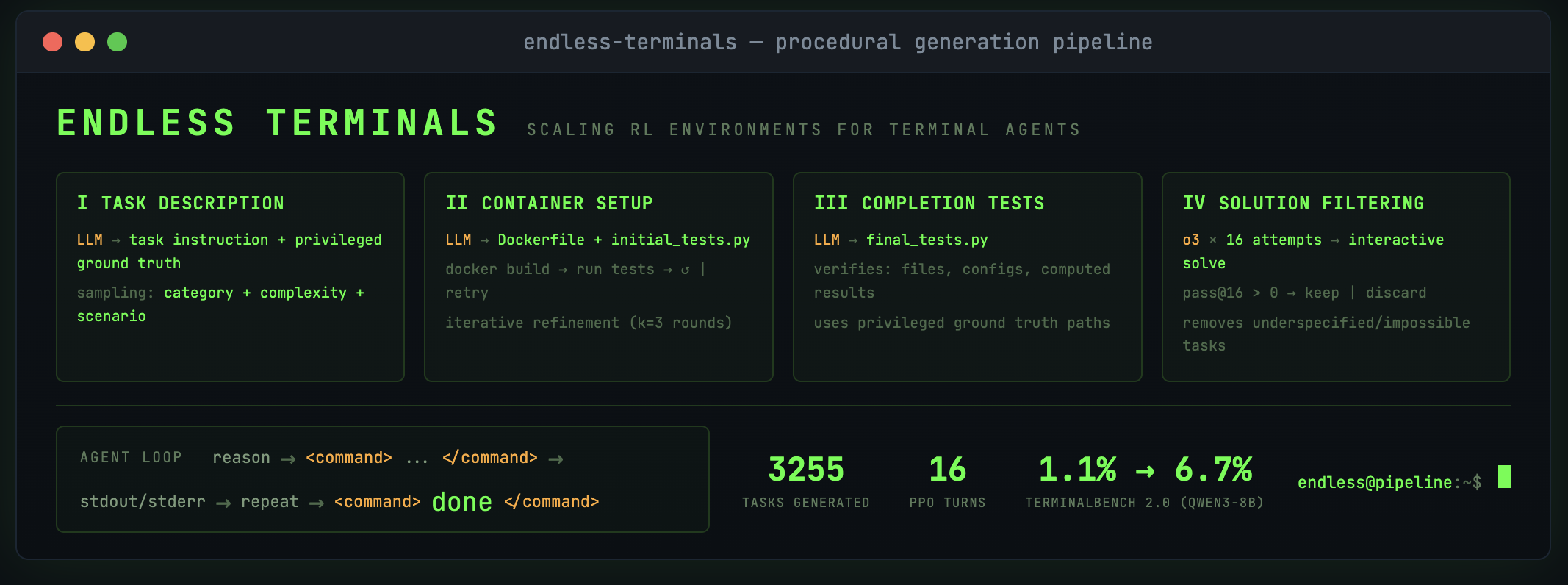

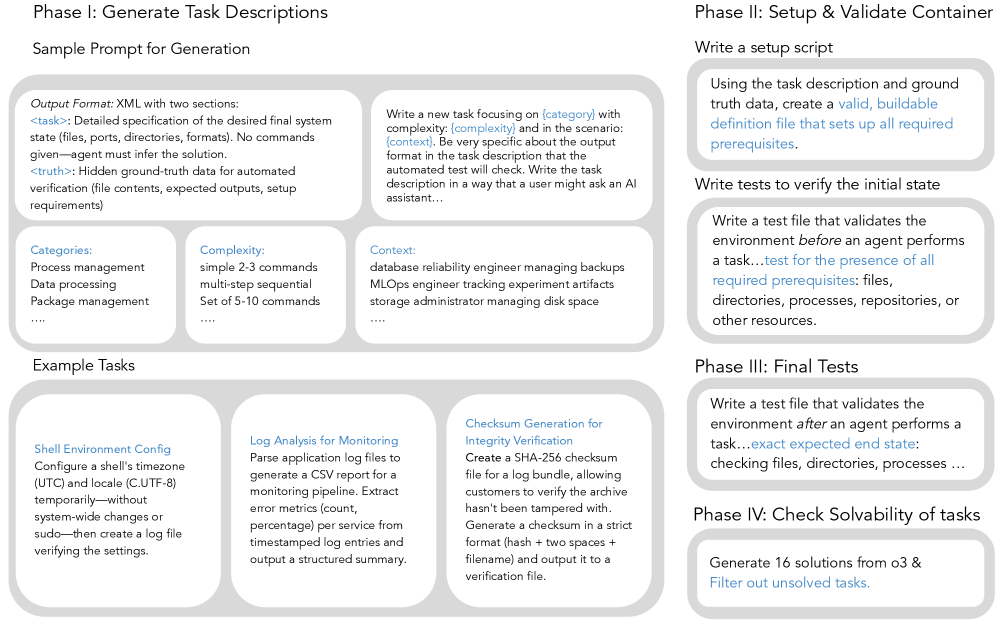

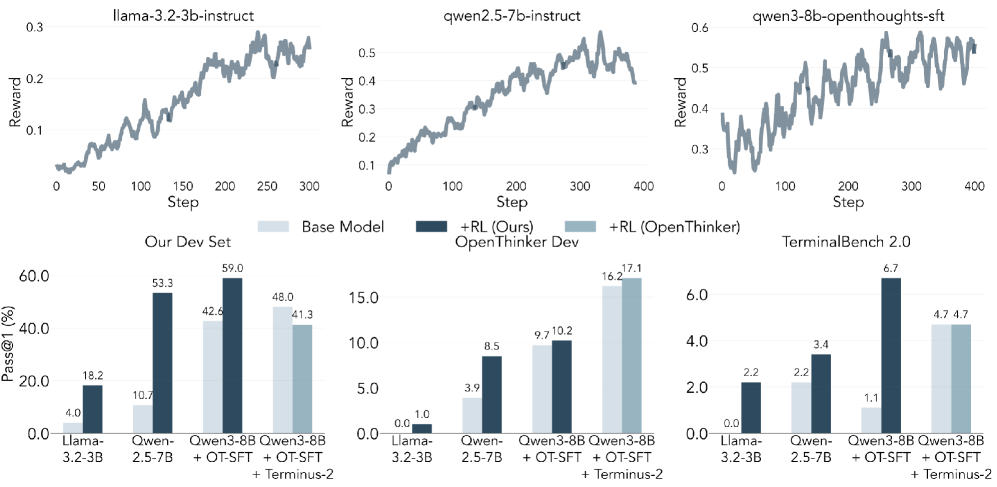

本文提出Endless Terminals,一个全自动的流程,用于程序化地生成终端使用任务,无需人工标注。该流程包含四个阶段:生成多样化的任务描述,构建和验证容器化的环境,生成完成测试,以及过滤任务以保证可解性。通过该流程,我们获得了3255个任务,涵盖文件操作、日志管理、数据处理、脚本编写和数据库操作。我们使用带有二元episode级别奖励的Vanilla PPO训练Agent,并采用最小的交互循环:没有检索、多Agent协作或专用工具。尽管如此简单,在Endless Terminals上训练的模型显示出显著的提升:在我们的held-out开发集上,Llama-3.2-3B从4.0%提高到18.2%,Qwen2.5-7B从10.7%提高到53.3%,Qwen3-8B-openthinker-sft从42.6%提高到59.0%。这些改进迁移到人工标注的基准测试中:在TerminalBench 2.0上,Llama-3.2-3B从0.0%提高到2.2%,Qwen2.5-7B从2.2%提高到3.4%,Qwen3-8B-openthinker-sft从1.1%提高到6.7%,在每种情况下都优于其他方法,包括具有更复杂Agent框架的模型。这些结果表明,当环境规模扩大时,简单的强化学习也能成功。

🔬 方法详解

问题定义:现有强化学习Agent的训练受限于环境的规模和多样性,特别是终端任务相关的环境。现有的终端基准测试集主要用于评估,缺乏生成大规模训练数据的能力,且人工标注成本高昂。因此,如何高效、自动地生成大规模、多样化的终端任务环境成为一个关键问题。

核心思路:Endless Terminals的核心思路是构建一个全自动化的流程,通过程序化生成任务描述、构建环境、生成测试和过滤任务,从而实现大规模终端任务环境的自动生成。这种方法避免了人工标注的成本,并能够灵活地扩展任务的种类和难度。

技术框架:Endless Terminals包含四个主要阶段:1) 任务描述生成:生成多样化的任务描述,例如文件操作、日志管理等。2) 环境构建与验证:基于任务描述,构建容器化的环境,并进行验证,确保环境的稳定性和可用性。3) 完成测试生成:生成用于判断Agent是否成功完成任务的测试用例。4) 任务过滤:根据任务的可解性进行过滤,保留Agent能够学习的任务。整个流程无需人工干预,可以持续生成新的任务和环境。

关键创新:Endless Terminals最重要的创新点在于其全自动化的任务生成流程。与以往依赖人工标注或有限数量预定义任务的方法不同,Endless Terminals能够程序化地生成大规模、多样化的终端任务,从而显著提升了强化学习Agent的训练效果。这种方法使得Agent能够接触到更广泛的任务类型,从而提高其泛化能力。

关键设计:在任务描述生成阶段,使用了某种任务描述语言(具体细节未知)来定义任务的类型、输入和预期输出。在环境构建阶段,使用了容器化技术(如Docker)来保证环境的隔离性和可重复性。在奖励函数设计上,使用了简单的二元episode级别奖励,即任务成功完成则奖励为1,否则为0。Agent使用Vanilla PPO算法进行训练,没有使用复杂的Agent框架或专用工具。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Endless Terminals上训练的Agent在held-out开发集和人工标注的TerminalBench 2.0基准测试中均取得了显著的性能提升。例如,Qwen2.5-7B在开发集上的成功率从10.7%提高到53.3%,在TerminalBench 2.0上的成功率从2.2%提高到3.4%,优于其他方法,包括具有更复杂Agent框架的模型。

🎯 应用场景

Endless Terminals可应用于训练能够自主完成各种终端任务的智能Agent,例如自动化运维、系统管理、数据处理等。该研究成果有助于提升Agent在实际应用场景中的适应性和效率,降低人工运维成本,并为开发更智能的自动化工具奠定基础。

📄 摘要(原文)

Environments are the bottleneck for self-improving agents. Current terminal benchmarks were built for evaluation, not training; reinforcement learning requires a scalable pipeline, not just a dataset. We introduce Endless Terminals, a fully autonomous pipeline that procedurally generates terminal-use tasks without human annotation. The pipeline has four stages: generating diverse task descriptions, building and validating containerized environments, producing completion tests, and filtering for solvability. From this pipeline we obtain 3255 tasks spanning file operations, log management, data processing, scripting, and database operations. We train agents using vanilla PPO with binary episode level rewards and a minimal interaction loop: no retrieval, multi-agent coordination, or specialized tools. Despite this simplicity, models trained on Endless Terminals show substantial gains: on our held-out dev set, Llama-3.2-3B improves from 4.0% to 18.2%, Qwen2.5-7B from 10.7% to 53.3%, and Qwen3-8B-openthinker-sft from 42.6% to 59.0%. These improvements transfer to human-curated benchmarks: models trained on Endless Terminals show substantial gains on held out human curated benchmarks: on TerminalBench 2.0, Llama-3.2-3B improves from 0.0% to 2.2%, Qwen2.5-7B from 2.2% to 3.4%, and Qwen3-8B-openthinker-sft from 1.1% to 6.7%, in each case outperforming alternative approaches including models with more complex agentic scaffolds. These results demonstrate that simple RL succeeds when environments scale.